高阶Transformer结合多模态数据,有效提升股票走势预测准确率,KDD 2024最新研究成果。

原文标题:高阶Transformer可在多模态时间序列数据上提升股票走势预测

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、高阶Transformer的计算复杂度如何控制?

3、如何评估股票预测模型的实际盈利能力?

原文内容

来源:时序人本文约2800字,建议阅读5分钟

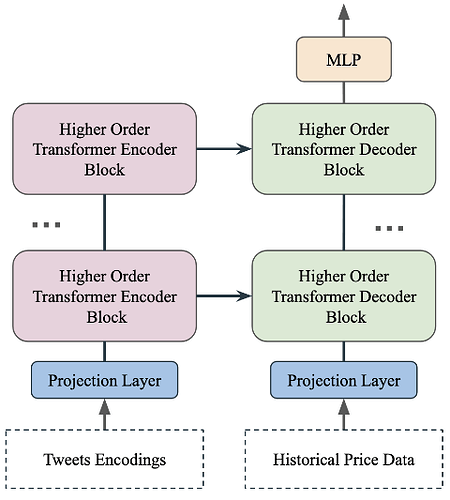

本文提出了一种专为处理多模态股票数据以预测股票走势而设计的高阶 Transformer架构。

对于投资者和交易者来说,预测金融市场中股票走势十分重要,因为这能使他们做出明智的决策并提高盈利能力。然而,由于市场动态的随机性、股票价格的非平稳性以及历史价格之外众多因素的影响,这一任务本质上极具挑战性。

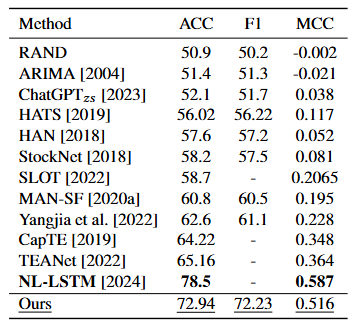

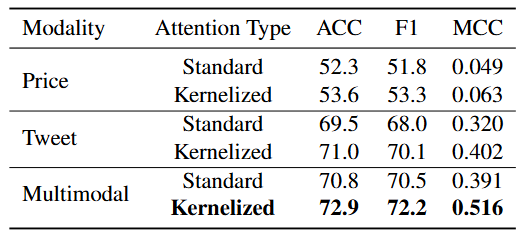

国外研究者通过引入高阶 Transformer 这一专为处理多变量时间序列数据设计的新型架构,解决了金融市场股票走势预测的挑战。将自注意力机制和 Transformer 架构扩展到更高阶,有效地捕捉了时间和变量之间的复杂市场动态。为了管理计算复杂性,研究者提出使用张量分解对可能较大的注意力张量进行低秩近似,并采用核注意力,从而将复杂性降低到与数据量成线性关系。此外,还提出了一个融合了技术分析和基本面分析的编码器-解码器模型,该模型利用了历史价格和相关推文的多模态信号。研究者在 Stocknet 数据集上进行的实验证明了该方法的有效性,凸显了其在提升金融市场股票走势预测潜力方面的作用。该工作已被 KDD 2024 接收。

【论文标题】

Higher Order Transformers: Enhancing Stock Movement Prediction On Multimodal Time-Series Data

【论文地址】

https://arxiv.org/abs/2412.10540

-

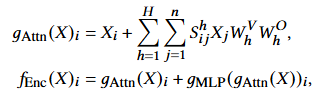

标准Transformer层

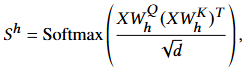

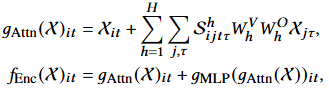

Transformer 编码层包含两个主要部分:自注意力层和逐元素前馈层。对于一组输入向量,Transformer 层计算特定的公式,包括自注意力和前馈网络的计算。

-

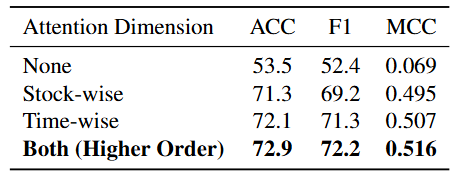

高阶Transformer层

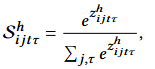

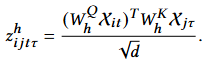

为了将缩放点积注意力的公式推广到高阶输入数据,研究者将注意力的概念扩展到张量。不仅定义了 Transformer 编码层作为一个函数,包括自注意力和前馈网络的计算,并且注意力分数的计算也进行了相应的扩展。

-

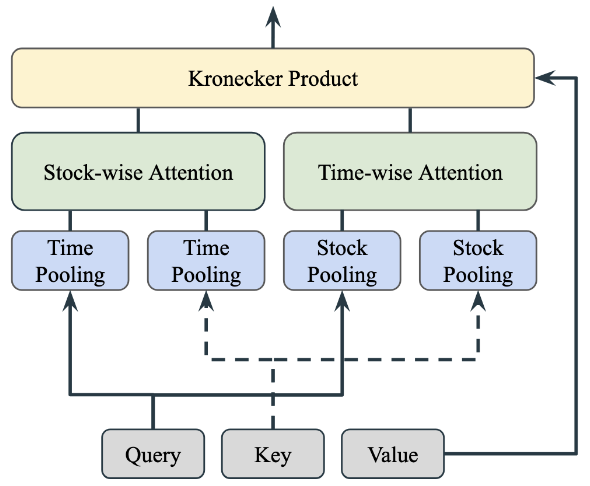

低秩近似与Kronecker分解

考虑注意力矩阵作为将张量重塑为变量和时间维度的扁平化结果。使用 Kronecker 分解参数化注意力矩阵,并展示了如何通过 Kronecker 分解来近似原始的注意力张量。

-

线性注意力与核技巧

采用核化线性注意力,通过使用合适的核函数来近似注意力矩阵,从而实现了线性计算复杂度。