本文约1600字,建议阅读5分钟

近日,斯坦福大学团队在利用 AI 复制大脑如何组织感官信息来理解世界的方式方面取得了重大进展,为虚拟神经科学开辟了新的领域。

当我们看着时钟的秒针移动时,我们的大脑会激活一系列的神经元,这些神经元对特定的视觉角度敏感。这些细胞形成美丽的「风车」图,每部分代表不同角度的视觉感知。

大脑的视觉区域还包含更复杂和抽象的视觉特征图,如面孔识别和场景理解等。

这样的功能图遍布整个大脑,让神经科学家既高兴又困惑,他们长期以来一直想知道,为什么大脑应该进化出只有现代科学才能观察到的地图式布局。

近日,斯坦福大学团队在利用 AI 复制大脑如何组织感官信息来理解世界的方式方面取得了重大进展,为虚拟神经科学开辟了新的领域。

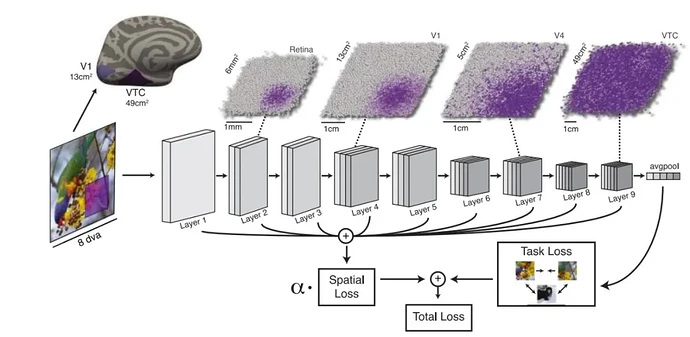

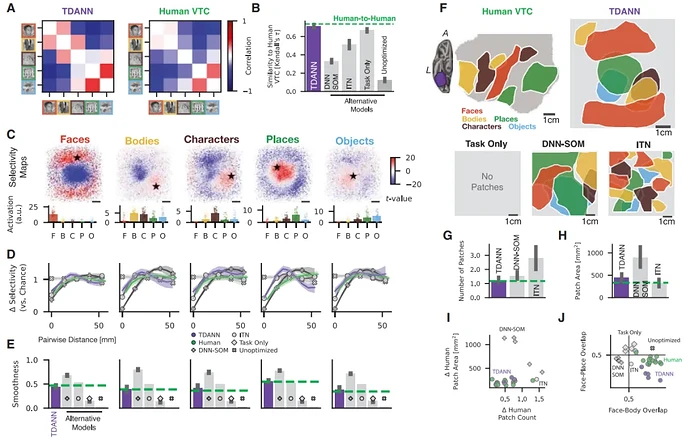

研究人员开发了一种新的人工智能算法——拓扑深度人工神经网络 (Topographic Deep Artificial Neural Network,TDANN),这是第一个预测灵长类视觉系统中多个皮质区域功能组织几个方面的模型。

TDANN 只使用两个规则:自然感官输入和连接的空间约束;它成功预测了人类大脑视觉系统多个部分的感官反应和空间组织。

经过七年的深入研究,该研究成果以《A unifying framework for functional organization in early and higher ventral visual cortex》为题,于 5 月 10 日发表在《Neuron》杂志上。

论文链接:https://doi.org/10.1016/j.neuron.2024.04.018

与传统神经网络不同,TDANN 结合了空间约束,将其虚拟神经元排列在二维「皮质片」(cortical sheet)上,并要求附近的神经元对感官输入有相似的反应。

图示:TDANN 架构。(来源:论文)

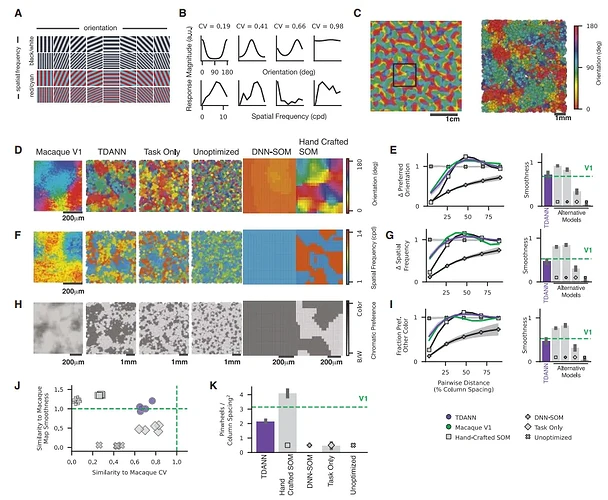

当模型学会处理图像时,这种拓扑结构使其形成空间地图,复制大脑中的神经元如何响应视觉刺激而自我组织。具体来说,该模型复制了复杂的模式,例如初级视觉皮层 (V1) 中的风车结构和高级腹侧颞叶皮层 (VTC) 中对面部或地点等类别作出反应的神经元簇。

图示:TDANN 对 V1 拓扑的预测。(来源:论文)

图示:TDANN 对高级视觉皮层拓扑结构的预测。(来源:论文)

该团队使用自监督学习方法来提高模拟大脑的训练模型的准确性。

论文一作 Eshed Margalit 博士说:「这可能更像婴儿学习视觉世界的方式,我认为我们最初并没有预料到它会对训练模型的准确性产生如此大的影响,但你真的需要正确地完成网络的训练任务,才能让它成为一个好的大脑模型。」

完全可训练的模型将帮助神经科学家更好地理解大脑如何组织自身的规则,无论是视觉还是其他感官系统(如听觉)。

这种创新方法对神经科学和人工智能都有重要意义。对于神经科学家来说,TDANN 提供了一个研究视觉皮层如何发育和运作的新视角,有可能改变神经系统疾病的治疗方法。对于人工智能来说,从大脑组织中获得的见解可以带来更复杂的视觉处理系统,类似于教计算机像人类一样「看」。

这些发现还可以帮助解释人类大脑如何以如此高的能量效率运作。例如,人类大脑仅用 20 瓦的功率就可以计算出数十亿次数学运算,而超级计算机则需要多一百万倍的能量才能完成同样的数学运算。

新的发现强调,神经元图谱——以及驱动它们的空间或拓扑约束——可能有助于使连接大脑 1000 亿个神经元的线路尽可能简单。这些见解可能是设计受大脑启发的更高效人工系统的关键。

更节能的人工智能可以帮助发展虚拟神经科学,从而可以更快地进行更大规模的实验。在他们的研究中,研究人员证明了他们的 TDANN 可以对广泛的自然视觉刺激产生类似大脑的反应,这表明这种系统将来可以用作快速、廉价的神经科学实验原型的「游乐场」,并为未来的测试快速确定假设。

虚拟神经科学实验还可以促进人类医疗保健。例如,更好地训练人工视觉系统(就像婴儿通过视觉了解世界一样)可能有助于人工智能像人类一样看待世界,在人类眼中,视线的中心比视野的其他部分更清晰。另一个应用可以帮助开发视觉假肢,或准确模拟疾病和伤害如何影响大脑的各个部分。

「如果你能做一些事情,比如做出预测,这将有助于为失明的人开发假肢设备,我认为这将是一件了不起的事情。」斯坦福大学心理学教授 Grill-Spector 说。

参考内容:https://medicalxpress.com/news/2024-05-neuroscientists-ai-simulate-brain-visual.html

编辑:文婧