斯坦福博士论文提出利用图神经网络(GNNs)提升图表示学习的表达力、可扩展性和可解释性,并展示了其在多个领域的应用。

原文标题:【斯坦福博士论文】朝向具表达力和可扩展的深度图表示学习

原文作者:数据派THU

冷月清谈:

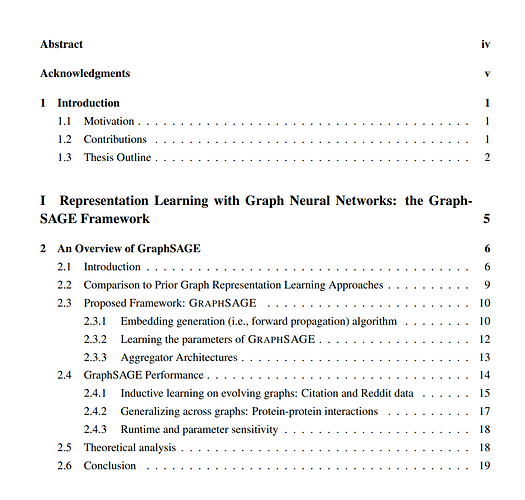

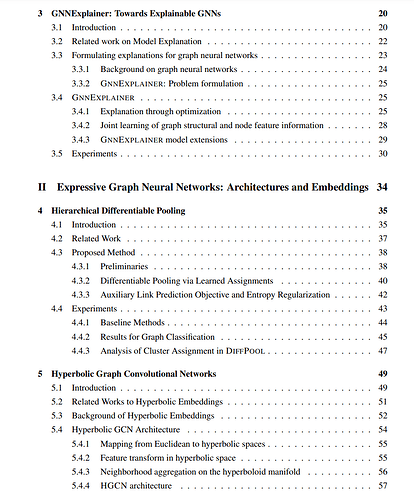

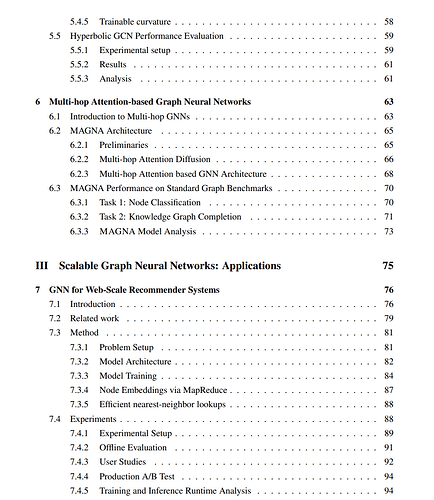

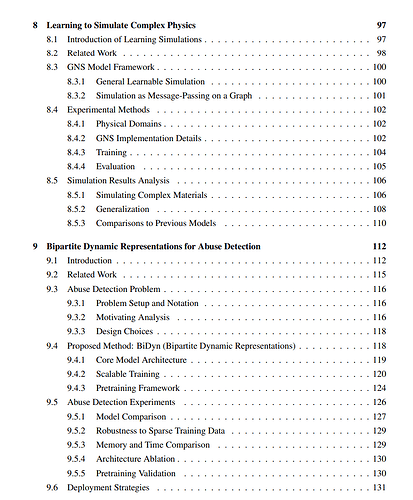

论文首先指出了传统图表示学习方法的局限性,例如难以扩展到大型图、表达能力不足以及在归纳场景中的局限性。然后,作者介绍了GraphSAGE框架,这是一个通用且强大的GNN框架,并提出了一种扩展模型以提高其可解释性。

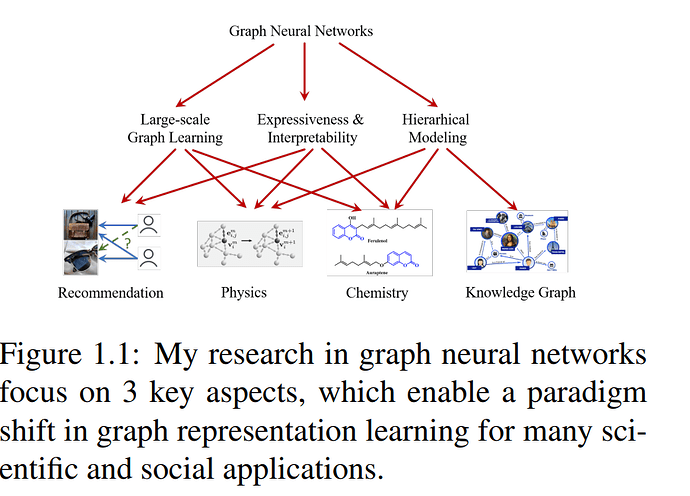

为了提升GNNs的表达能力,论文探索了多种方法,包括使用分层结构、几何嵌入空间以及多跳注意力机制。这些改进的GNN架构在分子图分类、知识图谱和大规模引文网络等任务中取得了显著的性能提升。

论文还展示了GNNs在实际应用中的案例,例如PinSAGE模型,该模型已部署在Pinterest,为数十亿用户提供推荐服务。此外,GNNs还被应用于预测材料的物理性质和检测动态系统中的滥用行为。

最后,论文总结了GNNs在处理大规模图数据、捕捉层次结构信息以及提高模型表达能力和可解释性等方面的优势,并展望了其在未来研究中的潜力。

怜星夜思:

2、如何理解论文中提到的“表达能力”和“可解释性”,以及它们在图表示学习中的重要性?

3、论文中提到的PinSAGE模型是如何应用于Pinterest的推荐系统的?它解决了哪些实际问题?

原文内容

来源:专知本文为论文介绍,建议阅读5分钟

在这篇论文中,我展示了一系列开创性的工作,利用图神经网络(GNNs)来解决图表示学习在解释性、可扩展性和表现力方面的挑战。