斯坦福博士论文研究如何在大模型时代进行高效的概率推理,提出了基于并行化、摊销推理和神经函数逼近的改进采样和推理技术。

原文标题:【斯坦福博士论文】大模型时代的概率推理

原文作者:数据派THU

冷月清谈:

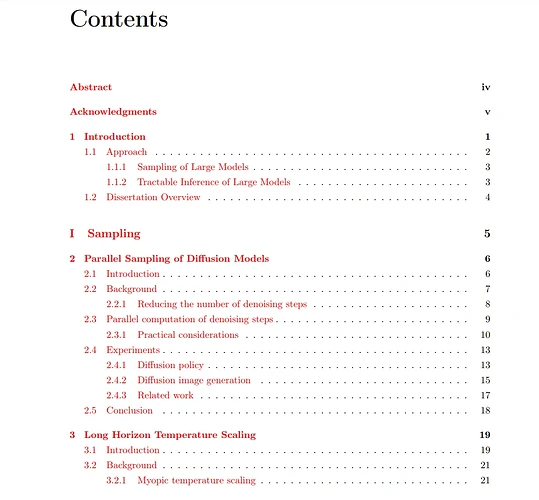

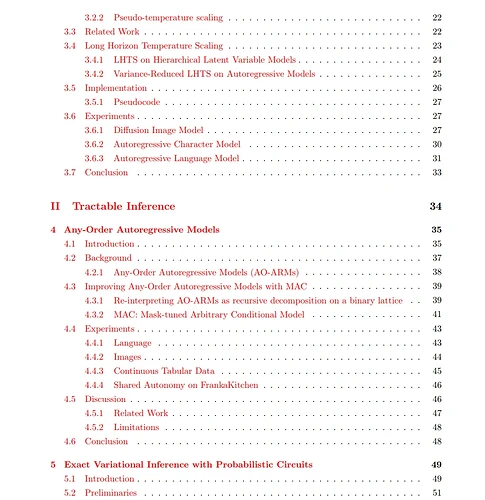

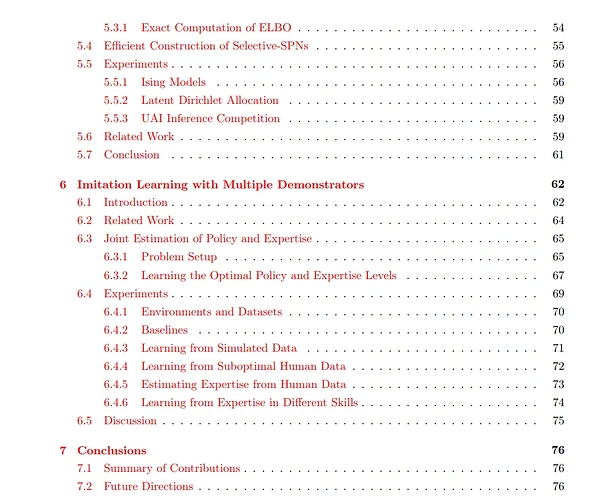

在采样方面,论文提出了改进的技术,以提升样本速度、样本查询的灵活性以及推理目标的准确性。这些技术适用于各种架构的大型模型,包括扩散模型、自回归模型和掩蔽自编码器模型。

在推理方面,论文关注如何有效估计生成模型的不同量,例如期望值和条件似然。论文提出了改进的架构和算法,以提高任意顺序自回归模型(AO-ARMs)和各种图形模型上的推理效果。

论文的研究成果在图像和文本生成、游戏玩耍和机器人等领域得到了应用验证,展现了在大规模生成模型高效部署方面的实际改进和新视角。

怜星夜思:

2、神经函数逼近在概率推理中扮演什么角色?有哪些具体的应用案例?

3、除了论文中提到的方法,还有哪些技术可以提高大模型概率推理的效率?

原文内容

来源:专知本文约1700字,建议阅读5分钟在这篇论文中,我们通过设计与模型规模兼容的算法成分来应对这一挑战,如并行化、摊销推理和神经函数逼近。