研究提高机器学习鲁棒性与可解释性的算法进展,强调在高风险应用中的重要性。

原文标题:【MIT博士论文】高效的鲁棒性和可解释性在学习和数据驱动决策中的应用

原文作者:数据派THU

冷月清谈:

本文探讨了提高机器学习算法可靠性的两大关键维度:鲁棒性和可解释性。首先,论文讨论了鲁棒性的重要性,研究了在不同数据不确定性影响下的学习鲁棒性,包括统计误差、数据噪声与损坏等。通过引入分布鲁棒优化方法,提出可以同时应对多种不确定性来源的分布模糊集,从而实现高效的鲁棒性。这种新算法在各种实际应用中展现了优于现有基准的性能。其次,论文探讨了可解释性,特别是在个性化患者治疗方案中的应用,指出医生不能依赖黑箱算法进行治疗方案决策。通过理论研究,证明了从观察到的历史样本中可以学习出动态系统的简洁表示,进而开发出增强可解释性的算法MRL。该研究为高风险环境中的决策支持工具提供了更加可靠与可理解的框架。

怜星夜思:

1、在机器学习中,鲁棒性与可解释性哪个更重要?

2、分布模糊集的应用场景还有哪些?

3、如何进一步提高机器学习算法的可解释性?

2、分布模糊集的应用场景还有哪些?

3、如何进一步提高机器学习算法的可解释性?

原文内容

来源:专知本文约1000字,建议阅读5分钟

本论文介绍了在机器学习中提高可靠性的算法进展,重点强调两个关键维度:鲁棒性和可解释性。

随着机器学习算法在高风险应用中不断开发和部署,确保其可靠性已变得至关重要。本论文介绍了在机器学习中提高可靠性的算法进展,重点强调两个关键维度:鲁棒性和可解释性。

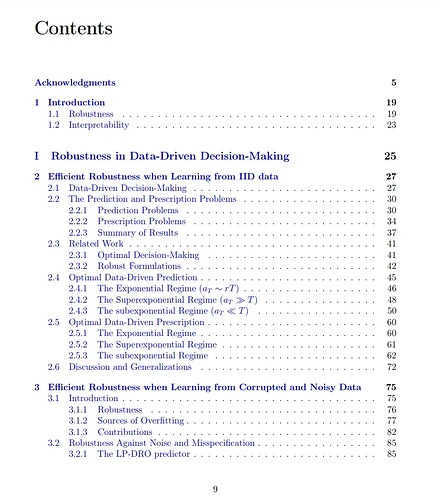

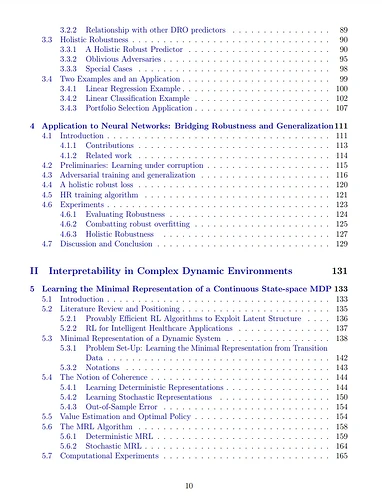

本论文的第一部分侧重于鲁棒性,即保证算法在各种数据不确定性下仍能提供稳定和可预测的性能。我们研究了在不同数据不确定性来源下的学习鲁棒性,包括基本的统计误差以及数据噪声和损坏。我们的研究揭示了这些不同来源如何相互作用并对数据驱动决策产生影响。我们引入了针对特定不确定性来源量身定制的新颖的分布鲁棒优化方法。我们的研究结果表明,对一种来源的保护可能会增加对另一种来源的脆弱性。为了解决这个问题,我们开发了分布模糊集,能够同时提供对所有来源的整体鲁棒性。在每种情况下,我们证明了我们的新方法实现了“高效”的鲁棒性,在平均性能与样本外保证之间实现了最佳平衡。我们的新算法被应用于各种场景,包括训练鲁棒神经网络,在这些场景中显著优于现有基准。

本论文的第二部分探讨了可解释性,这是高风险环境下决策支持工具的一个关键属性,要求算法能够为其决策提供可理解的解释。我们的工作在这一部分的动机来自于数据驱动的个性化患者治疗——一种越来越受欢迎的机器学习应用。在这个强化学习问题中,可解释性至关重要:医生不能依赖于一个黑箱算法来开具治疗方案。我们在理论上引入了学习连续状态空间动态系统最简洁离散表示的问题。在患者治疗的背景下,这相当于基于患者治疗过程中不断变化的特征来确定治疗组。令人惊讶的是,我们在理论上证明,仅从观察到的历史样本路径数据中就有可能学习到动态系统的最简洁表示。随后,我们开发了一种算法,MRL,能够学习这种简洁的表示,从而增强可解释性和可操作性。