论文探讨机器学习模型的局部解释方法,以提高透明度与用户理解。

原文标题:【博士论文】机器学习模型的可解释性:从数据适应性到用户感知

原文作者:数据派THU

冷月清谈:

本论文探讨了为已部署机器学习模型生成局部解释的策略,关注如何在不同条件下提供有意义的解释。研究的第一部分增强了一种基于规则的解释方法,并引入评估线性解释适用性的创新方法,侧重比较反事实解释方法的优势。第二部分则针对用户进行实验,评估不同解释方法对用户理解和信任的影响。这项研究致力于优化模型的解释生成,期望提高AI系统的透明度、可信度和可用性。随着机器学习技术的发展,其“黑盒”特性边演变为复杂性,理解模型的推理和决策过程显得尤为重要,特别是在医疗、自然灾害预测等关键领域。

怜星夜思:

1、机器学习模型的可解释性为何如此重要?

2、如何判断一个机器学习模型的可靠性?

3、提升机器学习模型可理解性的方法有哪些?

2、如何判断一个机器学习模型的可靠性?

3、提升机器学习模型可理解性的方法有哪些?

原文内容

来源:专知本文为论文介绍,建议阅读5分钟这篇论文探讨了为已部署的机器学习模型生成局部解释的方法。

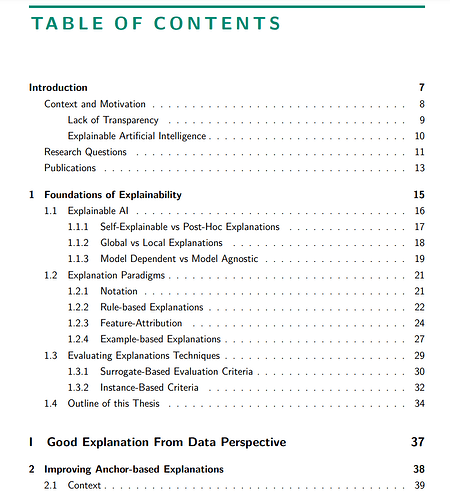

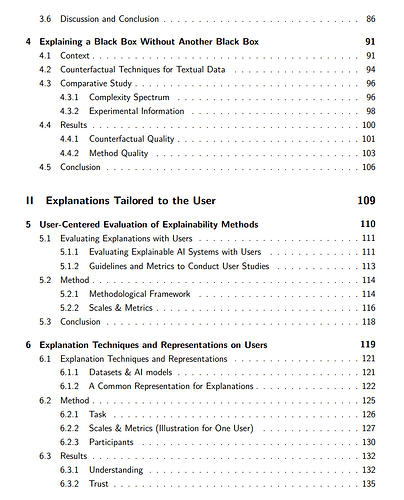

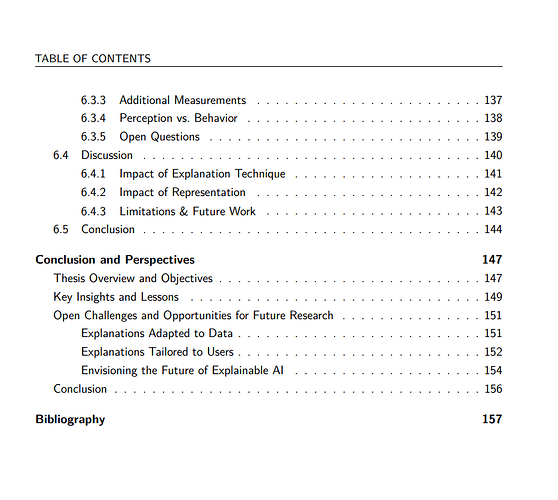

这篇论文探讨了为已部署的机器学习模型生成局部解释的方法,旨在确定生成有意义解释的最优条件,同时考虑数据和用户需求。主要目标是开发出一种为任何模型生成解释的方法,同时确保这些解释对于底层模型保持忠实并且对用户来说易于理解。论文分为两个部分。第一部分增强了一个广泛使用的基于规则的解释方法,并引入了一个评估线性解释适用于近似模型的适宜性的新方法。此外,它进行了一个比较实验,分析了两大类反事实解释方法之间的优势。第二部分专注于用户实验,评估三种解释方法和两种不同表示的影响。这些实验测量了用户在理解和信任方面如何感知他们与模型的互动,这取决于解释和表示方法。这项研究为更好的解释生成做出了贡献,可能对提高部署的AI系统的透明度、可信度和可用性产生影响。

在近几十年里,人工智能(AI)的迅速进步,特别是机器学习(ML)模型的发展,显著影响了我们的日常生活。这一显著的进步可以归因于数据可用性的指数级增长和这些模型精确度的提高。结果,AI和ML模型已经能够实现诸如提供医疗诊断、生成连贯文本、高效识别环境问题等显著成就。这些进步已经转变了众多行业,并且有潜力进一步革命化我们的社会。

然而,这一进展也导致了复杂性的增加,这使得ML模型变成了“黑盒子”。它们不透明的本质使得检查它们的推理、进行审计或从中获得洞见变得具有挑战性。那么问题来了:在我们不知道这些模型的局限性和潜在失败的情况下,我们能依赖这些模型在关键情况下作出决策吗?在预测个人娱乐偏好(如Spotify或Netflix)的场景中,模型不准确的后果可能是微小的。但在预测自然灾害或在医学、工作机会或正义等领域做出关键决策的情况下,理解模型的可靠性和推理变得至关重要。实际上,对模型的不信任或误解可能会导致错误的决策。此外,这些模型在对少数群体的偏见和对人类眼睛不可见的对抗性攻击方面展示了脆弱性。