探讨通过数据高效方法提升机器学习效果,减少对大型标注数据集的依赖。

原文标题:【斯坦福博士论文】通过数据高效方法增强机器学习

原文作者:数据派THU

冷月清谈:

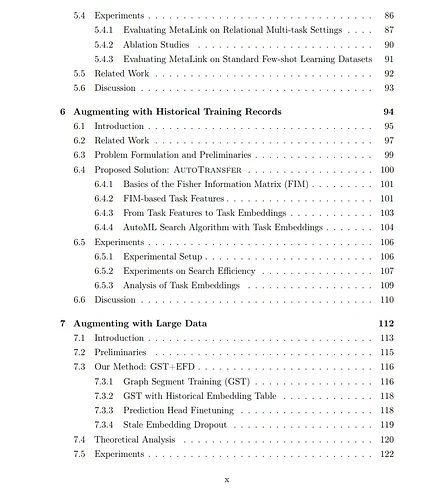

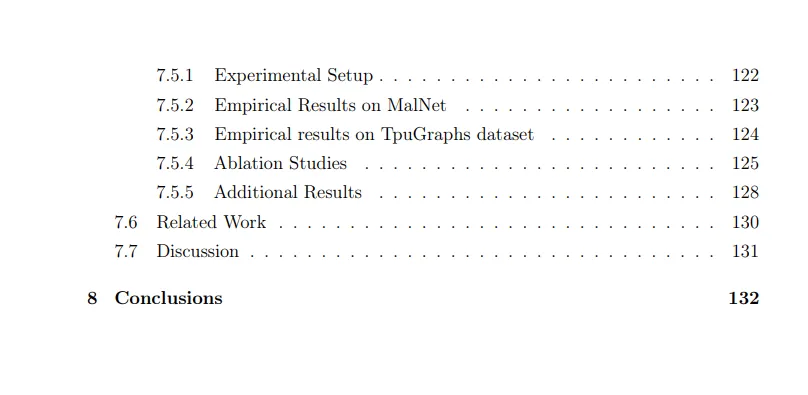

本文介绍了一项关于数据高效机器学习的创新博士论文,重点是如何在减少对大型、高质量标注数据集的依赖的前提下,保持或提升深度学习模型的有效性。文章主要分为两个部分。第一部分开发了优化的高级算法,特别是在标注数据有限的条件下,提出了一个创新的开放世界半监督学习框架,以增强模型的泛化能力和鲁棒性。第二部分则重点结合补充知识,以提升训练资源的利用效率,包括探索辅助任务的集成和历史数据的有效利用,从而改进AutoML的搜索效率。这一研究能为生物医药等领域的数据挑战提供有效的解决方案,具有重要的实际应用价值。

怜星夜思:

1、数据高效机器学习对现实应用的影响是什么?

2、你认为开放世界半监督学习框架的应用前景如何?

3、在机器学习中,辅助任务的集成可以如何影响模型性能?

2、你认为开放世界半监督学习框架的应用前景如何?

3、在机器学习中,辅助任务的集成可以如何影响模型性能?

原文内容

来源:专知本文为论文介绍,建议阅读5分钟本论文介绍了创新的机器学习策略。

监督深度学习技术在我们生活的所有领域(包括金融、医疗保健、社交网络等)都产生了巨大且前所未有的影响。然而,这种进步受到了一个重大挑战的阻碍:对大型、高质量标注数据集的依赖。这个问题在生物医药等领域尤为严重,因为在这些领域中,数据的获取和注释不仅成本高昂,而且复杂。为了应对这些挑战,本论文介绍了创新的机器学习策略,这些策略是数据高效的,旨在减少对大型标注数据集的依赖,同时保持或提高深度学习模型的有效性。

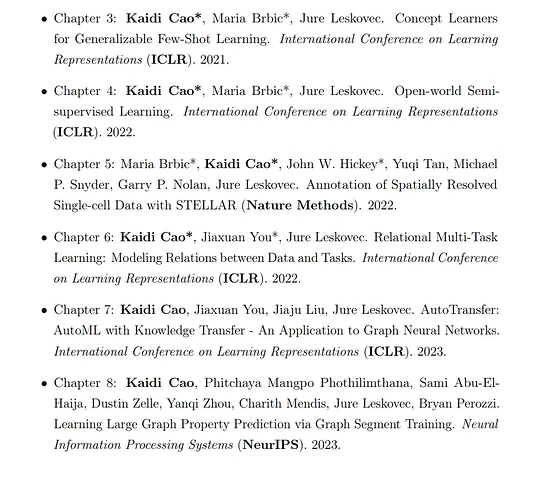

本论文系统地分为两个主要部分,每个部分都针对数据高效机器学习的关键方面。第一部分致力于为现有数据集开发优化的高级算法,特别是在标注有限的约束下。这一部分引入了一个新的机器学习设置,用于在低标注情况下增强泛化能力和鲁棒性,提出了一个创新的开放世界半监督学习框架,并将此框架适应到实际应用中。第二部分聚焦于通过结合补充知识来增强训练资源。它探索了集成辅助任务以增强训练的方法,检查了使用历史数据来提高AutoML搜索效率的方法,并引入了一种包含以前因内存限制而难以管理的大型数据集的方法。

https://searchworks.stanford.edu/view/in00000069378