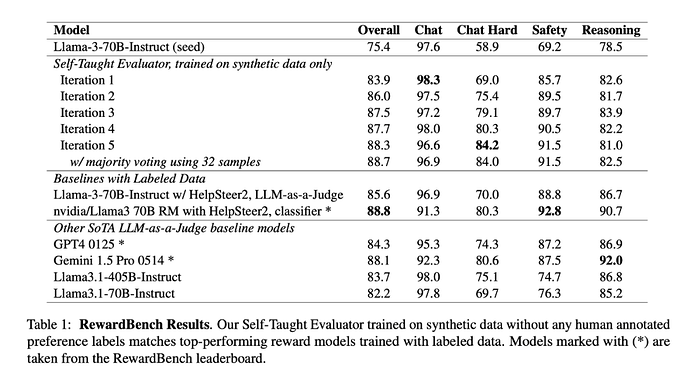

Meta 发布了一系列人工智能研究和模型,包括 SAM 2.1、Spirit LM、Layer Skip、Lingua 和 MEXMA,以推进高级机器智能的发展。其中,自学习评估器可生成合成数据,无需人工标注即可训练奖励模型,节省了大量标注成本。

原文标题:SAM 2.1上新、Lingua代码库发布,一大波Meta开源工具来袭

原文作者:机器之心

冷月清谈:

- **Spirit LM:**Meta 开发了跨模态模型 Spirit LM,将语音和文本无缝集成,生成更自然的语音表达。

- **Layer Skip:**Meta 推出 Layer Skip,一种优化大型语言模型推理速度和效率的技术,可节省能源和成本。

- **Lingua:**Meta 发布了 Lingua 代码库,简化了大规模语言模型的训练,加速研究进程。

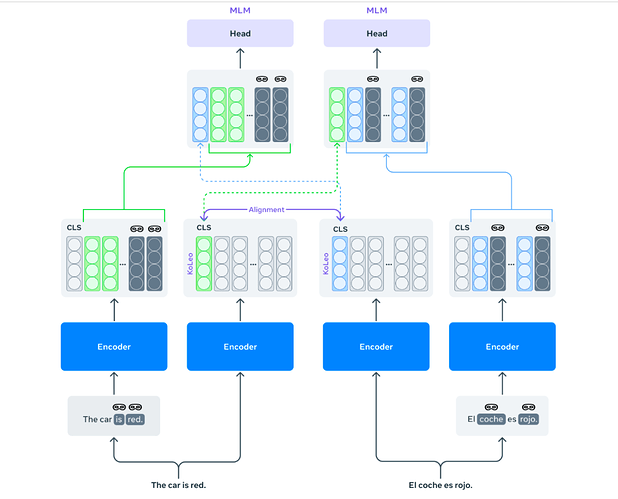

- **MEXMA:**Meta 提出跨语言句子编码器 MEXMA,在句子分类等任务中表现出色,覆盖 80 种语言。

- **自学习评估器:**Meta 开发了无需人工标注即可生成合成偏好数据的自学习评估器,用于训练奖励模型。

怜星夜思:

2、Meta 自学习评估器的潜力体现在哪些方面?

3、Lingua 和 MEXMA 这两个工具在促进自然语言处理研究方面有什么优势?

原文内容

-

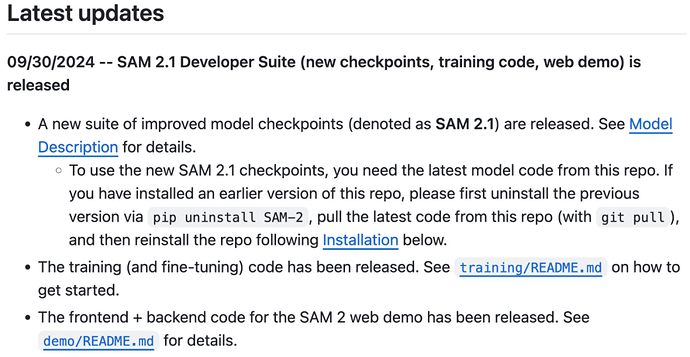

项目链接:https://github.com/facebookresearch/sam2

-

论文链接:https://arxiv.org/abs/2402.05755

-

代码链接:https://github.com/facebookresearch/spiritlm

-

模型权重:https://ai.meta.com/resources/models-and-libraries/spirit-lm-downloads/

-

论文链接:https://arxiv.org/abs/2404.16710

-

代码链接:https://github.com/facebookresearch/LayerSkip

-

权重链接:https://huggingface.co/collections/facebook/layerskip-666b25c50c8ae90e1965727a

-

项目链接:https://github.com/facebookresearch/lingua

-

论文链接:https://arxiv.org/abs/2409.12737

-

模型链接:https://huggingface.co/facebook/MEXMA

-

代码链接:https://github.com/facebookresearch/mexma

-

论文链接:https://arxiv.org/abs/2408.02666

-

代码链接:https://github.com/facebookresearch/RAM/tree/main/projects/self_taught_evaluator

-

访问合成数据:https://huggingface.co/datasets/facebook/Self-taught-evaluator-DPO-data

-

模型链接:https://huggingface.co/facebook/Self-taught-evaluator-llama3.1-70B