原文标题:新PyTorch API:几行代码轻松搞定多种注意力变体

原文作者:机器学习算法与Python学习

冷月清谈:

FlexAttention 是 PyTorch 的一个新 API,可以让用户使用几行惯用的 PyTorch 代码轻松实现多种注意力变体。

FlexAttention 特性

- 灵活:允许用户自定义注意力函数。

- 高效:通过将自定义函数编译成融合内核,实现高效的执行。

- 支持稀疏性:利用注意力掩码中的稀疏性,显著改善标准注意力实现。

解决的问题

现有注意力机制实现面临效率和灵活性的问题。融合的注意力机制提高了性能,但限制了灵活性;而支持各种注意力变体的实现又缺乏效率。FlexAttention 通过允许用户使用自定义函数灵活地修改注意力分数,解决了这一难题。

应用示例

FlexAttention 已经成功应用于实现各种注意力变体,例如:

- 相对位置编码

- Soft-capping

- 因果注意力

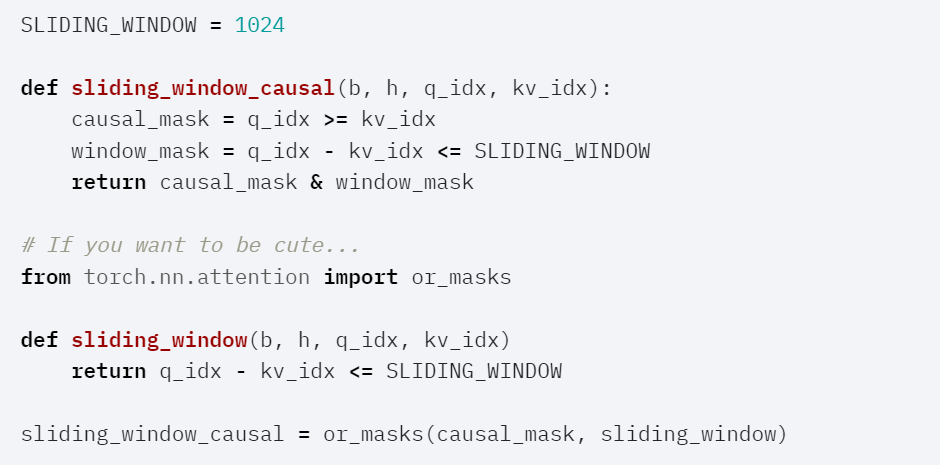

- 滑动窗口注意力

性能表现

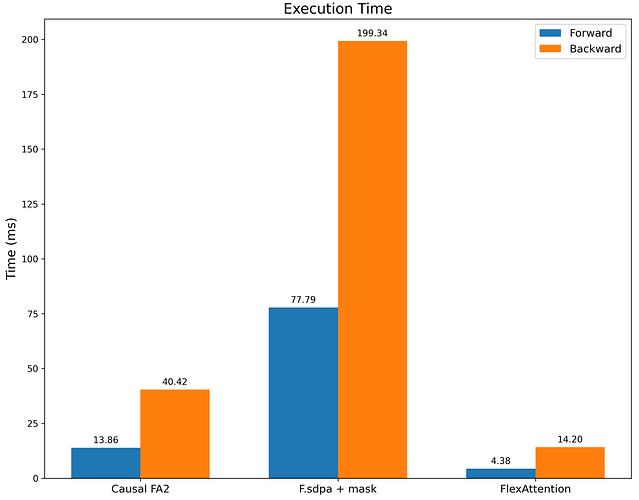

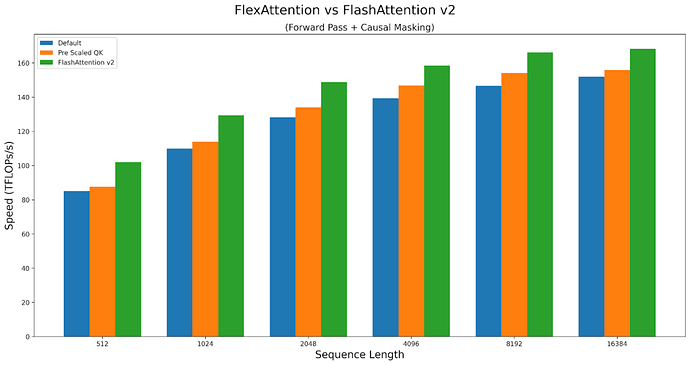

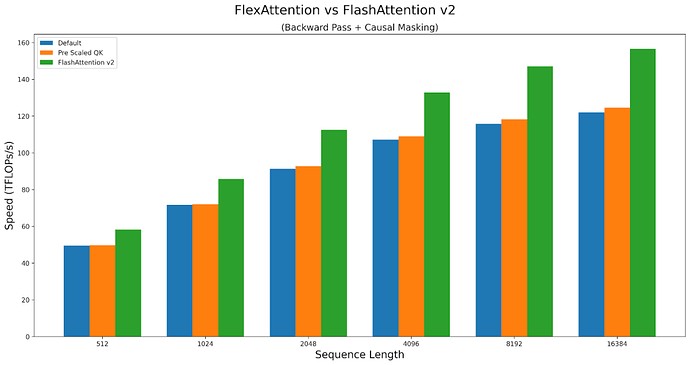

FlexAttention 的性能接近手写的 Triton 内核,在支持多种注意力变体的同时,仅牺牲了少量性能。

怜星夜思:

2、FlexAttention 与现有的注意力机制实现有什么不同?

3、FlexAttention 的潜在应用有哪些?

原文内容

用 FlexAttention 尝试一种新的注意力模式。

理论上,注意力机制就是你所需要的一切。然而在实际操作中,我们还需要优化像 FlashAttention 这样的注意力机制的实现。

-

FlexAttention 是一个灵活的 API,允许用户使用几行惯用的 PyTorch 代码就能实现多个注意力变体。

-

团队人员通过 torch.compile 将其降低到一个融合的 FlashAttention 内核中 ,生成了一个不会占用额外内存且性能可与手写内核相媲美的 FlashAttention 内核。

-

利用 PyTorch 的自动求导机制自动生成反向传播。

-

最后,PyTorch 团队还可以利用注意力掩码中的稀疏性,从而显著改善标准注意力实现。

for b in range (batch_size):

for h in range (num_heads):

for q_idx in range (sequence_length):

for kv_idx in range (sequence_length):

modified_scores [b, h, q_idx, kv_idx]

= score_mod (scores [b, h, q_idx, kv_idx], b, h, q_idx, kv_idx)

整理不易,点赞三连↓