原文标题:彻底摒弃人工标注,AutoAlign方法基于大模型让知识图谱对齐全自动化

原文作者:机器之心

冷月清谈:

AutoAlign是一种革命性的全自动知识图谱对齐方法,彻底摒弃了人工标注的需要。它基于大模型技术,以实体、谓词和属性的语义和结构理解为基础进行对齐。

AutoAlign的主要创新之处在于提出了三个相互联系的嵌入模块:

- **谓词嵌入模块:**使用谓词邻近图和类型对齐技术,将不同知识图谱中相似的谓词映射到相似的嵌入空间。

- **属性嵌入模块:**通过编码属性值的字符序列,建立实体和属性值之间的关系,实现隐含对齐。

- **结构嵌入模块:**改进TransE方法,以不同权重赋予不同邻居,有效学习实体嵌入。

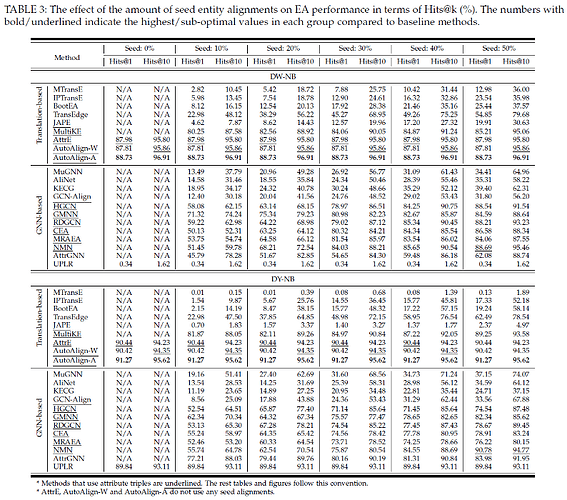

这些模块交替训练,利用已对齐信息优化嵌入,最终实现知识图谱之间的全面对齐。在基准数据集DWY-NB上的实验表明,AutoAlign在知识图谱对齐性能方面有显著提升,特别是在缺少人工标注种子的情况下。

优点

- 完全自动化,无需人工标注

- 基于大模型,语义理解能力强

- 通过嵌入模块学习实体、谓词和属性的相似性

- 在不同知识图谱和对齐任务上表现优异

应用场景

- 知识图谱融合

- 信息检索

- 推荐系统

- 自然语言处理

怜星夜思:

2、除了文本特征之外,AutoAlign是否还可以利用其他类型的特征进行对齐?

3、AutoAlign如何应对知识图谱的演化和变化?

原文内容

AIxiv专栏是机器之心发布学术、技术内容的栏目。过去数年,机器之心AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

-

论文:AutoAlign: Fully Automatic and Effective Knowledge Graph Alignment enabled by Large Language Models,36 (6) TKDE 2024

-

论文链接:https://arxiv.org/abs/2307.11772

-

代码链接:https://github.com/ruizhang-ai/AutoAlign

-

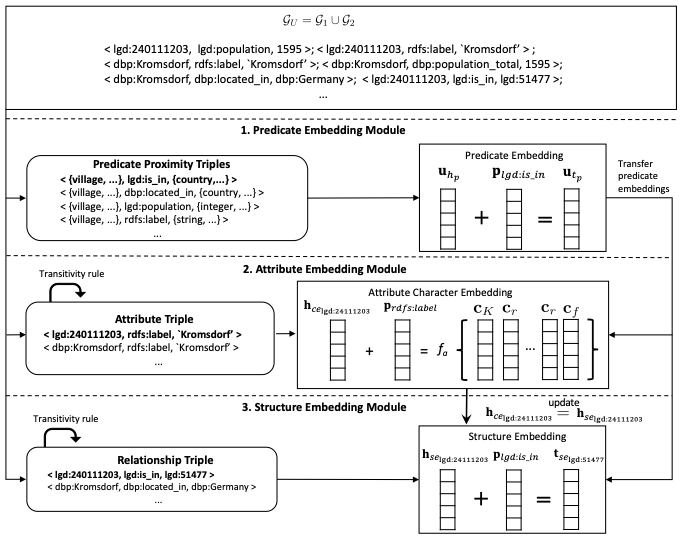

用于将谓词(predicate)对齐的谓词嵌入模块(Predicate Embedding Module)。

-

用于将实体(entity)对齐的实体嵌入学习部分,包括两个模块:属性嵌入模块 (Attribute Embedding Module)和结构嵌入模块(Structure Embedding Module)。

-

实体类型提取:研究团队通过获取每个实体在知识图谱中的rdfs:type谓词的值来提取实体类型。通常,每个实体有多个类型。例如,德国(Germany)实体在知识图谱中可能有多个类型,如“thing”、“place”、“location”和“country”。在谓词邻近图中,他们用一组实体类型替换每个三元组的头实体和尾实体。

-

类型对齐:由于不同知识图谱中的实体类型可能使用不同的表面形式(例如,“person”和“people”),研究团队需要对齐这些类型。为此,研究团队利用最新的大语言模型(如ChatGPT和Claude)来自动对齐这些类型。例如,研究团队可以使用Claude2来识别两个知识图谱中相似的类型对,然后将所有相似类型对齐为统一的表示形式。为此,研究团队设计了一套自动化提示词(prompt),能够根据不同的知识图谱进行自动化对齐词的获取。

-

属性嵌入学习:属性嵌入模块通过编码属性值的字符序列来建立头实体和属性值之间的关系。研究团队提出了三种组合函数来编码属性值:求和组合函数、基于LSTM的组合函数和基于N-gram的组合函数。通过这些函数,我们能够捕捉属性值之间的相似性,从而使得两个知识图谱中的实体属性可以对齐。

-

结构嵌入学习:结构嵌入模块基于TransE方法进行了改进,通过赋予不同邻居不同的权重来学习实体的嵌入。已对齐的谓词和隐含对齐的谓词将获得更高的权重,而未对齐的谓词则被视为噪声。通过这种方式,结构嵌入模块能够更有效地从已对齐的三元组中学习。

-

联合训练:谓词嵌入模块、属性嵌入模块和结构嵌入模块这三个模块可以进行交替训练,通过交替学习的方式互相影响,通过优化嵌入使其在各个结构的表示中达到整体最优。训练完成后,研究团队获得了实体(entity)、谓词(predicate)、属性(attribute)和类型(type)的嵌入表示。最后,我们通过对比两个知识图谱中的实体相似性(如cosine similarity),找到相似性高的实体对(需要高于一个阈值)来进行实体对齐。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:content@jiqizhixin.com