Claude Code因.map文件暴露大量源码,也意外公开了商用AI Agent的核心工程设计。

原文标题:Claude Code 源码泄露,51 万行代码,1900 个文件完整公开!

原文作者:图灵编辑部

冷月清谈:

事件的关键不只在“源码是否泄露”,还在于它暴露了商用 AI 编程工具的真实工程形态:并非简单套壳大模型 API,而是由权限控制、工具调用、任务拆分、记忆维护、协议集成等复杂系统组成。文章提炼出四类值得开发者重点关注的实践:提示词工程的规则化约束、多智能体调度架构、三层上下文压缩策略,以及后台自动记忆整合机制。

从安全角度看,这也是一次典型的供应链与发布流程失误案例,说明调试文件进入生产环境可能带来高风险后果。与此同时,也有开发者指出,这次更像是“提升可读性的还原”,因为客户端编译后逻辑原本就可在安装包中查看,真正不可复制的核心仍是 Claude 模型能力本身。整起事件既是安全警示,也给行业提供了一份罕见的AI Agent工程参考样本。

怜星夜思:

2、文章把这次事件说成一次很有价值的“工程教材”,但从伦理和法律上看,开发者该不该去研究这类意外公开的代码?边界在哪里?

3、从这次.map文件误打包来看,很多团队嘴上重视安全,流程里却总会漏一环。你觉得AI产品团队最容易忽视的发布安全问题是什么?

4、文章提到多Agent协作、上下文压缩、长期记忆管理这些设计。你觉得对普通开发者来说,哪一块最值得先学,为什么?

原文内容

AI 圈突发重磅:Claude Code 完整源码遭泄露。并非代码片段,也不是局部外泄。 总计 51 万行代码、1900 个文件,整套 TypeScript 源码被完整公开。

(这波其实信息量非常大,我们也临时加了一场直播,图灵社区明晚 20:00 李博杰老师现场拆解 Claude Code 源码,给你一次讲透。从围观到入局,这波机会普通开发者要怎么抓住,欢迎大家来直播间听听!)

事件起因

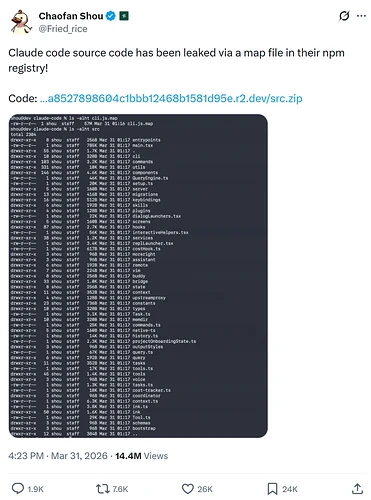

2026 年 3 月 31 日,安全研究者 Chaofan Shou 在 X 平台发文爆料:”Claude Code 源码通过 npm 仓库内的一个映射文件遭到泄露!“

泄密源头仅有一个.map文件。

源码映射文件是开发调试专用工具,作用是将编译后代码还原为原始源码,本应仅留存于开发环境。

Anthropic 团队不慎将该文件打包进了正式上线的 npm 生产安装包中。

该映射文件内嵌了 R2 对象存储桶访问链接,直接点击即可下载未经混淆、带完整注释的全套 TypeScript 源码。

泄露内容详情

本次外泄的是一套已投入商用的 AI 编程工具完整生产级源码。

项目规模

-

文件总数:1900 个

-

代码总行数:超 51 万行

-

技术栈:纯 TypeScript 开发、Bun 运行时、React+Ink 终端界面

核心源码文件

-

QueryEngine.ts(4.6万行):大模型 API 核心引擎,包含流式响应、工具调用循环、Token 用量统计全逻辑

-

Tool.ts(2.9万行):全部智能代理工具类型与权限校验规则定义

-

commands.ts(2.5万行):斜杠命令注册与执行调度核心

外泄功能清单

-

内置约 40 类智能代理工具: Bash 工具、文件读写工具、文件编辑工具、代理调度工具、网页抓取工具、全网搜索工具、MCP 协议工具、LSP 语言服务协议工具等

-

内置约 85 条斜杠指令:提交代码、代码评审、上下文精简、MCP 连接、记忆管理、技能配置、任务调度、Vim 编辑模式、差异比对、费用核算等

-

内部功能开关:主动智能模式、语音交互模式、桥接联动模式、KAIROS 调度内核

隐藏彩蛋功能

源码中暗藏 BUDDY 数字宠物系统,设计对标 OpenClaw 产品,包含稀有度分级、闪光变异形态、程序化随机属性生成等机制。 该功能隐藏于buddy/目录下,通过编译期配置开关锁定未开放状态。 预计上线 2026 年 4 月 1 日 - 7 日开启预热试玩,5 月正式全量发布。

Anthropic 官方应对

事故曝光后,Anthropic 紧急处置:第一时间推送 npm 版本更新,移除泄密的源码映射文件,并清除仓库内所有历史旧版本安装包。

但补救为时已晚。目前 GitHub 已出现至少 3 个完整镜像仓库: instructkr/claude-code、Kuberwastaken/claude-code、nirholas/claude-code 网络数据一旦公开,便可永久留存。

并非首次安全事故

这是 Anthropic 最近第二起泄密事件了。 就在 3 月 26 日,后台 CMS 配置失误曾导致:

-

未发布新品「Claude Mythos」模型核心参数泄露

-

多篇未官宣技术博客草稿外泄

-

3000 余项未公开素材全部暴露

短短数日,再添 51 万行完整源码外泄事故。

行业、社群反响

Reddit、Hacker News 都炸了,而且意见 surprisingly 一致:”这也太讽刺了。“

Anthropic 长期主打 Claude 代码编写与代码审计的强悍能力,结果自家代码却因为一个基础失误被曝光。该观点客观属实, Anthropic 从未将客户端交互逻辑列为机密,品牌真正的核心壁垒是 Claude 大模型本体,而非命令行工具。 开发者通过系统命令,即可直接查看本地安装包内全部编译后逻辑代码。

严格来说,这并非传统意义上的源码泄密,只是有人将压缩混淆代码还原为了易读格式。 但能查看代码与能读懂架构内核,完全是两个概念。

源码背后的核心技术干货

开发者 Jingle Bell 花了一整天研究代码,总结了一句:”如今全网所有人都在用 Claude 分析 Claude 源码,这简直直接撑起了它们今日的营收流水。“

业内已总结出四大可直接复用的核心工程设计:

1. 系统化提示词工程设计

传统错误写法:简单描述「协助用户,提供详细解答」 Anthropic 标准化工程写法:

-

工具强制约束:文件操作必须调用专属读取工具,禁止直接执行终端命令

-

风险权限管控:数据删除操作必须二次确认校验

-

输出格式规范:结论前置,补充细节在后 整套设计让 AI 行为高度可控、可预测,完全适配生产环境落地标准。

2. 多智能体协同调度架构

完整企业级多代理协作体系:

-

主控调度模式:主代理拆分任务分发至多个工作代理,并行执行后统一汇总结果

-

权限邮箱队列:高危操作需通过消息队列向主控申请权限审批

-

原子执行锁机制:防止多代理重复抢占同一权限任务

-

全局共享记忆池:所有代理共用统一记忆空间

完美平衡智能代理自主性与人工管控权限,是行业标杆级实践方案。

3. 三层上下文压缩策略

Claude Code 最亮眼的核心工程设计:

-

轻度精简:无 API 调用,本地缓存内容清理,自动删除冗余工具日志

-

自动精简:临近上下文上限触发,预留 13000 Token 安全缓冲,最高生成 20000 Token 总结文本;内置熔断机制,连续 3 次失败自动终止重试,规避死循环问题

-

全量精简:整段会话压缩汇总,重新注入近期高频文件(单文件上限 5000 Token)、执行计划与技能配置;压缩后预留 50000 Token 可用额度

所有长会话 AI 应用均可直接复用这套三层压缩方案。

4. 后台自动记忆整合机制

工具后台静默自动梳理长期记忆,触发需同时满足四项条件:

-

距上次记忆整合已满 24 小时

-

新增会话数量不少于 5 组

-

无其他整合进程正在运行

-

距上次扫描检测已满 10 分钟

四阶段整合流程:定位梳理→日志筛查→合并纠错→精简归档 严格控制记忆主文件不超过 200 行、25KB 大小。

所有需要长期记忆管理的 AI 产品,均可照搬这套轻量化运维逻辑——记忆重在定期梳理,而非无限堆积。

对开发者而言,这次泄密等同于免费顶级实战教程。Anthropic 多年打磨沉淀的工程规范与架构设计,如今完全公开透明。

事件深层影响

对开发者

经典供应链安全反面教材,源码映射仅用于开发调试,一旦误打包至生产环境,全套源码彻底公开。业内曾多次出现生产映射文件泄露后台密钥、支付接口凭证的安全事故。一处配置疏忽,即可让企业核心代码彻底暴露。

对 AI 工具行业

本次泄露公开了商用级 AI 编程工具真实落地架构:绝非简单 API 封装,包含多代理调度、权限管控、工具循环调用、IDE 联动、语音接入、Vim 适配、MCP/LSP 全协议集成等完整工程体系,全部为可直接运行的生产代码,远超宣传 PPT 与营销文案参考价值。

对 Anthropic 企业自身

知识产权重大损失:客户端接口逻辑、OAuth 鉴权流程、权限风控体系、多代理内核、未上线产品迭代路线全部曝光。竞品可直接复刻架构设计、优化策略与产品规划。

但核心壁垒并未失守:正如开发者所言,CLI 工具架构可复制、工程规范可学习,唯独 Claude 大模型的推理核心能力无法复刻,这才是企业真正的护城河。

结语

深夜通读完 51 万行代码目录,点开隐藏的宠物系统文件夹时,感触颇深。

即便是行业顶尖 AI 巨头,团队依旧是由普通人组成,会犯错误,会在代码里暗藏趣味彩蛋,会在愚人节前夕悄悄筹备隐藏新功能。

这次泄密固然是严重安全事故,却也揭开了 AI 行业的真实面貌,高端工具背后,是工程师一行行手写代码、一次次调试排错、无数个深夜迭代重构的成果。没有玄学,没有黑箱,只有 1900 个文件与数十万行务实代码。

这或许就是 AI 时代的本质,技术再先进,根基永远是代码;模型再强大,终究需要人来驾驭;而人类,永远难免犯错。

原文链接:https://dev.to/evan-dong/claude-codes-entire-source-code-just-leaked-512000-lines-exposed-3139

大模型好课持续热卖中

但这件事最值得关注的,其实并不是源码泄露本身。而是一个更现实的问题:”同样是 51 万行代码,为什么有人能从中提炼出架构精华,有人却只能当热闹看?“

能看到代码,不等于能理解系统;能跑通项目,不等于能设计架构;能调用 API,更不等于能构建真正的 AI Agent。

如果把 Claude Code 拆开来看,本质上就是 4 个核心能力:

-

可控的提示词工程设计

-

多 Agent 协同调度能力

-

长上下文压缩与成本控制

-

长期记忆管理机制

这四点,基本就是今天所有 AI Agent 产品的底层通用解法。换句话说,你现在学的不是某个工具,而是一整套下一代软件工程范式。

这也是我们为什么一直在做 Agent 课程的原因。不是教你怎么用某个模型,而是教你如何把大模型,真正变成一个可控、可扩展、可落地的系统。

9 周实战,实现从 0 到 1 打造智能 Agent,从基础原理到工具调用,从协作系统到项目落地,明星导师李博杰亲自授课,每次上课,弹幕都在刷这也讲得太好了吧。干货密度高得离谱。

随买随学,所有直播都有回放。笔记、资料、拓展学习路线全打包给你。保姆级教程,你只要跟着做就能快速起飞。

实战营用户交流学习氛围超好,遇到热点问题,不管是近期爆火的 OpenClaw,还是讨论度很高的 Harness 工程,大家都第一时间一起讨论分析。

共学营学员自主提问,相互解答,博杰老师答疑的同时还会给大家分享好用的 AI 工具,大家学习互助,共同进步。一直跟着学习的同学,也收获了自己了成果。