研究表明,缓解捷径学习是提升视觉和视觉-语言模型分布外泛化能力的关键。通过数据干预和模型设计,模型能学习更稳健的特征。

原文标题:【NTU博士论文】缓解捷径学习并提升视觉及视觉-语言模型的分布外泛化能力

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、文中提到了多种缓解捷径学习的方法,比如StillMix、FLASH和SPARCL。你认为这些方法的核心思想是什么?它们各自适用于哪些场景?

3、本文主要关注的是视觉和视觉-语言模型,那么你认为捷径学习在其他领域(比如推荐系统、金融风控等)中是否也存在?如果有,会以什么形式表现出来?

原文内容

来源:专知本文约1000字,建议阅读5分钟缓解捷径学习对于提升 OOD 泛化至关重要。

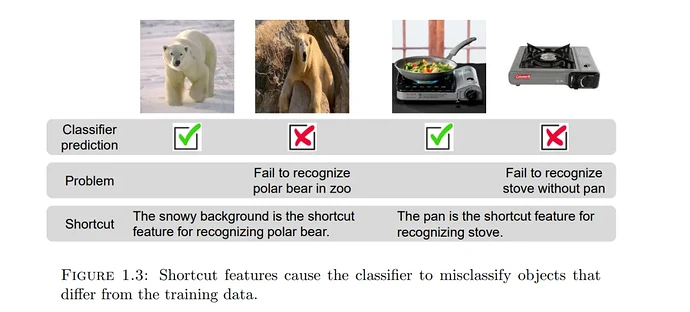

视觉模型与视觉-语言模型在训练数据与测试数据遵循相同分布的独立同分布(IID)基准测试中已取得显著成果。然而,当面对分布外(OOD)数据(即分布与训练数据存在差异的数据)时,其性能通常会出现大幅退化。导致泛化能力缺失的关键原因在于捷径学习(Shortcut Learning)——即模型倾向于依赖虚假相关性或表面特征进行预测。这些特征在训练集中具有预测性,但并未反映结果背后的底层因果逻辑。捷径学习主要源于两个因素:(1) 训练数据频繁包含在其他分布中并不成立的虚假相关性;(2) 梯度优化算法倾向于损失景观中的平坦极小值(Flat Minima),而这些相关性往往对应于此类易于学习的极小值。因此,模型通常会优先学习非因果模式,而非稳健且可泛化的特征。

因此,缓解捷径学习对于提升 OOD 泛化至关重要。这一挑战可以从两个互补的视角予以解决。在数据层面,通过数据增强和合成数据生成等干预技术,可以打破虚假相关性并凸显不变特征(Invariant Features)。在模型层面,通过架构设计扩大与因果特征相关的极小值范围,同时抑制与捷径特征关联的极小值,能够促使模型学习到更具泛化性的特征。上述方法协同作用,共同促进了稳健表示的构建并提升了 OOD 泛化表现。本论文将捷径学习视为视觉及视觉-语言模型在分布外泛化中所面临的基础性挑战,并在视频识别、视频生成以及视觉-语言理解等一系列任务中对其进行了深入研究。这些任务涵盖了从单模态判别到像素级生成,再到跨模态推理的演进过程,从而能够在表征与建模需求不断增加的情况下,对捷径缓解策略进行系统的评估。

在视频动作识别任务中,我们引入了旨在缓解静态视觉线索所导致的捷径学习的数据增强技术。我们提出了 StillMix,该方法在保持视频动作标签不变的前提下,将诱导偏差的静态帧混入训练视频中。这种增强手段破坏了静态特征与动作标签之间的虚假相关性,从而增强了模型对 OOD 视觉表现的泛化能力。

在小样本人体动作生成任务中,我们提出了一种结合数据增强与模型设计的策略,以缓解由外观线索驱动的捷径学习。我们引入了 FLASH,通过构建具有相同动作但外观不同的视频对,并在两组视频间进行特征对齐,以促进可迁移运动表示的学习。该方法降低了低数据量场景下的外观过拟合,增强了运动泛化性。

在视觉-语言组合理解任务中,我们开发了合成数据生成技术,以减少模型对粗粒度视觉-文本对齐的依赖。我们提出了 SPARCL,通过生成具有细微变化的模态数据并训练模型识别这些差异,提升了模型捕捉超越表层相关性的组合语义的能力。

综上所述,这些研究贡献表明,通过数据干预与模型设计来缓解捷径学习,是提升视觉及视觉-语言任务 OOD 泛化能力的关键。