介绍了工程知识引擎,通过多维数据融合和知识正循环机制,提升AI编程智能体的代码理解能力和工程协作能力。

原文标题:工程知识引擎:Harness Engineering体系下的工程知识底座

原文作者:阿里云开发者

冷月清谈:

怜星夜思:

2、文章提到了RepoWiki对于沉淀项目特有的设计语言与架构约束的重要性。但实际情况是,很多团队的Wiki文档更新不及时,与代码脱节严重。有什么好的方式能够保证RepoWiki与代码库的同步演进,避免成为摆设?

3、文章中Agentic Search通过多跳检索策略来获取更全面的上下文信息,避免了传统检索工具返回大量无关信息的问题。那么,在实际应用中,如何评估Agentic Search的效果,并不断优化其检索策略,以适应不断变化的项目需求?

原文内容

在AI编程智能体快速演进的今天,一个核心痛点愈发凸显:AI能写代码,却难以理解代码。更深层的问题是:即便模型能力再强,若缺乏结构化的工程约束与上下文支撑,智能体也难以稳定、可预期地完成真实工程任务。

当前主流AI编程智能体在项目级语义理解方面存在明显短板:

-

感知范围狭窄:仅围绕当前查询进行局部检索,缺乏对项目整体结构的上下文感知;

-

知识碎片化:返回的代码片段彼此孤立,难以还原其在系统中的真实语义角色;

-

高维上下文缺失:传统工具仅能获取低维代码细节数据,难以捕捉设计意图、历史决策等隐性知识;

这些局限导致AI智能体只能逐点的检索上下文,缺少对代码库的立体感知。当前业界逐渐形成共识:让AI智能体真正可用,需要构建Harness Engineering,包含环境设计、意图规范、反馈循环、可观测性工具、架构约束、上下文工程等,其中工程知识底座(包括代码规范、架构约束、反馈循环与知识积累机制等)在其中起到了关键作用。只有当这套底座足够扎实,智能体才能从"偶尔可用"走向"持续可靠"。

工程知识引擎:

从“点”到“立体”的工程感知

为解决这一难题,我们构建了工程知识引擎——一套多维融合的代码认知系统,通过整合代码文件、提交历史、RepoWiki、记忆等多维数据源,为AI智能体赋予深度上下文理解能力。

Qoder会自动构建工程知识引擎数据层,主动分析并构建 Commit Graph、RepoWiki、Memory、Code Chunk、Code Graph 等多元索引,将原本离散的工程信息编织成立体的知识网络。智能体可以通过多个检索工具从多维知识图谱中获取丰富的上下文支撑——不再是孤立的代码片段,而是带有设计模式、关联关系的立体信息。

更重要的是,Qoder构建了完整的知识正循环机制。一方面,任务完成后引擎会自动对对话过程进行分析与评估,从中提炼有价值的工程洞察,沉淀为持久化记忆;另一方面,当代码库发生 Git Commit 更新时,Qoder会实时捕获变更,自动分析增量代码的语义与影响,并将新知识同步沉淀到 RepoWiki 中,确保知识库与代码库始终保持同步演进。这意味着智能体使用得越多、代码迭代越频繁,知识积累越丰富,理解能力越强——从"被动检索"走向"主动学习",实现工程知识的自我进化与持续增值。这种持续演进的知识积累机制,正是工程知识底座建设的核心价值所在:每一次智能体的失误,都成为改进知识、完善规范、强化约束的信号;每一次代码迭代,都让知识库更贴近真实工程现实。智能体的能力边界,由其所运行的工程环境共同决定。

1)向量检索:基础检索能力

向量检索构成了智能体感知代码世界的底层触觉。它使自然语言查询能够直接映射至相关代码实体,摒弃了传统 grep 式工具依赖关键词匹配的盲目试探。Qoder通过高效的索引调度策略,相比业界同类产品,索引耗时平均减少5倍,95%的新开代码库仅需不到1分钟即可索引完成。

2)代码图谱:从语法到语义的升维

代码图谱通过显式建模代码间的语义关系(调用、引用、继承、实现等),提升智能体对代码库符号关系的认知。当智能体查询"如何实现用户登录验证"时,智能体不仅能获取到直接相关代码片段,还能通过图谱关系智能的联想出鉴权逻辑、Token服务等完整上下文。

3)Commit图谱:打通意图到代码的语义桥梁

智能体通过检索工具查询相关代码时,只能通过嵌入向量将自然语言与代码片段“黑盒”的映射在一起,无法覆盖的高层语义信号。而Commit Message天然具备高层次语义概括能力,架起"做什么"与"怎么做"之间的桥梁。Qoder通过模型对低质量Commit Message进行优化,构建了"Query → Commit Message(意图)→ 代码"的两阶段链路,有效弥合高层需求与底层实现之间的语义鸿沟。

4)RepoWiki:高阶知识的沉淀

代码图谱、Commit图谱、Chunk向量检索结合,起到了由点及面的效果,但是智能体过度依赖局部上下文和通用代码模式,忽视了项目特有的设计语言与架构约束,导致AI智能体生成的代码往往语法正确,却与项目风格和架构设计格格不入。RepoWiki自动生成并维护项目的架构设计、功能模块说明、开发规范等高阶知识,形成跟随代码库持续演进的知识库。

5)记忆系统:持久化的个性化记忆能力

记忆系统赋予AI智能体持久化记忆能力,帮助工程知识引擎加强对项目配置、开发规范、历史任务的设计决策及变更文件的感知。记忆系统会基于每轮的对话消息进行分析挖掘,抽象出有价值的记忆卡片,并会通过记忆系统的自动整理汰换、记忆的价值评估等实现记忆的自我演进。

6)Agentic Search:面向任务目标的自适应上下文编排引擎

如果说前述五大能力是工程知识引擎的“感官”与“记忆”,那么 Agentic Search 就是它的“认知中枢”——一个将多源异构知识动态调度、按需融合、自主推理的任务驱动型检索决策框架。

传统检索工具(如 grep_code 或单模态向量搜索)每次只会返回单一类型检索结果,主智能体需要不断的自我迭代调用多次传统工具采集信息,这种方式在复杂工程任务中极易检索出大量无关的上下文,导致上下文腐化。

Agentic Search 的重要在于将检索本身升格为可规划、可反思、可迭代的子任务。它基于当前任务目标、已有上下文置信度、各知识源的覆盖盲区与语义粒度,实时生成并执行最优的多跳检索策略。例如,面对请求:“请为订单服务新增幂等校验,兼容现有 Redis 分布式锁机制,并避免与库存扣减优化冲突”,Agentic Search 会自动编排如下推理路径:

1. 意图锚定:通过 Commit 图谱定位 inventory optimization 相关提交,提取其变更范围与设计约束;

2. 语义对齐:调用代码图谱,识别 RedisDistributedLock 类的继承链、被调用方及关键方法签名,确保新逻辑与锁生命周期兼容;

3. 规范校验:查询 RepoWiki 中《订单服务幂等设计规范》章节,获取 idempotency key 生成规则与失败重试策略;

4. 记忆增强:激活记忆系统,召回过往类似任务的经验(如基于 DB 唯一索引 vs 基于 Token UUID),主动规避。

效果评估

1)效果演示

在相同模型下,工程知识引擎的引入显著优化了任务检索阶段智能体的执行效率。相比传统方案,其工具调用轮次与频次大幅降低,直接带动全局 Token 消耗下降 21%。得益于引擎的高精度召回能力,系统表现出极强的逻辑鲁棒性,精准规避了对非相关文件(如 cache.py)的误触改动,有效消除了代码生成的副作用。

2)离线评估

在自研评测集 Qoder Agent Bench 上,启用工程知识引擎的实验组显著优于基线:

-

任务完成度得分提升 12%

-

平均 token 消耗降低 14%

-

相较业界主流方案,代码检索的 F-Score 提升 21%

-

启用Agentic Search后,相比于语义检索,主模型token消耗降低 10.4%

这表明,更丰富准确的多源上下文不仅提升了准确性,也减少了冗余推理与试错成本。Agentic Search能在保持智能体效果的情况下,大幅度减少无效上下文。

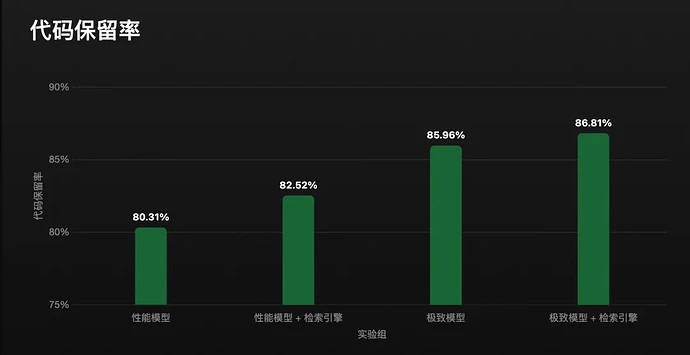

3)线上 A/B 测试

面向真实用户的 A/B 实验进一步验证了工程知识引擎的实用价值。在相同大模型下,启用该引擎的实验组相较仅使用 search_file、grep_code 等传统工具的对照组:

-

代码库检索(含向量检索、代码图谱、Commit图谱、RepoWiki):

-

代码保留率提升 1.9%,在1000个文件以上的代码库中,进一步提升2.2%

-

针对复杂任务,模型迭代轮次平均降低7.1%

-

记忆系统:

-

代码保留率提升0.66%,对话不满意率降低27%

知识引擎赋能智能体,使其生成的代码更精准、可靠且符合用户预期,从而显著提升代码保留率,并有效降低对话不满意率。

工程知识引擎的出现,标志着 AI 编程正在从"代码生成器"向"工程协作者"的角色转变。但这一转变能走多远,根本上取决于我们为智能体构建了怎样的工程环境。

实践表明,智能体的质量上限,除了模型能力外,更重要的是由其所处工程底座的完善程度决定的。文档是否准确、架构约束是否可执行、知识库是否随代码同步演进——这些"基础设施"的质量,直接决定了智能体能否持续、稳定、可预期地完成真实工程任务。

在这样的环境中,AI 不仅能看到代码的结构,还能理解背后的意图、设计决策、技术限制以及演进过程。每一次智能体的失误,都应成为完善工程底座的契机;每一次知识积累,都在缩小人机协作的认知鸿沟。这不仅是一次技术上的进步,也是我们对软件工程本身的重新审视:让工程环境足够好,智能体自然会足够好。这,可能是推动未来软件开发效率持续提升最务实的路径。