OpenClaw正快速从AI工具走向企业级应用,开发者们关注其在规模化、安全和长期稳定运行方面的挑战与实践。

原文标题:从狂热到工程、组织实践,OpenClaw这阵风能刮多久?

原文作者:AI前线

冷月清谈:

怜星夜思:

2、OpenClaw 在安全方面面临哪些具体的风险?文章提到了权限误用、敏感信息暴露、执行链失控等问题,你认为应该如何有效防范这些风险?

3、文章提到 OpenClaw 的长程记忆存在问题,这会对实际应用造成什么影响?你认为如何才能有效地提升 AI Agent 的记忆能力,使其更好地完成长期任务?

原文内容

最近一段时间,如果你混迹开发者社区,几乎很难绕开一个词:养龙虾。

它不是一个玩笑,也不只是一个热梗。围绕 OpenClaw,一场很少见的技术扩散,正在中国开发者圈迅速发生:有人在公司里部署“龙虾”做运维,有人拿它跑内容生产,有人尝试让多个 Agent 协同工作,甚至有人直接把它当作“数字员工”来管理。OpenClaw 及其衍生实践,已经从少数极客的尝鲜,变成越来越多人正在亲手验证的新工作方式。

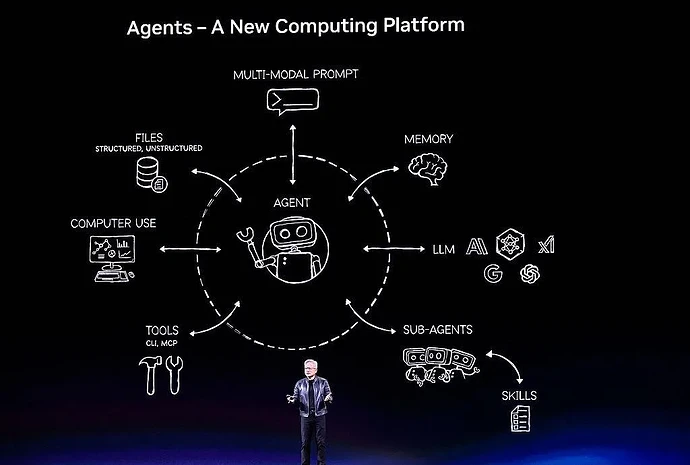

在前两天英伟达举行的 GTC2026 大会上,“皮衣教主”黄仁勋也是多次提到 OpenClaw,先是赞誉它为有史以来增长最快的开源软件,还强调 OpenClaw 不仅仅是一个工具,更代表计算范式的转变,更是将其和 Windows 操作系统相媲美,认为未来每个公司都应该有自己的 OpenClaw 战略。而这个周末,在中国,这股热潮将迎来一次更大规模的集中释放。

3 月 21 日到 22 日,OpenClaw 中国行 将在全国 12 座城市同步举行,覆盖 杭州、苏州、深圳、青岛、成都、广州、上海、南京、厦门、济南、武汉、北京(点击文末【阅读原文】链接立即报名)。整场活动横跨两天:周六 6 场,周日 6 场,几乎把国内主要技术城市一口气串了起来。活动议程显示,分享内容并不只是泛泛而谈“AI 很厉害”,而是围绕 OpenClaw 的规模化使用、企业落地、安全防护、记忆系统、多 Agent 架构、商业化探索等具体问题展开。

如果只把它理解成一场技术路演,可能低估了这件事。

从更大的背景看,这次 OpenClaw 中国行,真正值得关注的地方在于:它正在把“养龙虾”从社交媒体上的热词,推进到工程实践和组织实践的现实层面。

这轮 OpenClaw 的传播速度,明显快于很多同类项目。一个重要原因在于,它击中的并不是“看起来更聪明”的想象,而是“能不能替我干活”的现实诉求。

过去一段时间,大模型的能力已经被市场充分教育:会写、会答、会搜、会总结,这些大家早就见怪不怪了。真正卡住开发者和企业的,是另一层问题——为什么很多 AI 看起来很强,但一旦进入真实工作流,就经常掉链子? 为什么它在聊天框里像个天才,到了浏览器、终端、文件系统和企业系统里,却经常变得不稳定、不可控、不可复现?

也正因如此,OpenClaw 在最近的讨论中,逐渐被放到一个更具体的位置上:它不再只是一个“AI 工具”,而是一个试图让 Agent 真正参与执行的工程化入口。InfoQ 此前对 OpenClaw 的连续报道也在反复强调这一点:它之所以引发关注,不只是因为能“看见”和“操作”,而是因为它让开发者开始认真讨论 AI 从对话走向执行的可能边界。

换句话说,OpenClaw 真正激发的,不是“模型崇拜”,而是 执行崇拜。

这也是为什么在社区里,大家不说“我在调用一个工具”,而更喜欢说“我在养一只龙虾”。这个说法很形象:你不是在按按钮,而是在管理一个会做事、但也可能失控的半自主体。你要给它环境、给它权限、给它任务边界,还得随时准备处理它的偏航。

从议程来看,这次中国行最大的特点,是它已经明显越过了“科普 OpenClaw 是什么”的阶段,开始进入第二层讨论:怎么把龙虾从一只养成一群,从玩具养成系统,从体验养成生产力。

杭州场很典型。HiClaw/Higress 开源项目 Maintainer 张添翼的主题是《从养一只虾到开虾场:基于 HiClaw 的规模化养虾指南》。这个题目本身就很有代表性:它关注的不是“单点惊艳”,而是规模化问题。按照议程介绍,这场分享会从架构视角拆解 HiClaw 的 Manager-Worker 多 Agent 协作设计,还会结合现场 Demo,展示如何从 0 到 1 搭建一个 AI Agent 团队,并复盘安全凭证隔离、SubAgent 协作效率、资源占用等企业级痛点。

这背后的问题,其实已经非常工程化了。

当开发者开始认真讨论“Manager-Worker”“SubAgent”“资源占用”“安全凭证隔离”这些词时,说明 OpenClaw 的使用场景已经不再停留在个人试玩,而是在向真正的系统设计靠拢。它像极了早年分布式系统和微服务刚起来的时候:最先吸引大家的是“能跑起来”,真正决定能不能走远的,却是调度、边界、观测、安全和成本。

这也是为什么,苏州场和南京场同样值得看。苏州场里,既有“把 AI 从聊天框里拽出来,变成你真正的私人助理”,也有“独立完成一个可落地的智能办公数字员工项目”,主题直接覆盖文件自动化处理、Shell 命令执行、浏览器操控、多渠道交互、自定义技能开发、本地模型对接等一整套闭环。

这类内容的价值在于,它让“养龙虾”第一次有了更具象的路径:不是抽象地谈未来,而是回答一个非常实际的问题——如果我今天就想让 OpenClaw 接手一部分办公任务,到底该从哪一步开始?

如果说架构问题决定上限,那么案例决定信服力。

这次活动里,南京场有个特别有意思的议题:《完蛋!我公司被 30 只 🦞 包围了!》。在介绍中,维格创始人、兔兔养虾创始人,也是 TGO 鲲鹏会深圳的会员陈沛霖提到:最近两周,分享者让 30 个 AI Agent 在公司里持续工作,覆盖写代码、修 Bug、做运营、跑营销、做产品决策,并得出了一个极具冲击力的结论——“公司里 90% 的执行性工作已被所有 AI 替代”。

先不急着把这句话理解为终极结论,它至少说明一件事:OpenClaw 讨论的重心,已经从‘单点提效’转向‘组织替代率’了。

这是一个很关键的信号。

因为一旦讨论进入“多少工作可以交给 Agent”这个层面,开发者和企业关注的就不会再只是模型效果,而会变成更复杂的问题:人和 Agent 如何分工?什么任务适合交给龙虾?什么任务必须保留给人?监督机制如何设计?失误成本如何控制?这些问题,决定的已经不是一个工具是否好玩,而是一种新的组织协作方式能不能成立。

同样值得关注的,还有上海场、广州场和济南场。上海场讨论的是从 OpenClaw 到 FiClaw、goClaw 的演化,涉及金融量化交易产研体系、大规模 Agent 指挥系统、工程边界与资本逻辑;广州场覆盖端云融合、企业应用落地、本地部署和 OPC 商业化增长;济南场则把主题推向“专家虾”和“7×24 小时知识处理引擎”。这些议题放在一起看,会发现一个明显趋势:龙虾不再只是“会干活”,而是在开始按行业、按场景、按分工被重新塑形。

任何一个技术热潮,只要真的开始往生产走,就一定会遇到两个问题:安全 和 记忆。

这次活动的议程安排,恰恰说明 OpenClaw 社区已经开始正面应对这两个核心挑战。

安全几乎贯穿了多个城市。成都场谈“如何又高效又安全地用好你的 OpenClaw”,南京场有“一分钟给龙虾装上安全铠甲 ClawdSecbot”,上海场有“OpenClaw 安全风险全面解析与防护指南”,北京场则直接给出“踩了从安装到使用路上的 5 个大坑——OpenClaw 安全食用指南”。

这与近期 InfoQ 对 OpenClaw 安全问题的报道高度一致。相关报道提到,随着“养虾”热度快速上升,OpenClaw 的安装和使用已经出现大众化趋势,安全风险也因此被迅速放大:权限误用、敏感信息暴露、执行链失控,都不再只是理论问题,而是越来越真实的工程问题。

另一条主线是记忆。杭州场的 MemoryLake 分享,主题是“为 OpenClaw 打造永久、可迁移的多模态记忆平台”;InfoQ 同期另一篇文章则专门讨论了 OpenClaw 的长程记忆困局,指出随着任务链拉长和上下文变复杂,原生 memory-core 模块在长期任务中暴露出任务完成率偏低、记忆碎片化、检索低效等问题。

这其实很能说明一件事:OpenClaw 社区已经不再满足于“它能动”,而是开始追问 它能不能长期稳定地动、跨任务地动、可迁移地动。

因为它有两个层面的信息量。

第一,它是 实践。从议程内容看,这不是一场空谈趋势的大会,而是一场围绕 OpenClaw 真实使用问题展开的集体答辩:怎么装、怎么跑、怎么稳、怎么防、怎么协作、怎么商业化。

第二,它是 转折。如果说过去大家讨论 OpenClaw,重点还在“新鲜”“好玩”“很猛”,那这次中国行真正体现出来的是:围绕 OpenClaw 的讨论,已经从社区热梗进入工程深水区。

而这恰恰是当下 AI Builders 最关心的阶段。因为对真正的开发者、架构师、技术负责人来说,最有价值的从来不是一个新名词,而是一个新范式什么时候开始进入可验证、可复盘、可借鉴的阶段。

OpenClaw 也许还远没到成熟期,甚至它的很多问题才刚刚暴露出来。但也正因为如此,这个周末的 12 城联动,才更像一次难得的集体观察窗口:你可以看到龙虾怎么被养起来,也能看到它们是怎么翻车的;你能看到最乐观的想象,也能看到最务实的边界。

这比任何一句“Agent 时代来了”都更有价值。

因为对一个真正影响产业的软件范式来说,决定它命运的,从来不是热搜,而是 能不能被一线开发者和真实组织反复验证。

而 OpenClaw 中国行,正在做的,正是这件事。

最后的最后,重要的事情再说一遍: 本周末两天,近百位 OpenClaw 专家集结完毕,全国 12 座城市龙虾风暴来袭,覆盖 杭州、苏州、深圳、青岛、成都、广州、上海、南京、厦门、济南、武汉、北京。

点击文末【阅读原文】链接立即报名或扫码添加工作人员获取报名详情