探讨高权限AI Agent所需的基础设施,关注其执行边界、安全风险及评估体系,强调Agent已成为一个由模型、工具和环境构成的完整系统。

原文标题:更高权限的 AI Agent 需要怎样的 AI Infra?

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章中提到“Agent = Model + Harness”,你觉得 Harness 在 Agent 系统中扮演了什么角色?如果让你来设计一个 Harness,你会重点考虑哪些方面?

3、你认为在评估 Agent 的安全性时,最容易被忽略的环节是什么?你有什么好的建议来弥补这些疏忽?

原文内容

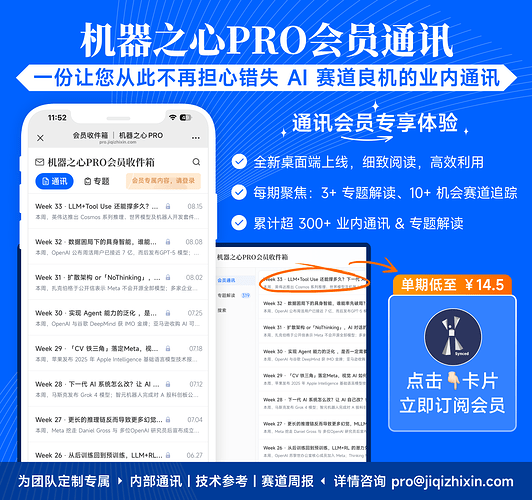

本文来自PRO会员通讯内容,文末关注「机器之心PRO会员」,查看更多专题解读。

高权限 Agent 正在经历一次对象边界的重写。从对话式助手到嵌入企业流程、浏览器、终端与操作系统的执行节点,Agent 已不只是「会回答问题的 AI 应用」,而是一个同时具有执行面、状态面、工具面与权限面的混合软件系统。伴随任务负载和责任边界的扩展,业界的话题开始关注这种「高权限 Agent」应当适配怎样的 AI Infra。

目录

01. Agent 作为「带执行面的混合软件系统」的能力边界有何特点?

业界对高权限 Agent 的定义在如何调整?Agent 的工作负载正在如何扩张?Harness 在如何影响 Agent 的 Infra 设计?...

真实世界之外,Agent 该如何评估?从「说错」到「做错」的风险升级要如何管控?...

新的 Agent Infra 需要考虑哪些问题?为什么沙箱、权限、凭证隔离和运行时控制会成为默认前提?...

Agent 作为「带执行面的混合软件系统」的能力边界有何特点?

1、以 OpenClaw 为代表的新一代高权限 Agent,已经不再局限于对话窗口中的问答工具,而是开始接入文件系统、命令行、浏览器、消息通道与网络服务,成为可以读写状态、调用工具并在授权边界内执行任务的系统对象。其应用扩展不仅限于传统问答,而是积极参与到多个执行场景中,承担复杂任务。

① LangChain 公开的 GTM agent 已能围绕 Salesforce leads 自动触发流程,跨 Gong、LinkedIn、公司网站等来源收集上下文,再将带 reasoning 和 sources 的 Slack 草稿推送给销售,显示 Agent 已被直接嵌入销售流程。[1-1]

② LangChain 在总结 Stripe、Ramp、Coinbase 的内部 coding agents 时,也直接将共性架构概括为 isolated cloud sandboxes、curated toolsets、subagent orchestration,以及 Slack、GitHub、Linear 等工作流集成,说明 Agent 正在成为研发流程中的执行基础设施。[1-2]

2、在权限、任务负载和边界逐渐扩张的趋势下,业界对 Agent 或 LLM-based Agent 的定义开始聚焦其整体性,强调 Agent 不只是模型能力的外延,而是一个由模型、工具、运行状态与环境反馈共同构成的完整系统。

① 以 Lei Wang 等人 2023 年的综述为代表,早期讨论多在「基于大语言模型的自主智能体」的框架下理解智能体,重点在于通过规划、记忆、工具使用等模块补足大模型能力,使其具备更完整的自主决策与执行能力。[1-3]

② 到近期综述中,这一理解进一步被系统化:研究者更强调智能体的「完整系统」属性,即其关键不只在于模型本身,而在于模型如何与工具、记忆、反馈回路和运行环境结合,作为连接自然语言意图与现实世界计算的系统接口持续运作。[1-4]

3、在企业实践中,Agent 的定义则从「模型能力外接工具」进一步收束为「可部署、可约束、可编排的执行系统」,其关键不只在于模型本身,而在于模型如何与工具、运行环境和流程控制机制共同工作。

① LangChain 将 Agent 概括为「Model + Harness」,并将这一外层执行框架进一步拆解为提示词、工具、沙箱、浏览器和编排逻辑等组成部分。[1-5]

② OpenAI 在有关 Agent 能力稳定目标下 harness engineering 的相关工作中,同样将重点放在环境设计、意图设定与反馈回路,而不再只是模型本身。[1-6]

4、在智能体开始承担系统执行功能之后,其责任后果不再单纯表现为会「说错」,业界开始担忧 Agent 是否会在系统执行层面真的「做错」。

① 随着模型开始调用工具、接入权限并嵌入业务流程,风险已具体表现为越权执行、误触发流程、敏感资源暴露,以及在错误边界内代表用户行动。

② 以 OpenClaw 为代表的智能体系统为例,其公开漏洞显示,恶意网站已可沿着本地网关、配对机制等控制路径尝试接管智能体。[1-7]

③ 美国国家标准与技术研究院已将部署环境中的访问约束、运行监测与安全评估列为智能体系统安全的重点问题。[1-8][1-9]

5、在高权限 Agent 的风险由「输出偏差」转向「执行失控」之后,相关治理已不再停留在模型侧防护,而是进一步扩展到权限、集成、网络、运行时与隔离环境。相关讨论的重点,已从「如何减少错误输出」转向「如何约束访问边界、限制执行范围并降低失控后的影响面」。

① 微软将 OpenClaw 视作「带持久凭证的不受信代码执行」,建议仅在隔离环境中评估,并使用低权限、非敏感凭证。[1-10]

② 官方模型威胁框架(Threat Model)将「恶意技能读取环境变量和配置文件以窃取凭证」列为严重残余风险,同时将 Runtime、Gateway、Integrations、Marketplace 与 MCP Servers 一并纳入威胁建模范围,并建议采用技能沙箱与凭证隔离等措施。[1-11][1-12][1-13]

不以真实世界作为训练场的 Agent 需要什么样的评估体系?

1、对于能够自主操作网页、图形界面和操作系统的智能体而言,真实网站与真实系统并不天然适合作为直接训练场。与之相应,围绕网页智能体和系统操作智能体的环境设计,当前正更集中地强调可复现、可验证与可隔离,即任务状态能够稳定重置、执行结果能够清晰判定、试错行为能够被限制在受控边界内...