清华、北大、腾讯提出GTR框架,通过思维引导的强化学习对抗多模态大模型智能体训练中的“思维崩塌”,显著提升决策能力。

原文标题:有效思考激发多模态智能体决策潜力!清华&北大&腾讯联合提出GTR训练新框架

原文作者:机器之心

冷月清谈:

怜星夜思:

2、论文中提到GTR框架在ALFWorld环境中去掉了文本观察,仅依赖视觉信息进行决策,这更贴近真实场景,但会不会导致智能体因为缺乏必要的文本信息而难以做出正确的决策?这种trade-off是如何考虑的?

3、GTR框架通过SFT loss将智能体的思路与修正器给出的正确结果对齐,但如果修正器本身给出的结果并非最优解,或者存在“幻觉”问题,是否会误导智能体的训练?如何避免这种情况?

原文内容

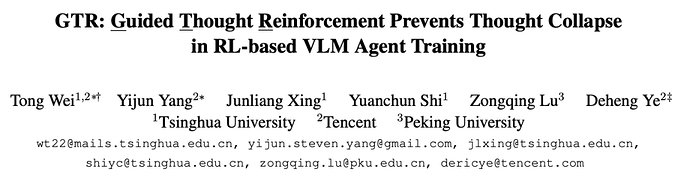

论文第一作者为魏彤,清华大学在读博士生,研究方向为大模型智能体和强化学习,导师为清华大学兴军亮、史元春;共同一作为腾讯杨一君;合作者为北京大学卢宗青;通讯作者为叶德珩。

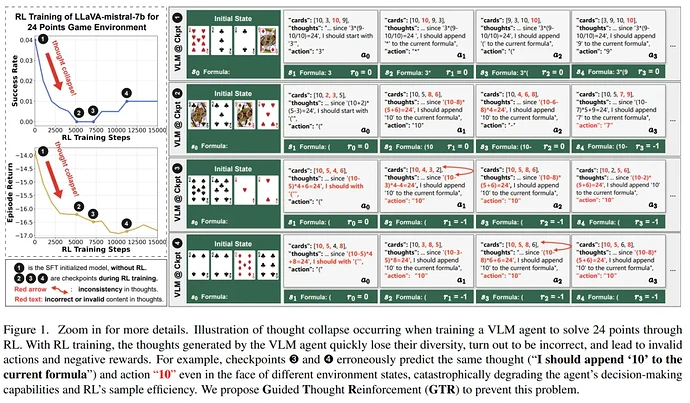

基于可验证奖励的强化学习(Reinforcement Learning with Verifiable Reward, RLVR)能够在大语言模型(LLMs)上有效提升思维链(Chain-of-Thought, CoT)决策的能力。然而对于多模态大模型(VLM)智能体的目标导向的动作推理任务,强化学习在复杂问题上并不能很好地提升决策能力,甚至会导致思维过程的退化。

来自清华、北大和腾讯的研究团队深入研究了这一 “思维崩塌”(thought collapse)的现象,发现由于模型训练的反馈仅依赖于最终动作,RL 训练无法有效约束 CoT 思维过程,导致 VLM 智能体思维退化,丧失多样性,并输出不一致和不完整的思路。

为了对抗思维崩塌,研究团队提出思维引导的强化学习(Guided Thought Reinforcement, GTR)框架,通过自动化修正器提供过程引导,在 RL 训练中实时优化模型的思路,且无需依赖人类的精细标注。在困难的卡牌游戏和具身智能任务中,基于 LLaVA-7B 的智能体用很小的规模实现了相比 SOTA 显著的成功率提升。

-

论文标题:GTR: Guided Thought Reinforcement Prevents Thought Collapse in RL-based VLM Agent Training

-

论文链接:https://arxiv.org/pdf/2503.08525

1.“思维崩塌” 现象影响 RLVR 训练效果

不像纯文本的智能体训练,由于多模态信息的引入和决策流程复杂性的提高,在交互性视觉环境中用 RL 训练 VLM 智能体更加困难。而其中 “思维崩塌” 的现象则主要体现在以下几点:

-

智能体的 CoT 过程失去多样性,对于不同的视觉和文本输入给出相同的思路。

-

模型输出思路不正确、不一致、不完整,虽在输出思路,但已丧失思考能力。

-

思维能力的丧失极大限制了模型的决策能力,难以释放模型潜力。

实验中发现,更大的模型、更长的训练时间也均展示出思维崩塌的情况。因此,问题的核心原因是强化学习的训练机制:

-

环境提供的奖励完全由模型最终的动作决定。

-

比动作输出更长且更基础的思维过程缺少评估和监督,只能依赖结果奖励间接引导。

-

在动作步骤多、状态空间大、复杂程度高的任务中,这一问题更加显著。

因此,这证明了 VLM 智能体的强化学习训练中,过程引导有着至关重要的作用。

2.GTR 框架如何避免模型 “不懂装懂”?

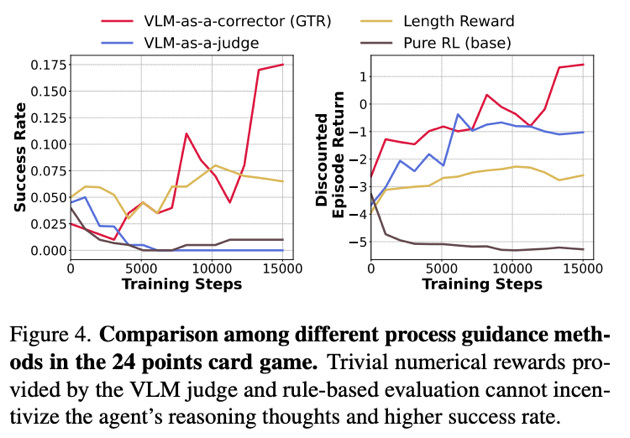

此前的相关工作也对过程引导的方法做出了研究。然而,常见的过程奖励模型(Process Reward Models, PRMs)需要精细标注的多模态数据训练,昂贵且费力;且固定数据集上的训练容易产生偏差,不适用于动态的交互式环境。

此外,用 VLM 进行打分的 VLM-as-a-judge 方法效果也不佳。这是由于简单的数值奖励难以提供充足的信息量和有效的指导,尤其考虑到大模型更强的 reward hacking 能力。在模型基础能力较差的情况下,缺少正向激励也容易导致悲观探索的问题。

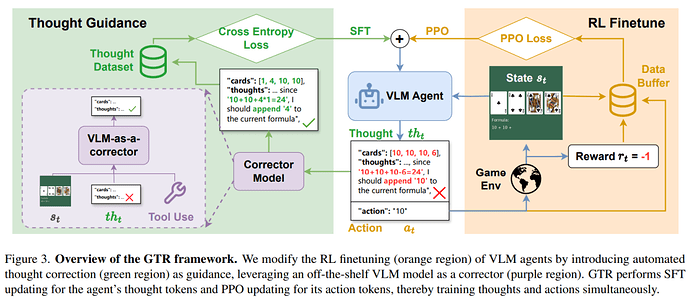

因此,我们需要找到一个足够简单、可规模化且有信息量的思维引导方式。在 GTR 框架中,“修正器模型”(corrector model)承担了这一至关重要的角色。

GTR 利用一个外部的 VLM 模型作为修正器,在强化学习的每一步,先对智能体思路中识别和推理的正确性进行评估,如果发现不正确或者不一致的情况,则利用智能体的状态输入进行修正。通过在常规的 PPO 过程中加入一个针对思路 token 的 SFT loss,将模型的思路与修正器给出的正确结果对齐,形成一个 “思维 + 动作”、“SFT+PPO” 的联合训练框架。

通过这种方式,强化学习与思维引导互相形成了补充。思维引导为训练提供了更多的监督信号,强化学习也能通过可验证奖励的反馈,使得修正过程无需专家级别的外部模型提供高质量的参考轨迹,让智能体能够突破外部模型的能力天花板。

针对在线训练样本偏移的问题,GTR 引入了 DAgger 策略缓解错误累积。框架还通过为智能体增加格式奖励和重复惩罚、为修正器模型提供工具调用弥补专业知识等方法,进一步提升了数据质量。

GTR 训练过程的伪代码如下:

3.GTR 的实验效果

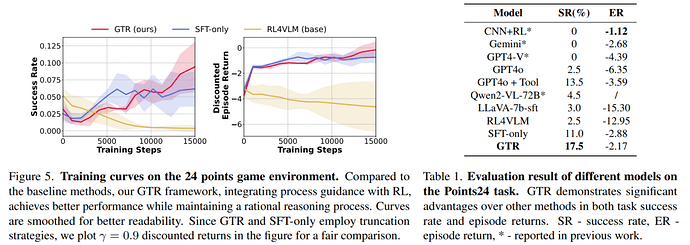

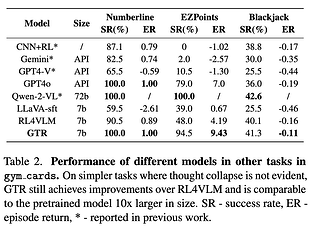

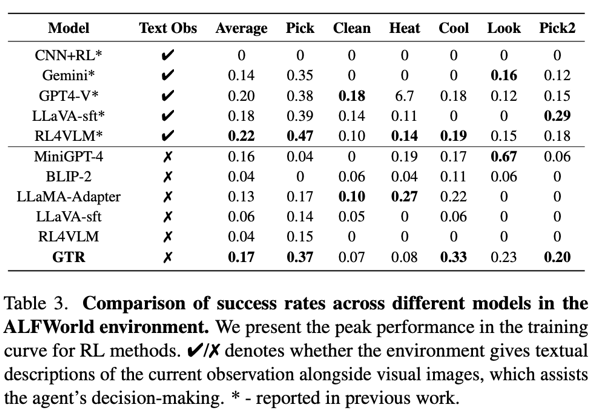

论文在 gym_cards 和 ALFWorld 两个常用的 VLM 智能体测试任务上进行了实验评估。智能体基于 LLaVA-7B,使用 GPT-4o 作为修正器训练。以仅包含强化学习的 RL4VLM 和仅包含思路引导的方法(SFT-only)作为基线进行比较。

在 gym_cards 中最困难的 24 点纸牌游戏中,GTR 在 15k 的训练步数内达到了最高 17.5% 的成功率,大幅超过了两个基线方法(2.5%、11.0%),甚至突破了 GPT-4o,即其修正器模型的水平(13.5%)。

而在更简单的、思维崩塌现象不显著的另外三个游戏中,GTR 相比于 RL4VLM 也能取得突破,并达到 10 倍其规模的预训练模型的能力水平。

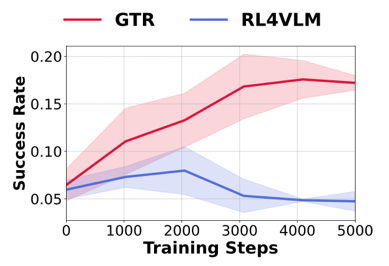

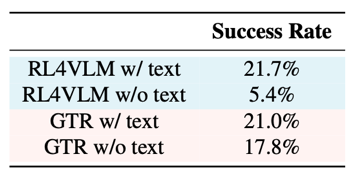

对于家用机器人场景的具身智能任务 ALFWorld,为了模拟真实环境,同时避免模型利用额外文本信息绕开多模态决策,实验中去掉了环境提供的文本观察,模型仅能依赖视觉信息进行决策。GTR 比起 RL4VLM 能够有效避免思维崩塌带来的性能下降,提升模型决策能力。

消融实验研究则证明了训练全过程思维引导的重要性、工具调用提升修正器专业知识的必要性和 DAgger 缓解在线训练分布偏移的有效性。同时指出,采用完整输出的 SFT 会限制 RL 的反馈,并使训练容易受到修正器幻觉的影响。

4. 研究意义与展望

本项研究揭示了多模态大模型智能体强化学习训练中,思维崩塌现象对训练稳定性和性能提升的限制。而通过修正器模型进行思路修改,GTR 在无需数据标注的条件下实现了实时自动化的思维过程监督,使过程引导与强化学习有机结合,互为补充,展现出强大的性能优势。

这一创新性的分析和解决方案也能够为复杂长时任务中大模型智能体的训练提供更多的启发和可能性。

更多细节请见原论文。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com