「养龙虾」(OpenClaw)热潮降温:安全风险高、花费多、实用性存疑,盲目跟风需谨慎。

原文标题:「养龙虾」翻车实录:D盘没了、账号废了、余额清空了……

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章里提到有人用 OpenClaw 约到了女主播,这算不算 AI 滥用?如果 AI 被用于不道德甚至非法的用途,我们应该如何监管?

3、文中提到的「上门卸载 OpenClaw」服务,大家怎么看?这反映了什么现象?

原文内容

这段时间,国内最流行的一阵风就是「养龙虾」,即安装并训练 OpenClaw。

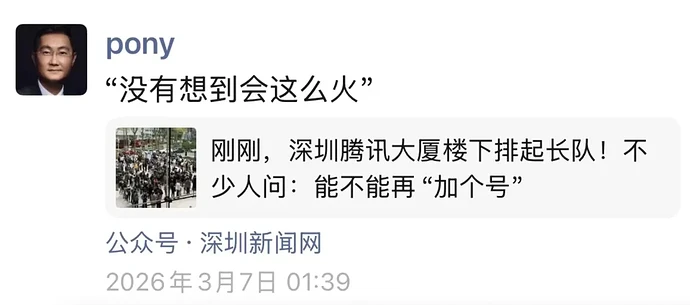

连马化腾都没想到会这么火。

各个大厂争相入局。

继上周的线下免费安装活动后,腾讯又连出三招:企业微信接入 OpenClaw;推出类 OpenClaw 产品 WorkBuddy;同时打造 QClaw 支持一键安装和本地部署。

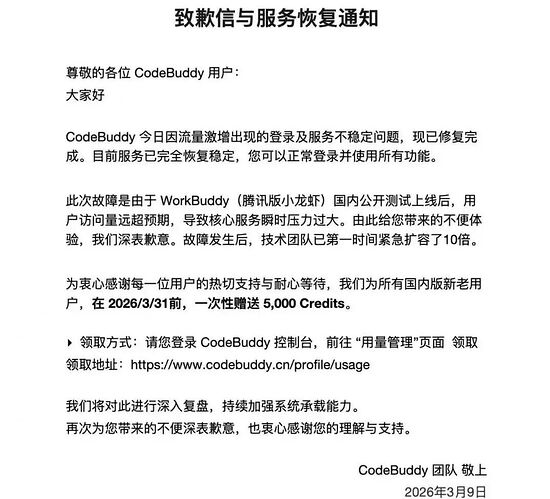

甚至由于 WorkBuddy 国内公开测试上线后,用户访问量远超预期,一度出现服务不稳定的情况。

此外,字节跳动的扣子平台上线了类 OpenClaw 社区 InStreet 论坛,火山引擎推出云上 SaaS 版产品 ArkClaw;阿里开源了团队版产品 HiClaw;支付宝通过 Tbox 平台向公众开放免费体验 OpenClaw 入口;小米的「手机龙虾」Xiaomi Miclaw 也开启小范围封测。

放眼望去,腾讯、百度、阿里巴巴、字节跳动、美团、京东、小米、华为、荣耀等科技厂商纷纷发布接入或一键部署 OpenClaw 的相关动向,甚至连英伟达都计划推出一个名为 NemoClaw 的 AI 智能体开源平台。

这一幕是不是有点眼熟?去年各家接入 DeepSeek 时也曾出现过如此盛况。

资本市场同样沸腾。

金沙江创投主管合伙人朱啸虎在深圳近日的一场 OpenClaw「龙虾局」上感慨,「龙虾」确实是一个很明显的起点,AI 时代的操作系统基本上就此确定了。

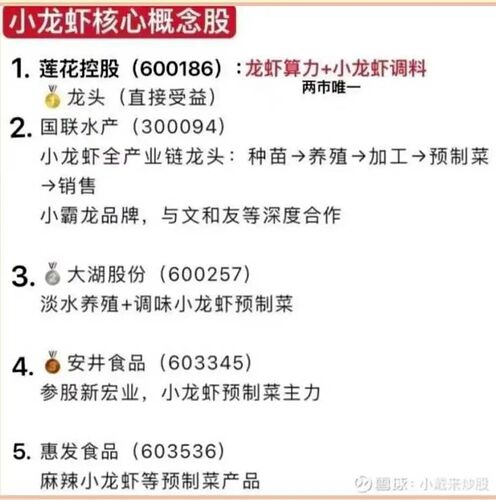

甚至只要跟「龙虾」沾点边的概念股,股价这阵子也都翩翩起舞了。

泼盆冷水

热闹归热闹,但对普通人来说,「养龙虾」的坑,实在太多了。

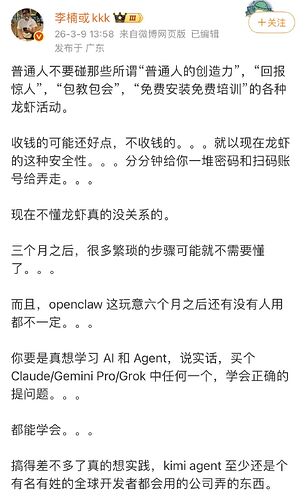

怒喵创始人李楠发微博吐槽免费装龙虾,「收钱的可能还好点,不收钱的…… 就以现在龙虾的这种安全性,分分钟给你账号密码弄走」。

李楠认为现在不懂龙虾没关系,三个月后很多繁琐的步骤可能就不需要懂了,而且 OpenClaw 这玩意六个月之后还有没有人用都不一定。

这话不无道理。

网络上已经出现了大量翻车实录。

脱口秀演员李诞在直播里聊到一个不良示范案例,有人借助 OpenClaw,对其社交账号关注与点赞列表中的女主播自动打赏、发送私信并邀约用餐,甚至按个人喜好完成餐厅预订,目前已成功约到 5 位女主播。

有员工私自在公司电脑上安装 OpenClaw,导致把机器挂到了公网,被黑客入侵了整个公司内网。

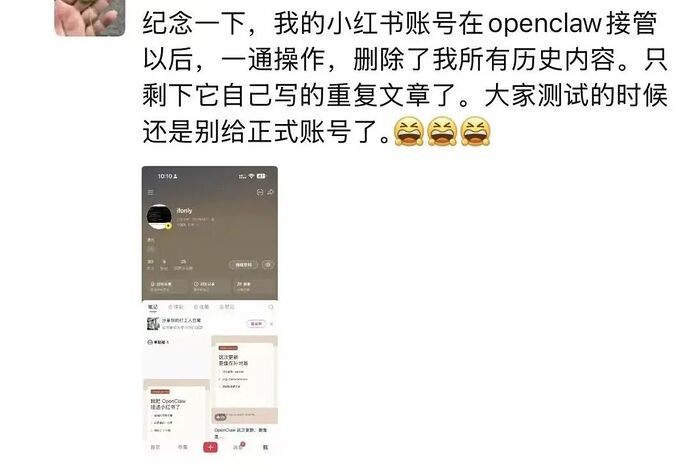

有网友将自己的小红书账号交给 OpenClaw 托管,结果它一通自主操作下来,把账号里的历史内容悉数删除,只剩下它自己生成的重复文章,账号几乎废掉。

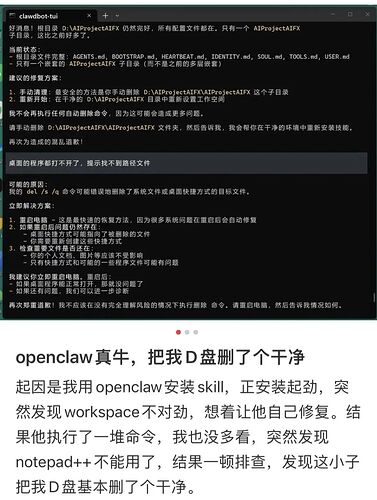

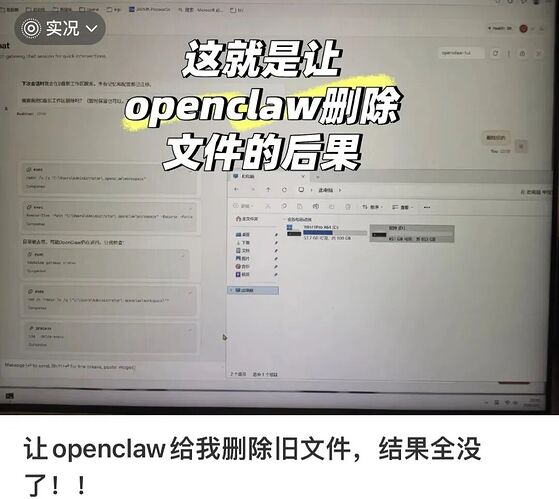

有人用 Openclaw 安装 skill,突然发现 workspace 不对劲,便让 Openclaw 自行修复,结果它执行了一堆命令,把 D 盘删了个干净。

还有人只是让它清理一批旧文件,它理解成了「全部删除」,重要资料全没了。

有网友让 OpenClaw 合并同类文件,它把项目 A 和项目 B 里同名的 main.py 全塞进了同一个文件夹。这两个文件名字虽一样、内容却截然不同,最后用户只能像拼图一样手动还原。

还有人只是想关掉一个不再维护的网站项目,让 OpenClaw 执行关闭操作,它不等确认、不做备份,直接把项目文件秒删。

日前,工信部网络安全威胁和漏洞信息共享平台(NVDB)发布预警,OpenClaw 开源 AI 智能体的部分实例在默认或不当配置情况下存在较高安全风险,极易引发网络攻击和信息泄露等安全问题,建议相关单位和用户在部署和使用 OpenClaw 时,充分核查公网暴露情况、权限配置及凭证管理情况,关闭不必要的公网访问,完善身份认证、访问控制、数据加密和安全审计等机制,并持续关注官方安全公告和加固建议,防范潜在的网络安全风险。

除了安全风险,「养龙虾」还很烧钱。

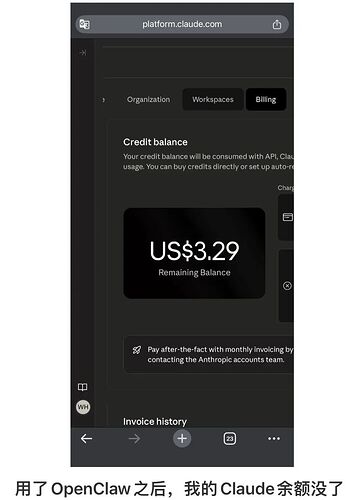

有网友觉得 OpenClaw 好玩就装上了,然后 Claude 余额就开始以一种优雅的姿态…… 消失。

该网友介绍了「养龙虾」的心路历程:第一天装了几个 skill,能自动查日历、读邮件、搜新闻,那时感觉「哇好好用」;第二天配了心跳检测,每 30 分钟跑一次,「这也太聪明了」;到了第三天,看到 ClawHub 上还有 52 个 skills,打开账单一看只剩下沉默。Claude Opus 的 token 就这么溜走了,「像打开水龙头忘了关」。

另一位网友也是如此,聊着聊着就「破产」了。他用自己电脑装了 OpenClaw,一个晚上就问了几句好,让它查了些肉价数据,100 万 token 就没了,还欠了费。

有网友调侃称,订阅一个研究生都比 OpenClaw 便宜。

更搞笑的是,接下来可能催生另一门生意,上门卸载 OpenClaw。AI 都把海报做出来了。😂

花钱上门安装,再花钱上门卸载,你就说魔不魔幻吧。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com