揭秘DeepMind曾试图脱离谷歌内幕:哈萨比斯策划50亿美元“赎身计划”,打造公益AGI实验室,最终博弈失败,凸显AI发展路线之争。

原文标题:哈萨比斯唯一官方传记首度揭秘:曾想让DeepMind脱离谷歌,还准备了一个疯狂的“B计划”

原文作者:AI前线

冷月清谈:

怜星夜思:

2、DeepMind 寻求脱离谷歌的计划最终失败,你认为导致这一结果的主要原因是什么?如果让你来设计,你会如何提高“B计划”的成功率?

3、文章中里德·霍夫曼对新型 AI 治理架构的理念表示赞赏,并认同 AI 最终需要某种获得民主广泛认可的非营利监督机制。你认为这种机制在实践中会面临哪些挑战?该如何解决?

原文内容

《哈萨比斯:谷歌 AI 之脑》首次曝光了这段未公开的内幕:霍夫曼当场口头承诺注资 10 亿美元,其他投资人纷纷表达兴趣,眼看计划即将成功,却被迫流产。这场博弈展现了哈萨比斯在资本与理想之间的艰难抉择,也折射出全球 AI 竞争下的权力格局。

现在,我们从书中摘录了这段精彩故事,以飨读者。

回顾 2013 年,哈萨比斯和苏莱曼曾采取过一种特殊的施压方式。在与谷歌的收购谈判中,他们曾考虑过 Facebook 的竞购。而在 2016 年底,他们又酝酿了一个“B 计划”:从外部投资者那里筹集 50 亿美元承诺资金。如果谷歌不给予他们想要的治理权,他们就退出公司。

50 亿美元是天文数字,足以覆盖 DeepMind 5 年多的运营成本。几个月前,OpenAI 曾自豪地宣称获得 10 亿美元承诺资金,而这只是虚无的承诺。但 DeepMind 领导层认为,他们可以向关注安全的投资者募资。募资的说辞是,50 亿美元就能让 AGI 处于安全环境中,拥有可靠的治理机制。

为敲定计划细节,苏莱曼组建了一支由富有想象力的律师、顶级沟通策略师和知名投资银行家组成的团队。他们共同提出了一种法律形式,强调 DeepMind 向善而非单纯追求收入的决心。

DeepMind 不会通过外部融资成立普通公司,而是会成立一家“担保有限公司”——这种结构通常应用于非营利组织;重组后的 DeepMind 不会向出资者发行股份,也不会分红,其法律责任将遵循章程中的原则。

哈萨比斯和苏莱曼联手同顾问们商议了数小时,并非所有人都认可“脱离谷歌”这一选项的可行性。“谷歌的控股公司 Alphabet 完全可以说‘好了,孩子们,安分点,我们拥有你们,你们得听我们的’。”其中一位顾问后来回忆道。DeepMind 员工在法律上受雇于谷歌,受竞业条款、禁止挖人的规定,以及 DeepMind 知识产权归属条款等的约束。想在一天内带走 100 名员工另起炉灶,必然会陷入错综复杂的法律纠纷。

但团队并未退缩。在一位公益法权威律师的支持下,他们准备声称,DeepMind 脱离谷歌符合英国公众利益。他们主张,拆分能加强 AI 安全性,进而维护公共利益。谷歌非常在意声誉,肯定不会在法庭上挑战这一主张。此外,即便脱离谷歌存在法律风险,这种威胁本身也具有价值。

团队最终敲定了一个双管齐下的计划。如果哈萨比斯和苏莱曼能与意在投资 B 计划的亿万富翁会面,谈一谈也无妨,与全球顶级资本家深化联系难道不好吗?但 DeepMind 也会小心行事,避免过度施压。“我们从未对谷歌说‘除非你这么做,否则我们就离开’。”一位顾问回忆道。

“关键在于让谷歌认真对待这场谈判,”这位顾问继续说道,“谷歌本可以说‘我们知道你们不会离开,何必浪费时间’,但值得称赞的是,他们从未这样做。这也让这场谈判显得尤为特殊。”

哈萨比斯和苏莱曼身处一个奇特的境地。他们试图为前所未有的技术构建前所未有的治理体系,与始终不置可否的母公司周旋。尽管前路未卜,但仍有一丝希望,他们决心继续全力争取。

2017 年 1 月初,哈萨比斯和苏莱曼现身阿西洛马酒店——这家宁静的海滨度假酒店位于加利福尼亚州蒙特雷半岛。近半个世纪前,这里曾举办过一场著名的基因研究会议,为 20 世纪 70 年代突破性技术的实验制定了基本规则。如今,在李世石被 AlphaGo 击败的冲击下,阿西洛马再度成为划时代会议的举办地,此次聚焦的是 AI 规则。

哈萨比斯和苏莱曼出席会议是为了探讨安全问题——毕竟,正是他们公司的产品让这场会议显得迫在眉睫。但他们也借此机会与里德·霍夫曼讨论了退出谷歌的想法。尽管哈萨比斯因霍夫曼参与创办 OpenAI 而对他心存警惕,但三人仍保持着友好关系。霍夫曼是一位优秀的沟通者,消息总是很灵通。

三人坐下后直奔主题:如果哈萨比斯和苏莱曼脱离谷歌,霍夫曼是否愿意为一家新的公益 AI 公司提供资金?

霍夫曼对 DeepMind 与其科技巨头出资方之间的紧张关系并不感到意外。他看到 OpenAI 与微软之间也出现了类似情况。最近,当微软试图将与 OpenAI 的合作打造成公关亮点时,马斯克勃然大怒,直言不会让 OpenAI“看起来像微软的营销工具”。

此外,霍夫曼赞赏新型 AI 治理架构的理念。他支持 OpenAI,正是因为它以非营利组织的形式成立,章程要求技术服务于社会。这种模式部分受到 DeepMind 的启发——SpaceX 会议曾首次尝试在营利性公司结构中加入非营利董事会——但 OpenAI 怀揣着进一步推动治理创新的宏大抱负。“我们计划让全球各地的人们推选出代表进入新的治理董事会。”山姆·奥尔特曼宣称,他从詹姆斯·麦迪逊(James Madison)关于制宪会议的笔记中汲取了灵感。“因为如果我不参与,我会想‘凭什么那些家伙能决定我的未来?’”

无论奥尔特曼关于全球选举的想法多么激进,霍夫曼都认同其核心诉求。AI 最终需要某种获得民主广泛认可的非营利监督机制,因为政客们对尖端技术的理解向来迟缓。就在会议举办的几个月前,唐纳德·特朗普当选为美国总统,霍夫曼认为特朗普的反监管倾向令人厌恶。霍夫曼愿意支持 DeepMind 脱离谷歌,尤其是在政治领导人无所作为的情况下,这么做可以填补治理空白。

哈萨比斯和苏莱曼向霍夫曼保证,填补治理上的空白正是他们的计划。他们详细阐述了担保有限公司的想法,并将其命名为“全球利益公司”(GlobalInterest Company)。没有人能从这家企业中获利,它将以资本主义的高效率运营,但产生的效益将具有后资本主义特质。霍夫曼最近刚刚将领英出售给微软,个人净资产达 38 亿美元。他是一位坦率的理想主义者,宣称要帮助人类蓬勃发展,这比苏莱曼所追求的目标更宏大、更“美国化”。出于坚定的信念,霍夫曼同意将超过 1/4 的个人财富,即惊人的 10 亿美元,投入 DeepMind 的社会进步愿景。这一金额比他一年多以前向 OpenAI 承诺的资金高出 100 倍。

“我当时说,这是我此生见证的最具变革力的技术,”霍夫曼回忆道,“我支持独立的、以公共利益为使命的 DeepMind,就像我支持 OpenAI 一样。这项技术不应被用于巩固垄断地位。”

“况且,我本就计划将 90% 的财富用于造福人类的事业,所以我当场承诺注资 10 亿美元。”

“我没有告诉奥尔特曼这件事,”霍夫曼继续说道,“也没有告诉 Greylock 的人。”他补充道。后者指的是他担任合伙人的风险投资公司。亿万富翁行事,无须向任何人交代。

部分 DeepMind 顾问主张接受霍夫曼的资金,推进拆分计划。有了知名投资者牵头,其他资金自然会跟进。即便谷歌试图在法庭上挑战 DeepMind,后续影响也可控。独立带来的回报包括运营的灵活性、用 DeepMind 股票激励员工的机会,这些足以抵消法律层面的复杂问题。

哈萨比斯理解这种观点,但他担心漫长的法律诉讼会耗尽自己的精力。作为 Alphabet 公司拆分出去的方案,无疑是更稳妥的选择。

为推动 Alphabet 拆分计划落地,苏莱曼在阿西洛马找到了肯特·沃克(Kent Walker)。沃克是 Alphabet 的顶级律师兼政策策略师,曾出席 SpaceX 安全会议。

苏莱曼将沃克介绍给安吉拉·凯恩(Angela Kane),这位联合国高级官员负责遏制大规模杀伤性武器。苏莱曼认为凯恩是 3-3-3 董事会的绝佳人选,能彰显拆分后 DeepMind 使命的可信度。他还告诉沃克,他已征求过奥巴马的意见,并提到了阿尔·戈尔。此外,苏莱曼暗示,各类人士(包括一些超级富豪)都希望 DeepMind 的技术在强大治理委员会的监督下发展。

与此同时,哈萨比斯与同样出席阿西洛马会议的拉里·佩奇进行了沟通。佩奇一直支持 Alphabet 的拆分计划,哈萨比斯想知道他现在是否有什么改变。

佩奇宣称,他仍然支持拆分计划,在他看来,将 DeepMind 拆分出去仍是合理的选择,但这需要得到桑达尔·皮查伊的同意。

哈萨比斯抓住这个看似恰当的机会,表示会立即拜访皮查伊。他收拾行李,提前离开会议场地,前往山景城,渴望尽快结束谈判。他厌倦了反复拉锯和律师介入。2017 年 1 月 6 日,哈萨比斯在谷歌总部与皮查伊会面,苏莱曼从阿西洛马的酒店房间接入通话。

哈萨比斯以和解的意图开启对话,他告诉皮查伊,拆分计划的设计初衷是缓解所有相关方的顾虑。他提出,皮查伊、佩奇和埃里克·施密特可以代表 Alphabet 进入 DeepMind 的 3-3-3 董事会,安吉拉·凯恩和其他知名人士担任独立董事。他还补充说,数月的谈判让他无法专注于 DeepMind 的本职工作,他想把精力放在科研上。

皮查伊友好地做出回应,听起来对所有提议都持开放态度,只需解决一些细节问题,由哈萨比斯和苏莱曼与德拉蒙德进行协商。

哈萨比斯和苏莱曼再次经历了 2016 年 11 月的遭遇。第二天,德拉蒙德与他们会面,表示 DeepMind 团队误解了皮查伊的意思,皮查伊完全反对 Alphabet 的拆分。根据一份 DeepMind 文件记载,哈萨比斯和苏莱曼提出了“所有可能的机制”来打消谷歌的顾虑,但德拉蒙德不为所动,谈判陷入僵局。

几天后,哈萨比斯和苏莱曼给皮查伊发了一封电子邮件。“Alphabet 的拆分计划已经拖了太久(超过一年),正严重影响公司的正常运营。”他们写道。两人提议返回山景城“彻底解决此事”,甚至愿意取消出席达沃斯世界经济论坛的计划。他们建议皮查伊、德拉蒙德以及拉里·佩奇、谢尔盖·布林都参加下一次会议,并表示他们早已厌倦了“一个唱红脸一个唱白脸”的拉锯。

双方再次会面时,谈话彻底暴露了彼此的分歧。哈萨比斯和苏莱曼认为,DeepMind 不适合归入谷歌旗下,其使命是 AGI,而非消费互联网产品。皮查伊则反对称,AI 是他为谷歌规划的愿景的核心,他绝不会允许自己的科学团队流失。

哈萨比斯原本希望拉里·佩奇能站在自己这边,推动 Alphabet 的拆分计划落地。但佩奇迟到了 2 小时,谢尔盖·布林来得更晚。他们这种后来被称为“创始人模式”的状态,即经常无影无踪,颠覆了“创始人应永久掌控公司”的硅谷信条。由于佩奇和布林实际上已经缺位,皮查伊成了与 DeepMind 正面交锋的人。

一周后,皮查伊试图打破僵局。他的目标是保住谷歌在 AI 领域的领先地位,而疏远 AI 界的领军人物绝非良策。在硅谷家中的一对一晚宴上,皮查伊为苏莱曼准备了素食咖喱和一项诱人的提议,用意是在他和哈萨比斯之间制造裂痕。

皮查伊提议,不必让整个 DeepMind 成为半独立的“赌注项目”,公司可以一分为二。哈萨比斯可以带着研究部门离开,专注于 AGI——皮查伊还略带轻蔑地表示,谁也不知道这是否能成功。与此同时,DeepMind 负责为医疗领域开发即时可用算法的应用事业部应并入谷歌。作为重组的一部分,苏莱曼将在加利福尼亚州负责谷歌所有的 AI 应用业务。

2017 年春天,皮查伊的计划缓慢推进。这个计划有其吸引力:哈萨比斯可以领导一个半独立的团队继续追求 AGI 的梦想;苏莱曼则可以借助谷歌的全球帝国推广实用型 AI。每隔几周,哈萨比斯和苏莱曼就会乘坐 11 小时的飞机从伦敦飞往旧金山,参加一场又一场冗长的会议。“我们会反驳一些内容,他们也会反驳一些内容。”苏莱曼后来表示。然后两人又要赶往机场,重新调整时差。难怪苏莱曼在伦敦与下属打交道时会显得心不在焉、心事重重;也难怪那年夏天 Transformer 架构出现时,哈萨比斯未能及时察觉其潜力。

2017 年 6 月初,DeepMind 的 500 多名员工乘坐两架包机离开伦敦,前往苏格兰高地。公司规模已经超出了伦敦周边会议中心的承载能力,因此组织者需寻找一个空间充足的场地,最终选定了距离巴尔莫勒尔城堡不远的阿维莫尔度假村。“如果需要大量住宿,要么选苏格兰,要么选私人岛屿,”首席策划师解释道,“我觉得私人岛屿有点儿太夸张了。”尽管话里透着务实,但阿维莫尔宽敞的宴会厅还是被绿植环绕,宛如《纳尼亚传奇》中的魔法森林。哈萨比斯和苏莱曼还带领大家去了卡丁车赛道,很难说两位创始人谁更争强好胜。

卡丁车并非最具风险的活动。开会期间,苏莱曼登上舞台,阐述了 DeepMind 应用事业部的愿景。他列举了 AI 将解决的现实问题:除了医疗健康,还有气候变化。苏莱曼最近聘请了谷歌工程师吉姆·高(Jim Gao),后者曾开发出一套 AI 系统,能降低数据中心的电力消耗。借助 DeepMind 的强化学习技术,吉姆·高计划将自己的创新提升到新高度,开启智能建筑时代,让建筑自主学习节能知识。

苏莱曼的演讲进入高潮,他在大屏幕上展示了一张幻灯片,标题为“DeepMind:一家全球利益公司”。在阿维莫尔会议召开前的几周里,谷歌似乎暗示自己已准备好就皮查伊的某个计划达成协议,现在正是向员工宣布这个消息的时刻。

数百名听众感到震惊。数月来,关于 DeepMind 拆分的传言一直在流传,还有人猜测员工可能在新公司实体中获得多少股票。但屏幕上的幻灯片显示了一个包含两个方框的组织结构图,暗示着不同的走向。第一个方框标注“Alphabet/ 谷歌”,显示苏莱曼和 AI 应用部门位于山景城母公司的核心位置。这不是拆分,而是并入。第二个方框标注“DeepMind”,显示一家专注于 AGI 研究的独立全球利益公司,仅通过代表技术许可协议的一条虚线与谷歌相连。显然,计划是一部分并入,另一部分拆分,大家都感到困惑不已。

10 天后,DeepMind 领导层同样感到困惑。谷歌反馈了最新谈判立场,附带一份划满红线的更新文件。皮查伊显然完全没准备批准阿维莫尔会议上宣布的计划,哈萨比斯和苏莱曼面临着不得不收回向全公司公布的愿景的局面。

这场危机适逢关键时刻。就在同一周,伊利亚·苏茨克维在读完有关 Transformer 的论文后,激动地跳了起来。

哈萨比斯尽力说服皮查伊重新考虑立场。为了表达对谷歌这份划满红线文件的不满,他取消了与这位 CEO 的下一次通话。

皮查伊立即联系了哈萨比斯,希望尽快沟通。哈萨比斯让他等了一段时间后最终同意了会面,随后愤怒地表达了自己的失望。4 天后,苏莱曼也开始施压,给德拉蒙德发邮件取消了另一场会议。

谷歌与 DeepMind 的关系降至冰点。谷歌看到了 AI 巨大的商业潜力,不愿放手;DeepMind 则认为 AI 部署不应受商业利益主导,否则将引发巨大的生存性风险。双方都深知彼此不可或缺,一场充满摩擦的对话仍在继续……

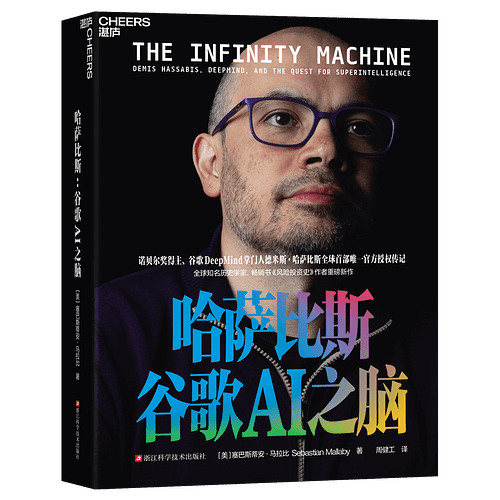

更多精彩故事,请见《哈萨比斯:谷歌 AI 之脑》

作者:[美] 塞巴斯蒂安·马拉比

译者:周健工

出版时间:2026 年 3 月

出版社:湛庐文化 / 浙江科学技术出版社