OpenClaw 迎来重大更新,支持 GPT-5.4,新增上下文引擎插件,优化持久化频道绑定,并强化安全性。GitHub Star 数已突破 28 万,正朝着成熟 Agent 操作系统迈进。

原文标题:OpenClaw昨晚大更新:支持GPT-5.4,记忆热插拔,Star量破28万

原文作者:机器之心

冷月清谈:

* **智能体/上下文引擎插件接口:** 引入 Context Engine 插件插槽,支持自定义上下文管理策略,例如通过 lossless-claw 插件实现无损压缩,无需修改核心逻辑。

* **ACP/持久化频道绑定:** 实现了 Discord 和 Telegram 的频道绑定存储,服务重启后 ACP 线程目标依然保持绑定,保证一致性。

* **Telegram 话题智能体路由:** 支持针对每个话题的 agentId 覆盖,将特定话题路由到具有隔离会话的专用智能体。

* **新手引导/联网搜索:** 优化了配置向导,增加供应商选择步骤和完整的供应商列表,同时支持 SecretRef 引用模式。

* **工具/联网搜索:** 将 Perplexity 供应商切换为 Search API,支持结构化结果,并新增语言 / 地区 / 时间过滤器,提高搜索精准度。

* **插件/系统上下文字段:** 新增钩子允许将插件的静态引导信息放置在系统提示词空间,降低 token 成本。

* **模型支持与工具链优化:** 新增对 google/gemini-3.1-flash-lite-preview 的原生支持,并对 Ollama 等本地模型的处理机制进行了优化。

* **安全性提升:** 通过防提示词注入、拦截等措施,进一步提升了安全性。

OpenClaw 正在努力解决 AI Agent 框架工程化落地中的关键问题,例如突破上下文窗口瓶颈,强化智能体协作,并提升安全性。目前,OpenClaw 在 GitHub 上的 Star 量已达 28 万,应用范围从专业开发者扩展到各行各业,有望成为每个人手下的“虚拟员工”。

怜星夜思:

2、OpenClaw 强调了智能体的持久化能力,这意味着 Agent 可以记住之前的对话和任务。你认为这种持久化能力在哪些应用场景中最有价值?

3、OpenClaw 不断提升安全性,例如防提示词注入。你认为在 Agent 应用中,还有哪些潜在的安全风险需要关注?

原文内容

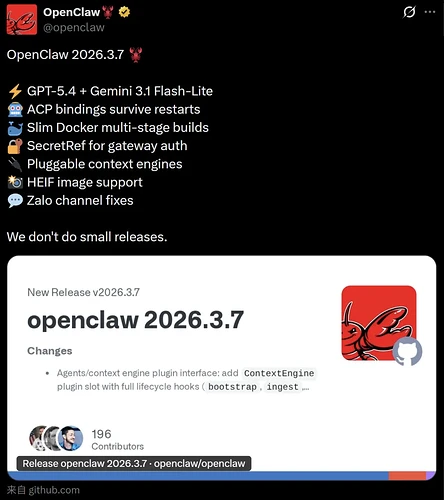

「我们没有小发布。」

本周日,最热门的智能体项目 OpenClaw 发布了 2026.3.7 版本,引入了上下文引擎插件、lossless-claw 等功能,同时也更新了一系列新模型的支持。

从 GitHub 的更新日志上看,OpenClaw 2026.3.7 的更新内容多而复杂。不过总的来说 OpenClaw 目前的主线已经逐渐清晰:它正在将 OpenClaw 从一个实验性的智能体框架,推向一个具备高度持久性、可扩展性和生产级安全性的成熟 Agent 操作系统。

具体来看,此次更新主要包括以下几个方面:

-

智能体 / 上下文引擎插件接口:新增 Context Engine 插件插槽,支持完整的生命周期钩子。引入基于插槽的注册表和配置驱动的解析机制;添加 LegacyContextEngine 包装器以保留现有的上下文压缩行为;通过 AsyncLocalStorage 为插件运行时提供作用域子智能体运行时,并新增 sessions・get 网关方法。这使得类似 lossless-claw 的插件提供替代的上下文管理策略,而无需修改核心压缩逻辑,而当未配置该插件时,行为无变化。

-

ACP / 持久化频道绑定:新增耐用的 Discord 频道和 Telegram 话题绑定存储,包括路由解析,以及 CLI / 文档支持,使 ACP 线程目标在服务重启后依然保持绑定,并能进行一致性管理。

-

Telegram/ACP 话题绑定:在 /acp spawn 命令中支持 Telegram Mac Unicode dash 前缀;支持 Telegram 话题线程绑定(--thread here|auto);将已绑定话题的后续回复自动路由至 ACP 会话;新增 Telegram 审批按钮,使用带有前缀的 approval-id 解析,且成功绑定后自动在话题内置顶确认信息。

-

Telegram / 话题智能体路由:在论坛组和私聊话题中支持针对每个话题的 agentId 覆盖,使特定话题可以路由到具有隔离会话的专用智能体。

-

新手引导 / 联网搜索:在配置向导中增加供应商选择步骤和完整的供应商列表,并在引导过程中支持 SecretRef 引用模式。

-

工具 / 联网搜索:将 Perplexity 供应商切换为 Search API,支持提供结构化结果,并新增语言 / 地区 / 时间过滤器,使得搜集信息更精准。

-

网关:为 gateway.auth.token 增加 SecretRef 支持,并加入身份验证模式防护栏。

-

插件 / 系统上下文字段:新增 prependSystemContext 和 appendSystemContext 钩子,允许将插件的静态引导信息放置在系统提示词空间,以利用供应商缓存并降低重复提示词的 token 成本。

-

新增对 google/gemini-3.1-flash-lite-preview 的原生支持,包括模型 ID 正规化、默认别名、多媒体理解图像查找、Google Gemini CLI 向前兼容回退及文档。

-

工具链与本地模型生态优化方面,在 2026.3.7 版本上,OpenClaw 重构了 Web 搜索工具,优化了 Ollama 等本地模型的处理机制,以及 Docker 容器部署。新版本完美兼容了 Ollama 等本地模型在「思考 / 推理(Thinking/Reasoning)」阶段的流式输出隔离,不再会将模型底层的思考过程误当做正式回复输出。

此外在容器化上,Docker 支持通过 OPENCLAW_EXTENSIONS 预打包扩展依赖,容器启动更快速、结果更可复现。

需要注意的是,此次更新中一个重要变化是「重大」网关认证模式,如果同时配置 gateway.auth.token 和 gateway.auth.password,则现在必须显式指定 gateway.auth.mode,升级前将该模式设置为 token 或 password。否则,升级后可能导致启动、配对或 TUI 失败。

而这些只是此次更新的部分内容,更多详细信息,大家可以去 GitHub 上获取。正如 OpenClaw 在更新贴文中所言,「此次发布的背后包含了 196 位贡献者」,涉及多方面的更新。

总结起来,OpenClaw 正在试图解决目前 AI Agent 框架工程化落地的几个重要问题。它突破了「上下文窗口」的瓶颈,允许开发者自由挂载 RAG(检索增强生成)、知识图谱折叠或无损压缩算法,为智能体「长期自主运行」铺平了道路。

在 OOLONG 基准测试中,使用相同的模型,新版 OpenClaw 上 lossless-claw 的得分为 74.8,而 Claude Code 的得分为 70.3,随着上下文长度的增加,差距会越来越大。

在所有测试的上下文长度下,它的性能都优于 Claude Code。有工程师在 OpenClaw 上运行了一周,表示:「说它运行良好都算是保守的说法。」

OpenClaw 强化了主从智能体的协作能力,复杂任务现在可以更加安全、隔离地拆解并分发给拥有专属记忆通道的小智能体来处理。通过让不同的 Agent「常驻」在不同部门群组中的方法,OpenClaw 实现了持久化的通道绑定。现在哪怕服务器重启,专用的智能体依然能记住上下文并接续之前的工作。

最后,诸如防提示词注入、拦截、凭据保护、时间戳的 UTC 锚定对齐等更新进一步提升了安全性。

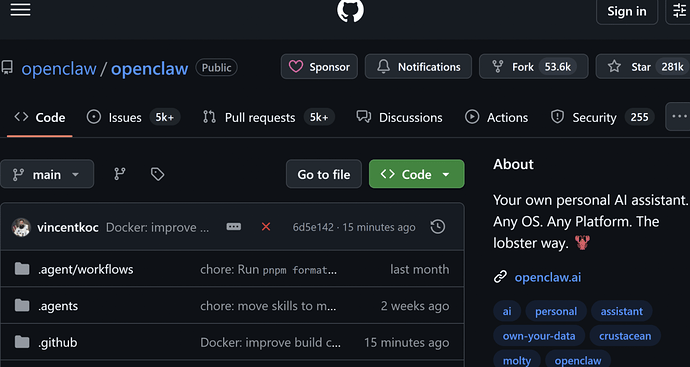

目前,OpenClaw 在 GitHub 上的 Star 量已经达到了 28 万。

从社交媒体到办公室,越来越多的人正在尝试使用 OpenClaw,该工具的应用范围已经从专业的开发者转向各行各业的不同人群。人们整将其用于从选股、撰写报告到制作 PPT、写电子邮件、写代码等各种用途。

AI 智能体助手,或许会很快成为每个人手下的「虚拟员工」,大大降低我们的工作量。

One More Thing

机器之心拟于近期在上海举办一场 OpenClaw 活动,正在四处「抓」有趣的议题和嘉宾。这次想把 OpenClaw 彻底聊透,从爆红机制、技术逻辑,到实战案例、创业机会等,我们都想听。

特别欢迎 OpenClaw 核心贡献者、大厂 / 科技公司团队负责人、实验室 / 高校学者、Agent 创业者、VC 投资人,以及在 OpenClaw 上有深入实践的朋友来聊。

有意者请联系小助手微信(微信号:13661489516)

参考内容:

https://x.com/openclaw/status/2030522386894946620

https://github.com/openclaw/openclaw/releases/tag/v2026.3.7

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com