本文介绍了在虚拟机上安装OpenClaw的详细步骤与配置,同时着重分析了OpenClaw的安全风险与Token消耗问题,为用户提供参考。

原文标题:本地虚拟机安装OpenClaw

原文作者:牧羊人的方向

冷月清谈:

怜星夜思:

2、文章中提到了OpenClaw的安全隐患,你认为应该如何平衡OpenClaw的强大功能和潜在的安全风险?有哪些最佳实践可以降低风险?

3、OpenClaw对Tokens的消耗较高,有哪些方法可以优化Token的使用,降低成本?

原文内容

近一段时间OpenClaw爆火,本文也尝试在虚拟机上安装OpenClaw。

1、安装npm

虚拟机安装Open首先得安装22.0以上版本的npm,此版本的npm不支持在类似centos7的低版本系统中运行。因此先安装centos 8系统,安装步骤可参考参考资料1。

1)安装npm

#cd /usr/local/src [root@centos8-tango-01 src]# wget https://nodejs.org/dist/v24.13.0/node-v24.13.0-linux-x64.tar.xz#解压缩

tar -xf node-v24.13.0-linux-x64.tar.xz#将解压缩的文件放到用户目录/usr/local

mv node-v24.13.0-linux-x64 /usr/local/node

#配置软连接方便进行全局调用

ln -s /usr/local/node/bin/node /usr/bin/node

ln -s /usr/local/node/bin/npm /usr/bin/npm

2)检查node和npm版本

[root@centos8-tango-01 local]# node --version

v24.13.0

[root@centos8-tango-01 local]# npm --version

11.6.2

2、安装openclaw

直接执行命令安装最新版本

# 执行安装

npm install -g openclaw@latest

安装过程中可能会提示一些软件不存在,比如git、cmake等,根据报错提示安装依赖软件

[root@centos8-tango-01 node]# dnf install git -y [root@centos8-tango-01 node]# git --version git version 2.27.0

[root@centos8-tango-01 _logs]# dnf install cmake python3-devel –y

安装过程约半个小时,安装完成后检查是否安装成功。

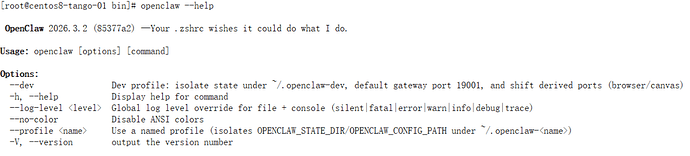

# 配置软连接 sudo ln -s /usr/local/node/bin/openclaw /usr/bin/openclaw # 查看是否安装成功 openclaw –help

OpenClaw 2026.3.2 (85377a2) — Your .zshrc wishes it could do what I do.

3、配置OpenClaw

1)手动配置

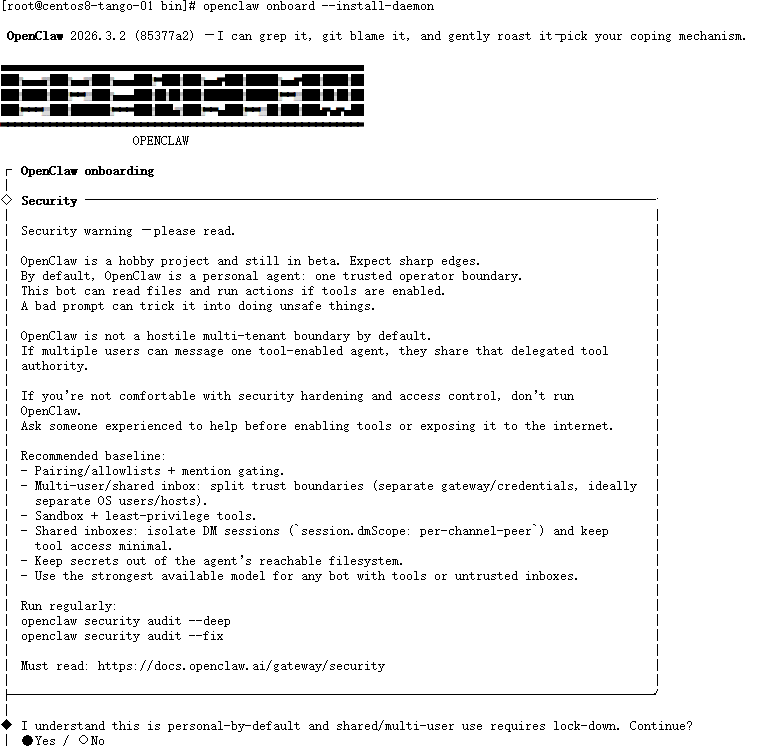

OpenClaw与常见的应用模板不同,官方提供了若干需用户自行手动配置的步骤,在首次登入服务器后,输入并回车运行如下命令开始配置:

openclaw onboard --install-daemon

运行上面的命令后,出现同意免责声明,将会出现一个问题:是否知晓风险,选择Yes就行。

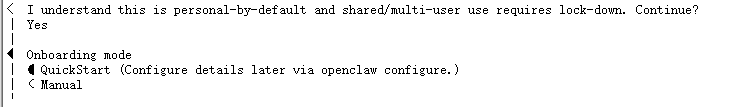

2)配置模式选择:快速入门

接下来需要选择Onboarding的模式。

第一个是快速启动,后续通过openclaw configure配置信息;第二个是先手动配置。选择QuickStart。

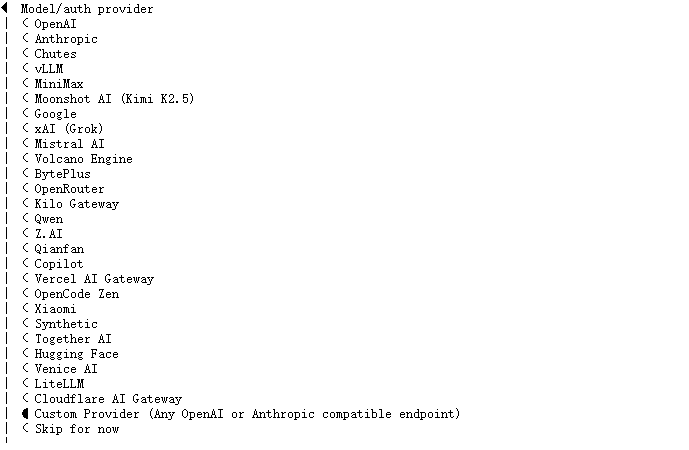

3)模型配置

然后它会让你配置AI大模型。有OpenAI、Qwen、MiniMax、Kimi等,有哪个API接口就选择哪个。如果是DeepSeek的API,选择Custom Provider进行配置,本次选择Deepseek API。

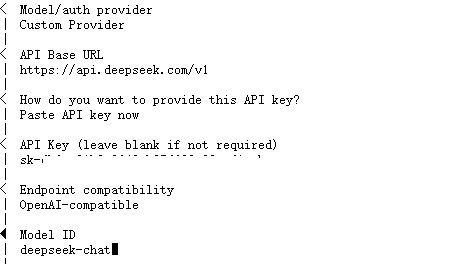

输入DeepSeek API的URL和API key。URL为https://api.deepseek.com/v1、API key为DeepSeek官网生成的sk-xxxx的key(注意不要泄露)、Model ID先选择deepseek-chat(对应Deepseek-V2模型)

配置完成后会校验API key是否可用,如果Token余额不足,会返回402报错。

4)选择频道

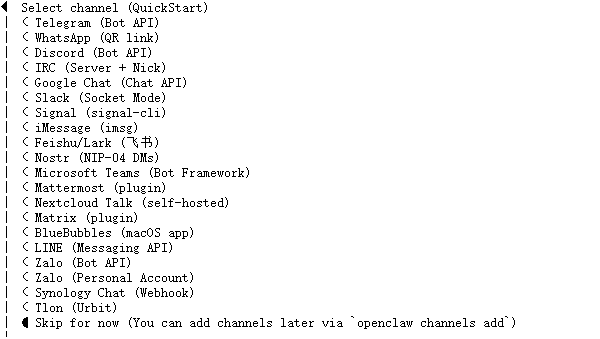

配置好模型后,会让你选择聊天频道。选择最后一个,直接跳过。

5)配置Skills

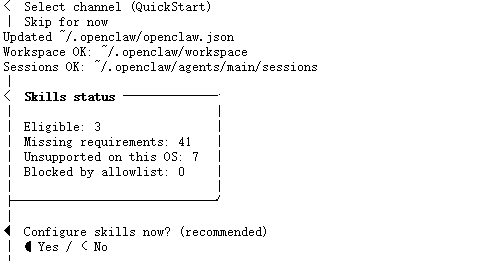

然后会问你要不要配置技能。选YES

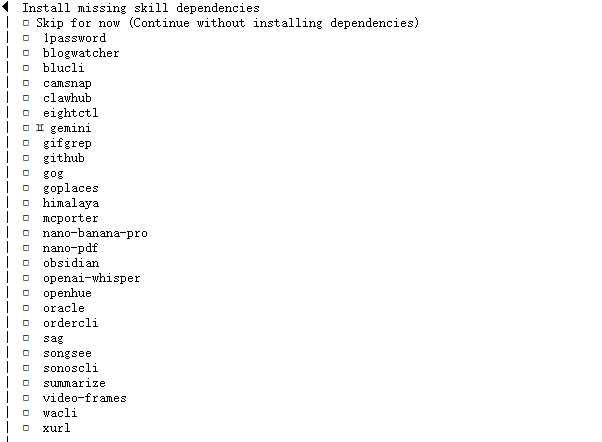

再然后,会给你一堆Skills,直接跳过

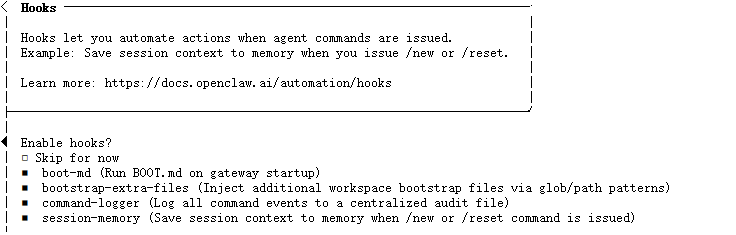

6)配置Hooks

继续下一步,会问你要不要配置hooks。建议都打开。

可以理解为三个插件:

-

boot-md:启动时自动加载一段markdown文本当默认引导内容。常用于把你的规则、偏好、项目背景在每次启动时塞进去。

-

command-logger:把在Clawdbot里执行过的命令和关键操作记一份日志,方便排查问题和复盘。如果比较在意隐私或不想留痕,就别开它。

-

session-memory:保存会话相关的状态或记忆,让它下次能延续上下文,体验会更连贯。

7)选择交互方式

它问你想要用什么方式孵化你的机器人。选择Web UI方式

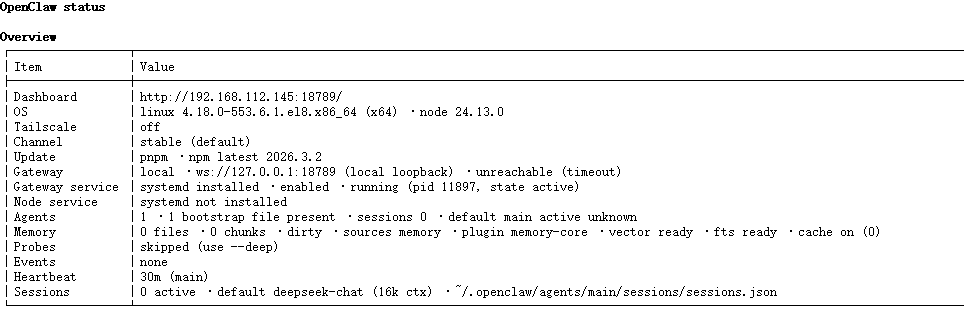

8)配置完成后查看openclaw状态

[root@centos8-tango-01 bin]# openclaw status

4、配置web界面

由于是用centos系统虚拟机安装的,在Windows本地访问时不能打开网页界面,需要修改配置。

1)将bind的配置改为lan

修改~/.openclaw/openclaw.json配置文件,把bind的配置改为lan

vi openclaw.json

"gateway": {

"mode": "local",

"auth": {

"mode": "token",

"token": "***********"

},

"port": 18789,

"bind": "loopback", // 改为lan

"tailscale": {

"mode": "off",

"resetOnExit": false

}

},

保存退出后重启应用

openclaw gateway restart

现在就能在浏览器通过http://你的IP:18789进行访问了。http://192.168.112.145:18789/

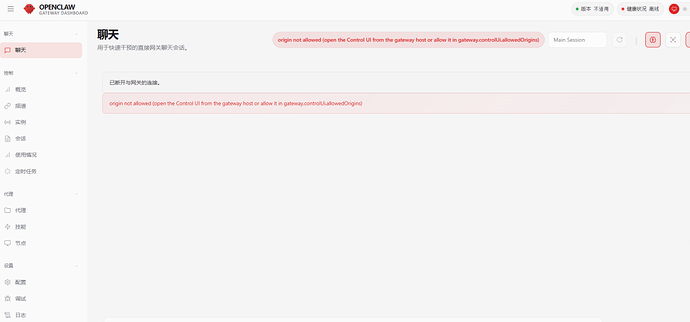

但是提示报错信息:origin not allowed (open the Control UI from the gateway host or allow it in gateway.controlUi.allowedOrigins)

2)OpenClaw 的配置文件添加 gateway.controlUi 部分

在配置文件中找到 gateway.controlUi 部分。如果没有,可以手动添加。

"gateway": {

"port": 18789,

"mode": "local",

"bind": "lan",

"controlUi": {

"allowedOrigins": [

"http://localhost:18789",

"http://127.0.0.1:18789",

"http://192.168.112.145:18789"

]

},

保存文件后,同样需要重启网关服务:openclaw gateway restart

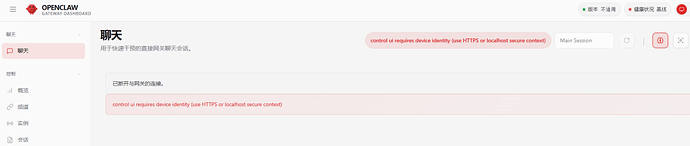

访问报错提示:control ui requires device identity (use HTTPS or localhost secure context)

3)根据提示,带入token访问dashboard

http://192.168.112.145:18789/=xx

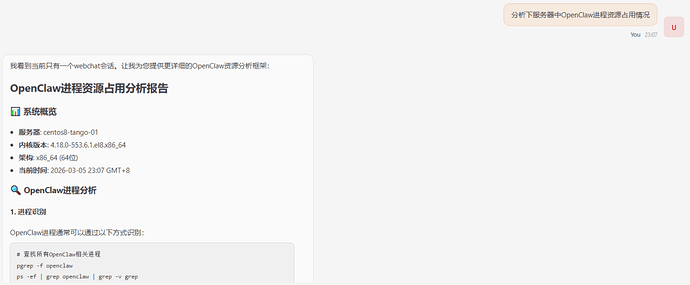

进入界面后,进行交互式提问,可以正常工作。比如“OpenClaw进程资源占用情况”,会给出比较详细的进程资源占用分析报告。

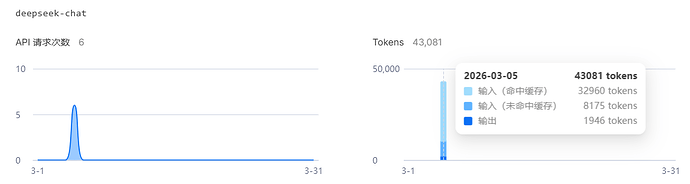

其它如接入钉钉或微信,没有使用场景暂时不做深入研究。不过目前来看OpenClaw是相当消耗大模型的Tokens,上面简单的一个任务已经消耗了4w多个Token数。

5、OpenClaw究竟怎么用

虽然已经部署了OpenClaw,但实际上有哪些使用场景却不是特别的明确,而且OpenClaw潜在的安全隐患,还有Tokens的消耗,都对如何利用这个利器持有保留意见。

1)OpenClaw安全隐患

-

"ClawJacked"漏洞:浏览器成为攻击入口。OpenClaw的网关服务默认监听本地地址,并假设所有来自本地的连接都是可信的,因此完全豁免了速率限制。当用户(特别是开发者)在运行OpenClaw的同时,使用浏览器访问了一个恶意网站,该网站中的脚本就能悄无声息地与本地OpenClaw建立WebSocket连接。由于浏览器并不阻止对本地地址的这种连接,整个行为不会触发任何警告。利用本地连接豁免速率限制的漏洞,攻击脚本可以以每秒数百次的速度暴力破解你的OpenClaw管理密码。一旦成功,系统会自动批准这个来自本地的“新设备”,攻击者便获得了与你同等的管理员权限。攻击者可以指令你的AI代理窃取各类服务的凭证和API密钥、翻阅通信软件的历史记录、从连接受控的设备中盗取文件,甚至在被入侵的节点上执行任意系统命令,实现对整个工作站的完全控制。

-

默认配置权限过宽:OpenClaw为了追求强大的自动化能力,被设计为需要极高的操作系统权限。这种“信任边界模糊”的设计,意味着一旦代理本身被诱导或劫持,它将拥有破坏或泄露你大量敏感数据的入口。

-

第三方插件生态的不可控性:OpenClaw过度依赖于其插件Skills生态,但这些skills有一部分是存在安全漏洞,甚至是恶意的软件。

2)Tokens消耗

在默认情况下,OpenClaw的每次请求都会全量加载所有工具定义、系统提示词和技能摘要,这导致了大量的Token被“浪费”。一个简单的指令就有可能消耗大量的Tokens,对于高频用户或依赖付费API的用户来说,这是一笔不容忽视的开销。

总之,高度复杂的AI系统可能会展现出开发者未曾预料到的“涌现行为”,也就是使用者或者用户无法完全预测一个长期运行的AI代理在特定情况下会做出什么决定,这种不确定性在自动化操作中可能引发难以预料的后果。对用户而言,发出了一个指令或者任务给到OpenClaw,运行一段时间后它给出了一个任务结果,但在这过程中他做了些什么完全是黑盒的,不在你的掌控范围内,这种不可控就会存在着潜在的风险和安全隐患。

参考资料:

-

https://blog.csdn.net/solihawk/article/details/158804994

-

https://blog.csdn.net/qq_31292011/article/details/157899970