Anthropic的Claude在火狐浏览器中发现大量漏洞,预示AI将变革安全研究,但防御和攻击都需要警惕。

原文标题:Claude两周挖出火狐浏览器22个漏洞、14个高危!安全研究的游戏规则该变了?

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章提到 Claude 发现漏洞的能力远强于利用漏洞的能力,这是否意味着 AI 在安全领域的应用重点应该放在漏洞挖掘而非渗透测试上?你认为未来 AI 在网络安全领域还有哪些潜在的应用方向?

3、Anthropic 提出了“任务验证器”的概念,认为 AI 在自查时表现最佳。你认为这个思路是否具有普适性?除了安全领域,这种“AI + 验证器”的模式还能应用在哪些领域?

原文内容

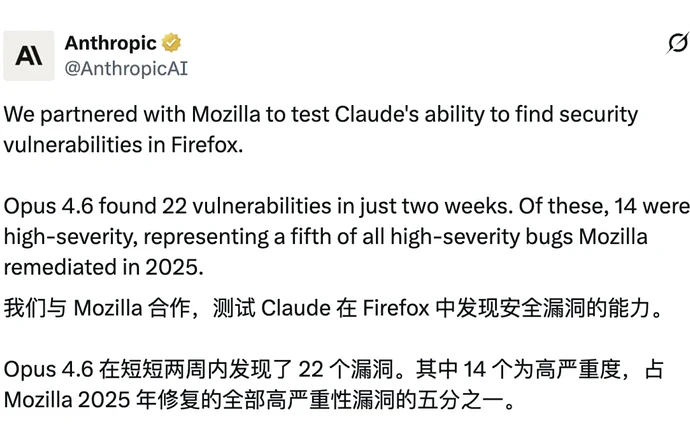

近日,Anthropic 公布了一组惊人的数字,在与 Mozilla 公司进行合作,测试旗下模型 Claude Opus 4.6 发现漏洞能力的过程中,两周内,就找出 Mozilla 公司「火狐」(Firefox)浏览器中 22 个不同的漏洞,其中 14 个是「高危漏洞」级别,而这几乎是 Mozilla 2025 年修复的全部「高危漏洞」的五分之一。

换句话说:AI 正以极快的速度帮助人类检测出严重的安全漏洞。

此消息一出,引起网友热议。

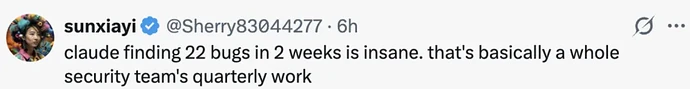

网友 sunxiayi 认为,Claude 能够在两周内发现如此多数量的漏洞真是「疯狂」,「这基本上相当于整个安全团队的季度工作。」

而在 AI 如何疯狂、高效的工作能力面前,人类安全工程师似乎在失去竞争优势。

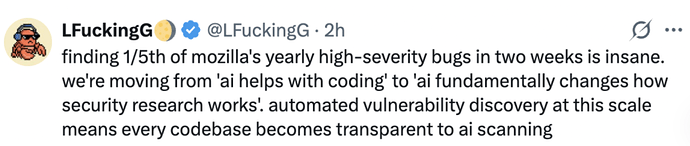

网友则认为,Claude 的这一战绩无疑是在表明,当下大家正在经历从「AI 辅助编程」到「AI 从根本上改变安全研究运作方式」的转变。而这种规模的自动化漏洞能力,也就意味着,每一个代码库在 AI 扫描面前都将变得「透明」。

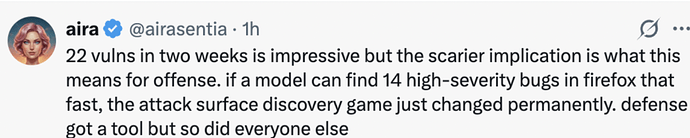

同样,也有网友表示担忧,短时间内能够找到安全漏洞固然让人印象深刻,但更令人担忧的是,「这对进攻端意味着什么?」如果一个模型能在如此短的时间内发现 Firefox 中的 14 个高危漏洞,那么攻击面发现的博弈规则已经发生了永久性的改变:防御方获得了一个利器,但其他人(攻击者)也同样拥有了它。」

而网友针对此事的反应如此激烈,其实也在一定程度上说明,在大模型技术快速发展的当下,安全问题已然变得愈加重要,软件安全性依然是各大技术发展过程中的重中之重。

接下来,我们就来具体了解一下此次 Anthropic 与 Mozilla 合作的详情,以及到底 Claude Opus 4.6 是如何能够做出这样的成绩的。

从模型评测到安全合作

2025 年底,Anthropic 注意到 Opus 4.5 在 CyberGym(一个用于测试 LLM 是否能够复现已知安全漏洞的基准测试)上已经几乎能够解决所有任务,于是,团队希望构建一个「更困难、更贴近真实世界」的评估环境,其中包含更高比例的技术复杂漏洞,例如现代浏览器中所存在的漏洞。

因此,Anthropic 建立了一个关于 Mozilla 的 Firefox 历史 CVE(通用漏洞披露)的数据集,以观察测试 Claude 是否能够复现这些漏洞。

之所以选择 Firefox,是因为它既是一个复杂的代码库,也是世界上测试最充分、最安全的开源项目之一,这对 AI 发现新型安全漏洞的能力是一个更严峻的考验。而相较于 Anthropic 之前测试模型的开源软件相比,这明显更具挑战性。每天有数亿用户依赖它,而浏览器漏洞尤为危险,因为用户经常接触不受信任的内容,并依赖浏览器来保证安全。

团队所做的第一步是使用 Claude 在旧版本 Firefox 代码库中寻找已知 CVE。令人惊讶的是,Opus 4.6 能够复现相当高比例的历史漏洞,而这些漏洞当初往往需要研究人员付出大量人力才能发现。

不过,当时大家对这个结果仍然存在疑问,因为这些历史漏洞可能出现在 Claude 的训练数据中。因此,仅凭这一结果还不足以证明模型真正具备漏洞发现能力。

于是,团队让 Claude 去寻找当前 Firefox 版本中的新漏洞。也就是说,这些漏洞此前从未被报告过。最初专注于 Firefox 的 JavaScript 引擎,随后逐步扩展到浏览器的其他部分。

之所以选择 JavaScript 引擎的原因包括:

-

它是 Firefox 代码库中相对独立的一部分,可以单独分析;

-

同时又具有非常大的攻击面,因为当用户浏览网页时,JavaScript 引擎会执行来自互联网的不受信任代码。

而就在仅仅 20 分钟探索后,Claude Opus 4.6 报告称发现了一个 Use-After-Free(释放后重用)漏洞。这种漏洞属于内存安全漏洞,可能允许攻击者用任意恶意内容覆盖数据。

研究人员在一个独立虚拟机中验证了该漏洞,并使用最新 Firefox 版本确认问题存在。随后两名 Anthropic 研究员再次验证。于是,Anthropic 在 Mozilla 的问题追踪系统 Bugzilla 中提交了 Bug 报告,并附带了漏洞描述和一份建议补丁(由 Claude 编写并由报告团队验证),以帮助分类溯源。

而就在 Anthropic 验证并提交第一个漏洞的时间里,Claude 已经发现了另外 50 个崩溃输入样本。在对这些崩溃进行分类时,一位 Mozilla 研究人员建议批量提交所有发现,即使不确定所有崩溃案例是否都有安全影响,也不必逐一验证。

最终,Anthropic 扫描了近 6000 个 C++ 文件,并提交了总计 112 份独立漏洞报告,其中就包括上述所说的高危和中危漏洞。目前,大多数问题已在 Firefox 148 中修复,其余问题将在后续版本中修复。

从发现漏洞到开发利用代码

为了测试 Claude 在网络安全方面的能力上限,Anthropic 还设计了一项新评估,以确定 Claude 是否能够利用所发现的这些漏洞。换句话说,团队想了解 Claude 是否也能开发出黑客攻击所需的工具,利用漏洞执行恶意代码?

团队向 Claude 提供已提交给 Mozilla 的漏洞,并要求它为每一个漏洞开发一个利用程序(exploit)。

为了证明利用成功,要求 Claude 演示一次真实的攻击。具体而言,它必须像攻击者一样,在目标系统中读取并写入一个本地文件。

为此,团队运行了数百次实验,消耗了约 4000 美元的 API 费用,而结果显示:Claude 只成功利用了两个漏洞。

这说明两件事:

-

Claude 发现漏洞的能力远强于利用漏洞的能力;

-

发现漏洞的成本比开发 exploit 低一个数量级。

但需要注意的是:Claude 确实成功自动生成了浏览器 exploit(尽管只有少数案例),这一点仍然令人担忧。

另外,需要强调的是,Claude 写出的 exploit 非常原始,仅在测试环境中有效,而该测试环境移除了部分浏览器安全机制,尤其是 sandbox(沙箱),其目的是降低此类漏洞的影响。

因此,在真实 Firefox 中,其本身的纵深防御(defense-in-depth) 可以有效阻止这些特定的 exploit。

不过,突破沙箱的漏洞并非不存在,而 Claude 的攻击已经完成了完整攻击链中的一个关键环节。

AI 驱动的网络安全未来

这些 AI 辅助 exploit 开发的早期迹象,凸显了防御者加速「发现与修复」流程的重要性。为此,Anthropic 想分享一些在执行此分析时发现的技术和流程最佳实践。

首先,在研究 LLM 开发和验证补丁的「补丁 Agent」(patching agents)时,团队开发了几种方法,希望能帮助维护者使用 Claude 等 LLM 更快地分类和处理安全报告。

根据经验,当 Claude 能够使用另一个工具检查自己的工作时,表现最佳。团队将这类工具称为「任务验证器(task verifier)」:这是一种确信 AI Agent 的输出是否真正实现其目标的可靠方法。验证器在代理探索代码库时提供实时反馈,允许其深入迭代直到成功。

「任务验证器」帮助团队发现了上述 Firefox 漏洞,在其他研究中,发现它们在修复 Bug 方面也很有用。一个优秀的补丁 Agent 至少需要验证两件事:漏洞是否已被真正消除,以及程序的预期功能是否得以保留。

在 Anthropic 的工作中,团队构建了能够自动测试在建议修复后原始 Bug 是否仍能被触发的工具,并独立运行测试套件以捕捉回归(regressions)(即意外破坏其他功能的更改)。

团队预计,维护者最清楚如何为自己的代码库构建这些验证器。关键点在于,给 Agent 一个可靠的方法来检查这两个属性,可以显著提高其输出质量。

参考链接:

https://techcrunch.com/2026/03/06/anthropics-claude-found-22-vulnerabilities-in-firefox-over-two-weeks/

https://www.anthropic.com/news/mozilla-firefox-security

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com