OpenAI核心人员离职,揭示其战略从技术转向商业落地,Anthropic成人才新选择。AI发展路线面临重塑。

原文标题:GPT-5核心推手闪电跳槽,Anthropic CEO高调炫耀员工留存碾压OpenAI,“AI第一公司”光环崩塌?

原文作者:AI前线

冷月清谈:

怜星夜思:

2、OpenAI拥抱五角大楼的订单,引发了伦理争议。在商业利益和伦理道德之间,AI公司应该如何权衡?

3、Anthropic吸引OpenAI人才,是否意味着AI领域正在出现新的“人才迁徙线”?这种人才流动会对AI行业的格局产生什么影响?

原文内容

在国内科技圈被阿里 Qwen 技术负责人林俊旸离职的消息刷屏时,硅谷的一则人事变动却显得异常安静。

OpenAI 后训练负责人、GPT-5 系列的核心推手 Max Schwarzer 宣布离职,转身加入 Anthropic,回归一线研究员身份。

这一离职时间点尤为微妙。此前 Open AI 与 Anthropic 两家公司正处在对垒态势中,OpenAI 接下了 Anthropic 曾明确回避的五角大楼订单。此消息一出,引起民众强烈反弹,ChatGPT 短期卸载量随之激增 295%。

在商业版图扩张与伦理争议并存的十字路口,作为掌控模型效果的关键人物,Max Schwarzer 在升任研究副总裁仅 7 个月后便选择离开。这本身就是一个强烈的信号:OpenAI 正在全速驶向商业化的未来,或许已不再是纯粹研究者心中的理想之地。

Max Schwarzer 的离开并非孤例。她在离职声明中坦言,许多她欣赏的同僚已身在 Anthropic。

比如 OpenAI 联合创始人、后训练负责人、ChatGPT “对话能力”的缔造者 John Schulman,超级对齐团队负责人、曾试图为超越人类的 AI 建立安全围栏的 Jan Leike,OpenAI 联合创始人、极客型算法科学家 Durk Kingma......

这揭示了一条正在成形的“人才迁徙线”,这些技术领袖正陆续从 OpenAI 位于旧金山 Mission 区的总部撤离,向着更强调“宪法级 AI”与安全研究的 Anthropic 汇聚。

而 Max Schwarzer 在 Anthropic 的新方向是强化学习(RL),这正是她曾主导 GPT-o1 时的核心领域,重在逻辑推理,旨在突破模型的思考上限。这种对“能力边界”的执着,与 OpenAI 当下的产品策略形成了鲜明反差。

回顾近期 GPT-5 系列的迭代路径,一个明显的变化是,OpenAI 的研发重心正在从单纯拓展模型的参数边界转向解决商业落地的“最后一公里”问题。

无论是推理优化、幻觉降低,还是嵌入 Agent 能力与企业级部署,GPT-5 系列的目标都指向了“可控、可靠、可规模化”。这一趋势在最新推出的模型 GPT-5.3 Instant 上尤为明显,该模型致力于体验的优化与情商的提升。显然,一场关乎“用户体验”新一轮竞赛已经悄然打响。

如果将视野拉大,看 OpenAI 近期的一系列动作,从签下五角大楼的政府订单,到将推出取代 GitHub 的代码托管平台,从模型提供商向开发者工具生态扩张,这其实都在讲述同一个故事:

OpenAI 正处于战略转型的关键时期,它要变成一个具有全球影响力、深度嵌入商业与政府体系的 AI 平台型巨头。

从 GPT-4 系列到 GPT-5 系列的迭代,可以清晰看到,Open AI 正在从“让 AI 更聪明”,转向 “让 AI 更值得信任”。

这种转变并非偶然,而是在经历了长达两年的“参数军备竞赛”后,OpenAI 意识到,单纯的模型规模增长正面临边际效应递减的困境。

正如 OpenAI 前首席科学家 Ilya Sutskever 所言:“只靠 Scaling Law 的时代已经结束,我们重新回到了探索与发现的阶段。”

过去模型大一倍,能力上一个台阶;如今模型大十倍,效果提升可能不足 10%。盲目扩参性价比变得极低,而在后训练与推理环节做优化,反而能带来极高的投入回报。

然而,这里存在一个巨大的悖论,既然“后训练”已成为 OpenAI 的新战略高地,为何 Max Schwarzer 等后训练领域的顶级掌舵人,却纷纷选择出走?

这恰恰揭示了 OpenAI 内部对于“后训练”定义的根本性分歧,是“为了真理”,还是“为了产品”。在科学家眼中,后训练本应是通往 AGI 的最后一道安全闸。但在商业化加速的 OpenAI 管理层看来,后训练正在被重新定义为一种“高级客服培训”。

此前,GPT-5.2 版本那种“爹味十足”的说教语气或过度易被触发的安全防御,已经激怒了大量用户,在社交媒体上掀起实质性退订潮。这让 OpenAI 痛切地意识到,糟糕的交互体验正在抵消模型智力的优势。

于是,在最新推出的 GPT-5.3 Instant 中,巨大的算力资源被从“逻辑推理”倾斜到了更务实的“工程修补”上:如何让语气更圆滑?情商更高?对话更流畅?它不再试图成为一个“全知全能的神”,而是努力成为一个“甚至懂你潜台词的人”。

至此,Open AI 后训练的目标,从“防止 AI 毁灭世界”,降维成了“防止 AI 惹上官司”。

OpenAI 的这种商业化转向,也正对应着整个行业评价尺度的重写。

年初,吴恩达提出的“图灵 -AGI 测试”不再关心 AI “会不会解题”,而是看它能否在路径不可控的条件下把一件事真正做完;斯坦福大学的《2026 AI 预测报告》与谷歌云的 ROI 报告,也都直指同一个风向标:别谈模型智力上限,谈企业中的落地效益。

对于企业客户而言,账算得很清楚:一个能考满分但偶尔胡言乱语的天才,远不如一个考 90 分但情绪稳定、逻辑自洽的助手有价值。降低企业的合规风险,这才是企业级落地的关键门槛。

正如苹果从不堆砌硬件参数却能赢得用户一样,OpenAI 也试图通过极致的工程化打磨证明,在商业世界里,“体验决胜”远比“参数堆叠”更能留住客户,这也是其商业化转向的核心逻辑。

OpenAI 的技术转向只是冰山一角,其水面之下潜藏的,是 Sam Altman 在政治与商业的双重布局。

这家诞生于“开源、公益、推动 AGI 造福人类”理想的公司,正在疯狂吞噬算力、数据与资本,其所有动作的核心,都围绕一个关键词“控制权”。

据 The Information 爆料,OpenAI 正秘密研发一款代码托管平台,意图直接取代微软旗下的 GitHub,成为全球新一代代码托管与生成中心。

尽管 OpenAI 的工程师对外宣称,是对 GitHub 近期频繁宕机的不满。但从结果来看,此举更像是争夺软件工业的“底层定义权”。

目前,OpenAI 的 Copilot 不过是挂在 IDE 上的“外挂”,始终依附于微软的开发者生态。而它真正想要的,是让 AI 成为编程的“原生环境”。

开发者在其平台上完成代码托管、生成、调试、部署的全流程,OpenAI 则通过掌控这一闭环,收割最鲜活、最核心的工程数据,构建“数据 - 模型 - 应用”的自循环体系。

Open AI 也完成从 AI 模型提供者向开发者工具生态的扩张。

而更具争议的一步,则是 OpenAI 拥抱五角大楼的政治“投名状”。

2024 年初,OpenAI 更新了其使用政策,删除了此前明确禁止“军事和战争用途”的条款。这一调整并未高调宣布,但被多家媒体注意到。

随后,OpenAI 任命前美国国家安全局(NSA)局长 Paul Nakasone 进入董事会,并成立“安全与保障委员会”。

这些动作被普遍解读为 OpenAI 加深与美国国家安全体系合作的信号。

而在最新“五角大楼订单”事件中,Anthropic 选择坚守“宪法级 AI”的边界,拒绝让其 AI 模型用于大模型国内监控或全自动武器,最终被列为“国家安全供应链风险。而 OpenAI 却很快便与五角大楼达成协议,接受了五角大楼“符合适用法律即可使用”的核心框架。虽然增设三条安全红线,并争取到“云端部署、自主掌控安全栈”的技术防护权,但协议措辞仍为潜在监控留下解释空间。

OpenAI 的接手,不仅是一次商业截胡,更是一次政治站位。这表明 OpenAI 已准备好承担作为“国家级 AI 基础设施”的复杂性。

毕竟,在 2 亿美元的国防预算面前,企业级 SaaS 的收入显得微不足道。能成为美军的供应商,则获得了“大而不能倒”的政治豁免权。

而在最新一轮融资中,OpenAI 融资规模高达 1100 亿美元,堪称 AI 史上最大的一笔融资,OpenAI 投后估值直逼 8400 亿美元,直逼万亿俱乐部。

Open AI 计划拿这笔钱扩大人工智能基础设施建设,堆出一道竞争对手无法翻越的算力高墙。这正是平台经济“网络效应”的极致运用:通过垄断算力、数据等核心资源,形成“用户聚集—资源强化—更多用户涌入”的自我强化循环,最终实现市场垄断,这也是 OpenAI 追求“控制权”的核心逻辑之一。

但在这场看似风光的狂奔背后,悬着一把致命的达摩克利斯之剑,极度疯狂的烧钱速度,与尚未闭环的商业模式,构成了 OpenAI 最大的隐患,

如今的 OpenAI 正深陷政府安全需求、伦理风险、商业利益三方博弈之中。它正在进行一场人类商业史上前所未有的豪赌,在资金链断裂之前,强行跑通商业闭环。

当企业的基因突变,必然引发细胞的代谢。Open AI 的高层震荡,是战略重心转移后的必然分化

随着 ChatGPT 成为拥有数亿用户的超级应用,OpenAI 内部的引力场发生了根本性反转:工程化与产品化开始主导决策,纯粹的研究探索被迫后退。

多位 OpenAI 高管和研究负责人在近几年离职,包括 CTO、后训练负责人、研究负责人。对于像 John Schulman 或 Max Schwarzer 这样的技术原教旨主义者来说,当算力资源开始优先向产品部署而非前沿探索倾斜,当安全团队的权限被商业交付节点挤压,离开便成了唯一选择。

Anthropic 成为了这些“流亡者”的庇护所。那里更像 2019 年之前的 OpenAI:更慢的发布节奏、更严苛的安全审查、对 Scaling Laws 理论更为痴迷。

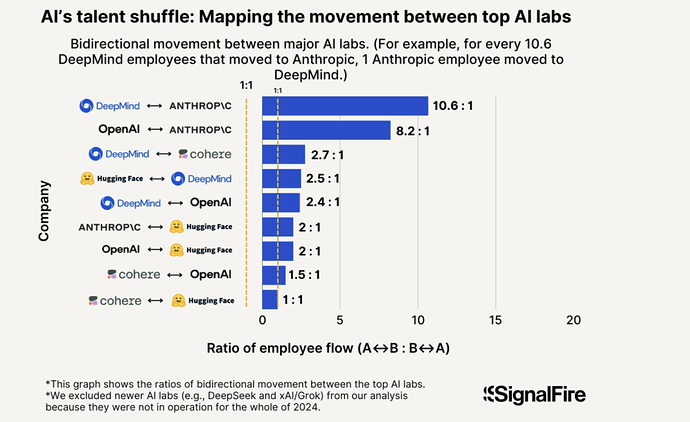

在风险投资公司 SignalFire 最新发布的 2025 人才趋势报告中,Anthropic 顶尖 AI 人才的留存率达到 80%,而且工程师从 OpenAI 跳槽到 Anthropic 的可能性是从 Anthropic 转投 OpenAI 的 8 倍。

而 Anthropic 的首席执行官 Dario Amodei 更是夸耀,自家公司有能力抵御竞争对手“挖墙脚”,他们不会理会竞争对手,如 Meta 花十倍薪水挖角的伎俩,因为大部分员工都会因为“使命”自愿留下。据相关人士透露,在此诱惑下,只有两名员工辞职去了 Meta,其留存率远高于 Open AI。

这种人才迁徙也表明了 OpenAI 正在筛选掉“纯粹研究者”,留下“产品经理”和“工程师”。 它聚集了最优秀的产品化人才,他们擅长将技术变现,打造像 ChatGPT 这样改变世界、体验极致的产品。OpenAI 正在变成 AI 时代的微软。

而 Anthropic 正在吸纳最纯粹的“科学家”和“安全专家”。 它聚集了致力于探索 AGI 理论边界和安全底座的头脑,似乎成为 AI 时代的贝尔实验室。

这不仅仅是两家公司的竞争,更是两条技术路线的赌局。OpenAI 选择了“广度与渗透”,先成为不可或缺的基础设施,赢下市场份额。Anthropic 选择了“深度与边界,赌在未来,赌在安全底座。

OpenAI 近期的“小动作”不断,一边用更少幻觉、更少拒答、更不冒犯的交互把 ChatGPT 打磨成可规模化的“企业级默认入口”,一边又把触角伸向代码托管、政府合同与安全治理,把自己嵌入更硬的生产体系与国家机器。这正在从“模型公司”跨进“基础设施公司”的转变。

而这条路的代价,是信任与文化的再分配:研究者会用脚投票,用户会用卸载表达态度,竞争者会用“更道德”的叙事抢夺心智。

参考链接:

https://x.com/max_a_schwarzer

https://www.theinformation.com/articles/openai-developing-alternative-microsofts-github

https://www.reuters.com/business/openai-is-developing-alternative-microsofts-github-information-reports-2026-03-03/

https://openai.com/zh-Hant/index/gpt-5-3-instant/

声明:本文为 AI 前线整理,不代表平台观点,未经许可禁止转载。