阿里云Coding Plan集齐四大国产模型,助力开发者低成本体验各类AI模型,实现“Token自由”。

原文标题:阿里云 Coding Plan 集齐四大国产模型最强版本,开发者迎来“Token 自由”

原文作者:AI前线

冷月清谈:

怜星夜思:

2、文章提到“Token 自由”,你觉得目前国内大模型Token的收费如何?如果让你来设计一个更合理的收费模式,你会怎么做?

3、阿里云Coding Plan集齐了多家国产模型,你会因为这个原因选择它吗?你更看重AI服务的哪些方面?

原文内容

"我将把工资收入中,排除个人生活必须支出之外的所有收入,都用来购买 token。"一位做 Agent 的朋友最近对我说。

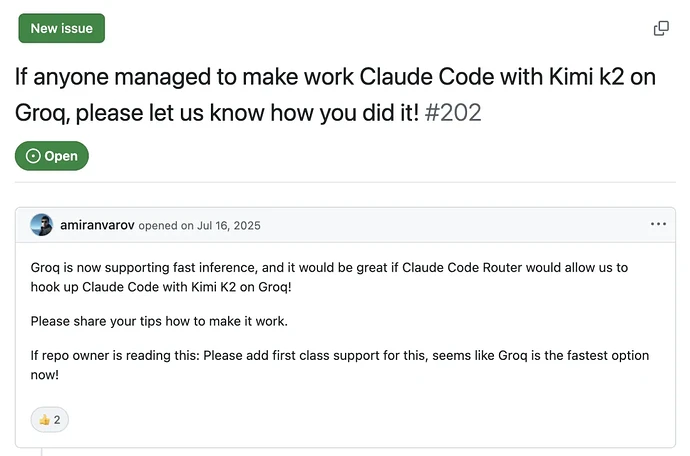

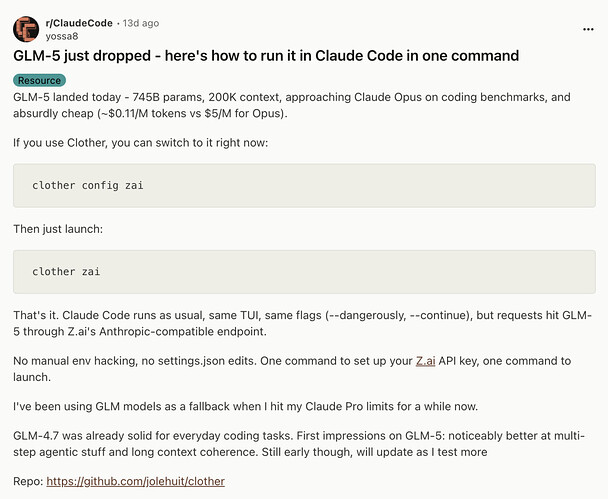

这句话道出了当下对技术热情的开发者的两难处境:想做的东西太多,但 token 实在太贵。这也迫使许多国内外开发者寻找用国产开源模型接入 Claude Code 等编程工具的替代方案。

在此背景下,云厂商的订阅服务成为了一种新的探索方向。

今天,阿里云百炼 Coding Plan 宣布全面上线 Qwen3.5、智谱 GLM-5、MiniMax M2.5、Kimi K2.5,成为 首家集齐千问、GLM、Kimi、MiniMax 四大国产顶尖大模型订阅服务的云厂商。用户订阅后,可在 Qwen Code、Claude Code、Cline、OpenClaw 等主流 AI 工具上无缝切换模型。

在今年 1 月智谱 GLM Coding Plan 限售的情况下,阿里云也成为第一家上线 GLM-5 服务的云厂商。

值得注意的是,在目前国内云厂商中,阿里云是首家在 Coding Plan 中包含自家模型之外,还集齐智谱、Kimi、MiniMax 这些国产开源模型最新、最强版本(GLM-5、MiniMax M2.5、Kimi K2.5)的服务商。

更为关键的是,基于阿里云强大的基础设施,可以直接解决 Coding API 服务不稳定、推理效率低的问题,这是云厂商的天然优势。

阿里云向 InfoQ 透露,为了提供更好的 Coding Plan 用户体验,阿里云在多个工程方面进行了优化。在基础设施层,阿里云不仅提供稳定的弹性资源保障,还通过自研芯片与云服务的紧密结合,显著提升了大模型的推理效率,从而更好地服务于企业和开发者。例如,真武芯片针对主流 MoE 架构模型进行了大量优化,能够满足大规模计算的需求。

这次入驻阿里云 Coding Plan 的四款模型,最近都在技术社区获得了很好的风评。根据 OpenRouter 统计,MiniMax M2.5、Kimi K2.5 和 GLM -5 的 Token 调用量都进入了近期“LLM 排行榜”前 5,Qwen3.5 则在 Hugging Face 公布新一期开源大模型榜单登顶榜首。

值得一提的是,此次推出的 Coding Plan 是阿里云百炼旗下面向个人开发者的服务。

开发者的需求相对明确,但很多时候都没有被主流厂商照顾到。他们既需要便宜的 AI 模型,又希望保留 Claude Code 等工具的强大能力,同时避免重复购买多个国产大模型账号,倾向于“哪个好用用哪个”的灵活策略。

阿里云 Coding Plan 以远低于单独订阅的价格打包提供,对于需要大量消耗 token 的 Agent 场景而言,无疑是一大利好。

此前大众对阿里云百炼的认知更多是"一站式大模型开发与应用平台"——它集成了千问及主流第三方模型,为开发者提供兼容 OpenAI 的 API 及全链路模型服务,同时提供可视化应用构建能力,让业务人员能快速创建智能体、知识库问答等 AI 应用。

而这次,通过 Coding Plan 的性价比套餐,阿里云直接切入了程序员的日常编程场景。

对于阿里云来说,这一计划不仅仅是推出一项服务,更是其在国产 AI 模型生态中的布局。通过引入智谱、MiniMax 等模型公司的旗舰模型,阿里云不仅解决了开发者的成本难题,也通过降低准入门槛,为开发者提供了更丰富的选择。

阿里云正在成为 AI 流量的超级分发站,让不同模型的开发者都能够在其平台上找到最适合自己的工具和服务。

目前,除了阿里云 Coding Plan 上线的 8 款顶尖编程模型之外,阿里云百炼平台还上线了 100 多款国内外主流模型 API 和 400 多个 AI 硬件、短视频及广告内容等领域的 Agent 模板与服务,可满足更多企业场景的模型需求。

对于开发者而言,这意味着更低的成本、更多的选择、更稳定的服务,也更接近"token 自由"。