OpenAI神秘模型破解多道前沿数学难题,预示AI或将革新STEM研究范式,创造新知识。

原文标题:震撼!OpenAI神秘模型连破6道前沿难题,奥特曼:AI在造「新知识」

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、文章提到“AI目前还不能取代数学家”,你认为在未来的数学研究中,AI最有可能扮演什么角色?是辅助工具,还是合作伙伴?

3、文章中提到数学家加入了OpenAI和Google DeepMind,你觉得这对AI发展意味着什么?

原文内容

来源:新智元本文约3700字,建议阅读9分钟OpenAI首席科学家震撼爆料,其神秘内部模型仅凭一周成功攻克了10道未发表顶尖数学难题中的6道。这一名为First Proof的挑战标志着AI已从奥赛选手进化为前沿知识的创造者,奥特曼更直言STEM研究范式将被彻底重塑。

还记得两年前,AI只能磕磕绊绊地解出一道小学奥数题。

今天,读完这篇文章时,你可能会感到一种深入骨髓的战栗。

因为那个曾经蹒跚学步的「孩子」,在刚刚过去的一周里,不仅学会了奔跑,还一脚踢开了人类智力皇冠上最坚固的那扇门——前沿数学研究。

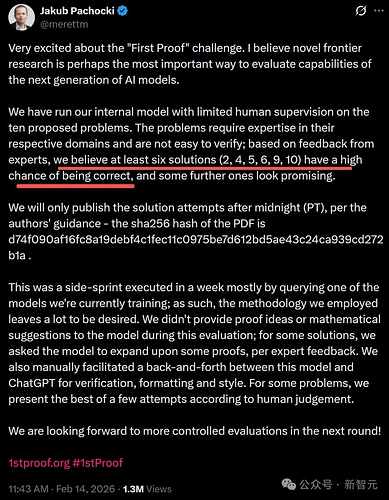

OpenAI首席科学家Jakub Pachocki在X上扔出了一颗重磅炸弹——

「我们用内部模型对10道前沿数学研究题发起挑战,在仅有少量人工监督的情况下,至少6道的解答有很高概率是正确的。」

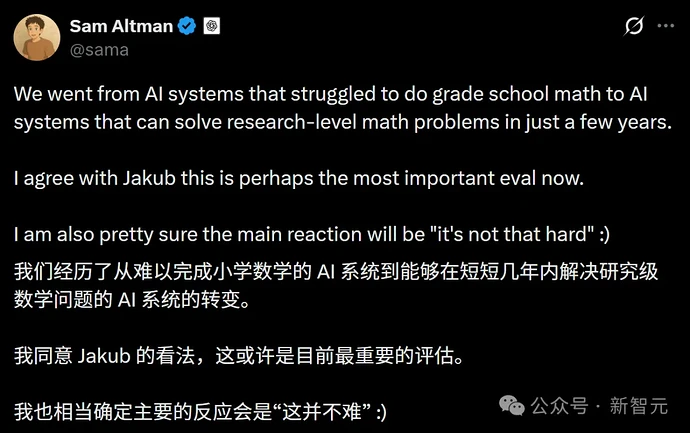

随后,奥特曼亲自转发并感慨:「我们从AI连小学数学都做不好,到AI能解决研究级别的数学问题,只用了短短几年。」

奥特曼以一贯的轻描淡写风格加了一句:「我也相当确定,大家的主要反应会是『也没那么难嘛』。」

嗯,典型的奥式凡尔赛。

奥特曼甚至表示,AI已经有了产生新知识的能力!

OpenAI总裁Brockman也转发表示振奋!

确实,这不是奥数竞赛题,不是考研真题,不是任何已经有标准答案的东西。

这是11位世界顶级数学家刚刚从自己的研究中挖出来、答案从未公开过的前沿问题。

人类专家自己解这些题,每道也需要好几天,甚至更久。

而OpenAI一个还没公开的神秘模型,一周搞定了其中大部分。

这到底是怎么回事?

一场硬核的数学考试

故事要从2月6日说起。

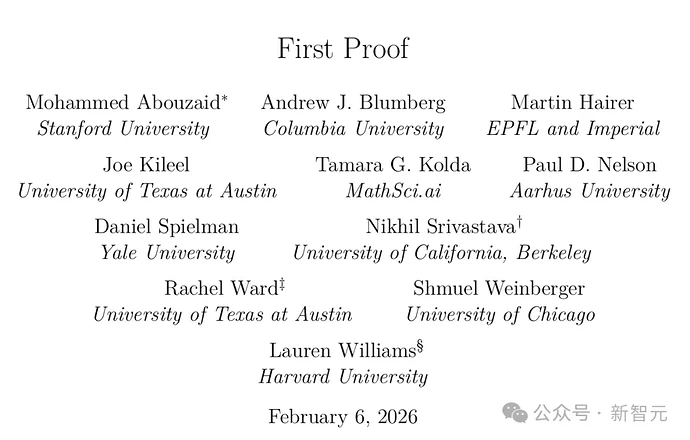

那天,来自斯坦福大学、哥伦比亚大学、哈佛大学、耶鲁大学、洛桑联邦理工学院等顶尖机构的11位数学家,联合发布了一篇名为「First Proof」(首次发酵)的论文。

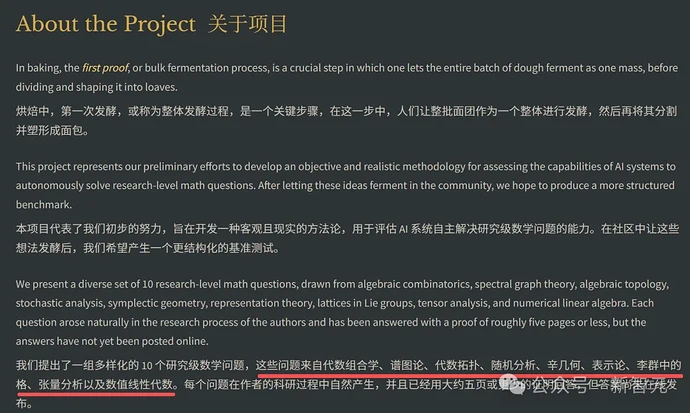

这个名字本身就很有意思——在烘焙中,「first proof」指的是面团的第一次整体发酵,在分割成型之前让它慢慢膨胀。

数学家们把这次实验比作面团发酵:先把问题撒出去,让AI和社区一起「醒发」。

这11位出题人来头可不小。

其中Martin Hairer是2014年菲尔兹奖得主,Daniel Spielman是耶鲁大学的谱图论大牛,Lauren Williams是哈佛大学的代数组合学权威。

Martin Hairer

他们每人贡献了一道(或参与出了一道)从自己正在进行的研究中抽出来的真问题。

这10道题覆盖了数学中极为广泛的领域:代数组合、谱图论、代数拓扑、随机分析、辛几何、表示论、李群中的格、张量分析、数值线性代数。

网站地址:https://1stproof.org/

每一道题的证明长度大约在五页左右——这不是那种需要几百页论文才能搞定的世纪难题,而是数学家在研究过程中遇到的「引理」(lemma),也就是通往更大定理路上的一块关键垫脚石。

换句话说,这是一个优秀研究生可能需要苦苦琢磨一段时间的那种日常级研究任务。

关键是,这些问题的答案从未在互联网上出现过。

没有发表过,没有在任何会议上讲过,没有出现在任何公开场合。

答案被加密后上传到了1stproof.org。

这意味着,AI模型不可能通过检索训练数据来作弊。

数学家们的目标很明确:我们不想再看AI做奥数题了,我们想知道,AI到底能不能做真正的数学研究。

OpenAI的疯狂一周

消息一出,整个AI圈和数学圈都炸了。

斯坦福大学数学教授、First Proof团队成员Mohammed Abouzaid后来坦言:「我们完全没想到会引发这么大的动静,更没想到AI公司会这么认真地投入资源来做这件事。」

其中最引人注目的参赛者,当然是OpenAI。

根据Jakub Pachocki的描述,这并不是OpenAI倾巢出动的大会战,而是一次「Side-sprint」(副业冲刺)。

就像是工程师们在午休时间顺手搞的一个测试。

他们使用的是一个内测模型。

不是GPT-5.2,不知道它是不是GPT-6,还是某种更激进的架构。

这个模型在「有限的人工监督」下工作:OpenAI没有向模型提供数学思路或解题建议,但在某些解答上,根据专家反馈要求模型进行了扩展和补充。

他们还手动安排了这个内部模型与ChatGPT之间的对话,用于验证、排版和风格润色。

对于部分问题,他们从几次尝试中按照人类判断选出了最优解。

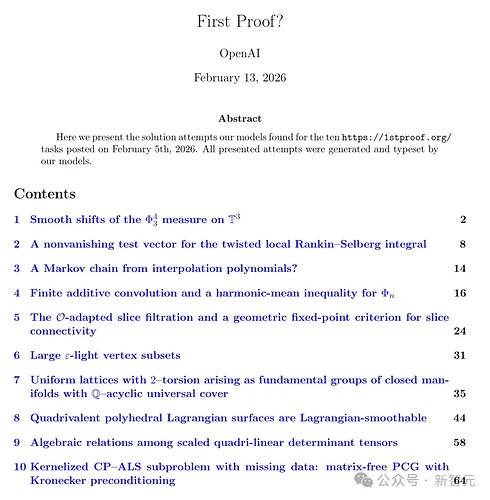

最终,OpenAI在2月13日提交了一份67页的PDF,包含了对全部10道题的解答尝试。

Pachocki自信地宣布:至少6道解答(第2、4、5、6、9、10题)有很高概率是正确的。

文档地址:https://cdn.openai.com/pdf/a430f16e-08c6-49c7-9ed0-ce5368b71d3c/1stproof_oai.pdf

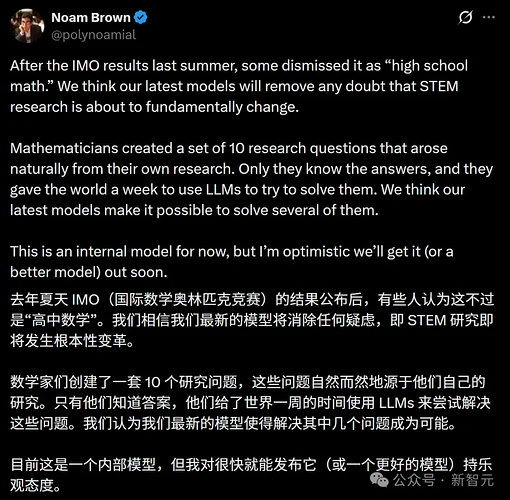

OpenAI的另一位核心研究者Noam Brown也在社交媒体上高调喊话:「去年夏天IMO的结果公布时,有些人不以为然,说那只是高中数学。我们认为我们最新的模型将消除一切怀疑——STEM研究即将发生根本性变革。」

Noam Brown还在文中承诺,他们很快会发布这个新模型。

2月14日,First Proof团队公布了全部10道题的正式答案,并发布了他们自己用公开AI模型(GPT-5.2 Pro和Gemini 3.0 Deepthink)测试这些题目的经验报告。

有趣的是,官方论文中可能出现了一个小错误。

这里应该是2026,不是2025。

不过,这都不重要。

我们来看结论。

结论相当冷峻:在单次尝试的情况下,公开可用的最强AI模型只答对了2道题——第9题(张量代数关系)和第10题(核化CP-ALS子问题)。

而且第9题还存在疑似「数据污染」问题——一个几乎等价的证明已经存在于已有文献中。

第1题也被发现受到了污染,出题人Hairer网站上曾经有一个证明草稿的存档,但即便如此,AI也没能填上其中的关键缺口。

更耐人寻味的是Abouzaid对AI产出风格的评价:「我看到的AI给出的正确解答,有一种19世纪数学的味道。但我们要构建的是21世纪的数学。」

那么OpenAI自称的「6道很可能正确」到底怎么样了?

事态很快出现了戏剧性转折。

论文发布不到一天,数学社区就开始对OpenAI的解答进行逐题审查。

Pachocki自己很快更新了声明,承认第2题(关于扭曲局部Rankin-Selberg积分的非消没检验向量)的解答「很可能不正确」。

社区的独立评审则进一步发现,第5题(关于等变稳定范畴的O-适应切片滤过)和第7题(关于Q-无环万有覆叠的均匀格)的解答也存在严重漏洞。

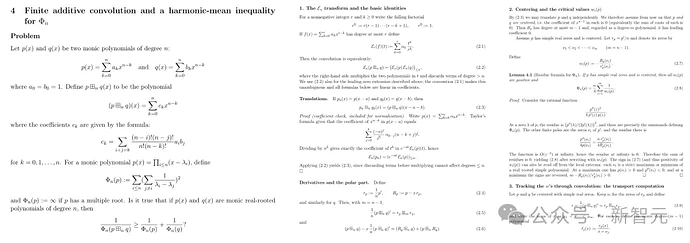

到目前为止,根据《科学美国人》的报道以及社区数学家的独立评判,比较确定正确的是第4题(有限加法卷积的调和平均不等式)、第8题(四价多面体拉格朗日曲面的光滑化)、第9题和第10题。

其余几道仍在审查中,但整体来看,OpenAI的实际命中率很可能低于其最初宣称的六成。

尽管真实成绩可能没有OpenAI宣传的那么辉煌,但我们不应因此低估这件事的历史意义。

哪怕最终确认只有3到4道题被正确解答,这也意味着一个AI,在面对从未见过的、真正前沿的数学研究问题时,能在一周之内独立(或半独立地)给出严格的数学证明。

这在几年前是完全不可想象的事情。

2022年,当时ChatGPT还经常在分数加减法上犯错。

2024年,AI开始能解一些竞赛数学题。

2025年夏天,OpenAI的模型在国际数学奥林匹克上拿到金牌成绩。

而现在——2026年2月——AI正在尝试解答人类数学家正在研究的、从未发表过的原创问题。

从小学算术到前沿研究,这条路走了不到四年。

这个速度,才是真正让人心跳加速的地方。

更值得关注的是那些被AI做对了的题目。

比如第4题,关于有限加法卷积中Φ_n函数的调和平均不等式——这需要一系列精巧的线性代数操作、对双随机矩阵的深刻理解、以及Jensen不等式的巧妙应用。

OpenAI的模型写出了一个自包含的23页证明,逻辑链条完整,最终被专家确认为正确。

一个AI,独立完成了一篇可以发表在数学期刊上的研究级证明。

这不是做题,这就是做研究。

数学家要失业了吗?

至少现在,还不会。

《科学美国人》在报道这次事件时给出的判断很直接:「AI目前还不能取代数学家。」

为什么?

因为数学研究远不止「证明一个已知问题」这一个环节。

真正的数学研究包括:发现值得研究的问题、创造新的概念和定义、构建新的理论框架——然后才是证明。

First Proof测试的只是最后一步,也是最机械化的一步。

而在前面那些需要真正的洞察力、审美判断和开创性想象的环节,AI目前连门都还没摸到。

但奥特曼说的也没错:速度是关键变量。

如果AI从做不了小学数学到能碰前沿研究只用了四年。

那再过四年呢?

有趣的是,一些顶尖数学家已经开始用脚投票。

哥伦比亚大学的数学天才Ashwin Sawhney从学术界休假加入了OpenAI。意大利数学家Pagano则去了Google DeepMind。

他们的理由出奇一致:「很明显这将改变我们做数学的方式,与其以后被动适应,不如趁早参与。」

First Proof团队已经宣布,他们将在3月14日(恰好是π日)发布更多细节和分析,并计划在未来几个月内发布第二批问题——附带更严格的评判标准和更完善的规则。

他们甚至愿意与AI公司签订协议,在问题公开前进行受控测试。

这不是一场考试的结束,而是一个新时代的开始。

数学——这门人类最古老、最纯粹的智力活动——正在第一次面临一个真正的对话伙伴。

这个伙伴有时胡说八道,有时又惊人地深刻。

它会用19世纪的语言说话,但运算速度是21世纪的。

它还不能代替数学家思考,但它已经可以在某些关键节点上为数学家分担工作。

面团还在发酵。

我们已经闻到面包的香味了。

参考资料:

https://x.com/merettm/status/2022517085193277874

https://x.com/polynoamial/status/2022527227049742779

https://x.com/sama/status/2022729068949717182