谷歌发布Gemini 3.1 Pro,推理能力大幅提升,12项基准测试领先。主打真实任务完成,加速AI落地。

原文标题:编码新王登基!Gemini 3.1 Pro 血洗 Claude 与 GPT,12 项基准测试第一!

原文作者:AI前线

冷月清谈:

怜星夜思:

2、文章提到 Gemini 3.1 Pro 开始注重推理能力和真实任务完成率,你认为这对于 AI 技术的未来发展意味着什么?AI 模型的发展方向会因此发生哪些转变?

3、Gemini 3.1 Pro 降低使用成本的同时提升智能水平,你认为这对于 AI 在生产环境中的应用有何影响? 会加速AI在哪些行业的落地?

原文内容

核心能力全面下放,

多端同步上线

在上周发布 Gemini 3 Deep Think 重大更新、面向科学研究与工程领域复杂问题之后,谷歌今日正式推出支撑这些突破的“核心智能”升级版本——Gemini 3.1 Pro。

Gemini 3.1 Pro 是一款采用混合专家架构的 Transformer 模型,这意味着它在生成提示响应时仅激活部分参数。用户可输入包含高达 100 万 token 数据量的提示词,内容不仅涵盖文本,还包括视频等多模态文件。Gemini 3.1 Pro 的响应输出最多包含 6.4 万 token。

这意味着,Gemini 3 系列的最新能力不再只停留在研究层面,而是开始全面进入开发者工具、企业服务以及普通用户的日常应用场景。

根据官方披露,Gemini 3.1 Pro 已于今日开始分批上线,覆盖对象包括开发者、企业客户以及普通消费者:

-

开发者:可通过 Gemini API(Google AI Studio)、Gemini CLI、智能体开发平台 Google Antigravity 以及 Android Studio 预览使用;

-

企业用户:通过 Vertex AI 和 Gemini Enterprise 接入;

-

消费者:可在 Gemini App 及 NotebookLM 中直接体验。

谷歌方面表示,此次“全线铺开”的策略,旨在将最新一代推理能力快速融入实际工作流与个人使用场景,而不仅仅停留在实验室或演示阶段。

推理表现翻倍、

12 项基测排名第一

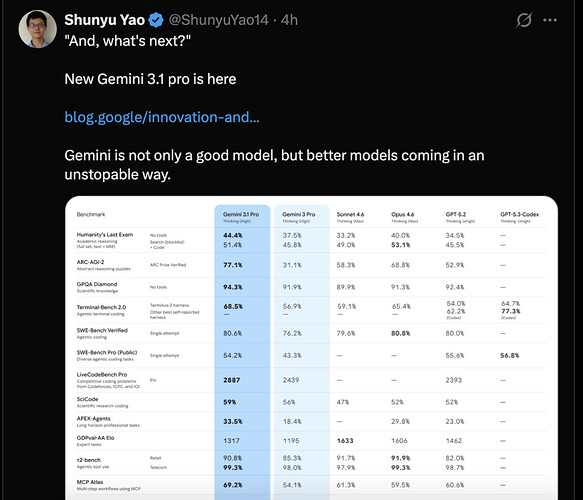

从技术定位来看,Gemini 3.1 Pro 并非简单的性能微调,而是一次 核心推理能力(core reasoning)的系统性升级。官方将其描述为“更聪明、更具能力的基础模型”,尤其适用于复杂问题求解、跨领域分析以及需要抽象逻辑的任务。

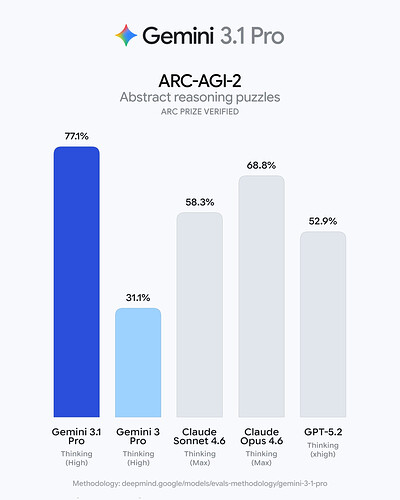

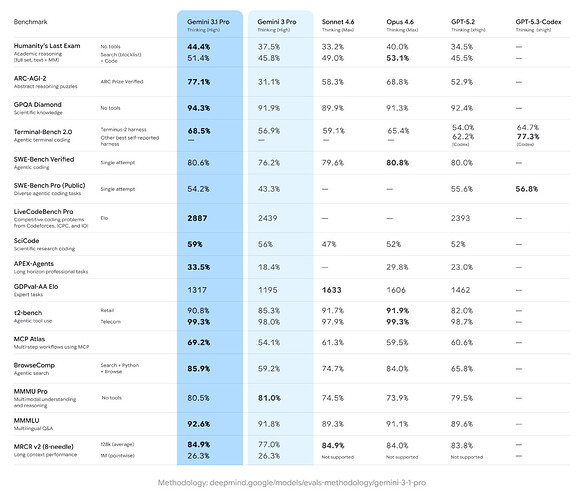

这一进步也体现在权威评测成绩上。在 ARC-AGI-2 基准测试中,Gemini 3.1 Pro 获得了 77.1% 的经验证成绩。该测试专门用于评估模型在从未见过的新逻辑模式下的泛化与推理能力。它包含多个视觉谜题,每个谜题均由一系列图形组成。构成谜题的图形在设计上各不相同,但都遵循特定规律。大语言模型必须推断出该规律,并利用其生成新的图形。

这一分数 是 Gemini 3 Pro 推理表现的两倍以上。在当前大模型竞争格局中,ARC-AGI 系列被视为衡量“类通用智能推理能力”的重要指标之一,这一成绩也意味着 Gemini 3.1 Pro 在抽象推理与新问题适应能力上迈出了关键一步。

值得注意的是,人类参与者在该测试中的平均正确率约为 60%。前阵子发布的 Gemini Deep Think 以 84.6% 的准确率遥遥领先其他模型。

虽然 Gemini 3.1 Pro 在得分上低于 Gemini Deep Think,但这是一款基础模型,并且它向所有用户免费开放。而具备“深度思考”能力的 Deep Think 模式属于更高维度的技术突破,目前仅限 Google AI Ultra 订阅用户使用,且每日限用 10 次。

能让开发者免费体验能力如此强的 Gemini 3.1 Pro,谷歌已经很大方了。

再来横向比较下 Gemini 3.1 Pro 与其他模型:Claude Opus 4.6 达到 68.8%,Claude Sonnet 4.6 为 58.3%,GPT-5.2 获得 52.9%,而上一代产品 Gemini 3 Pro 仅得到 31.1%。短短三个月时间,同一系列模型的闭卷推理能力就从 31.1% 跃升至 77.1%,实现了翻倍以上的跨越式提升。

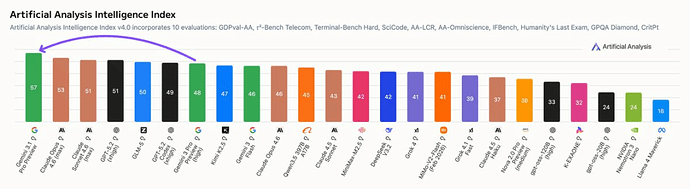

谷歌官方公布了 16 项基准测试数据,Gemini 3 Pro 在其中 12 项基测中均位列第一。

在评估 AI 模型使用第三方服务执行任务能力的 MCP Atlas 测试中,Gemini 3 Pro 以 69.2% 的成绩领先于最近刚发布的 Claude Sonnet 4.6,在编程测试 Terminal-Bench 2.0 中,Gemini 3 Pro 编码能力高于 Opus 4.6、GPT-5.2。在另一项包含科学编程任务的代码基准测试 SciCode 上,该模型的表现比 Claude Opus 4.6 高出 7%。

从发布节奏来看,谷歌正在尝试将前沿研究成果更快转化为“默认可用”的基础能力。先通过 Deep Think 展示在科学与工程问题上的上限,再通过 3.1 Pro 将这些能力沉淀为更稳定、更通用的底座模型,并迅速推向 API、企业平台和消费级应用。

Gemini 3.1 Pro 面向那些“给出一个简单答案远远不够”的任务而设计,它将高级推理能力转化为可用于解决最棘手问题的实用智能。升级后的智能水平能够在多种现实场景中发挥作用——无论是将复杂主题以清晰、直观的方式呈现出来,还是把分散的数据综合成一个统一视图,亦或是推动一个富有创造力的项目从构想走向落地。

为了说明其潜在用途,Gemini 团队指出,该模型可以创建可用于网站的 SVG 动画,还可以将小说的文学风格转化为个人作品集网站的设计。

基于代码的动画生成:Gemini 3.1 Pro 可以直接根据文本提示生成可直接用于网站的动态 SVG 动画。由于这些动画完全由代码构建,而非像素渲染,因此在任何缩放比例下都能保持清晰锐利,同时相比传统视频格式,文件体积小得多,极大降低了加载和分发成本。

复杂系统综合: 利用先进的推理能力,弥合了复杂 API 与用户友好型设计之间的鸿沟。在这一示例中,模型构建了一个实时航天仪表盘,成功配置并接入了一条公共遥测数据流,用于可视化 International Space Station 的轨道运行情况。

交互式设计:Gemini 3.1 Pro 能够编写复杂的 3D 椋鸟群舞(murmuration) 模拟代码。它不仅生成视觉层面的代码,还构建了一个沉浸式体验:用户可以通过手部追踪来操控鸟群,同时聆听一段会随着鸟群运动而动态变化的生成式配乐。对于研究人员和设计师而言,这为原型化 多感官、强交互 的界面提供了一种极具潜力的方式。

创意编程:3.1 Pro 能够将文学主题转化为功能性代码。当被要求为艾米莉·勃朗特的《呼啸山庄》构建一个现代个人作品集网站时,该模型不仅概括了文本内容,更通过推理小说中的阴郁基调,设计出时尚的当代界面,最终创建出能捕捉主角神韵的网站。

自去年 11 月推出 Gemini 3 Pro 以来,用户反馈和技术进步共同推动了这一系列快速迭代。今天发布的 3.1 Pro 预览版旨在验证这些更新成果,并将在全面上线前继续在智能体工作流等前沿领域进行深度优化。

即日起,Gemini 应用中的 3.1 Pro 版本将向 Google AI Pro 和 Ultra 套餐用户逐步开放,提供更优使用权限。3.1 Pro 现已独家登陆 NotebookLM 平台,面向 Pro 及 Ultra 用户开放。开发者和企业用户可通过 AI Studio、Antigravity、Vertex AI、Gemini Enterprise、Gemini CLI 及 Android Studio 等渠道,在 Gemini API 中抢先体验 3.1 Pro 预览版。

去年 9 月加盟谷歌 DeepMind 的清华物理系知名研究者姚顺宇(Shunyu Yao)在 x 上发帖称,更强的模型也将很快亮相。

在公司 2025 年第四季度收益报告中,首席执行官 Sundar Pichai 表示:“我们的第一方模型,如 Gemini,现在通过客户直接使用 API,每分钟处理超过 100 亿个 token,Gemini App 的月活跃用户已增长到超过 7.5 亿。”

随着 Gemini 3.1 Pro 正式上线,围绕这次更新的讨论迅速在技术社区中展开。与以往大模型发布时对“参数规模”“模型体量”的高度关注不同,不少网友认为,这一版本释放出的关键信号,并不在于“更大”,而在于整体推理能力和复杂问题求解能力的持续上推。

有开发者指出,Gemini 3.1 Pro 的定位非常明确:不再单纯追求模型规模的扩张,而是更强调在真实任务中的完成度和稳定性。这也被视为当前头部大模型竞争的一个重要转折点——竞争焦点正在从“谁的参数更多”,转向“谁能把问题真正做完、做好”。

在 x 上,该开发者表示:

“Gemini 3.1 Pro 上线了,重点不是更大,而是把整体推理和复杂问题求解能力继续往上推。这波信号很明确:头部模型竞争正在从参数规模,转向真实任务完成率。”

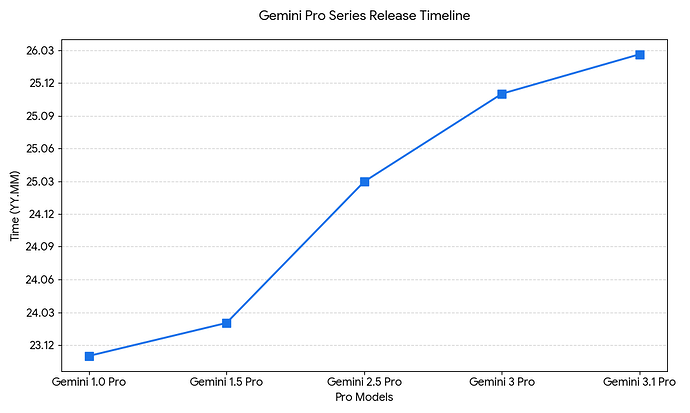

与此同时,还有网友系统梳理了谷歌近年来模型更新的时间线,直言人工智能的发展节奏已经进入“以月甚至以周计”的阶段。在这样的背景下,谷歌已难以承受过长的更新间隔。

Gemini 3.1 专业版在较短时间内推出,被解读为谷歌对这一现实压力的直接回应:必须持续、快速地将核心能力推向市场。

成本与落地能力同样成为讨论的焦点。有网友特别提到,Gemini 3.1 Pro 在降低使用成本的同时提升智能水平,这种优化路径对于推动 AI 在生产环境中的应用尤为关键。在他们看来,人工智能的前沿价值并不仅体现在基准测试成绩上,更体现在这些能力能否被开发者社区轻松获取、快速部署,并稳定运行于真实业务中。

综合这些反馈可以看出,Gemini 3.1 Pro 的发布,已经不只是一次常规的模型升级,而更像是一次方向性的表态:在大模型逐渐走向成熟的阶段,真正决定胜负的,将是推理能力、工程可用性以及规模化落地的综合表现。

参考链接:

https://blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-pro/

https://www.ai.jp.net/article/google-s-gemini-3-1-pro-a-new-reasoning-champion-c710f5

https://x.com/ShunyuYao14

https://deepmind.google/models/gemini/pro/