清华团队发布HuMI系统,让人形机器人摆脱对真机依赖,通过便携设备高效学习全身操作技能,求婚、拔剑出鞘都不在话下!

原文标题:情人节暴击!下跪求婚的可以是机器人了

原文作者:机器之心

冷月清谈:

怜星夜思:

2、HuMI系统采用了分层控制策略,高层负责规划,底层负责控制。你觉得这种分层结构对于复杂机器人控制来说,还有哪些好处?

3、文章提到HuMI系统在未见过的场景和物体上仍能保持较高的任务成功率,这主要归功于数据采集规模和多样性。你认为在机器人学习中,数据规模和多样性哪个更重要?为什么?

原文内容

这个情人节,Unitree G1 人形机器人解锁了 “求婚” 新技能。

在人类眼中充满仪式感的求婚动作,对于机器人来说其实是颇具难度的全身操作任务:既要维持重心稳定,又要保证手部动作的精准,这对机器人的全身协调能力提出了不小的考验。

这一浪漫场景的背后,是清华叉院、上海期智研究院、千寻智能与上海交通大学联合团队的最新研究成果 —— HuMI (Humanoid Manipulation Interface) ,一个集成了人形机器人便携式数据采集与多样化技能学习的通用框架:研究人员不再受困于繁琐的遥操作或昂贵的动捕环境,只需佩戴简单的追踪设备,就能高效教会人形机器人协调全身,完成复杂的操作任务 。

-

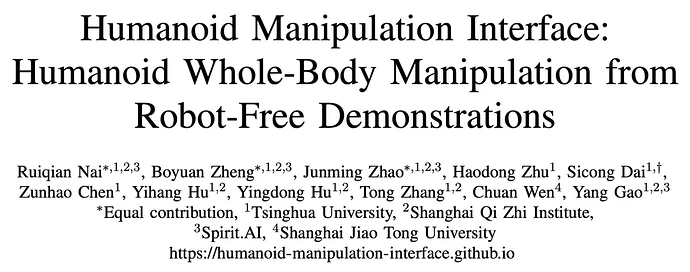

论文标题:Humanoid Manipulation Interface: Humanoid Whole-Body Manipulation from Robot-Free Demonstrations

-

论文链接:http://arxiv.org/abs/2602.06643

-

项目主页:https://humanoid-manipulation-interface.github.io

教人形机器人学会全身操作,难在哪里?

尽管遥操作是目前获取数据的主流方案,但其采集效率低下,对操作员的经验要求也较高;同时,由于无法脱离实体机器人,采集场景往往局限于实验室内部,难以获取支撑泛化的多样性数据。

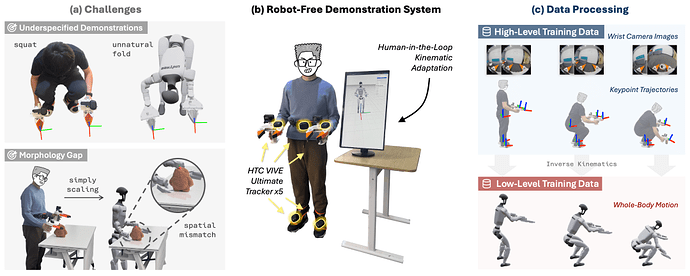

相比之下,虽然 UMI 的 “无真机” 数采方案在机械臂上大获成功,但直接迁移到人形机器人时却面临如下难题:

-

演示信息缺失:仅记录手持夹爪部轨迹无法约束全身姿态,机器人不知道向下抓取时该 “弯腰” 还是 “下蹲”;

-

人机构型差异:人与机器人的身体比例不同,简单的尺寸缩放会导致机器人与交互物体的空间错位;

-

执行误差干扰:与机械臂的高精度不同,人形机器人的底层控制器往往存在较大的跟踪误差,导致高层策略规划的轨迹与实际执行脱节。

HuMI 系统的核心技术

针对人形机器人数据采集难、效率低的痛点,团队提出了 HuMI 系统。该系统通过硬件、交互与算法的协同设计,实现了低成本、高效率的人形机器人全身操作策略学习。

1. 硬件设计:便携式穿戴设备

采集数据时,操作员仅需手持两个带有鱼眼 GoPro 相机的 UMI 手柄,并在手柄上、腰部和双脚佩戴 5 个 HTC Ultimate VIVE 追踪器。有了这套便携的设备,无需将笨重的实体机器人搬运到现场,即可在楼道、大堂等各种环境中采集全身动作数据,极大降低了数据获取的门槛。

2. 数据采集:实时逆运动学预览

为了解决人机身体构型差异导致的动作不可用问题,HuMI 提供了实时逆运动学(IK)预览。采集数据时,操作员可以通过屏幕观察虚拟机器人做出对应动作的效果。如果人的动作超出了机器人的物理极限,操作员能立刻发现并调整姿态,从而确保采集到的数据物理可行。此外,重定向后的全身数据也会进一步用于底层控制器的训练。

3. 算法架构:分层控制策略

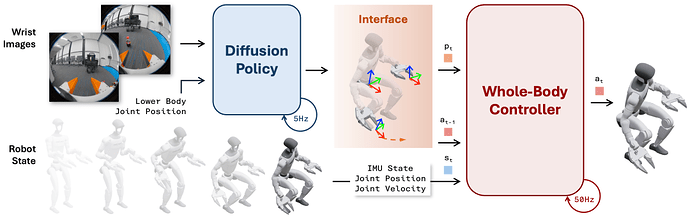

HuMI 采用高低层协同的分层式控制架构,通过精心设计的接口层将规划与控制模块有机串联,共同完成复杂的全身操作任务:

-

高层规划策略:基于 Diffusion Policy,利用手腕相机的视觉输入规划全身关键点轨迹;

-

底层控制策略:通过强化学习训练。在训练阶段,HuMI 设计了自适应的手部跟踪奖励,并引入了变速增强训练,使机器人能同时兼顾全身的协调平衡与手部的精准操作。

实验表现:多维任务验证

团队在 Unitree G1 人形机器人上进行了多方面测试,从任务能力、泛化表现和采集效率三个维度验证了系统的有效性:

1. 任务能力:HuMI 成功实现了五项颇具挑战性的全身操作任务:求婚(单膝下跪)、拔剑出鞘、投掷玩具、上前清理桌面以及下蹲拾取,展现了双臂协同、高动态、长距离移动操作等多方面能力,且均达到了 75% 以上的成功率。实验证明,机器人能够流畅地完成大幅度重心转移和精细的手部动作,保持了极高的平衡稳定性和动作连贯性。

2. 泛化表现:凭借便携硬件随时随地采集数据的优势,HuMI 能够轻松覆盖各种真实场景,为策略的泛化性打下了坚实基础。在下蹲拾取这一任务上的实验结果显示,机器人在会议室、电梯间、走廊等未见过的场景,面对未见过的瓶状物体时,仍能保持 70% 的任务成功率。上述实验表明,得益于便携式设备带来的数据采集规模与多样性,策略在复杂环境下具有出色的泛化能力。

3. 采集效率:与传统遥操作模式相比,HuMI 在数据收集效率上展现出显著优势。由于摆脱了对机器人真机的依赖,系统的数据采集吞吐量提升至传统方式的 3 倍 —— 以拔剑任务为例,仅需 15 分钟即可快速收集 60 条有效演示数据。此外,HuMI 还扩展了动作采集的边界:在遥操作中,若底层控制器不支持单膝下跪等高难度动作,操作员便无法进行数据采集;而 HuMI 则能够摆脱真机限制,先行采集这类复杂动作。

HuMI 的核心价值在于打破了数据采集对机器人实体的依赖。通过全新的数据采集方式,HuMI 大幅降低了人形机器人数据的获取门槛与成本,在显著提升学习效率的同时,也为开发更具泛化性的通用人形机器人技能提供了有力支持。

关于作者

该项目有三位共同一作:佴瑞乾,郑博远,赵俊铭。

佴瑞乾是清华大学交叉信息研究院的四年级博士生,导师为高阳教授。他的主要研究方向为具身智能,致力于通过大规模数据使机器人能够感知、推理和学习。佴瑞乾已在 ICLR, ICRA, AAAI, NeurIPS 等多个机器人学和机器学习顶会发表论文,研究项目涵盖人形机器人,VLA,四足机器人等多个方向。

郑博远是清华大学交叉信息研究院的一年级博士生,导师为高阳教授。他的主要研究方向为具身智能,目前专注于通过人形机器人的全身协同控制,实现复杂多样的移动操作任务。郑博远已在 CoRL、ICLR 等多个机器人学和机器学习顶会发表论文。

赵俊铭是清华大学交叉信息院(IIIS)的一年级博士生,导师为高阳教授。他的研究聚焦于具身智能,致力于赋予机器人更通用和鲁棒的操作能力。他重点关注机器人操作数据的高效扩展及人形机器人的移动操作。此前的工作包括高效泛化的插入装配模型,以及融合自适应推理的 VLA 模型等。

项目的通讯作者是清华大学交叉信息研究院助理教授、千寻智能联合创始人高阳,他主要研究计算机视觉与机器人学。此前,他在美国加州大学伯克利分校获得博士学位,师从 Trevor Darrell 教授。他还在加州伯克利大学与 Pieter Abbeel 等人合作完成了博士后工作。在此之前,高阳从清华大学计算机系毕业,与朱军教授在贝叶斯推理方面开展了研究工作。他在 2011-2012 年在谷歌研究院进行了自然语言处理相关的研究工作、2016 年在谷歌自动驾驶部门 Waymo 的相机感知团队工作,在 2018 年与 Vladlen Koltun 博士在英特尔研究院在端到端自动驾驶方面进行了研究工作。高阳在人工智能顶级会议 NeurIPS,ICML,CVPR,ECCV,ICLR 等发表过多篇学术论文,谷歌学术引用量超过 5000 次。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com