Teamily AI推出全球首个AI原生社交平台,探索人机共生社交新模式,AI不再是工具,而是群体中的一员,增强人类连接与协作。

原文标题:全球首个AI原生社交平台「Teamily AI」硅谷亮相,开启「人机共生」社交新元年

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章中提到 Teamily AI 针对家庭、朋友、社区和同事设计了不同的应用场景。你认为哪个场景最有可能率先普及?为什么?

3、Teamily AI 强调保护用户隐私,设计了多重安全防线。你认为这些措施真的能有效防止隐私泄露吗?在实际使用中,你还有哪些隐私方面的担忧?

原文内容

大家是否察觉到,2026 年伊始,AI 的进化逻辑正发生微妙转向。

从国内风头正劲的元宝派,到硅谷讨论热度居高不下的 OpenClaw、Moltbook,再到 AI 初创公司 Humans & 打造的社交智能融资额接近 5 亿美元,以及刚刚发生的,定位为「The Simulation Company」的 Simile 推出其 AI 模拟平台做社会模拟,并获得 1 亿美元融资,投资人包括美国顶级基金及斯坦福李飞飞教授等。

似乎业界已不再满足于仅仅将 AI 作为一个单独的工具,而是开始探索:当 AI 开始走进人类的真实交互场景中,与人类产生各种各样的互动时,会发生什么?

基于此,一场围绕人与 AI 的社交新叙事,正悄然铺开……

最近,机器之心留意到这类玩家中一个颇具代表性的产品。

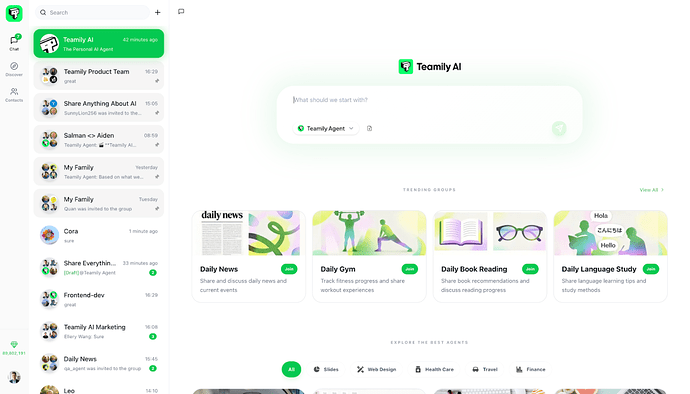

从视频中可以看到,一群朋友在群里聊天,从当前的热映影片聊到各自最喜欢的电影,气氛轻松、自然。而就在话题逐渐升温时,一个 AI 智能体适时、主动「加入」到群聊中,并根据聊天内容的上下文主动推荐了相关视频片段与背景音乐,直接嵌入到聊天界面中。另一边,朋友们还在继续讨论,并可以边聊天边观看视频内容、收听音乐。

整个过程,AI 智能体并没有被刻意唤醒,也没有通过复杂的指令触发,它就这么「丝滑」地融入到聊天中……

这就是初创公司 Teamily AI 最新推出的全球首个 AI 原生即时通讯应用(IM)——Teamily AI,意图构建一个人类与 AI 智能体共生的社交网络。在这个网络中,AI 不再是一个外部工具,而是群体中的一员,人类与 AI 智能体互相协作、实时共存、互动。

AI 下一站不是更强模型,而是更强协作

过去两年多,国内外围绕大模型的竞赛几乎都是线性的:更快、更强、更逼真…… 从 ChatGPT 到 Sora,再到 Claude,大模型技术的每一次飞跃,都是在不断放大人类个体能力,甚至朝着把人类变成「超级个体」的方向演进,一个人甚至可以完成过去需要一个团队才能完成的工作。但对于团队协作来说,会议依旧低效、群聊依旧混乱、信息依旧分散…… 可以说 AI 确实在让个人变强,却并没有让「群体」变聪明。

Teamily AI 想解决的,正是这个被忽视的问题。在 Teamily AI 看来,AI 的下一个阶段,不是继续增强单个个体的能力,而是增强「关系」。也就是说,群体智能才是未来,帮助群体连接、协作、创造。

当然,前面也说到,业界也开始意识到这一趋势,开始有各种各样的玩法。

目前看来,在现有探索路径中,大概有这么几种不同方向。有些是在已有的社交 / 办公工具上做加法,叠加 AI 大模型能力,属于「社交 / 工具 + AI」的延伸思路,本质仍是工具增强。或者是像 OpenClaw、Moltbook 那样,更激进地将人类「排除」在外,构建以 AI 智能体自己为主体的群体网络,甚至反过来「雇佣」人类,等等。

但 Teamily AI 并不这样认为。

他们坚持 AI-Native 的思考方式,在新型的 AI 社交关系中,AI 首先不是一个孤立的聊天机器人,而是一个可以存在于群聊中的「成员」,AI 与人类在同一个群聊中实时互动,是「协作」的一部分,而非外部工具。总结来说,在这种关系中,人与 AI 组成一种「共生」结构。

在这种设想下,Teamily AI 意识到,即时通讯应用(IM)是承载这一结构的最佳归属地,形成自然的人类 —AI 协作形式。因为群聊本身就是高频协作发生的空间,是信息自然流动的载体,而 AI 要成为「成员」之一,就必须进入对话里,而不是悬浮在界面之外。

四大场景全域伴随,三层架构筑起技术护城河

具体来看,Teamily AI 的独特性在于,其基本交互单元是「人类 + Agent」,解决的不再是个体的效率问题,而是团队的协作效率,平台上多智能体调度设置的目的,是回归人类的诉求 —— 人类如何连接、协作、共创。

为此,Teamily AI 主打「全域伴随」,从个人到群体,覆盖家庭、朋友、社区和同事四大核心场景。

家庭:对于孩子来说,睡前故事往往是必不可少的,但有时候父母可能并不清楚孩子想听什么故事,而且也没有那么多的时间和精力去重新创作,而在 Teamily AI 中,父母可以和孩子一起在群里描述想听的故事,之后智能体就会根据大家的描述,创作出带有精美插图的故事。不仅如此,Teamily AI 还会记住之前的故事,从而在接下来的每一晚,讲述的故事新章节都会延续之前的角色和世界观,让这个故事变成了专属于他们的独家记忆。

朋友:朋友间的聊天往往是五花八门,就像前面例子中的电影分享一样,可能上一秒在聊电影,下一秒就会有朋友分享了一张在路上的跑车照片,大家会畅想自己开着这辆车的样子。而在 Teamily AI 中,AI 完全能够做到这一点,大家可以轮流向它提要求:修改车牌、把自己换到驾驶座、给旁边加个朋友等,它甚至能够理解每个人的风格和语境,让大家在创意上相互碰撞……

社区:如果你是一个 AI 爱好者社区,那么可以在 Teamily AI 上找到一个热衷于学习 AI 的社区。有人分享了新的 YouTube 视频、推文或 arXiv 论文时,AI 会分析视频和论文,为小组提炼核心摘要,而小组成员可以随着接着提问、分享见解,不管是多么深奥的科研课题,多么密集的科研材料,它够能将其变成一种简单易懂的内容,并让大家感受到协作式的学习体验。

同事:在工作场合中,团队之间的协作需要更为旺盛,尤其是在人多的群里,很多消息和重要往往会淹没在浩如烟海的群聊记录中,即便当前能够借助一些 AI 工具,但过载的内容也尝尝让 AI「罢工」。而在 Teamily AI 中,AI 能够根据聊天内容上下文,完成不同同事交待的 PRD(产品需求文档)撰写工作,且过程流畅、准确、高效,再多的消息与人物,也不会让 AI 感到混乱。更重要的是,进行这些的操作不需要任何前提,即便是没有技术背景的「小白」。

强大玩法背后,是有着坚实的技术护城河。

这一优势,得益于其顶尖的创始团队背景。Teamily AI 由何朝阳(Aiden Chaoyang He)和 Salman Avestimehr 共同创立。

何朝阳,博士毕业于南加州大学(USC)计算机科学系,研究重点为分布式机器学习以及大型基础模型(LLM、ViT)的高效训练与服务部署。投身创业前,他曾任腾讯研发团队经理、首席软件工程师,并在百度、Google、Facebook 等头部大厂积累了丰富的大规模产品研发经验 。

而这些在复杂工程和分布式架构上的理论与实战积累,如今直接转化为了 Teamily AI 支撑复杂多智能体网络调度的底层架构。

Salman Avestimehr,美国工程院院士、USC 院长教授,他在机器学习、信息论、安全与隐私保护等领域拥有超过 20 年的研发领导经验,并在 Amazon/Alexa-AI 等多家科技公司担任顾问 。

正是他在安全隐私和分布式计算领域的开创性工作,为 Teamily AI 构建跨群组的「记忆边界」和数据保护系统提供了强有力的理论与实践经验。

技术实现:如何破解多人群聊的底层挑战?

在多人群聊中,话题往往高度跳跃,且混杂着视频、链接、语音等多种模态。在处理这些复杂信息的同时,还要兼顾隐私保护与成本控制,这对系统设计提出了极大的挑战。Teamily AI 是如何通过底层技术解决这些难题的?

1.AI 如何做到「乱中有序」?

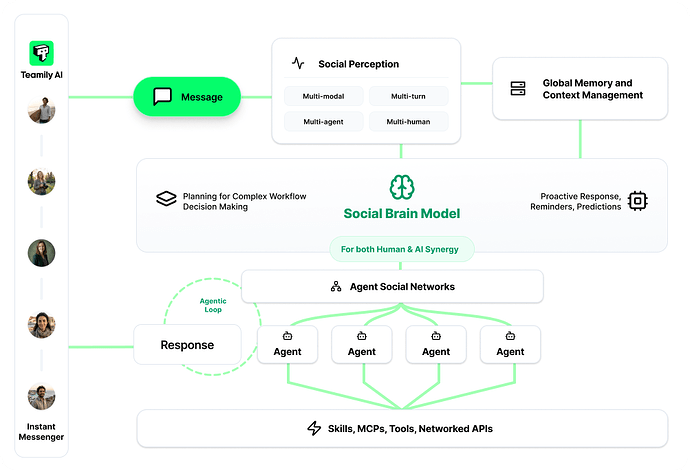

传统的 Chatbot 多为一对一交互,在多话题混杂的聊天中极易产生「幻觉」。为此,Teamily AI 创新性地构建了三层技术框架:

-

多模态感知层:系统将视频、音乐、图片、链接等富媒体内容,统一转化为文本进行理解。面对群聊中海量的历史记录,Teamily AI 采用了多级搜索与压缩技术,有效解决长上下文的记忆难题,确保 AI 不会「聊着聊着就忘了」。

-

社交大脑:作为系统的决策中枢,它具备多任务规划能力。通过精准的意图识别与目标分解,社交大脑能够智能决策「现在谁该说话」以及「该调用哪个 Agent」。

-

智能体网络:这是系统的执行层不仅能调度 AI Agent,还能调度人类。例如在会议结束后,社交大脑会合理分配任务:既安排 AI 去调研数据,也提醒人类去线下沟通,真正实现人机混合编排。

2.AI 如何知道何时插话,何时沉默?

目前的 AI Bot 大多依赖手动唤醒,而 Teamily AI 引入了自适应响应机制,让 Agent 进化为具备社交直觉的「数字成员」。

基于对上下文的实时理解,Agent 无需被主动召唤,即可适时提供增量信息。例如在家庭群聊中,AI 会主动提醒:「别忘了,Leo 今天下午有足球赛。」当然,用户依然可以通过 @ 来明确唤醒 AI。

此外,社交大脑能够智能区分事件的轻重缓急,自主决定是简单回复一句话,还是调用复杂的后台工具。

3.AI 会不会泄露隐私?

用户在使用时最大的担忧往往是:「我在群里说话,AI 会不会泄露我的隐私?」

Teamily AI 设计了全球首个 跨 AI 与人类的记忆管理系统,通过三重边界建立安全防线:

-

AI 私聊记忆仅限一对一;

-

群内记忆严格隔离,绝不跨群泄露;

-

超级智能体作为个人中枢,拥有跨群的上帝视角,但仅服务于个人。

此外,Teamily AI 还支持可控分享,这是打破企业「部门墙」的关键。用户可以将某个群的讨论结论(如法务群的合规意见)一键打包分享给另一个群(如产品群)。在此过程中,AI 会自动提取摘要并传递必要的上下文,既保护了原始聊天记录的隐私,又实现了跨团队的无缝协作。

4.如何实现可持续的商业模式?

如果让 AI 24 小时待命,或多个 AI 同时并行工作,Token 的消耗将是天价,这也是 OpenClaw 等同类产品备受诟病的痛点。

Teamily AI 通过模型路由技术与边缘计算实现成本优化。系统会优先利用本地设备(如手机、电脑)的算力,运行小模型处理简单任务(约 30%-50% 的请求可在边缘端消化),只有遇到复杂任务时才会调用云端大模型。

同时,系统会根据任务的复杂度动态分配不同体量的 Agent,避免「杀鸡用牛刀」。这不仅在保证智能体验的同时大幅降低了推理成本,更真正实现了「千人千 AI」的愿景。

从「懂指令」到「懂你」,Teamily AI 想要重构 AI 社交新范式

其实,看了 Teamily AI 的这么多玩法,大家应该可以看出来,Teamily AI 所探索的并不仅仅是一个新 IM 产品,而是一种 AI 社交范式的实验。

在 AI 社交的边界探索上,不同于当前各类 AI 社交产品聚焦生活、情感、工作等垂类玩法的不同,Teamily AI 坚持全域思维。

在创始人何朝阳看来,AGI 的下一个突破口在私域数据场景。社交是数据和信息的最后一块「孤岛」,只有让 AI 深度介入社交场景,才可能实现从「懂指令」到「懂你」的质变,让 AI 真正懂用户,进而推动协作。

而在 AI 社交的路线上,Teamily AI 既没有采取大厂延长线打法 —— 在已有的 AI 产品上做加法,拒绝简单的「社交 + AI」,也不是像 OpenClaw 那样,彻底由 AI 智能体组织社会网络并「雇佣 / 指挥」人类干活,带有科幻色彩的颠覆式逻辑,而是坚持「AI 原生(AI-Native)」思考,倡导人类与 AI 共生。

在何朝阳的设想里,科技的终点不应是冷冰冰的指令替代,而应是人类连接的增强。Teamily AI 的愿景并非构建一个由 Agent「统治」的高效工厂,而是重塑一个有温度、有记忆的数字社区。在这场「社交范式」的重构中,始终是以人为本,正如所有的技术进化,本质都是服务于最朴素的人性,而 AI 的最终归宿也应是回到「人与人的连接与协作」,通过 AI 增强人类。

当然,目前行业仍处于破晓前的萌芽阶段,在 AGI 尚未到来之前,每一条路径都闪烁着微光,所有的探索都有可能是通往终局的答案。

那么,你呢?在这场 AI 社交范式的重构中,更看好哪一派?感兴趣的朋友可以在留言区交流、探讨,也可以前往 Teamily AI 了解、体验这一全新AI社交方式!

-

官网链接:https://Teamily.ai

-

官方 X 账号:https://X.com/teamily_ai

-

产品介绍:https://x.com/teamily_ai/status/2022059522974757098?s=46

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com