OpenDataLab开源MMFineReason多模态推理框架,含1.8M高质量数据集,助力4B模型性能超越30B,数据驱动方法展现巨大潜力。

原文标题:开源多模态推理「破壁」时刻:MMFineReason助力4B逆袭30B

原文作者:机器之心

冷月清谈:

怜星夜思:

2、MMFineReason 的开源数据管线完全基于开源生态,这对于多模态大模型的发展意味着什么? 相比于依赖闭源 API 的方案,这种方式有哪些优势和局限?

3、文章提到 MMFineReason 数据集的思维链(CoT)长度远超同类数据集,这种长路径推理数据对模型能力提升有何帮助? 未来多模态模型的发展方向是什么?

原文内容

长期以来,开源多模态模型在复杂推理任务上,始终与 GPT-4o、Gemini 等顶尖闭源模型存在一道难以逾越的鸿沟。

社区开发者们逐渐意识到,核心痛点或许不在于模型架构的精进或者模型参数的规模。真正的瓶颈,在于高质量、思维链(CoT)密集的推理数据极度匮乏。

在纯文本领域,DeepSeek-R1 的成功已验证了高质量后训练数据(Post-training Data)的威力,但在多模态领域,我们面对的是横亘在眼前的「两座大山」:

-

数据失衡:现有开源多模态数据仍以简单 VQA 与自然图像为主,而对于真正具有高推理价值的数据,如 STEM 图表、逻辑谜题、复杂视觉符号等数据不仅少,而且标注成本极高。

-

推理质量参差不齐:即便现有的「推理数据」也存在推理过程短、模版化,标注粒度不足、缺乏中间验证、视觉与逻辑推理割裂的问题。

为了填补这一空白,上海 AI 实验室 OpenDataLab 研究团队正式开源了 MMFineReason 框架。这既是一套全流程 100% 基于开源生态、可复现的多模态推理数据合成 Pipeline,同时也开源了由此方法构建的包含 1.8M 高质量样本、5.1B Token 的大规模数据集。

-

论文标题:MMFineReason: Closing the Multimodal Reasoning Gap via Open Data-Centric Methods

-

Huggingface 论文:https://huggingface.co/papers/2601.21821

-

项目主页:https://mmfinereason.github.io/

-

数据集 & 模型:https://huggingface.co/collections/OpenDataArena/mmfinereason

小模型,大性能:高效数据选择的强大优势

先来秀一秀性能结果。团队很惊喜的发现,MMFineReason 的出现,标志着多模态模型进入了「以小博大」的新阶段。

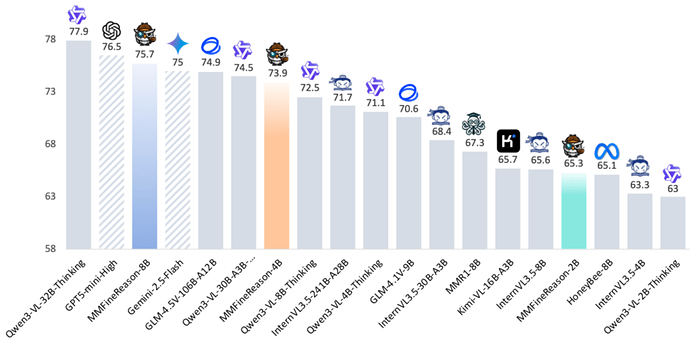

实验数据显示,MMFineReason-4B 模型基于 Qwen3-VL-4B 训练而成,其推理能力不仅超越了 Qwen3-VL-8B-Thinking,性能更是直逼 30B 参数规模的 Qwen3-VL-30B-A3B-Thinking。

更令研究团队惊喜的是,同样基于同尺寸底座训练的 MMFineReason-8B,表现更加优秀:它直接击败了 Qwen3-VL-30B-A3B-Thinking 和 Gemini-2.5-Flash,并开始向 GPT5-mini-High 及 Qwen3-VL-32B-Thinking 等顶级模型发起冲击。

值得强调的是,这种「跨级碾压」的性能跃迁并非来自新的模型结构设计,也不是通过更复杂的训练技巧实现的,而几乎完全源于数据层面的变化 —— 尤其是推理数据的结构化程度与单位样本中的有效推理密度。

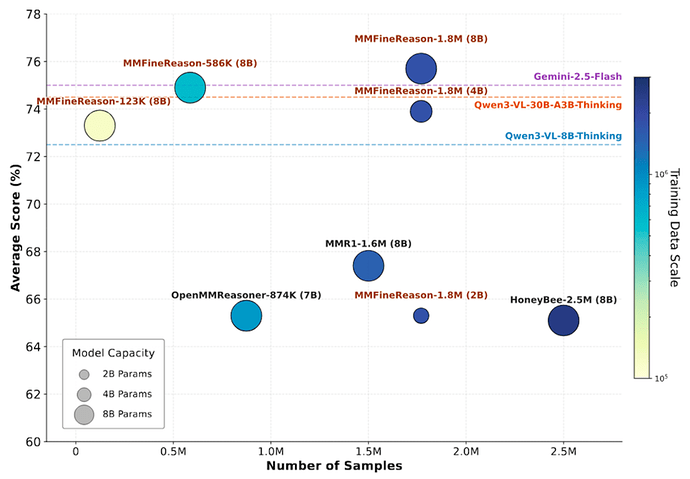

更进一步,团队还发现通过难度感知过滤,能实现极高的数据转换效率:仅使用总量 7%(约 123K)的高难度精选子集数据,即可媲美全量 1.8M 数据相当的性能表现。

因此,当数据被有效筛选、难度与模型能力精确对齐时,数据选择本身就成为决定参数效率的核心杠杆。

揭秘「Closed-Source Level」数据管线:完全开源的数据生产线

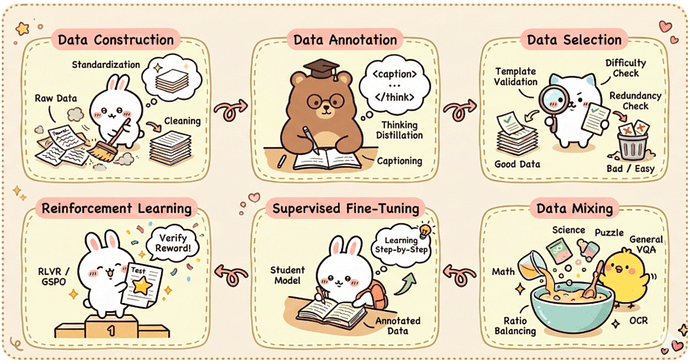

不同于依赖黑盒 API 的传统方案,MMFineReason 构建了一套完全开源的透明且高效的 Pipeline,全流程 100% 基于开源模型。整个流程主要通过三个阶段来实现高质量数据的生产:

-

数据标准化:首先从源头定义「什么是可推理任务」,对 STEM、Puzzle、图、几何、科学表等多领域数据进行标准化处理并统一 Schema,并进行严格的清洗。

-

推理蒸馏:利用 Qwen3-VL-235B-Thinking 作为老师模型进行推理蒸馏,并严格遵守四阶段推理框架:「视觉感知 → 逻辑推导 → 中间验证 → 结论确认」,从而来生成详细且具备「视觉落地」能力的 CoT 推理轨迹。

-

双重过滤:为了确保训练的高效性,团队引入了双层筛选机制,第一是正确性过滤,确保答案与推理过程严格一致;在剔除低质量 CoT 的基础上,进行难度感知(Difficulty-Aware)过滤,专门筛选出对 Qwen3-VL-4B 小模型具有高「训练价值」的样本,即「小模型稳定失败」的样本,从而避免了无效数据的堆砌。

最终,研究团队得到了 MMFineReason-1.8M(正确全量), MMFineReason-586K(正确且去掉过于简单样本),以及 MMFineReason-123K(正确且最困难样本)三个高质量数据集。

MMFineReason-1.8M:专为「深度推理」打造的高质量多模态数据

与其说 MMFineReason 是一个常规的 VQA 数据集,倒不如将其定义为一个专为多模态大模型准备的「硬核思维训练场」。在当前多模态领域普遍陷入「数据饥渴」与「思维链断层」的背景下,该项目展现出了极具辨识度的核心特征。

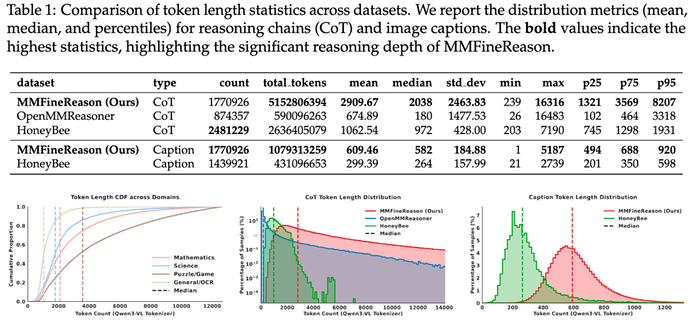

首先,MMFineReason 在思维深度上实现了质的飞跃。相比 HoneyBee 等同类数据集,其平均思维链(CoT)长度达到了惊人的 2,910 tokens,规模足足是前者的 2.7 倍。这种长路径推理数据的引入,本质上是让模型告别了简单的「直觉判断」,转而掌握一套详尽且具象的「视觉 - 逻辑」推导范式。

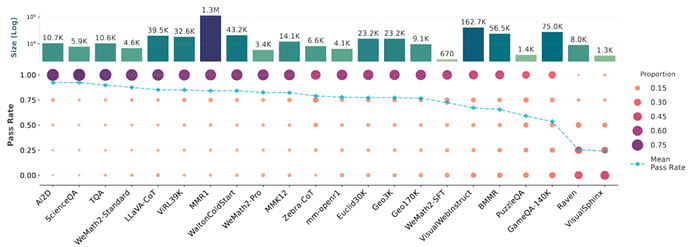

在领域分布上,研究团队展现出了鲜明的去平庸化导向,坚决拒绝易于「刷分」的简单样本,转而深耕高难度逻辑腹地。

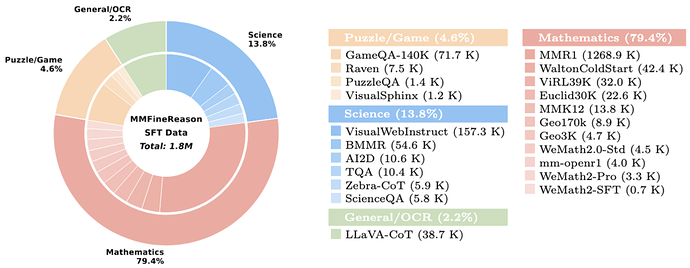

数据集中,数学领域以 79.4% 的绝对占比强化了符号推理根基,涵盖了几何、微积分等深度学科;13.8% 的科学数据则聚焦于复杂的物理、化学图表分析;此外,数据集还引入了 4.6% 的谜题与游戏数据,通过抽象模式识别与策略博弈,不断试探并挑战开源模型的智商上限。

图为 MMFineReason 数据集的数据分布情况。可以看到数据集的领域覆盖了数学、谜题与游戏、几何 / 微积分、图表与复杂科学等。

更具深远意义的洞察在于这种高强度训练带来的「协同提升效应」。实验结果打破了专项训练会削弱通用能力的固有认知:当模型在 STEM 和逻辑难题上进行深度钻研时,其在一般性 VQA 任务上的表现反而得到了同步增强。这种以点带面的能力释放,再次印证了高质量逻辑链条才是驱动模型性能跨级演进的真逻辑。

结语与展望

MMFineReason 的开源,证明了在多模态领域,当模型架构逐渐收敛、参数规模的边际收益不断下降,决定能力差距的,不再是模型有多大,而是「数据是否真的教会模型如何推理」。通过精细化的数据工程,小参数模型完全有潜力在复杂推理任务上对抗甚至超越大参数模型。

这不是一次规模的胜利,而是 Data-Centric 方法论的胜利。我们期待未来在多模态开源大模型的路上,能用更高效、更高价值的数据来促进社区的进步。

目前,该项目已在 Huggingface 及 GitHub 全面上线,为开源社区提供了从数据到工具链的完整支撑。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com