AI应用春节红包大战预示流量高峰,底层算力面临大考。共绩科技的弹性算力解决方案,助力企业应对挑战,保障用户体验。

原文标题:当AI应用都在「撒钱」时,谁来扛住千亿交互背后的算力大考?

原文作者:机器之心

冷月清谈:

怜星夜思:

2、共绩科技提出的“智能算力电网”概念,如何理解?这种模式与传统的云计算服务相比,有哪些优势和局限性?

3、Remy的案例中,48小时内算力扩容19倍,保证了用户体验。这种爆发式的算力需求在其他行业是否常见?对于不同规模的企业,选择算力解决方案时应该考虑哪些因素?

原文内容

春节还未到,但各路 AI 应用的「战斗」号角已经吹响。

腾讯元宝先声夺人,豪掷 10 亿元现金红包;百度文心一言紧随其后,狂撒 5 亿元红包;字节跳动火山引擎则直接与春节流量大户春节联欢晚会「联名」;阿里千问请客,诚邀广大网友喝奶茶,一度让服务器「崩溃」……

但这还只是「前菜」,在大模型落地应用成为主流叙事的这一年,各大 AI 厂商或初创都在围绕谁将成为下一个「超级入口」狂奔。而在春节这一重要时间节点,对于 AI 应用厂商来说,既是自我展示的好时机,也是接受网友检验的关键时刻,必须铆足了劲疯狂「秀肌肉」。

行业预测数据显示,仅除夕当晚,主流 AI 应用的交互量可能突破千亿次,瞬时并发峰值或达 10 亿次 / 秒量级。

而每一次 AI 对话、每一帧图像生成、每一次实时交互,都在考验底层算力基础设施的弹性极限。

因此,对于大多数 AI 应用来说,「大考」之前需要思考一个重要命题:当不确定性的流量高峰成为新常态,什么样的算力基础设施才能确保用户体验始终丝滑?

有一家创业公司,在去年一场真实的「流量海啸」中,不仅稳稳接住了,还完成了一次漂亮的技术支撑。这个故事的主角,正是全球 3D 内容应用头部企业 ——Remy,以及背后的底层算力合作伙伴 —— 共绩科技。

他们的案例为行业提供了一个可参考样板:面对难以预见的峰值,基于秒级弹性伸缩的算力架构,已成为保障业务连续性的关键技术选项。

Remy 爆火背后:

48 小时算力狂飙 19 倍,稳稳扛住 50 万用户极限考验

Remy 是 KIRI Innovation(麒砺创新)旗下产品,成立 7 年来,基于 NeRF、3D 高斯泼溅等技术深耕,聚焦于让沉浸式 3D 创作变得触手可及。

去年,在华为 HarmonyOS 6 的发布会现场,Remy 惊艳亮相,创始人兼 CEO 王正男现场演示,仅用一段手机环绕视频,就生成了可在手机里自由查看的沉浸式 3D 空间。发布会结束仅数小时,Remy 的下载量便一路飙升,直冲华为应用市场第一。

对于用户来说,Remy 让 3D 内容真正走向大众。无需专业设备,也不用建模基础,一部普通智能手机,对准实物拍摄一段视频,五分钟后就能生成一个可 360° 查看、可社交分享的沉浸式 3D 空间。曾经只有专业工作室才能具备的能力,如今被装进了每一位华为用户的口袋。

但这对于 Remy 来说,既是高光时刻,也是「生死考验」。

汹涌的用户瞬间涌入,每秒都有成千上万条视频等待被「3D 化」。后台算力需求呈指数级飙升,服务器压力骤增。对于一家创业公司而言,这是梦寐以求的高光,也是一场关乎存亡的极限压力测试:如果用户点开应用却迟迟无法生成,刚点燃的市场热情将迅速冷却。

关键时刻,KIRI 的底层算力合作伙伴 —— 共绩科技,启动了秒级响应机制。通过弹性算力调度系统,在 48 小时内将支撑 Remy 的 GPU 集群规模从百卡极速扩容至 1900 张卡,稳稳接住了 50 小时内 50 万用户的集中登录冲击!

流量洪峰再猛,Remy 的用户体验依然丝滑,没有掉链子。这背后,正是共绩科技的核心能力:极速、稳定的算力弹性扩缩容。

算力「如水电」:按需调度,秒级扩缩

共绩科技成立于 2023 年,核心团队来自清华,专注于构建融合算力与电力的智能调度网络,旨在提供平价、可靠、绿色的算力服务,使 AI 技术真正普及到每个人。

据了解,通过精细调度算法,共绩科技已为多家 AIGC 领军企业及科研机构提供高效算力,目标实现算力使用成本直降 50% 以上。

而他们所做的事情,简单来说,就是打造了一张「智能算力电网」。

怎么理解?

传统模式下,企业往往需要为可能的最高流量峰值预先储备资源 —— 为了可能出现的流量最高峰,很多团队不得不提前数月规划服务器采购,但峰值过后,大量资源闲置。

这种「为峰值容量预付成本」的模式,在 AI 应用负载呈现强波动、高并发特性的今天,正显露出其效率短板。

随着 AI 应用深度融入日常生活并日趋实时化,重大节日、产品发布、营销活动等带来脉冲式流量,已从偶然事件变为可预测的周期性场景。

为此,行业应对策略也正在发生根本转变:从静态「资源储备」转向动态的「弹性调度」。

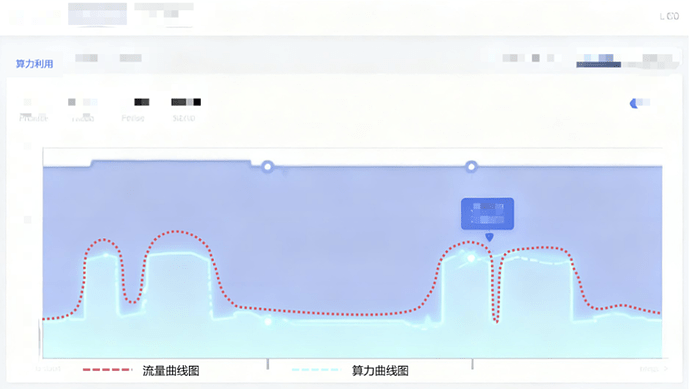

在共绩科技看来,理想的算力供给应该像智能电网一样,实时调峰填谷。通过实时感知与调度,让算力供给曲线紧贴业务流量曲线,在需求高峰时动态调配资源,在低谷时平滑释放,在整体上实现资源利用率的跃升。

而这恰好完美匹配了即将到来的 AI 应用春节期间的「心跳曲线」:

-

秒级弹性: 流量高峰来了,算力自动跟上;高峰过去,资源自动释放。你只需为实际使用量付费,无需为「可能用得上」的峰值容量提前买单。

-

极致稳定: 通过智能容错和高可用架构,保障关键任务 SLA 高达 99.99%。春节值守,你可以更安心地关注业务本身,而不是后台的负载告警。

-

简单易用: 提供 Serverless GPU 服务,支持 Docker 容器化「一键部署」,预置主流 AI 框架。你无需关心底层运维,像用水用电一样,专注你的 AI 创意。

从此,AI 应用厂商不必再继续传统云厂商的包年包月模式,为了春节那 1% 的突发流量,闲置 99% 的算力资源,成本大幅降低。

但这又不仅仅是成本优化,还确保了峰值期的服务稳定性。

对于用户来说,他们感知不到后台复杂的资源调度,只关心交互是否流畅、结果是否及时。在注意力争夺白热化的当下,一次卡顿就可能意味着用户耐心耗尽甚至永久流失,企业辛辛苦苦拉来的新用户,也许就会在漫长的加载圈和 502 报错里流失了……

因此,在当前多模态大模型、实时生成式 AI、空间计算等技术逐渐普及,应用对算力的需求正变得更密集、更突发、更不可预测 / 波动剧烈的当下,这种「按需使用、即时伸缩」的模式日益成为「刚需」。尤其是对于创新节奏快的 AI 初创团队来说,它降低了公司使用高性能算力的门槛,团队可以更轻量地启动重型 AI 应用,而成熟产品在应对市场活动时也拥有了更大的灵活性与确定性。

找靠谱战友,迎接春节流量洪峰

如今,春节的流量洪峰即将到来,对于 AI 应用厂商来说,既考验着产品的吸引力,更考验着企业的「底层内力」—— 算力支撑的厚度,直接决定了你能接住多少流量、留住多少用户。

Remy 的故事,很可能在今年的春节,以更大的规模、在更多的 AI 应用上重演。

与其在焦虑中祈祷服务器稳定,不如在节前为你的 AI 应用找一个靠谱的「战友」。共绩科技作为专业的「算力守护者」,希望能够与各大 AI 应用厂商一同并肩作战,帮助解决弹性扩缩容的核心难题,扛住春节流量洪峰。

毕竟,在 AI 竞赛的下半场,稳定的用户体验,才是最好的新春祝福。

春节流量大战在即,共绩算力团队愿每一家 AI 企业都能专心做产品、冲流量,至于算力这件事,交给共绩就好 —— 你只管乘风破浪,它帮你扛住算力压力,守住每一波流量红利,过一个安心年。

共绩算力团队,提前祝各位 AI 应用企业,春节大卖,服务器不崩,睡个安稳觉!流量长虹!

更多信息,可前往共绩算力平台官网查看。

-

官网链接:www.suanli.cn

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com