2026年,Self-Distillation成为大模型持续学习的关键。通过内生能力和信息差,模型可实现自驱动升级,不再依赖外部强教师。

原文标题:2026开年关键词:Self-Distillation,大模型真正走向「持续学习」

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章提到了“灾难性遗忘”的问题,在持续学习中,除了Self-Distillation,还有哪些方法可以有效缓解这一问题?它们的优缺点是什么?

3、文章中提到的三种Self-Distillation框架(SDFT、SDPO、OPSD)分别适用于哪些场景?它们之间有什么联系和区别?未来它们会如何发展?

原文内容

2026 年刚拉开序幕,大模型(LLM)领域的研究者们似乎达成了一种默契。

当你翻开最近 arXiv 上最受关注的几篇论文,会发现一个高频出现的词汇:Self-Distillation。

近年来,基础模型取得了显著的成功,为语言、视觉、机器人等领域的 AI 应用提供了强大的支持。

但在真正落地、长期使用的过程中,研究者逐渐发现:如何让模型在不断吸收新知识的同时,不丢失已有的核心能力 —— 即「持续学习」,正成为制约大模型进化的关键瓶颈。

传统的强教师依赖范式因成本与数据依赖,难以适配高频的持续进化。Self-Distillation(自蒸馏) 随之成为破局点 —— 通过合理的上下文引导或反馈机制,模型完全可以构建出一个比当前权重更聪明的临时自我,让模型在没有外部强教师的情况下实现内生增长。

基于这一深刻洞察,由 MIT、ETH Zurich、Meta 及斯坦福等顶尖机构组成的紧密学术圈,在 2026 年 1 月密集发布了三项研究成果。

1.Self-Distillation Enables Continual Learning

-

论文标题:Self-Distillation Enables Continual Learning

-

论文链接:https://www.alphaxiv.org/abs/2601.19897

-

代码链接:https://github.com/idanshen/Self-Distillation

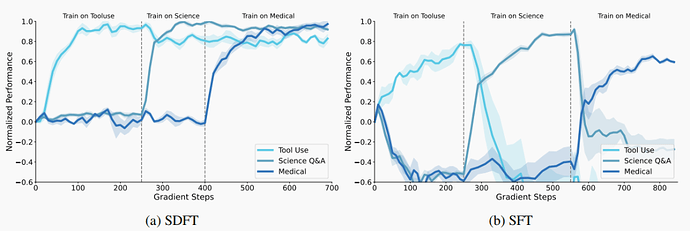

在持续学习领域,传统的监督微调(SFT)常因 「灾难性遗忘」 备受诟病,它的副作用非常明显:当你教模型学会一套新的知识,它原有的代码能力或常识推理往往会发生断崖式下跌。

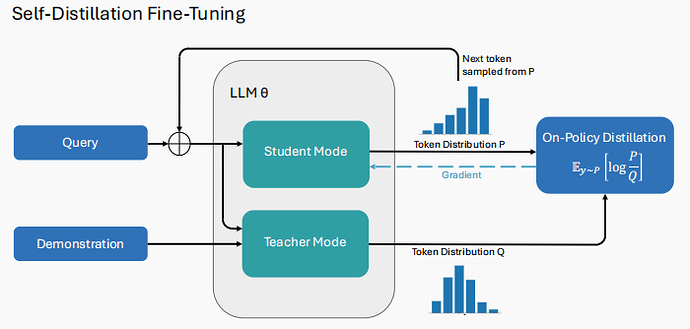

研究团队提出了一种自蒸馏微调(SDFT)方法,该方法能够直接从演示中实现基于策略的学习。

SDFT 机制概览

核心机制: 该方法假设预训练模型已具备强大的 ICL 潜力。在学习新知识时,首先构造包含少量专家演示(Few-shot)的上下文,诱导模型生成高质量的教师分布;随后要求模型在不带演示的情况下,通过自蒸馏去拟合这一分布。

技术突破: 该方法将持续学习转化为一个 策略内对齐问题。由于训练信号源于模型自身的 ICL 状态,它能最大限度地保持模型原始的概率流分布,避免参数在微调过程中产生剧烈漂移,从而解决了监督微调(SFT)中常见的灾难性遗忘。

在技能学习和知识获取任务中,SDFT 的表现一致优于 SFT:它不仅实现了更高的新任务准确率,还显著减少了灾难性遗忘。在顺序学习实验中,SDFT 使单一模型能够随时间累积多种技能而不会出现性能退化,证明了同策略蒸馏是从演示中实现持续学习的一种实用路径。

2.Reinforcement Learning via Self-Distillation

-

论文标题:Reinforcement Learning via Self-Distillation

-

论文链接:https://arxiv.org/pdf/2601.20802

-

代码链接:https://github.com/lasgroup/SDPO

目前的强化学习(如 GRPO)通常只能拿到一个二值反馈,这在长程推理中会导致严重的「信用分配」问题。此外,在 GRPO 等算法中,如果模型在某组尝试中全军覆没(奖励均为 0),学习信号就会消失,导致模型进化停滞。

研究团队认为,问题的关键并不在于强化学习本身,而在于常见的二值反馈信息密度极低,无法为长逻辑链条提供精细的指导。

针对这一困境,研究团队提出了 SDPO(自蒸馏策略优化) 框架,旨在将环境中的 「富反馈」 转化为高效的学习信号。

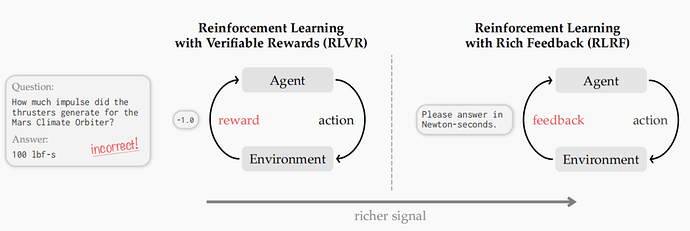

RLVR 与 RLRF 强化学习范式对比

核心机制: SDPO 引入了 富反馈(Rich Feedback) 环境。当模型生成错误答案时,环境会返回具体的报错信息(如逻辑判读)。模型将这些报错信息重新注入上下文,作为一个 「自省教师」 来重新审视并校准之前的错误尝试。

技术突破: 该方法通过自蒸馏机制,将原本模糊的标量奖励转化为 Token 级的密集监督信号。通过对比 「反馈后分布」 与 「初始分布」 的差异,SDPO 能精准定位导致失败的关键 Token,指引模型降低错误路径的概率,并提高修正后逻辑的置信度。

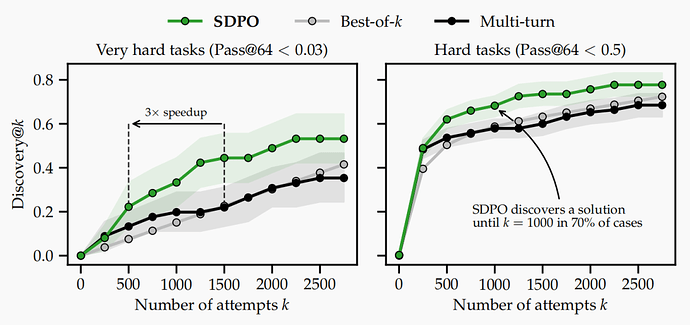

在极难任务(左图)中,SDPO(绿线)展现了极高的采样效率,仅需约 1/3 的尝试次数(3× speedup)即可达到其他算法的解发现率。而在整体训练维度上,它能以更少的样本量快速收敛,在 k=1000 时已能解决 70% 的困难任务,显著突破了传统算法的性能瓶颈。

在 LiveCodeBench 等竞赛级编程测试中,SDPO 展现了惊人的学习效率:它仅需传统 GRPO 算法 1/4 的生成样本量 即可达到同等精度。它证明了即便没有外部强教师,模型也能通过利用环境反馈进行深度自省,从而打破标量奖励带来的进化僵局。

3.Self-Distilled Reasoner:

On-Policy Self-Distillation for Large Language Models

-

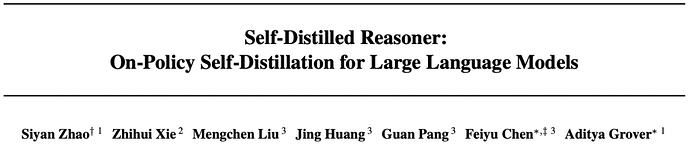

论文标题:Self-Distilled Reasoner: On-Policy Self-Distillation for Large Language Models

-

论文链接:https://arxiv.org/pdf/2601.18734

在复杂推理任务中,大模型往往面临搜索空间过大、奖励信号稀疏的问题。尽管强化学习能提升模型上限,但在没有外部 「强教师」 辅助的在线学习场景中,模型很难在短时间内找到通往正确答案的深层逻辑路径。

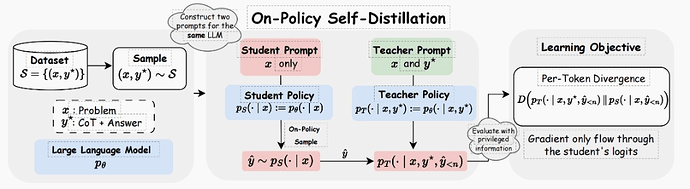

研究团队提出了 OPSD(策略内自蒸馏) 框架,通过在同一模型内部构建 「信息不对称」 来引导自我进化。

OPSD 框架概览

核心机制: 该框架将模型配置为两种状态。教师策略在输入中包含 「特权信息」(如标准答案或经过验证的推理轨迹),能够产生高质量的 Token 概率分布;而学生策略则在不接触特权信息的情况下仅凭题目进行作答。

技术突破: OPSD 采用 策略内(On-Policy)采样,核心训练目标是最小化学生分布与教师分布之间的 KL 散度。这种设计强制模型在不借助外部参考的情况下,通过内生分布的对齐,学会如何从题目直接推导出具有逻辑深度的推理链路。

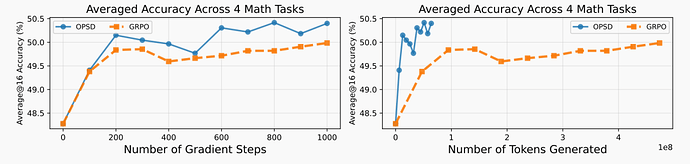

在 MATH 和 GSM8K 等高难度推理基准测试中,OPSD 展现了极高的学习效率:它在 Token 利用率上比传统的 GRPO 算法高出 4-8 倍。实验证明,SFT 虽然能提供初始方向,但 OPSD 能够更进一步地挖掘模型内在的“推理潜力”,证明了通过特权信息诱导出的自我博弈,是实现推理能力飞跃的一条捷径。

这三篇论文核心逻辑高度一致:利用模型已有的内生能力,通过不同的上下文构造出 「信息差」,从而实现自驱动的闭环升级,Self-Distillation 正在成为大模型后训练阶段(Post-training)的标准配置。

2026 年,也许我们不再需要教模型怎么变强,只需要给它一个「持续学习」的机会。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com