CVPR 2026 AdvML@CV Workshop 关注视觉-语言智能体安全,探讨对抗攻击与防御,期待您的投稿!

原文标题:CVPR 2026 Workshop征稿|第六届AdvML@CV:多模态大模型智能体安全

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章提到了视觉-语言智能体在无人驾驶和智能机器人领域的应用前景,大家认为在这些实际应用中,安全问题的重要性体现在哪些方面?

3、对抗机器学习在视觉-语言智能体安全领域有哪些独特挑战?跟传统的图像分类或者目标检测任务相比,有哪些新的攻击和防御方法?

原文内容

IEEE/CVF 计算机视觉与模式识别会议 CVPR 2026 将于 2026 年 6 月 3 日至 6 月 7 日在美国科罗拉多州丹佛举办。我们将在 CVPR 期间举办第六届对抗机器学习计算机视觉研讨会(6th AdvML@CV),Workshop 预计安排在 6 月 3 日或 6 月 4 日。

本届主题聚焦:Safety of Vision-Language Agents(视觉-语言智能体安全)。

主题聚焦:

视觉-语言智能体的安全与鲁棒性

多模态基础模型推动了视觉理解、生成与推理能力的跃迁,也让 Vision-Language Agents(视觉-语言智能体)迅速成为「感知——语言推理——行动规划」一体化的新范,在无人驾驶、智能机器人等领域具有广阔应用前景。

但随着智能体自主性增强,攻击面也从传统像素级扰动扩展到更复杂的安全风险:例如对抗提示(Adversarial Prompts)、指令注入(Instruction Injection)、Jailbreak 操控等,它们可能扰乱推理链条、误导感知决策,甚至诱发危险行为。

我们希望通过本次 Workshop,汇聚计算机视觉、多模态学习与 AI Safety 社区的研究者与工程实践者,共同推进安全、鲁棒、可信的视觉-语言智能体研究与落地。

论文征稿

本次研讨会诚邀与以下主题相关(但不限于)的投稿:

-

Attack and defense on vision-language agents

-

Datasets and benchmarks that could evaluate vision-language agents

-

Adversarial / Jailbreak attacks on vision-language agents

-

Improving the robustness of agents or deep learning systems

-

Interpreting and understanding model robustness, especially agentic AI

-

Adversarial attacks for social good

-

Alignment of vision-language agents

投稿类型与格式要求:

-

Long Paper:正文最多 8 页(不含参考文献)

-

Extended Abstract:正文最多 4 页(含参考文献)

-

论文需匿名,并使用 CVPR 2026 Author Kit 模板撰写(LaTeX/Word 均可)

-

被录用论文可选择收录至 CVF & IEEE Xplore Proceedings

重要日期

-

Abstract Submission Deadline: 2026/03/05

-

Paper Submission Deadline: 2026/03/05

-

Author Notification: 2026/03/17

-

Camera-Ready Deadline: 2026/04/01

-

CVPR 2026 Conference: 2026/06/03

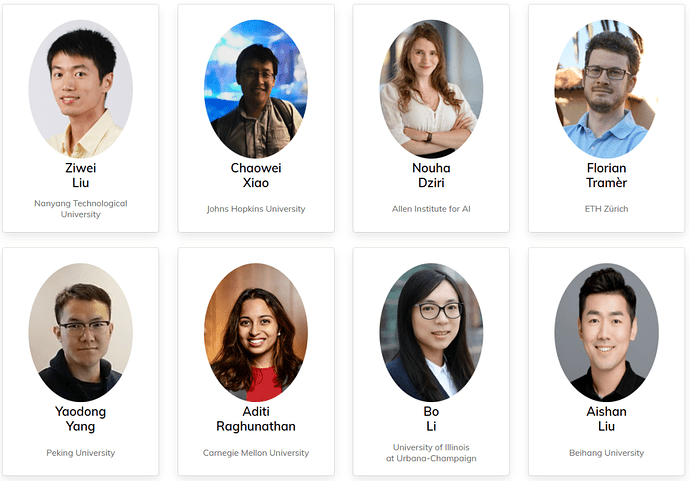

演讲嘉宾

组织团队

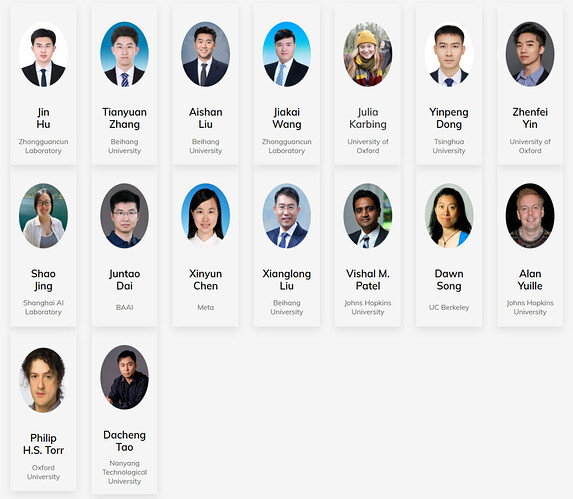

Program Committee

Workshop Sponsor

投稿入口与会议信息

欢迎转发给有相关研究方向的同学与合作伙伴,我们期待在研讨会现场与大家交流!

-

Workshop 官网: https://cvpr26-advml.github.io/

-

OpenReview 投稿入口: https://openreview.net/group?id=thecvf.com/CVPR/2026/Workshop/Advml

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com