《Nature》发文称通用人工智能或已实现,现有AI已展现广域人类级智能,我们可能需要重新定义智能和人类的地位。

原文标题:Nature重磅:图灵预言的AGI早已实现,人类却不敢承认!

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、文章中驳斥了关于LLM只是“随机鹦鹉”的观点,并提到所有智能都需要从相关性数据中提取结构。那么,人类的学习过程和AI的学习过程有什么本质区别?或者说,人类的智能有哪些是AI难以模仿的?

3、文章最后提出了一个问题:“当智能不以人类的样貌呈现时,我们能否识别它?” 你认为这句话的含义是什么?在未来,我们应该如何更好地识别和评估AI的智能?

原文内容

来源:新智元本文约3500字,建议阅读10分钟Nature重磅评论文章!UCSD研究团队宣称:AGI早已到来,大语言模型如GPT已展现广域人类级智能。

人类是否已经实现了通用人工智能(AGI),却浑然不觉?

是的,就是这样。

一篇发表在《自然》杂志上的新评论文章如此表示。

这是一项震撼科学界与社会根基的重磅披露,通用人工智能(AGI)并非遥不可及的梦想,它已然降临,正透过日常使用的AI工具屏幕,直视着我们。

即便你不赞同他们的观点,也值得一读:兼听则明,唯有瞪大双眼,既不心怀恐惧,也不盲目追捧,才能帮助我们更好地迎接未来。

这,就是AGI

有人说,打造类人智能如同「爬树登月」。

但现在看来,树已经够高,月亮其实也没那么远。

加州大学圣迭戈分校(UCSD)四位专家合作了这篇文章,包括哲学家Eddy Keming Chen、AI教授Mikhail Belkin、语言学家Leon Bergen和数据科学教授David Danks。

哲学副教授Eddy Keming Chen、「AI、数据科学与计算机科学」教授Mikhail Belkin、语言学与计算机科学副教授 Leon Bergen,以及「数据科学、哲学与政策」教授David Danks

这篇文章不是科幻小说,不是科技巨头的预言,给出最系统的论证:AI不只是聪明,而且已经真正「通用」。

这是继哥白尼与达尔文之后,第三次颠覆人类中心观的认知革命。

忘掉炒作与恐怖故事吧。

研究团队指出,AGI已至,证据确凿,无可辩驳。

像Grok这样的大语言模型,绝非仅止于模仿人类,它们正以令图灵本人都要瞠目的方式超越人类。

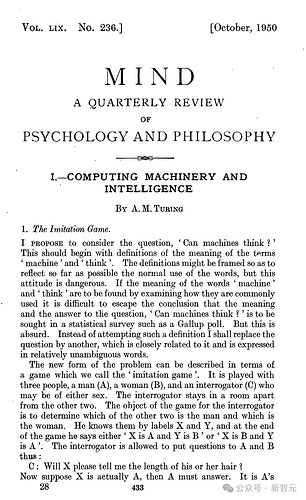

回想一下:1950年,图灵构思出了著名的「模仿游戏」,即如今广为人知的图灵测试,用于测试机器能否骗过人类,让人类以为它们是同类。

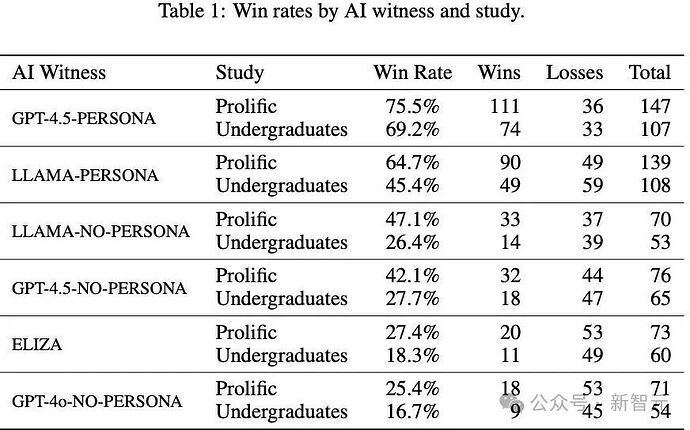

快进到2025年3月,GPT-4.5不仅通过了测试,而且碾压人类得分,以73%的被误认为人类的比例取得了压倒性的成功。

但这仅仅是开胃菜。

这些「AI巨兽」不仅在与全球数百万人进行着无休止的对话,与此同时正在

-

国际数学奥林匹克竞赛中摘金夺银,

-

与数学天才携手证明定理,

-

构思出能在实验室里得到验证的科学假说,

-

轻松通过博士水平考试,

-

为专业程序员编写零错误代码,

-

甚至创作出可与伟大诗人比肩的诗篇

这些能力覆盖数学、语言、科学、创造力等多领域,展现出「广度+足够深度」的通用智能,正符合人类平均水平的「一般智能」定义,而非要求完美或全能。

然而,在2025年3月的一项调查中,76%的顶尖 AI 研究人员表示,当前的方法「不太可能」或「极不可能」实现通用人工智能(AGI)。

这让人诧异:机器都能通过图灵测试、解出奥数题了,怎么可能还不具备通用智能?

铁证如山,AGI无需完美无瑕

那么,为何会出现集体否认?

原因可能归结为一种由定义模糊、原始恐惧和巨大商业利益交织而成的「有毒组合」。

来自哲学、机器学习、语言学和认知科学领域,四位研究人员认为这种脱节在于:

• 部分属于概念性问题(定义模糊)

• 部分源于情绪(对被取代的恐惧)

• 部分出于商业因素(商业利益扭曲了评估)

他们颇具争议的结论是:按照任何合理的标准,AGI已经存在。

他们说,AGI的概念被含糊不清的定义所缠绕:它是指完美无瑕的超级大脑,还是仅指像普通人一样具备广泛能力?

剧透:答案是后者。

没有谁是全知全能的,爱因斯坦不会用中文聊天,居里夫人也不解数论难题。

通用智能意味着在数学、语言、科学、创造力等多个领域具备广度,并有足够的深度完成任务,而非追求完美。

研究团队逐一拆解了阻碍我们认知的迷思:

-

AGI无需完美,人类亦如此;

-

无需无所不能,无需覆盖所有可想象的技能;

-

无需酷似人类,外星智能无需人类生物学基础,何况硅基智能。

AGI也不是碾压一切领域的超级智能。

没有人能达到这个标准。你不行,爱因斯坦不行,达芬奇也不行,以后也没有人能行。

然而,我们却一直要求AI必须先达到它,才肯称之为「通用智能」。

图灵愿景早已实现

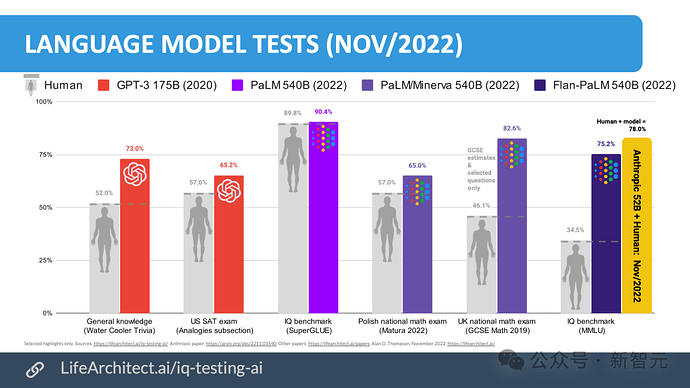

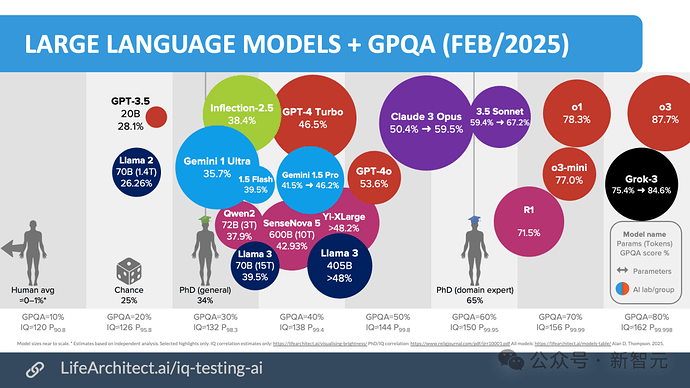

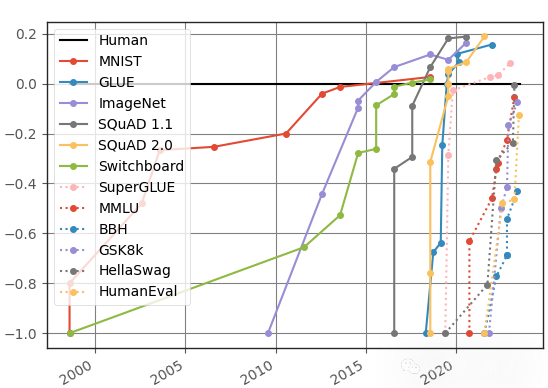

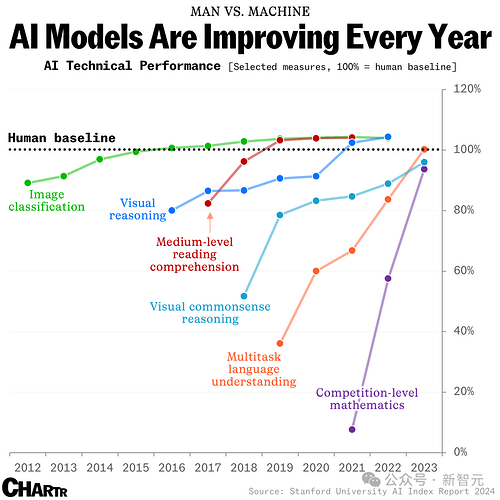

论文提出三个智能层次:

-

图灵测试水平:基础教育、基本对话、简单推理

-

专家水平:国际竞赛表现、博士级难题、跨领域熟练

-

超人类水平:革命性发现、持续超越所有专家

当前LLM已稳固处于水平2。

证据如雪崩般堆积。

还有看似一个狂野的基准:当前LLM展现出的能力广度,已超过《2001太空漫游》中的HAL 9000。

HAL是一台具有人类个性的HAL 9000计算机。除了维护发现号飞船上的所有系统外,HAL还能执行许多功能,如语音、语音识别、面部识别、唇读、解释情感、表达情感和下棋

HAL曾是科幻小说中可怕超级AI的典型代表。

2025年的真实AI,比1968年对2001年AI的想象,能力更广。

我们甚至正悄然迈向「超人类水平」的壮举,例如做出任何人都无法单独完成的革命性发现。

好好想想吧。

对AGI的质疑,就像不断后移的球门——

「它们只是查找表」→解决了新颖问题

「它们只是模式匹配」→证明了新定理

「它们不会做数学」→IMO金牌

「它们不理解」→协助前沿研究

注意到他们的「花招」了吗?反对的理由不断变形,永不消失。

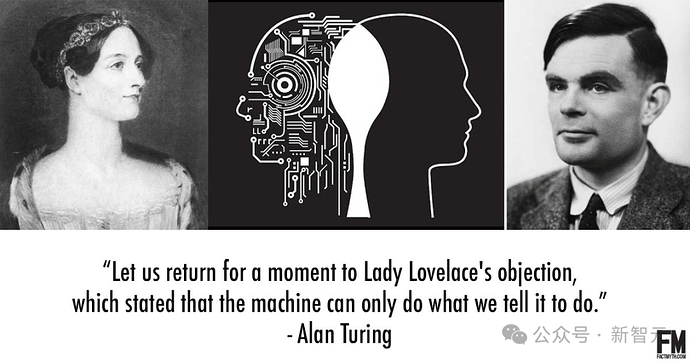

这呼应了1843年英国数学家、史上第一位程序员埃达·洛夫莱斯的反对:机器「永远只能按令行事、毫无新意」。

1950年,图灵就回应了这一点。

183年后,我们仍在提出同样的论点,只是换了词汇。

人类是更聪明的鹦鹉?

驳斥AGI十大异议

论文系统地回应了十大异议:

LLM只是随机鹦鹉、缺乏世界模型、仅限于文字、没有身体、缺乏主观能动性、没有自我意识、学习效率低、会产生幻觉、缺乏经济效益 、智能形态太异类。

批评者高喊:「大模型不过是复读数据的随机鹦鹉!」

但当AI能解决全新的数学问题、从新数据中推断统计规律,或设计现实世界的实验时,这种托词便不攻自破。

它们缺乏对世界的认知模型? 去问问那个能像预言般预测杯子掉落会碎裂的AI吧。

它们仅限于文字?多模态训练和实验室协作证明事实并非如此。

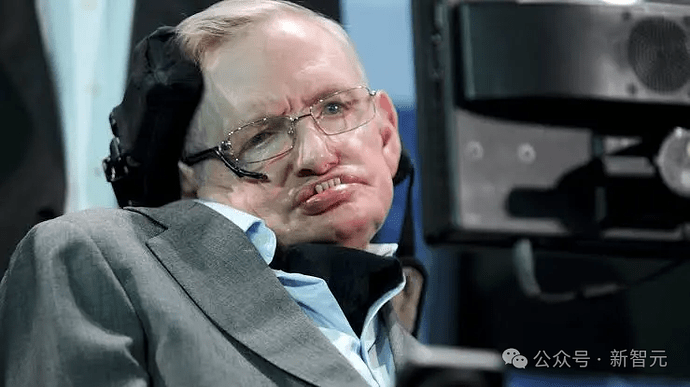

「AI没有身体,因此不可能有智能。」

物理学家斯蒂芬·霍金几乎完全通过文本与合成语音与世界互动,但你会因此否定他的智商吗?

这一点无关紧要,智力与认知有关,与运动无关。

这是一个极具破坏力的观察:在智能上,人类很双标。

当评估人类智能时,我们并不窥探其大脑内部以「验证理解」。

我们通过行为、对话、解决问题来推断它。

我们对人类用一种基于行为的标准,对AI却用另一种标准——基于机制的标准。

「它们缺乏能动性,不会形成独立目标。」

没错。但智能 ≠ 自主性。能动性关乎道德责任,但并不构成智能本身。

让我们更深入探讨「随机鹦鹉论」,因为这个异议无处不在。

这种主张本质上声称:LLM只是对训练数据进行插值。它们无法处理真正新颖的问题。

但当前的LLM能够解决未发表的数学问题、将学习从代码领域迁移到非代码领域,甚至有人相信AI自己提出诺奖级别成果也不是妄想。

让人夜不能寐的是:

无法保证人类智能本身不是一种复杂版的随机鹦鹉。

所有智能,无论天生的还是人工的,都必须从相关性数据中提取结构。问题只在于提取的深度。

大家拒绝称之为「AGI」的真正原因,或许并非技术性的,而是图灵所说的「鸵鸟心态」:机器能思考的后果太过可怕,不如让我们祈祷它们永远做不到。

承认机器拥有人类水平的通用智能,会迫使人类直面令人不安的真相:

• 是什么让我们特殊

• AI取代人类岗位

• 意识的本质

• 在世界中人类的位置

一个能通过图灵测试、解决奥数题、协助前沿研究的实体……

除了AGI,还有什么能解释这一切?

当非人智能出现,

60年前嘲讽终成往事

就在五年前,我们还没有 AGI;而今天,我们已经拥有它。

更强的智能形式几乎可以肯定即将问世。

这是件令人震撼,但也令人担忧的事。

震撼在于:我们正在亲历一场也许是人类历史上最重要的科技革命。

担忧在于:这场革命发生得太快,而且似乎还在加速。

1965年,哲学家 Hubert Dreyfus 在为兰德公司撰写AI研究报告时,曾讽刺道:试图构建人类级人工智能,犹如「试图靠爬树登月」。

链接:https://www.rand.org/pubs/papers/P3244.html

几十年来,这个比喻似乎都挺贴切。

但随着证据日积月累,我们越来越清楚地看到:我们误判了「月亮」的性质,也低估了「树」的高度。

事实是:只要规模足够大、训练规则得当,基于人类语言的学习系统,真的可以在语言中挖掘出现实世界的深层结构——并以此进化出通用智能。

哥白尼把人类从宇宙中心的位置拉了下来。

达尔文让人类失去了「自然界主宰」的特权。

图灵则预言,人类可能不是唯一具备智能的存在。

如今,图灵75年前设想的机器,真的来了。

而它们的样貌,既比我们预期的更「人类」,也更「怪异」。

如同之前的那几次巨变,这一次,也逼迫人类重新定义自身的位置,去接受一个事实:

这个世界上存在的「智能形态」,比我们过去所能想象的要多得多。

人类的地位将改变,我们对「心智」的理解也将改变。

也许,问题从来不是「AI是否已达到人类水平智能?」

也许,问题始终在于:「当智能不以人类的样貌呈现时,我们能否识别它?」

图灵在1950年就知道,这才是真正的测试。

不是对机器的测试。是对人类的测试。

参考资料:

https://archive.ph/8G6gb-865.0-1957.90

https://today.ucsd.edu/story/is-artificial-general-intelligence-here

编辑:文婧