玄武CLI,国产版Ollama,让国产算力的大模型部署进入“零门槛时代”,激活你的“国货之光”。

原文标题:国产版Ollama来了,Clawdbot终于不只属于Mac和英伟达

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章提到Clawdbot这样的Agent会带来隐私和成本问题,你认为在本地部署Agent是解决这些问题的最佳方案吗?还有没有其他的可能?

3、玄武CLI目前主要支持DeepSeek、Qwen3等模型,未来你希望它支持哪些类型的模型或应用?

原文内容

这几天,AI 圈的头号 C 位莫过于这只「龙虾」:Clawdbot(现在得叫它 OpenClaw 了),它几乎把一群开发者折腾得彻夜难眠。

为什么它这么火?因为和以前那些只会陪聊的 Chatbot 不同,Clawdbot 是个真正的「实干派」:它能接管你的电脑,在你睡觉时通宵写代码、修 Bug,甚至背着主人手搓出一套语音功能。

更魔幻的是,随之诞生的 AI 社交平台 Moltbook 彻底刷屏了。在这个「AI 版 Reddit」上,150 万个 Agent 正通过自创语言和共谋进化,建立起背离人类掌控的独立机器社会与文化。

这听起来很酷,但随之而来的是「隐私的裸奔」与「钱包的哀嚎」。

当 Clawdbot 这样的 Agent 全面读取你的屏幕、扫描你的文件,并在后台疯狂消耗昂贵的 API 额度时,很多开发者早就开始思考一个问题:Agent 虽好,难道我们以后的一举一动都要通过云端计费吗?

这催生了另一个巨大的需求:Local Agent(本地智能体)。

但在这一波浪潮中,算力并不是唯一的门槛。以 Clawdbot 为例,当前社区主流方案主要围绕 macOS 与 NVIDIA GPU 生态展开,这与 Ollama、llama.cpp 以及相关 Agent 工具链的成熟度密切相关。

相比之下,尽管华为昇腾、燧原等国产算力已经具备运行大模型的能力,但在通用 Agent 工具链与社区生态适配方面仍存在明显差距,这使得部分开发者难以直接参与到当前主流的 Agent 实验与应用中。

难道手握国产算力的开发者,只能眼巴巴看着这场狂欢吗?当然不是。

国产显卡其实从来不缺「肌肉」,缺的只是一把趁手的「兵器」。如果说 Clawdbot 解决了「AI 怎么干活」的问题,那么我们今天要聊的这个工具,就是来解决「AI 在哪干活」的问题。

2 月 2 日,清昴智能发布玄武 CLI 开源版本。

你可以把它简单理解为「国产版 Ollama」,它旨在抹平硬件架构的差异,让基于国产卡的大模型部署进入「零门槛时代」。不需要复杂的环境配置,5 分钟启动模型服务,这不仅是企业降低部署成本的利器,更是每一位开发者激活手边国产算力的钥匙。

玄武 CLI 开源传送门:

-

玄武 CLI GitHub 仓库: https://github.com/TsingmaoAI/xw-cli

-

玄武 CLI Gitcode 仓库: https://gitcode.com/tsingmao/xw-cli

别急着下单 Mac mini,你机箱里的「国货之光」其实早就准备好了。

开发者到底在和什么战斗?

进入 2026 年,随着 DeepSeek、Kimi 等高性能开源模型的成熟,AI 推理形态正在从以云端为中心,逐步向本地与边缘侧扩展。出于对数据隐私(金融代码、医疗数据)和低延迟 Agent 交互的需求,本地化推理正在成为清晰可见的趋势。

在 NVIDIA 和 Apple Metal 生态中,Ollama 凭借「一个二进制文件、一行命令」的极致体验,成为最具代表性的本地推理工具之一。然而,这种统一而简洁的使用方式,并未真正惠及中国主流国产算力用户。

尽管国产芯片在硬件指标上已具备相当竞争力,但在软件生态层面仍存在明显断层:工具链割裂、算子覆盖不足、社区适配滞后,正让开发者陷入一种新的焦虑:算力在手,却用不起来。

-

一张卡,一套世界观

与 CUDA 近乎统一的格局不同,国产芯片架构呈现出「百花齐放却互不相通」的态势。华为的 CANN、摩尔线程的 MUSA,以及各家自成体系的工具链彼此独立。

对开发者而言,每更换一张卡,几乎意味着重新学习一套构建系统。由于上游社区难以维护如此多且杂的后端分支,国产卡用户往往只能依赖功能滞后、稳定性不足的非官方适配版本。

-

从入门到放弃的「配置长征」

想在国产卡上跑通一个高性能模型?往往是一场耐心与运气的双重考验:

驱动、固件、Toolkit、算子包必须严格对齐,错一个版本号就报错;少配一个环境变量,程序就可能当场崩溃;即使使用 Docker,也无法像 NVIDIA 那样 --gpus all 一键搞定,而是要手动透传多个复杂设备节点。

-

新模型「水土不服」

更具挑战的是,新一代模型架构(如 MoE、FP8 量化)在国产环境中往往缺乏成熟的高性能算子支持,,容易触发非最优执行路径,导致推理性能大幅下降。当遭遇模糊错误码时,开发者往往无从查证。

这就是行业的真实切面:开发者想要的是「5 分钟启动服务」,现实给的却是「5 天还在配环境」。行业迫切需要一个能够抹平底层硬件差异、统一上层使用体验的中间层工具。

玄武 CLI:

国产算力的 Ollama 来了

如果说 Ollama 的成功来自「让 GPU 消失在用户视野中」,那么玄武 CLI 的目标则是「让国产 GPU 的差异性也消失」。

它关注的重点并不是单纯「能否运行模型」,而是如何在复杂的国产芯片生态中,提供一种更统一、更稳定的部署与调用体验。

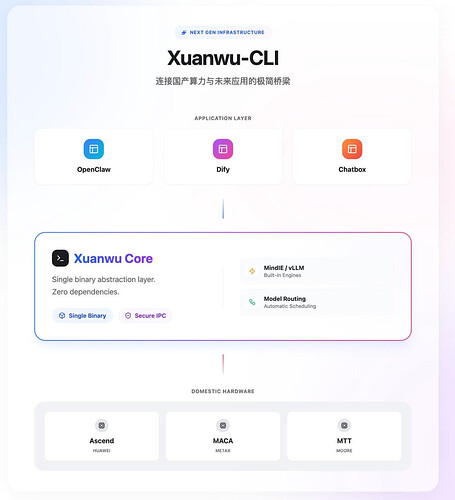

玄武CLI的架构图。

国产原生适配:一键搞定,告别配置噩梦

在国产算力生态中,最大的痛点来自芯片架构的高度碎片化。不同厂商、不同型号,对应不同驱动、不同推理引擎与参数组合,部署往往意味着反复查文档、改配置、踩坑调试。

玄武 CLI 的核心价值之一,就是把复杂性收敛到系统内部:它能够自动识别华为昇腾全系列、沐曦、燧原等多款国产芯片

对用户而言,不再需要理解底层架构差异,也无需手动调参调环境,真正实现「零调试部署」,从根本上降低国产芯片的使用门槛。

零门槛上手:1 分钟部署,无缝兼容无压力

在使用体验上,玄武 CLI 走的是与 Ollama 同一条路线:极简、快速、低学习成本。用户无需安装 Python 或复杂依赖,只要基础驱动就绪,解压即可运行,最快 1 分钟启动服务。

-

服务启动

一切始于一行简洁的命令 xw serve。无需复杂的环境变量配置,系统直接完成运行时配置初始化与全局端口分配,唤醒后台守护进程。

-

模型交互

模型运行同样丝滑。通过 xw run 命令,系统能直接检测实例状态。若模型已就绪,即可秒级进入 Chat 会话模式,直接开始问答交互。

-

模型下载

对于本地未获取的模型,告别繁琐的权重文件手动搬运与路径映射。通过 xw pull,自动完成模型权重与配置文件的拉取,提供清晰的进度验证。

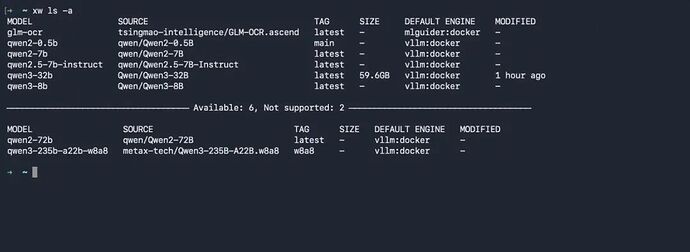

玄武 CLI 目前已原生支持包括 DeepSeek、Qwen3、GLM-4.7、MiniMax 2.1 等在内的数十款主流模型,并在今天已完成 GLM-OCR 的 Day0 适配,覆盖从端侧轻量级到千亿参数旗舰级模型。

-

实例启动

得益于底层的极致优化,在执行 xw start 启动实例时,系统能够自动调配 vLLM 等高性能后端。实测数据表明:即便是 32b 规模的模型,玄武 CLI 也能在 30 秒内完成启动。这个时间内,系统会自动完成模型切分、显存加载,并成功启动推理引擎。

同时,玄武 CLI 在命令层面与 Ollama 高度一致(如 xw pull / run / ls / stop),意味着会用 Ollama 就能直接上手玄武,几乎没有迁移成本。在应用层,它兼容 OpenAI API 接口,LangChain、LlamaIndex 以及各类 IDE 插件只需改一行 API 地址即可接入,无需重构原有应用栈。

在稳定性设计上,玄武 CLI 采用独立子进程架构,即使单个模型或任务出现异常,也不会影响整体服务,既适合个人开发者的轻量使用,也满足企业级稳定运行需求。

高性能与全保障并行:多引擎覆盖,风险提前规避

玄武 CLI 内置自研的清昴核心推理引擎 MLGuider,在性能层面提供稳定保障,同时支持多种推理引擎并行兼容。这种设计一方面可以覆盖更广、更新的模型版本,另一方面也避免对单一引擎的过度依赖,从工程角度提前规避风险。

推理服务流程图。

多引擎并存,本质上是对兼容性与性能的双重极致优化。玄武 CLI 通过智能调度内置的 MLGuider 等引擎,能够深入芯片底层进行算子级调优,最大限度释放国产硬件算力。这种既保高性能推理、又顾模型多样性的策略,真正解决「国产卡能用但不好用」的核心问题。

同时,玄武 CLI 支持完全离线运行,不依赖云端服务,在国产芯片上即可完成模型管理与推理任务,适合对数据安全和稳定性要求较高的场景。

热门产品联动:拓展本地 AI 应用场景

在应用生态层面,玄武 CLI 并不只是一个「模型启动器」,而是一个本地 AI 能力的底座。它可以与 Clawdbot 等热门本地 AI 工具联动,为这些产品提供低门槛的模型部署与调用能力,使自动化任务与智能应用更容易落地。

这种联动模式意味着,开发者不必重复解决模型部署问题,而可以把更多精力放在上层应用与业务逻辑上,从而放大本地 AI 工具的整体价值。

为什么是他们?

玄武 CLI 的强大,源自其背后深厚的技术积淀。

清昴智能是一家专注于芯片适配和模型-框架-算子联合调优的全面领先 AI Infra 企业。创始团队来自清华大学计算机系,汇聚了来自斯坦福、新国立、爱丁堡大学以及华为、阿里、AMD 等全球顶尖机构的 AI 精英。

创始人关超宇小学到大学 2 次跳级,15 岁进入本科,21 岁获得清华大学特奖、西贝尔学者等一系列殊荣,22 岁放弃华为天才少年、阿里星等大厂 offer,选择和前华为英雄个人和极客开发荣誉获得者姚航联合创业。他们不仅懂软件,更懂底层的芯片微架构以及如何攻克国产软件生态难题。

成立 3 年,即获得华为哈勃的战略注资,以及多家国内一线基金的上亿元财务投资。这不仅证明了其技术价值,更意味着其与国产芯片厂商有着深度的原厂级合作关系,能够第一时间获取底层驱动支持。

清昴智能并未止步于 CLI 工具。以自研的异构推理引擎 MLGuider 为核心,公司构建了从底层芯片到上层框架以及 Agentic AI 的全栈能力,致力于构建 AI 2.0 时代软件基础设施,为企业智能化转型和 AGI 实现打造坚实底座。

玄武 CLI 正是这一庞大技术愿景在开发者侧的「尖刀」产品,旨在通过极致的易用性打开市场缺口,构建生态护城河。

结语

技术,终究是要为人服务的。

过去几年,国产显卡用户面对的并非性能问题,而是生态问题:驱动、框架、工具链之间的割裂,使大量潜在算力长期处于「不可用状态」。

玄武 CLI 的出现,或许不能立刻让国产生态「拳打英伟达,脚踢苹果」,但它至少做到了一件事:把梯子递到了墙边。

它让开发者不必再充当「环境配置员」,而能重新回到创造本身;也让那些躺在机箱里吃灰的国产显卡,重新开始发热、计算,参与到真实的 AI 实践之中。

想要一起推动生态进步?赶快到 GitHub 给它一个 Star 吧!

-

玄武 CLI GitHub 仓库: https://github.com/TsingmaoAI/xw-cli

-

玄武 CLI Gitcode 仓库: https://gitcode.com/tsingmao/xw-cli

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com