北大与中科院提出机器人操作评估新范式Eval-Actions与AutoEval,解决执行质量模糊和来源真实性问题,告别单一成功率指标。

原文标题:机器人具身操作评估新范式来了,从此告别单一成功率指标

原文作者:机器之心

冷月清谈:

怜星夜思:

2、Eval-Actions基准引入了失败场景数据,这与传统数据集只关注成功演示有什么不同?为什么包含失败数据对于机器人学习错误恢复至关重要?

3、AutoEval-S通过时空聚合策略和物理信号校准来捕捉动作细节,那么,除了文中提到的速度和加速度方差,还有哪些物理信号可以用来提升机器人操作评估的精度?

原文内容

作者介绍:刘梦源,北京大学深圳研究生院研究员,研究领域为人类行为理解与机器人技能学习;盛举义,北京大学在读博士研究生,研究方向为机器人操作技能学习方法研究;王梓懿、李培铭,北京大学在读硕士研究生,研究方向为视频理解分析;徐天铭,北京大学在读硕士研究生,研究方向为机器人操作技能学习方法研究;徐天添,中国科学院深圳先进技术研究院集成所研究员,研究领域为磁控微型机器人导航、机器人的协同控制等;刘宏,北京大学深圳研究生院教授,研究领域为计算机视觉与智能机器人、机器学习与智能人机交互。

-

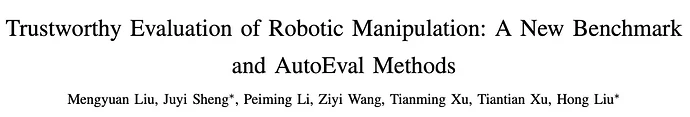

论文标题:Trustworthy Evaluation of Robotic Manipulation: A New Benchmark and AutoEval Methods

-

论文链接:https://arxiv.org/abs/2601.18723

-

代码链接: https://github.com/LogSSim/TERM-Bench

随着 Vision-Action (VA) 和 Vision-Language-Action (VLA) 模型的爆发,机器人模仿学习取得了长足进步。然而,当前的评估体系却面临着严重的「信任危机」。现有的评估范式主要依赖二元的「成功率(Success Rate)」,这种简单的指标掩盖了两个关键问题:

-

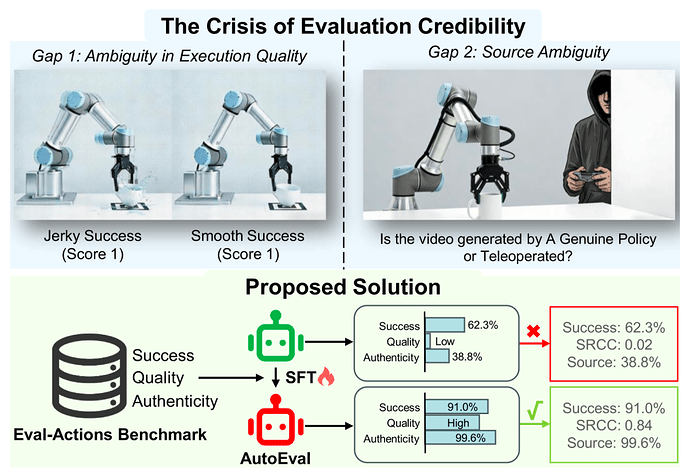

执行质量的模糊性(Gap 1):同样是「成功」完成任务,模型 A 可能动作僵硬、伴随剧烈抖动(Jerky Success),而模型 B 则行云流水。传统的二元评价无法区分二者,导致潜在的安全隐患被忽视。

-

来源的模糊性(Gap 2):在一些已有的展示视频中,不仅难以判断动作是否由真正的自主策略生成,甚至难以分辨其是否由人类远程操作(Teleoperation)「冒充」。

为了解决上述评估信任危机,北大与中科院团队提出了一套完整的解决方案:Eval-Actions 评估基准与 AutoEval 自动化评估架构。该方案旨在从「细粒度动作质量」和「来源真实性」两个维度,重塑机器人操作的评估标准。

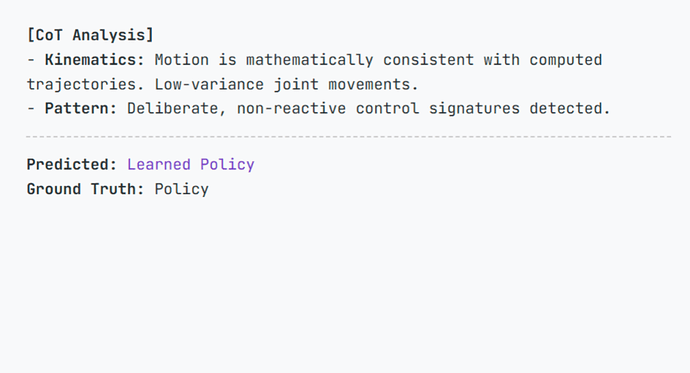

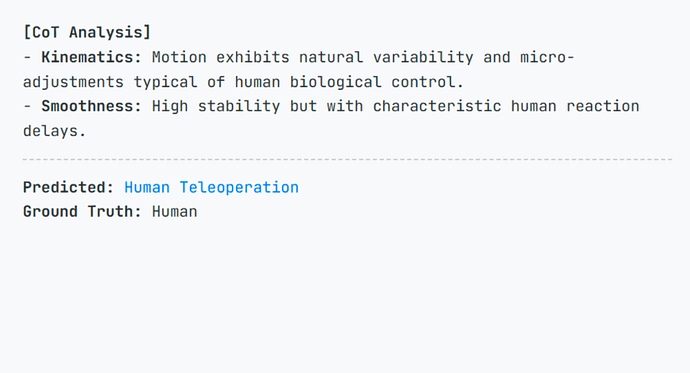

图 1 (上) 评估危机:现有二元指标掩盖了执行质量(如「抖动成功」与「平滑成功」的区别)和来源真实性(难以区分策略生成与人类遥操作)的模糊性。 (下) 解决方案:Eval-Actions 基准与 AutoEval 架构(绿色部分)相结合,填补了这两大空白,实现了精准的细粒度质量评估与鲁棒的来源验证,显著优于传统的通用 VLM(红色部分)。

填补空白:首个面向评估完整性的 Eval-Actions 基准

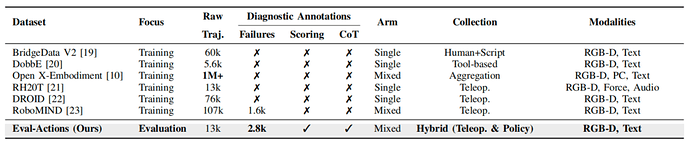

表格 1 机器人操作数据集的对比分析。与以模型训练为核心、追求原始轨迹数据量最大化的数据集不同,Eval-Actions 以标注密度最大化为设计目标,独有的优势在于提供故障场景数据、混合轨迹数据源。

为了打破现有数据集仅关注「成功演示」的局限,研究团队构建了 Eval-Actions 基准。与 Open X-Embodiment 等以训练为目的的数据集不同,Eval-Actions 专为诊断性评估而生。

-

包含失败场景:数据集不仅包含成功的轨迹,还创新性地引入了约 2.8k 条失败数据。这对于模型学习错误恢复和鲁棒的失败检测至关重要 。

-

混合来源验证:数据集混合了人类遥操作数据与多种策略(VA 及 VLA 模型)生成的轨迹,为验证「来源真实性」提供了数据基础。

-

多维监督信号:提供了专家评分(Expert Grading)、排序引导(Rank-Guided)以及思维链(Chain-of-Thought, CoT)三种层次的注释,支持从数值评分到逻辑推理的全方位评估。

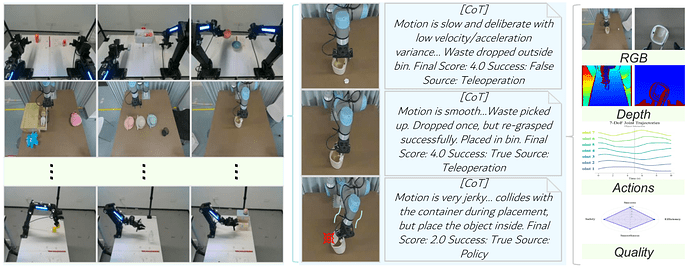

图 2 Eval-Actions 基准概览。包含从单臂到双臂的 150 + 任务,并提供细粒度的质量雷达图与 CoT 注释。

AutoEval:双引擎驱动的自动化评估专家

为了实现对机器人行为的精准诊断,团队设计了 AutoEval 框架。它并未采用单一模型,而是针对不同的评估维度,创新性地提出了 AutoEval-S 和 AutoEval-P 两种架构,分别解决「看不清细节」和「胡乱推理」的难题。

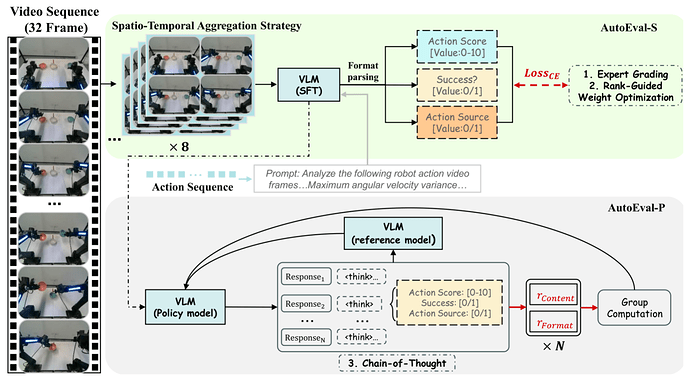

1. AutoEval-S:精准捕捉动作细节

传统的 VLA 模型往往只能处理稀疏的关键帧,容易遗漏动作执行过程中的抖动或停顿。AutoEval-S(Small)引入了时空聚合策略(Spatio-Temporal Aggregation)。

-

高频细节压缩:它并没有简单丢弃中间帧,而是将高频的运动细节「压缩」 进视觉 Token 中,最大化了时间信息的密度。

-

物理信号校准:辅以运动学校准信号(Kinematic Calibration Signal),直接利用速度和加速度方差等物理数据来校准视觉评估,确保评分精准反映动作的平滑度与安全性。

2. AutoEval-P:具备逻辑推理能力的「考官」

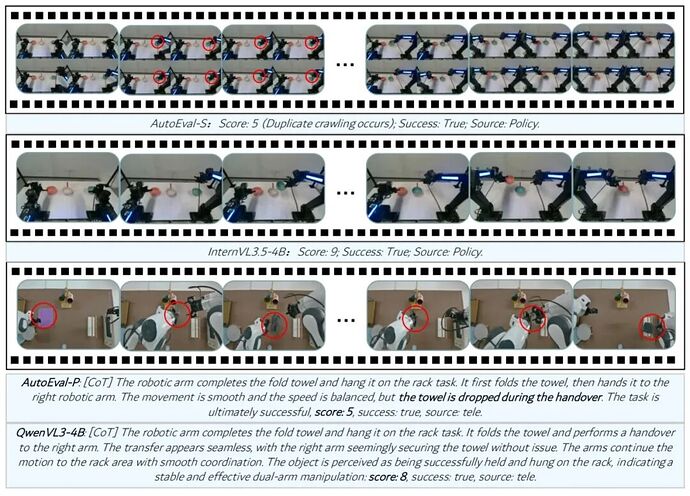

当需要模型输出思维链(CoT)进行解释时,传统模型常出现「幻觉」,即推理逻辑与打分不一致(例如嘴上说「动作完美」,实际上物体已经掉了)。AutoEval-P(Plus)引入了组相对策略优化(GRPO)范式。

-

强制言行一致:通过强化学习,AutoEval-P 被训练在生成评分的同时,必须给出逻辑自洽的物理推理。其混合奖励函数(Hybrid Reward Function)同时约束内容的准确性和格式的规范性,有效消除了大模型的推理幻觉。

图 3 上分支 (AutoEval-S):专为评分与排序设计。采用时空聚合策略将高频运动细节压缩至视觉 Token,并辅以物理校准信号,精准捕捉动作中的细微抖动。下分支 (AutoEval-P):专为思维链(CoT)推理设计。引入 GRPO 强化学习范式,通过混合奖励函数(内容 + 格式)强制模型生成逻辑自洽的物理推理与评分,有效解决大模型的「幻觉」问题 。

实验结果:树立可信评估新标准

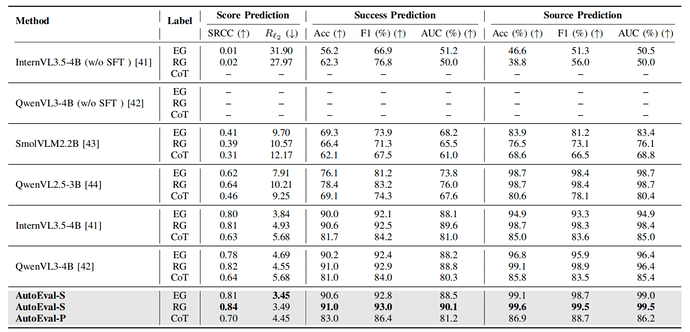

在 Eval-Actions Small (EAS) 子集上的广泛实验表明,AutoEval 框架在多项指标上展现出卓越性能,全面超越了 InternVL、QwenVL 等通用大模型 。

1. 极高的来源辨别力:让「造假」无处遁形

AutoEval 能够以 99.6% 的准确率区分视频是来自真实的策略生成还是人类遥操作,有效解决了「来源模糊性」问题,为机器人社区提供了一套权威的防伪工具。

2. 细粒度评分高度对齐人类

在衡量动作平滑度、安全性和效率的综合质量评分上,AutoEval-S 与人类专家的判断高度一致。

-

在专家评分(EG)协议下,SRCC 达到 0.81 。

-

在排序引导(RG)协议下,SRCC 高达 0.84,显著优于未微调的 InternVL3.5-4B (SRCC ≈ 0.02) 和 QwenVL3-4B。

表格 2 Eval-Actions 基准上的性能对比 在专家评分(EG)、排序引导(RG)及思维链(CoT)三种协议下,AutoEval 均取得了 SOTA 性能。特别是在 RG 协议下,AutoEval-S 的评分相关性(SRCC)达到 0.84,来源预测准确率高达 99.6%,远超未微调的 InternVL 和 QwenVL 等基线模型。

图 4 细粒度动作质量评估的定性对比

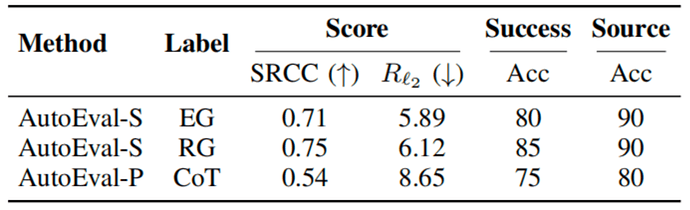

3. 跨构型泛化能力

即使在未见过的 Franka 机器人数据上,AutoEval 依然保持了稳健的评估能力。AutoEval-S 在新形态机器人上仍能达到 0.75 的评分相关性(SRCC)和 90% 的来源预测准确率,展现了强大的跨实体泛化潜力 。

表格 3 AutoEval 在未见构型 Franka 机械臂数据上的泛化实验结果

4. 区分远程操作和策略执行视频

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com