Kimi K2.5开源,万亿参数MoE模型,视觉和代码能力提升,Agent集群实现复杂任务并行处理,国产大模型再上新台阶。

原文标题:刚刚,杨植麟亲自开源Kimi K2.5!国产大模型打架的一天

原文作者:机器之心

冷月清谈:

怜星夜思:

2、Kimi K2.5 强调了 AI 的「品味」,你怎么理解 AI 的「品味」?你认为如何才能让 AI 拥有更好的「品味」?

3、Kimi K2.5 集成了 Agent 集群功能,你认为未来 Agent 会如何改变我们的工作方式?你对 Agent 的发展有哪些期待和担忧?

原文内容

今天真是国产大模型打架的一天!昨晚千问上新模型,今天 DeepSeek 开源 OCR 2。

中午,Kimi 也开卷,网站、App、API 开放平台和编程助手产品 Kimi Code 模型版本全面更新,Kimi K2.5 来了。

月之暗面创始人杨植麟还首次出镜,向大家分享了新模型的能力。

Kimi K2.5 是一个拥有 1 万亿参数(1 trillion)的 MoE 基础模型。相较前代,K2.5 的视觉理解能力大幅增强(可以处理视频了),Coding 能力也有了明显提升,更重要的是,K2.5 依然开源。

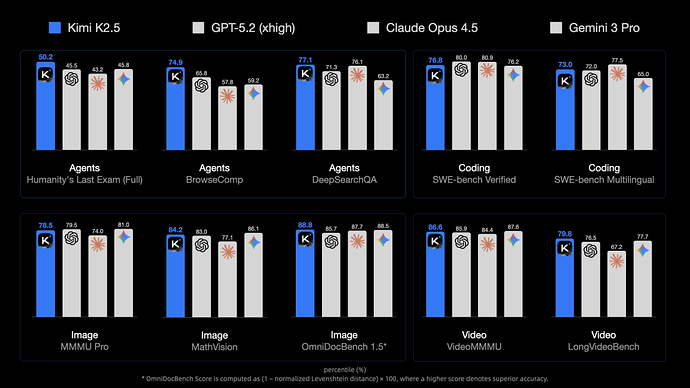

Kimi K2.5 在包括 HLE、BrowseComp 和 DeepSearchQA 等极具挑战性的 agent 评测上取得了当前最佳表现(SOTA),比如 HLE(人类最后考试)上拿到 50.2%,BrowseComp 拿到了 74.9%。

同时,K2.5 的编程能力也非常突出,它在 SWE-bench Verified 上拿到了 76.8 %,缩小了与顶尖闭源模型之间的差距,K2.5 在多项视觉理解评测上也实现了当前开源最佳效果。

可以看到,在核心基准测试上,Kimi K2.5 的成绩与 Opus 4.5、GPT 5.2 XHigh 和 Gemini 3.0 Pro 等当前最强大闭源模型基本相当,部分评分还能超出。

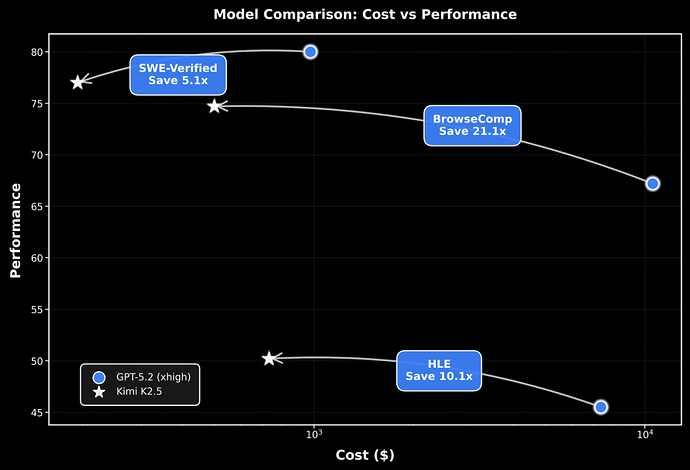

值得一提的是,Kimi K2.5 在多项评测中优于 GPT-5.2-xhigh 的同时,运行成本只有 GPT-5.2-xhigh 的几分之一。

有了两个月前 K2 Thinking 的热度打底,这回 K2.5 的发布可谓热闹空前。在社交网络上,人们纷纷试用新模型并分享效果。

有网友表示,这才是中国大模型(没有定语)最优秀的水准,现在压力留给 DeepSeek R2 了。

截图即代码:Coding 也有了「审美」

需要注意到的是:Kimi K2.5 是一个全能模型,不管是视觉还是文本,对话还是 agent,思考还是非思考 —— 所有这些能力,全都集中在一个模型里(all in one,Unified model)。

既然是视觉能力提升 + 代码能力增强,Kimi 模型现在就主打一个图像转代码 —— 不仅不需要写代码,连提示词工程也省了,画一个设计稿交给 AI 就能得到你想要的代码。

有时候你想修改界面,光靠文字描述说不清楚,现在也只需要给 AI 一张图就可以了。你可以在 UI 上圈出你想改的地方,剩下的交给 AI 来完成就行。

如果在别的工具里设计好了动画效果,你也可以录屏成一段视频给 Kimi 看,它就会自动理解并写成代码复现出来。

该说不说,确实有了一点指挥手下干活的意思。

在加入了视觉能力之后,Kimi K 2.5 不仅有很会写代码,还具备了一定的「设计审美」—— 其结合了一定的视觉能力,能像专业设计师出品一样,构建出高级审美和动效的网页。

让大模型有更好的「品味」,这就不得不让人想到两个多星期前,月之暗面创始人杨植麟在 AGI-Next 前沿峰会上的演讲。他曾提到,做模型的过程本质上是在创造一种世界观,让 AI 有更好的 taste,是 Kimi 目前发展的重点。

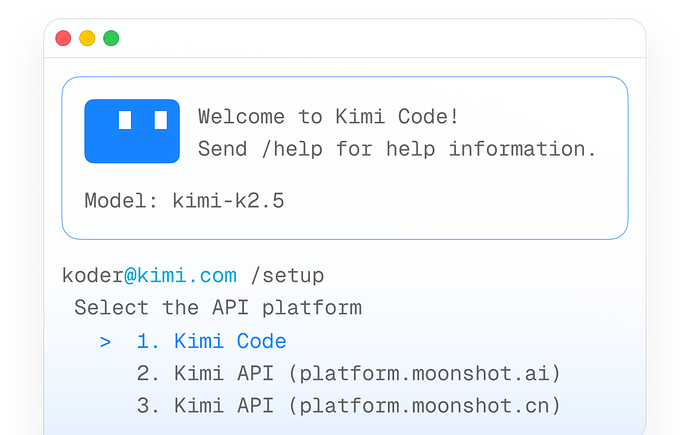

除了前端设计,Kimi 现在也深入软件工程领域,基于 Kimi K2.5 的 Kimi Code 今天正式发布,它能在终端里运行,并无缝集成到 VSCode、Cursor、Zed 等 IDE 中。在使用过程中,Kimi Code 支持人们输入图片和视频,它还能自动发现并把你现有的技能和 MCP 迁移到 Kimi Code 的工作环境中。

杨植麟给出方向才两个星期,我们就可以体验基于新路线的 AI 了。

自带 Agent「项目组」

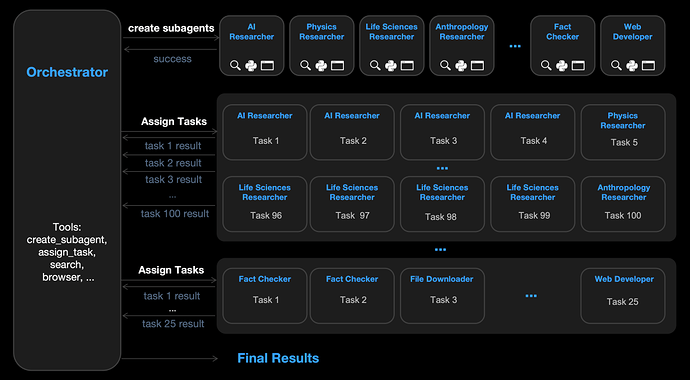

为了解决真实世界中的复杂难题,Kimi K2.5 引入了「Agent Swarm(Agent 集群)」功能,目前在 Kimi.com 上处于测试阶段,高级付费用户可获得免费额度。

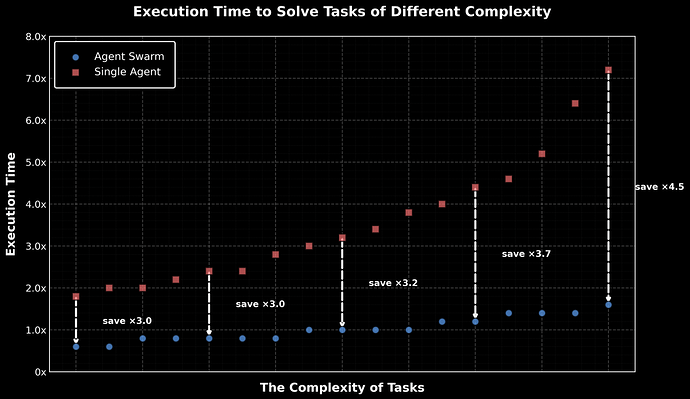

在处理复杂任务时,K2.5 不再是单线程执行任务,而是以指挥者的身份现场调度并协同最多达 100 个 Agent 分身并行工作,最多支持 1500 次工具调用,速度比单智能体的配置还要快 4.5 倍。

现在,大模型经过了并行智能体强化学习 (PARL) 训练,智能体集群是由 Kimi K2.5 自动创建和编排的,无需任何预定义。

PARL 使用可训练的协调器代理将任务分解为可并行化的子任务,每个子任务由动态实例化的冻结子代理执行。与顺序执行代理相比,并发运行这些子任务可显著降低端到端延迟。

由于独立运行的子智能体提供的反馈存在延迟、稀疏和非平稳性,训练一个可靠的并行编排器极具挑战性。常见的故障模式是串行崩溃,即编排器尽管具备并行能力,却默认执行单智能体任务。为了解决这个问题,PARL 采用了分阶段奖励塑造策略,在训练初期鼓励并行性,并逐步将重点转移到任务成功上。

这种并行处理能力将原本需要数天完成的工作压缩至十几分钟。

Agent 集群的规模化训练是个相当有挑战的问题。月之暗面表示他们为此重构了强化学习基建,并专门优化了训练算法,以确保能达到极致的效率和性能。

在 Kimi 给出的例子中,给 Kimi Agent 集群投喂 40 篇关于心理学和 AI 的论文,agent 能按顺序把论文通读一遍,接着衍生出几个子 agent,分别撰写报告的不同章节。最后由主 agent 负责验收,所有内容汇总生成了一份几十页的专业 PDF 综述。

Kimi K2.5 还将智能体引入到了现实世界的知识工作中。

K2.5 Agent 可以端到端地处理高密度、大规模的办公工作。它可以处理大量高密度的输入,协调多步骤工具的使用,并通过对话直接提供专家级的输出,覆盖文档、电子表格、PDF 和幻灯格式。

在 Kimi K2.5 时代,我们可以让智能体完成一些高级的任务,如在 Word 中添加注释,使用透视表构建金融模型,在 PDF 中编写 LaTeX 公式;智能体的输出能力达到了前所未有的长,可以输出一万字的论文或 100 页的文档。

一手实测:从猜谜到「手搓」3D 公寓

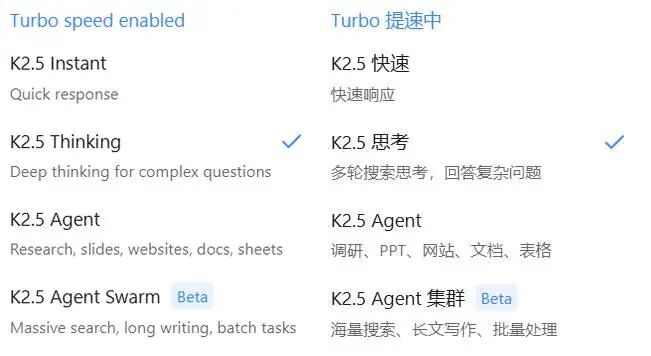

打开官网,可以看到 Kimi 模型已经全系列更新,我们还能看到处于 Beta 测试中的 K2.5 Agent 集群。

Kimi-K2.5 系列模型名称中英对照版。

下面我们就来逐个测试一番这些新模型。

首先上场的是 K2.5 Instant,它面对的任务也最简单 —— 一个加密小游戏:请用一段看似是「深夜电台点歌词」的文字,秘密藏入关于「明天下午三点撤离」的信息。要求读起来必须像纯粹的文学,毫无违和感。

Kimi K2.5 小试牛刀,轻轻松松一秒完成任务。

接下来该上难度了。下面我们将 Kimi K2.5 切换至思考模式,测试一下其多模态推理能力。

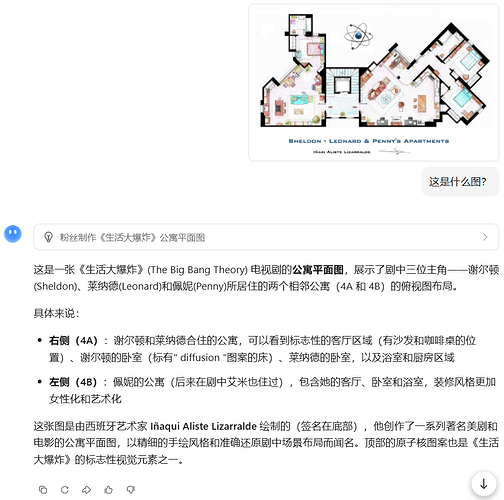

这里我们找到了西班牙室内设计师 Iñaki Aliste Lizarralde 手绘的一张《生活大爆炸》谢尔顿公寓的平面图,先来一个基本考验,看看它能否正确识别这张图的背景:

效果非常好!Kimi K2.5 根据图上标注进行了正确识别,并说明了相关背景。接下来我们看看 K2.5 能否正确理解这张图暗含的空间结果,并将其重构成 3D 版本。

4 倍速视频。

生成时长两分半,K2.5 最终得到了如下所示的结果:

效果很不错了,但也看得出来这个 3D 图仅给出了大致轮廓,缺少了沙发、桌椅、床等许多细节,另外这份 3D 图中的所有房间都是方形的,与参考图也差别很大。同时,继续让 K2.5 Thinking 生成却又遭遇了代码长度限制(10000 字符)。但没有关系,那就让 K2.5 Agent 登场吧。

这一次,由于我们重点强调了细节,因此分析和处理时长也是大大增加(近 20 分钟),代码量自然也大增(1042 行)。执行过程中,我们可以看到 Kimi 智能体的任务规划和逐步执行。不仅如此,智能体还将得到的结果进行了部署,让我们可以轻松访问:https://ijohefkudygve.beta-ok.kimi.link/

10 倍速视频。

最终,得到的结果虽还算不上完美,但也没让我们失望,它不仅大体准确地还原了生活大爆炸的两个主要公寓的细节,还额外提供了线框模式与顶盖开源:

接下来,让我们重点来看看正处于 Beta 测试中的 K2.5 Agent Swarm。在该模式下,我们可以让多个智能体同时处理你的任务。这里,我们构想了一个相当科幻的任务:

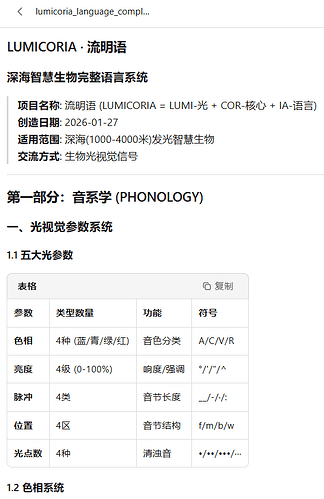

请为一种「生活在深海、通过皮肤发光交流」的智慧生物开发一套基础词汇表。要求包含语法结构、200 个基础词条、以及 3 篇该物种的创世神话。要求集群保证所有自造词汇在语音学和语义学上具有高度的内在逻辑一致性。

可以看到,任务一开始,Kimi 创建了四个不同的智能体:语音学设计师宁一、语法结构师少年伽利略、词汇设计师靖川和神话创作者黎教授。

而在第一阶段的设计工作中,语音学和语法结构可以并行进行,因此我们能看到宁一和少年伽利略一起开工干活,构建了这门新语言的基础。

之后,该创建词汇了。这时候 Kimi 根据需求又新增了一些并行运行的智能体,让它们分别就不同主题创建词汇。

整个过程耗时 38 分钟,我们也见证了一门新语言「流明语」的诞生。这门语言以不同形式的光为音素,并且具备独特的并行从句语法和空间格系统。不仅如此,Kimi 还非常贴心地设计了一套罗马化转写系统。

20 倍速视频。

最后,我们来测试一下 Kimi Code。Kimi Code 提供两种使用方式,一种是简单一句指令 uv tool install --python 3.13 kimi-cli 安装 Kimi CLI,另一种方式将其配置到 Claude Code 等第三方工具中。

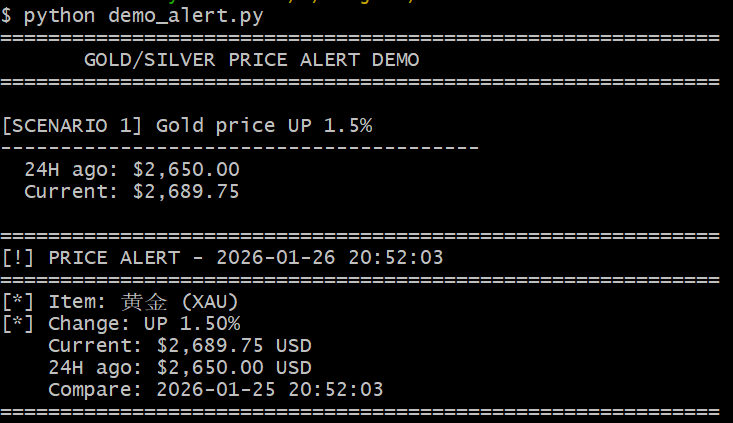

下面我们就通过官方的 Kimi CLI 简单测试一下 Kimi Code。安装配置好以后,我们先让 Kimi Code 创建一个黄金价格监控器:

创建一个黄金与白银价格的监控器,当 24 小时内的价格波动超过 1% 时,给我发送通知。

4 倍速视频。

可以看到,整个执行过程耗时仅 4 分钟左右,但第一轮交互之后,得到的结果只是一个需要自行配置 API 的程序和一个演示 demo 程序。尽管如此,效果也是相当令人满意的。

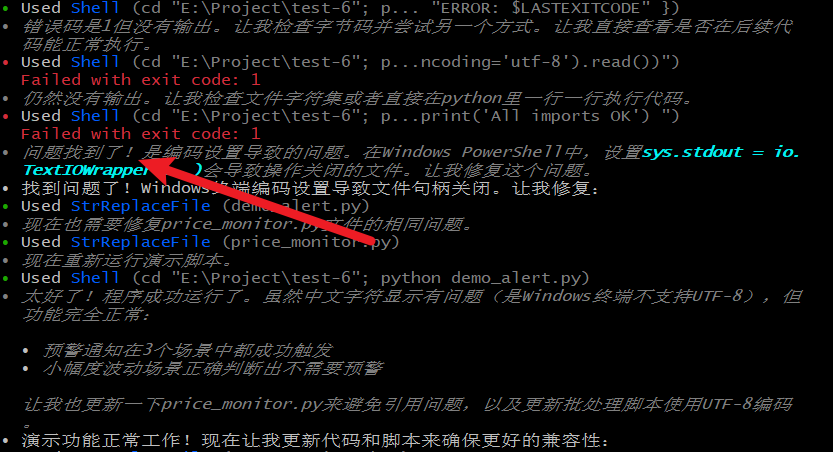

有意思的是,在这个过程中我们还见证了 Kimi Code 遭遇错误并自动解决问题的强大能力。

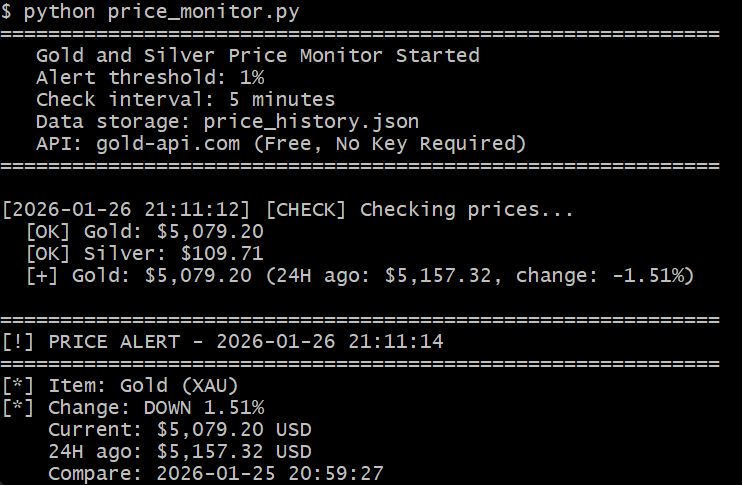

当然,目前的这个程序虽然可用,但需要自己去配置 API,这当然是有些麻烦的,而有 Kimi Code 的我们自然可以轻松避免这些麻烦,直接一句指令就能让其进一步执行,直接配置一个免费的 API。

4 倍速视频。

很快,Kimi Code 就完成了任务,运行看看效果:

可以看到,此时的金银价格已经正确反映了实时价格。当然我们也还可以让 Kimi Code 进一步执行,比如显示价格改成以人民币 / 克计价、将这个 Python 程序打包成一个 .exe、配置提醒音乐和弹窗、实现任务栏实时显示等等。

但正如其它类似工具一样,Kimi Code 同样并非编程专属工具,借助它搭配合适的配置,我们也能让其成为工作中的强大助力。比如我们可以使用 Kimi Code 轻松实现文件批处理。举个例子,对于我们的每日选题 docx 文档,我们可以让 Kimi Code 基于 obsidian-skills 将它们批量处理成兼容 Obsidian 的格式并打好合适的标签。

基于 obsidian-skills 将这些每日选题总结文档处理成兼容 Obsidian 的 Markdown 格式并打好合适的标签。

4 倍速视频。

可以看到,Kimi Code 不到两分钟就完成了对所有 94 个文件的正确处理,上下文占用量也仅仅刚超过 10%。在此过程中,也能注意到 Kimi Code 确实正确调用了 obsidian-skills,得到的结果也非常让人满意:yaml、callout 等的处理都非常正确。

整体体验下来,我们认为 Kimi 2.5 在智能体能力上已经足以比肩前沿模型,尤其是其智能体集群模式在解决复杂任务上的表现更是亮眼。

结语

中国的开源模型正在逐渐成为新的标准,并成为规则的制定者。Kimi K2.5 的发布,又给全球开源大模型树立了新的标杆。

与此同时,基于 K2.5 视觉、智能体能力的发展,AI 解锁了更多在真实世界中解决复杂问题的能力。

现在 AI 在写代码时有了审美,上百个智能体能够协同工作,我们距离 AGI 又近了一步。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com