谷歌研究发现,DeepSeek-R1等模型的推理能力或源于内部“思维辩论”,模拟多智能体交互,通过对话行为和社会情绪角色提升解题准确率。

原文标题:DeepSeek-R1推理智能从哪儿来?谷歌新研究:模型内心多个角色吵翻了

原文作者:机器之心

冷月清谈:

怜星夜思:

2、研究中提到,当DeepSeek-R1面对更高难度的问题时,对话式行为和社会情绪角色会更加明显。这是否意味着我们可以通过提高问题的难度来激发模型的“思考能力”?

3、研究中提到通过激活值添加法对特征进行调控,从而影响模型的推理过程。这种方法有哪些潜在的应用场景?

原文内容

过去两年,大模型的推理能力出现了一次明显的跃迁。在数学、逻辑、多步规划等复杂任务上,推理模型如 OpenAI 的 o 系列、DeepSeek-R1、QwQ-32B,开始稳定拉开与传统指令微调模型的差距。直观来看,它们似乎只是思考得更久了:更长的 Chain-of-Thought、更高的 test-time compute,成为最常被引用的解释。

但如果把问题继续往深处追问:推理能力的本质,真的只是多算几步吗?

谷歌、芝加哥大学等机构的研究者最近发表的一篇论文给出了一个更具结构性的答案,推理能力的提升并非仅源于计算步数的增加,而是来自模型在推理过程中隐式模拟了一种复杂的、类多智能体的交互结构,他们称之为「思维社会」(society of thought)。

简单理解就是,这项研究发现,为了解决难题,推理模型有时会模拟不同角色之间的内部对话,就像他们数字大脑中的辩论队一样。他们争论、纠正对方、表达惊讶,并调和不同观点以达成正确答案。人类智能很可能是因为社交互动而进化的,而类似的直觉似乎也适用于人工智能!

通过对推理输出进行分类,以及结合作用于推理轨迹的机制可解释性方法,研究发现,诸如 DeepSeek-R1 和 QwQ-32B 等推理模型,相较于基线模型和仅进行指令微调的模型,展现出显著更高的视角多样性。在推理过程中,它们会激活更广泛、异质性更强的、与人格和专业知识相关的特征,并在这些特征之间产生更充分的冲突。

这种类多智能体的内部结构具体表现为一系列对话式行为,包括提问 — 回答序列、视角切换以及对冲突观点的整合;同时还体现在刻画激烈往返互动的社会情绪角色之中。这些行为通过直接与间接两种路径,共同促进了关键认知策略的运作,从而解释了推理任务中准确率优势的来源。

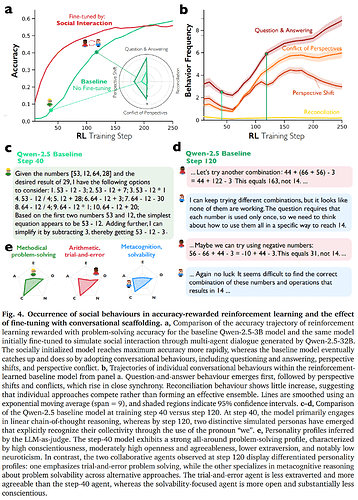

进一步的受控强化学习实验显示,即便仅以推理准确率作为奖励信号,基础模型也会自发地增加对话式行为;而在训练中引入对话式脚手架(conversational scaffolding),相较于未微调的基础模型以及采用独白式推理微调的模型,能够显著加速推理能力的提升。

这些结果表明,思维的社会化组织形式有助于对解空间进行更高效的探索。谷歌认为,推理模型在计算层面建立了一种与人类群体中的集体智能相对应的机制:在结构化的条件下,多样性能够带来更优的问题求解能力。

基于此,谷歌提出了通过智能体组织形式来系统性利用「群体智慧」的新研究方向。

论文地址:https://arxiv.org/pdf/2601.10825

同时,这一研究也给社区提供了一些启发。

方法概览

对话行为

本研究采用以 Gemini-2.5-Pro 模型作为评估器的方法,从推理轨迹中识别出四类对话行为:

1. 问答行为:指对话中先提出问题后给出回答的语列,例如「为什么……?因为……」「倘若…… 会怎样?那么……」

2. 视角转换:指对话过程中切换至新的想法、观点、假设或分析方法的行为。

3. 观点冲突:指表达出与其他观点不一致、纠正对方观点或观点间存在矛盾张力的情况,例如「等等,这肯定不对……」「这与…… 相矛盾」。

4. 观点调和:指将存在冲突的观点整合或梳理为连贯结论的情形,例如 「因此,若满足…… 条件,或许两种观点都成立」「结合这些见解……」以及「这就化解了观点间的矛盾……」

针对每条推理轨迹,大语言模型评估器会统计各类会话行为的独立出现次数,输出整数计数结果(无对应行为时计为 0)。

在这四类会话行为的标注上,Gemini-2.5-Pro 与 GPT-5.2 的结果展现出高度一致性。此外,Gemini-2.5-Pro 的标注结果与人工评分也具有一致性。

社会情感角色

本研究基于 Bales 互动过程分析(IPA)框架,对推理轨迹中社会情感角色的呈现情况展开分析。该框架将话语划分为 12 种互动角色类型,每种类型均在提示词中通过具体行为描述进行操作性定义。以 Gemini-2.5-Pro 模型构建的 LLM-as-judge 评估器,会分别统计这 12 类角色的独立出现次数;在核心分析环节,作者将这些统计结果进一步归总为四大高阶类别,具体如下:

-

信息给予类角色:包括提出建议、表达观点、提供导向。

-

信息征询类角色,包括征询建议、征询观点、征询导向。

-

积极情感类角色,包括展现团结、释放紧张、表示认同。

-

消极情感类角色,包括表现对抗、显露紧张、表示异议。

在核心分析采用的四大高阶 IPA 类别中,评分者间信度均达到较高水平。

为衡量推理轨迹中社会情感角色是否存在交互共现特征,作者针对两组角色组合计算 Jaccard 指数。该指数用于衡量模型是否会在同一条推理轨迹中协调互补性角色,而非孤立地使用单一角色。Jaccard 指数越高,代表模型的互动模式越均衡、趋近于对话形态;指数越低,则说明其推理过程更偏向单向、独白式的表达。

认知行为

本研究采用 Gemini-2.5-Pro 作为 LLM-as-judge 评估器,识别出四类此前已被证实对语言模型推理准确率存在影响的认知行为。

在测量环节,作者沿用了 Gandhi 等人使用的提示词与示例,该套材料的有效性已通过多名人工评分者验证。每类认知行为均在提示词中附带具体示例,以操作性定义的方式指导标注工作,具体如下:

-

结果核验:指推理链中明确将当前推导结果与目标答案进行比对的情形。提示词中给出的典型示例包括:「该推导过程得出结果 1,与目标值 22 不符」「由于计算结果 25 不等于目标值 22」。

-

路径回溯:指模型意识到当前推理路径无法得到正确结果,进而明确返回并尝试其他方法的情形。

-

子目标拆解:指模型将原问题分解为若干更小、可分步完成的中间目标的情形。

-

逆向推理:指模型从目标答案出发,反向推导至初始问题的情形。

在这四类认知推理行为的标注上,Gemini-2.5-Pro 与 GPT-5.2 的一致性处于良好至极佳区间。Gemini-2.5-Pro 的标注结果与人工评分也呈现出高度一致性。

上述信度评估的计算基于两类推理轨迹样本:一类是用于解决通用推理问题的 30 条推理轨迹,另一类是 Qwen-2.5-3B 模型在强化学习过程中生成的 50 条推理轨迹。

特征干预

为探究会话行为在推理过程中发挥的作用,作者采用稀疏自编码器(SAE),对模型激活空间内具有可解释性的特征进行识别与操控。稀疏自编码器可将神经网络的激活值分解为一组稀疏的线性特征,从而能够在不修改模型权重的前提下,对特定行为维度实施定向干预。本研究使用的稀疏自编码器,基于 DeepSeek-R1-Llama-8B 模型第 15 层的残差流激活值训练得到。

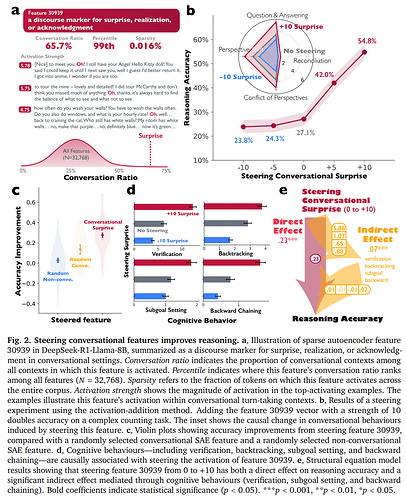

从候选特征中,作者最终选定了特征 30939。经大语言模型评估器归纳,该特征的定义为「用于表达惊讶、顿悟或认同的话语标记」。在涉及话轮转换与社交互动的语境中,当出现「Oh!」这类 token 时,该特征会被激活。特征 30939 的会话占比为 65.7%(在所有特征中处于第 99 百分位),同时具备高度稀疏性(仅在 0.016% 的 token 上激活),这表明该特征是会话现象所特有的,而非适用于通用语言模式的特征。

在文本生成阶段,作者通过激活值添加法对特征 30939 进行调控:在每个 token 的生成步骤中,将该特征的解码器向量按调控强度系数 s 进行缩放后,叠加至模型第 15 层的残差流激活值中。

实验结果

先说主要结论,本文证明了,即便在推理轨迹长度相近的条件下,推理模型依然表现出更高频率的对话式行为和社会情绪角色。

对话行为和社会情感角色

DeepSeek-R1 的推理过程中明显出现了视角切换和观点冲突,并通过诸如「不同意」「给出观点」「提供解释」等社会情绪角色加以体现,例如:「但这里是环己 - 1,3 - 二烯,而不是苯。」「另一种可能是高温会导致酮失去 CO 之类的反应,但不太可能。」

相比之下,DeepSeek-V3 在同一问题上的推理轨迹中,既没有视角冲突,也没有视角切换,更不存在分歧表达,只是以单线独白的方式连续给出观点和解释,且缺乏自我修正,缺少不完整的推理。

在一个创造性句子改写任务中,DeepSeek-R1 同样通过视角冲突展开不同写作风格之间的讨论,并伴随「不同意」「提出建议」等社会情绪角色,例如:「但那样加入了‘根深蒂固’,原句里并没有,我们应该避免添加新想法。」「等等,那不是一个词。」「不过要注意,‘cast’ 的力度不如 ‘flung’,所以我们用 ‘hurled’ 更合适。」

而 DeepSeek-V3 几乎没有出现冲突或分歧,只是给出若干建议,缺乏 DeepSeek-R1 中那种反复比较、逐步修正的过程。

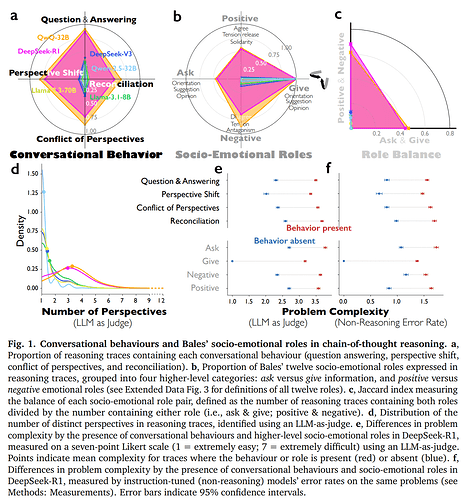

如图 1a 结果表明,DeepSeek-R1 和 QwQ-32B 的对话式行为出现频率显著高于各类指令微调模型。与 DeepSeek-V3 相比,DeepSeek-R1 在提问 — 回答(𝛽=0.345)、视角切换(𝛽=0.213)以及整合与调和(𝛽=0.191)方面均显著更频繁。QwQ-32B 相对于 Qwen-2.5-32B-IT 也呈现出高度一致的趋势,在提问 — 回答、视角切换、视角冲突和整合行为上均显著更多。值得注意的是,无论模型参数规模大小(8B、32B、70B 或 671B),所有指令微调模型的对话式行为出现频率都始终处于较低水平。

如图 1b 所示,与对应的指令微调模型相比,DeepSeek-R1 和 QwQ-32B 均展现出更具互惠性的社会情绪角色结构:它们既会提出问题、请求指引、意见和建议,也会给予回应,同时还表现出负向与正向的情绪角色。

指令微调模型主要以单向方式给出指引、观点和建议,几乎不进行反向提问,也缺乏情绪层面的互动,其推理过程更像是一段独白,而非对话的模拟。

本文进一步使用 Jaccard 指数来量化社会情绪角色的互惠平衡性。表明,DeepSeek-R1 在推理过程中更倾向于以互相协调的方式组织不同角色,而不是将它们孤立地、零散地使用。QwQ-32B 相对于 Qwen-2.5-32B-IT 也表现出一致的趋势。

进一步考察发现,当 DeepSeek-R1 面对更高难度的问题时,对话式行为和社会情绪角色会更加明显。

例如,在复杂度最高的任务中,如研究生水平的科学推理(GPQA)以及高难度数学题,模型展现出非常明显的对话特征;而在布尔表达式、基础逻辑推理等较为简单、程序化的任务中,对话行为则非常有限。

对话特征引导可提升推理准确率

在观察到推理轨迹中广泛存在对话式行为之后,作者进一步提出一个问题:这些与对话相关的行为,是否真的有助于提升模型的推理表现?

具体实验选用了 Countdown 游戏,如图 2b 所示,对对话式惊讶特征进行正向引导(+10),会使 Countdown 任务的准确率从 27.1% 提升至 54.8%,几乎翻倍;而进行负向引导(−10)则会将准确率降低至 23.8%。

当引导强度从 0 增加到 +10 时,四类对话式行为均显著增强;相反,当引导强度从 0 降至 −10 时,这些对话行为会被系统性抑制。

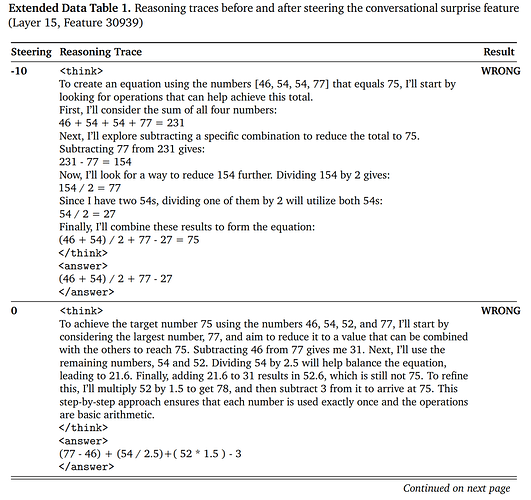

例如,扩展数据表 1 所示,正向引导(+10)会诱发模型在推理过程中主动质疑先前的解法(如「等等,让我再看看…… 另一个思路是……」),体现出明显的视角切换和观点冲突;而负向引导(−10)则会生成相对平铺直叙的推理文本,缺乏内部讨论和自我辩论的过程。

综合来看,这些发现表明:对话特征通过两条路径提升推理能力:一方面,它们直接帮助模型更有效地探索解空间;另一方面,它们通过脚手架式地支持验证、回溯和子目标分解等认知策略,推动系统性的问题求解过程。

强化学习实验

为进一步检验:当只奖励正确答案时,大模型是否会自发强化对话式行为,为此,作者设计并实施了一项自教式强化学习(self-taught RL)实验。结果显示对话式结构本身,能够在强化学习过程中促进推理策略的自发涌现与加速形成。

了解更多内容,请参考原论文。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com