南洋理工&商汤提出棱镜假说与UAE,统一视觉模型,兼顾语义理解和细节还原,让AI既懂语义又能还原细节。

原文标题:视觉模型既懂语义,又能还原细节,南洋理工&商汤提出棱镜假说

原文作者:机器之心

冷月清谈:

怜星夜思:

2、UAE方法中,语义对齐损失只施加在最低频的前K个band上,高频不强行对齐,这种设计的目的是什么?如果对所有频段都进行语义对齐,可能会产生什么问题?

3、文章提到UAE可以与现有的diffusion transformers无缝对齐,这为未来的研究方向带来了哪些可能性?例如,是否可以将UAE应用于视频生成或3D建模等领域?

原文内容

作者来自 Nanyang Technological University(MMLab) 与 SenseTime Research,提出 Prism Hypothesis(棱镜假说) 与 Unified Autoencoding(UAE),尝试用 “频率谱” 的统一视角,把语义编码器与像素编码器的表示冲突真正 “合并解决”。

-

论文标题:The Prism Hypothesis: Harmonizing Semantic and Pixel Representations via Unified Autoencoding

-

代码仓库:https://github.com/WeichenFan/UAE

-

论文地址:https://arxiv.org/pdf/2512.19693

背景:为什么 “懂语义” 和 “还原细节” 总是很难兼得?

在视觉基础模型里,我们经常同时依赖两类能力:

-

语义理解:像 DINOv2 / CLIP 这类 “语义编码器” 更擅长类别、属性、关系等抽象信息;

-

像素保真:像 SD 系列 VAE 这类 “像素编码器” 更擅长纹理、边缘、小字等细节重建。

但现实问题是:很多系统被迫把两套表示 “拼在一起用”:语义一套、像素一套,训练效率下降、表示互相干扰、而且很难得到一个既 “语义强” 又 “细节强” 的统一潜空间。

论文把这种矛盾归结为一个更本质的问题:世界的信息到底如何被表示,才能既共享语义,又保留各自模态的细粒度。

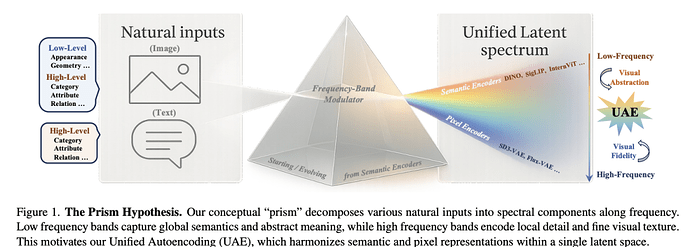

核心洞察:Prism Hypothesis(棱镜假说)

论文给出了一个非常直观的统一解释:

-

可以把真实世界的输入看成投影到同一条 “特征频谱” 上的不同切片;

-

低频更像 “全局结构 / 语义”(类别、布局、关系);

-

高频更像 “局部细节 / 质感”(纹理、边缘、微小文字)。

为了验证,作者做了两类证据:

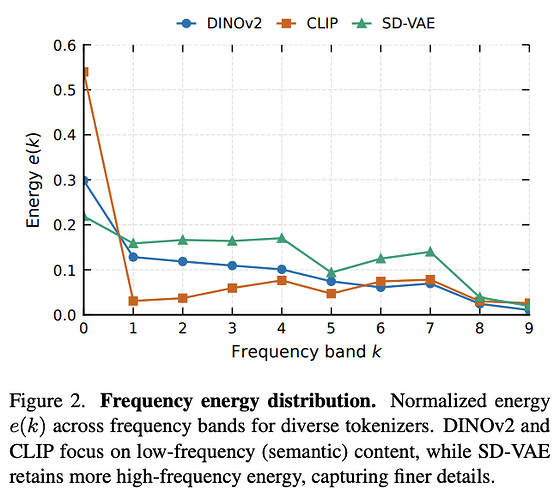

1. 能量谱分析:语义编码器(如 DINOv2、CLIP)能量更集中在低频,而像素型编码器(如 SD-VAE)保留更多中高频细节。

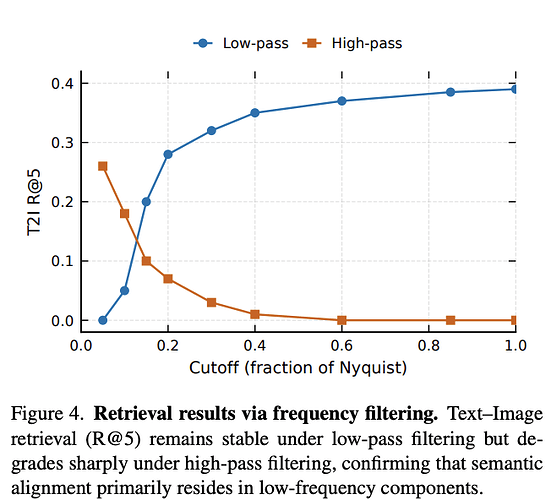

2. 频率过滤下的检索鲁棒性:文本 - 图像检索的 R@5 在低通情况下较稳定,但在高通 / 去掉低频基座后会明显崩塌、趋近随机,说明跨模态语义对齐主要来自共享低频基座。

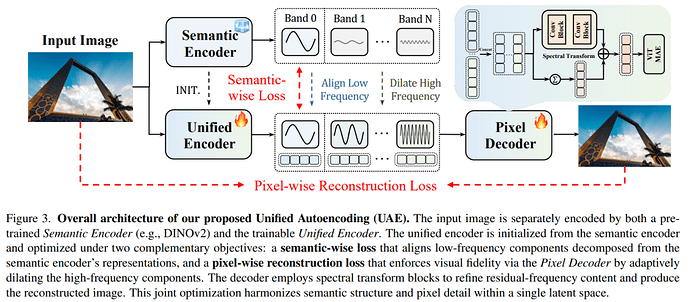

方法:Unified Autoencoding(UAE)怎么把两种表示 “合成一套”?

围绕 “低频语义基座 + 高频细节残差” 的思路,UAE 的核心是把一个统一编码器学成多频段潜变量,并把 “语义该管什么、细节该放哪里” 结构化地拆开。

1) Unified Encoder:从语义编码器初始化,走向统一潜空间

以 DINOv2 为例,UAE 的统一编码器从预训练语义模型初始化,进入后续频域处理。

2) Residual Split Flow:在频域做 “可控的分带分解”

UAE 用 FFT 做频段投影(平滑径向 mask),并采用迭代残差拆分,把潜变量拆成多个频带:

-

低频带(低频)承载语义 / 全局结构

-

更高 band(高频)逐步承载边缘、纹理等细节残差

同时强调分解的可逆性与空间一致性。

3) Frequency Band Modulator:只 “扰动细节”,再做频带融合给解码器

训练时对高频带进行噪声扰动以增强鲁棒性;然后把各频带在通道维拼接,融合后作为解码器唯一输入。

4) Semantic-wise Loss:语义只约束低频,细节放开学像素

为了既继承语义先验、又扩展到高频细节,UAE 的语义对齐损失只施加在最低频的前 K 个 band 上:

-

低频对齐 ;

-

高频不强行对齐;

论文也明确把 UAE 定位为 tokenizer,并强调其 “能与现有 diffusion transformers 无缝对齐”。

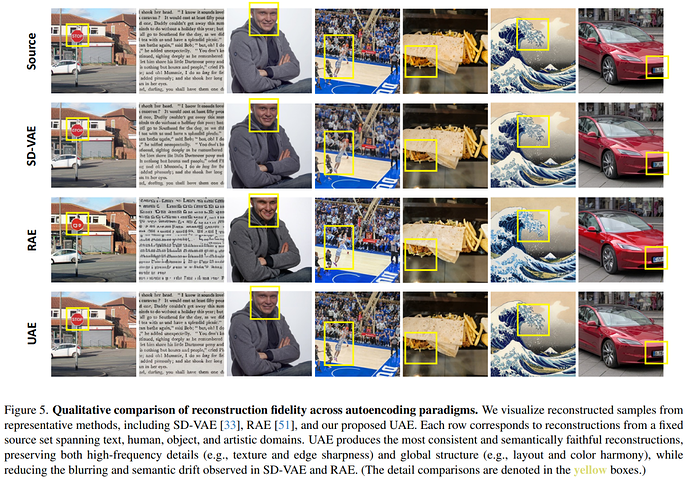

实验结果:一个潜空间,同时要 “语义” 也要 “细节”

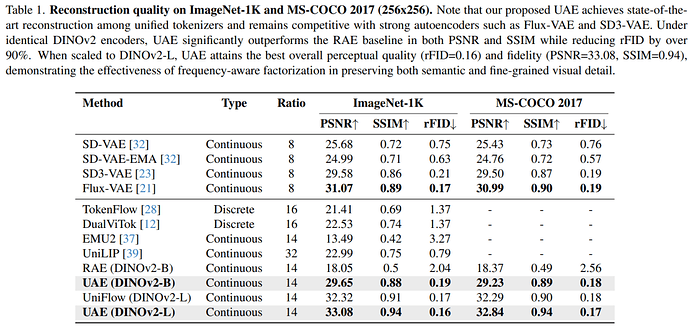

重建质量(ImageNet / MS-COCO)

在 256×256 重建任务上,UAE(DINOv2-L)在 ImageNet 上达到 PSNR=33.08、SSIM=0.94、rFID=0.16,在 MS-COCO 上达到 PSNR=32.84、SSIM=0.94、rFID=0.17。

同时,论文指出在相同 DINOv2 编码器设置下,UAE 相比 RAE 基线在 PSNR/SSIM 更高,并且 rFID 下降超过 90%。

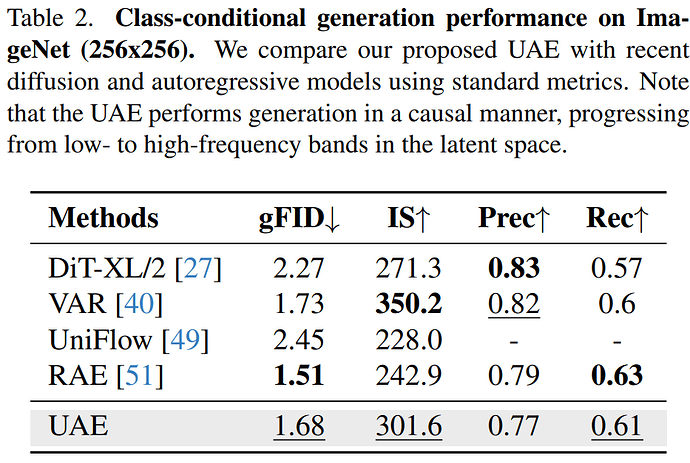

生成能力(ImageNet 类条件生成)

在 ImageNet 256×256 类条件生成上,UAE 达到 gFID=1.68、IS=301.6。

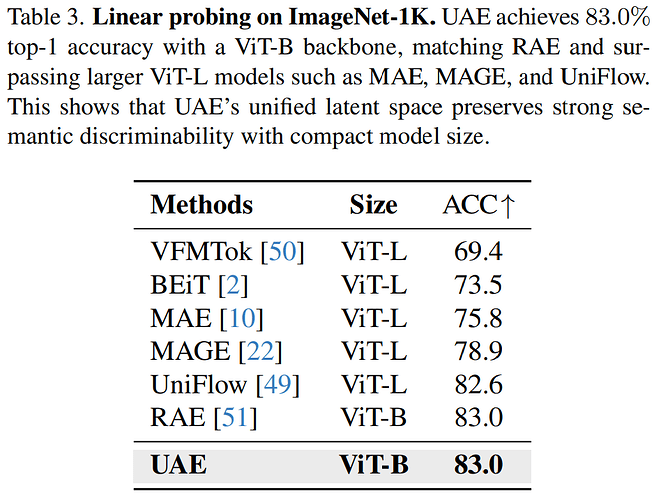

语义理解(Linear Probing)

在 ImageNet-1K 上,UAE 在 ViT-B 骨干下达到 Top-1=83.0%,与 RAE 持平。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com