清华大学“学术之路”系列讲座回顾:Python助力科研数据采集与分析,解决跨学科研究痛点。

原文标题:“学术之路”回顾 | Python科研应用系列分享会

原文作者:数据派THU

冷月清谈:

怜星夜思:

2、讲座中提到了多进程并发技术,对于初学者来说,还有哪些简单易用的方法可以提高数据采集效率?

3、在金融文本分析中,情感分析的应用场景有哪些?如何提高情感分析的准确性?

原文内容

近日,清华大学五道口金融学院研究生分会和清华大学学生大数据研究协会联合举办了【"学术之路"讲座——Python科研应用分享会】。本期讲座邀请了能源环境经济研究所2025级博士研究生毛涵洁同学,为有志于学习编程但非计算机、非数据科学专业的同学提供极具实操性的“跨界科研工具箱”,通过三期连讲的形式,手把手带领同学们实现从静态网页解析到复杂动态数据抓取的科研进阶。讲座以Python爬虫与金融文本分析为主题,分为基础篇、进阶篇、实战篇三部分。

活动回顾

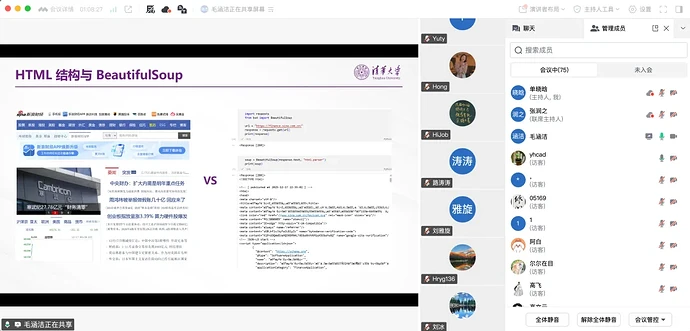

近日,【“学术之路”讲座——Python科研应用分享会】第一讲拉开帷幕。本期讲座由展开同学主持,毛涵洁同学担任主讲。她从爬虫的技术本质出发,带领同学们认识了 Requests 库这一核心利器。讲座以新浪财经ESG频道为例,带领零基础同学完成了静态网页数据的精准提取,打通了数据采集的第一道关卡。

第二讲由毛涵洁同学继续主讲。她深入剖析了AJAX技术原理,并指导同学们使用浏览器开发者工具(F12)进行抓包分析,掌握直接定位并获取后台JSON数据接口的方法,实现高效的数据采集。针对更复杂的交互页面,讲座还介绍了Selenium浏览器自动化工具作为“保底方案”,并分享了PyMuPDF与pdfplumber库在解析金融PDF文档中的关键技巧。

收官讲座由熊陈言同学主持。本场聚焦真实金融科研场景,毛涵洁以巨潮资讯网A股年报的批量下载与处理为例,演示了如何运用多进程并发技术大幅提升采集效率。随后,进一步讲解了多进程文本分析、词频统计与情感分析等深度挖掘技术,并以国际金融公司(IFC)数据库的抓取为例,完整展示了Selenium在跨国研究数据闭环中的应用。

活动总结

来源 | 清华大学五道口金融学院研究生分会

关于我们