Earth-Agent:大模型像专家,理解并执行复杂地球观测分析,开创新范式!

原文标题:首个地球科学智能体Earth-Agent来了,解锁地球观测数据分析新范式

原文作者:机器之心

冷月清谈:

怜星夜思:

2、AI智能体像Earth-Agent这样越来越厉害,地球科学家是不是也要跟着『变身』了?未来他们的工作会变成啥样?是能解放出来做更有创造性的研究,还是得学一堆新技能啊?

3、文章里提到了AI会有『工具幻觉』和『文件幻觉』,在咱们地球科学这种要求特严谨的领域里,这『幻觉』是不是格外危险?除了训练,大家有没有什么脑洞大开的点子能减少这种错觉呢?

原文内容

本文的第一作者冯沛林和吕主涛是上海人工智能实验室的实习生,他们的研究聚焦于大语言模型,尤其关注多模态大语言模型的推理和智能体。通讯作者李唯嘉为中山大学遥感学院副教授。论文的其他合作者来自上海人工智能实验室和中山大学。

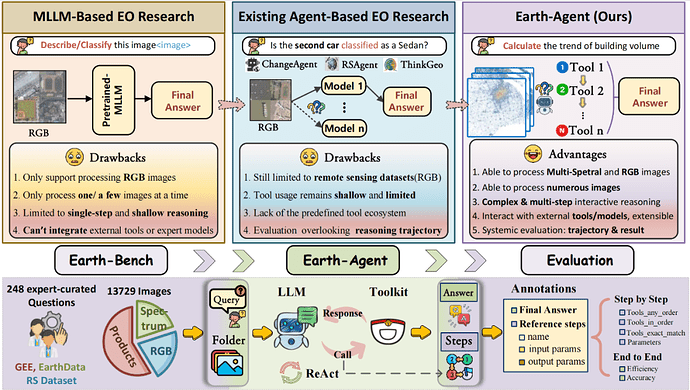

当强大的多模态大语言模型应用于地球科学研究时,它面临着无法忽视的 「阿克琉斯之踵」:

-

只能处理 RGB 图像,面对光谱数据束手无策。

-

只能做少量的图片,无法胜任大规模遥感数据语料分析。

-

只能做简单问答,缺乏处理复杂、多步骤科学问题的能力。

-

囿于模型预训练所得的静态知识,无法调用成熟的专业工具与科学模型体系。

而今,这些 「致命伤」 终于迎来了它们的解药。想象一下,有一个能真正理解并执行复杂地球科学任务的 「AI 科学家」。它能够理解你的研究意图,像人类专家一样自主规划分析流程;可以处理原始光谱数据、遥感影像和地球产品,进行专业的指数计算和参数反演;能在多步骤推理中调用最合适的工具,完成从数据预处理到时空分析的全流程工作。

这一切不再是想象,由上海人工智能实验室与中山大学联合研发的 Earth-Agent,正在将这一愿景转化为现实。

-

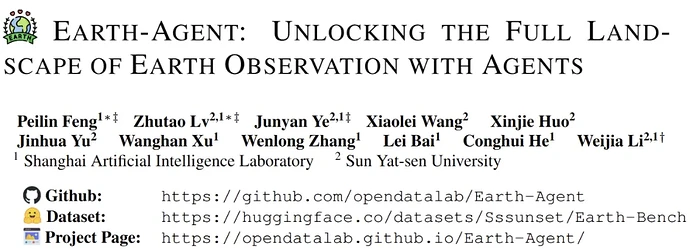

论文题目:Earth-Agent: Unlocking the Full Landscape of Earth Observation with Agents

-

论文链接:https://arxiv.org/abs/2509.23141

-

代码地址:https://github.com/opendatalab/Earth-Agent

-

项目主页:https://opendatalab.github.io/Earth-Agent/

灵感来源:

模拟人类的专业能力掌握逻辑-知识转化为工具库

想象一名地球科学领域的学生如何成为一个成熟的研究者?他需要在数年的学习中,从专业课程中汲取海量知识,将每一个理论和算法内化为自己心中的 「工具」。而后在面对真实的数据分析场景时从储备的 「工具库」 中精准挑选并串联起 「指标计算」、「参数反演」、「统计分析」 等一系列工具链路,最终形成解决复杂问题的完整工作流。

我们能否借助 AI 智能体(Agent)复现这一 「知识工具化」 与 「流程自动化」 的专家能力?

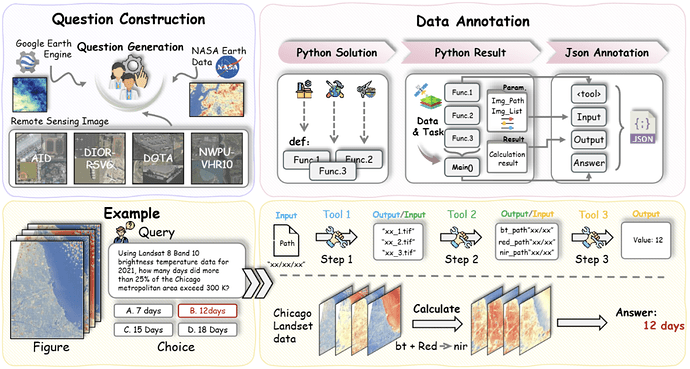

基于上述灵感,研究者构建了 Earth-Agent 的核心框架,其关键在于两个层面的构建:

-

领域知识工具封装化:研究者将地球科学领域长期积累的专业知识逐一封装为标准化、可执行的函数或专用模型并标注其明确的功能定义、输入输出规范以及典型的适用场景,从而构建成一个结构化的工具体系。借助模型上下文协议(MCP)桥接语言模型和工具库。在本工作中,该工具库共集成了 104 个专用工具。

-

基于 LLM 的智能规划与调度:研究者利用大语言模型(LLM)强大的上下文理解与推理能力,使其充当智能体的 「大脑」。在 Reasoning + Acting (ReAct) 机制在面对用户查询时,Agent 通过理解当前需求能够从预构建的工具库中动态地选择最合适的工具,从而自主完成从数据预处理到复杂时空分析的全链路科学工作流。

基准评估:

多步推理+双层次评估协议

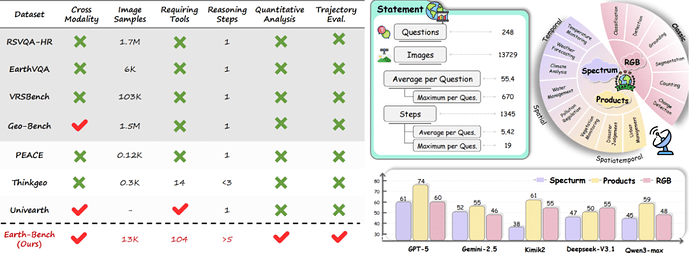

Earth-Bench 包含 248 个专家标注的任务,涵盖 13,729 张图像,分布于三大模态:

-

RGB 图像:用于场景分类、目标检测、变化检测等感知任务;

-

原始光谱数据:用于植被监测、温度反演、干旱评估等定量分析;

-

地球产品数据:用于城市扩张、水体变化、气象趋势等时空分析。

与以往侧重于对单张或少量遥感影像进行描述(Captioning)、分类(Classification)或简单问答(VQA) 的基准不同的是,Earth-Bench 的核心在于评估智能体执行完整地球科学分析工作流的能力。

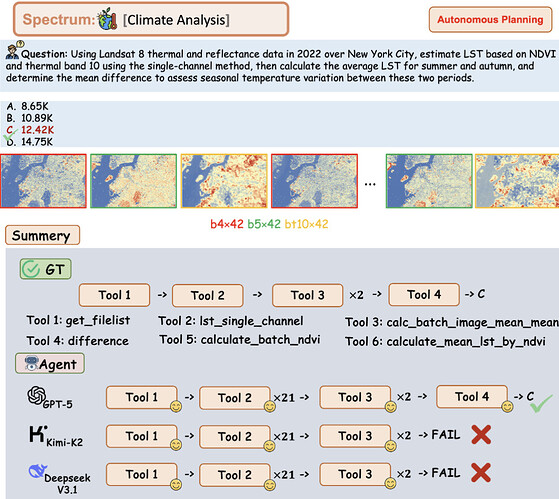

举一个例子:「利用 2022 年纽约市 Landsat 8 热成像和反射率数据,采用单通道方法基于 NDVI 和热波段 10 估算 LST,然后计算夏季和秋季的平均 LST,并确定平均差以评估这两个时期之间的季节性温度差值。A. 8.65K B. 10.89K C.12.42K D.14.75K。」可以看到,Earth-Bench 的题目不再局限于对于原始地球观测数据进行简单的一步即可完成的描述、分类、计数任务,而是强调利用地球科学的知识进行严格的指标计算和时空分析。

Earth-Bench 只有 248 个题目,但是需要处理 13729 张 image 图像,平均每个题目需要处理 55 张影像,平均每个问题需要 5.4 步才能完成。这意味着智能体必须具备批量数据处理、时序分析和跨文件信息整合的能力,这直接对应了真实地球科学研究中处理大规模观测数据的核心需求。

另一方面,以往的 Agent 基准测试陷入了 「唯结果论」 的陷阱,侧重于最终结果的准确性而忽视了对于 Agent 推理轨迹的评估。

研究者认为 「怎么得出这个结论」 的过程和结论本身同样重要,因此邀请了一支由遥感专业研究生组成的专家小组针对 Earth-Bench 的每一个问题都进行逐步的解答求得最终结果。他们把每一步调用了什么工具、输入了什么参数、得到了什么中间结果,都完整地记录了下来。 这就形成了一条条标准的 「专家推理轨迹」。接着将专家推理轨迹纳入到了 step-by-step 评估,并将最终的答案和效率纳入到了结果的 end-to-end 评估。

Earth-Agent 的能力评估和实验分析

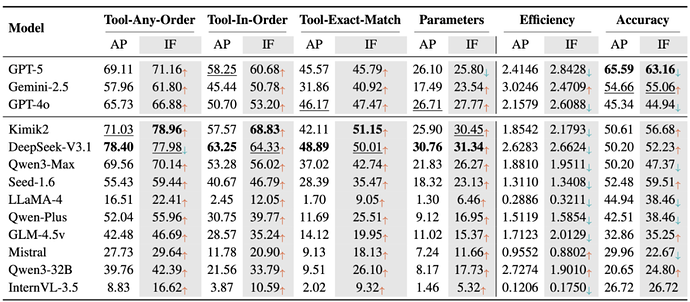

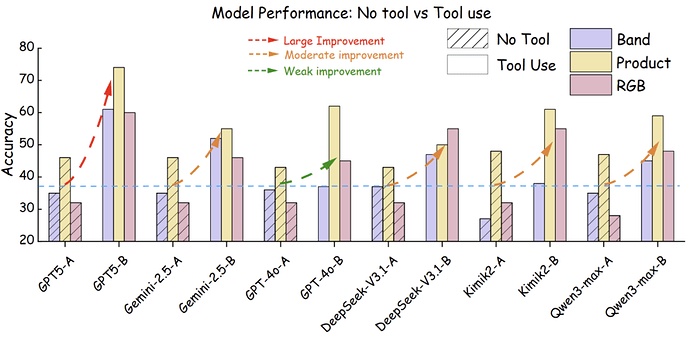

实验一:比较不同的 LLM Backbone

通过对 GPT、Gemini、Kimik2、DeepSeek、Qwen 等主流模型的测试,评测结果揭示了进行工具调用(Tool Calling)预训练的语言模型表现大幅领先于没有进行工具调用预训练的模型。闭源模型最终准确率更高,但 DeepSeek-V3.1 和 Kimik2 在推理过程中工具使用的准确率上超越 GPT-5。

研究者还对比了 Query 中不进行步骤提示的 Auto Planning(AP)和在 Query 中加入步骤提示的 Instruct Following (IF) 的实验结果,可以发现 IF 可以提升工具的感知准确率,但是往往会使得智能体在中间过程中引入无关的工具,使得效率下降并引起级联误差,导致最终的准确率不一定上升。

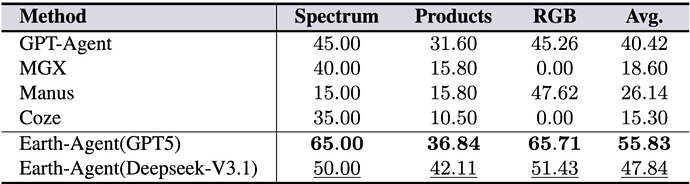

实验二:与通用的 Agent 架构的对比

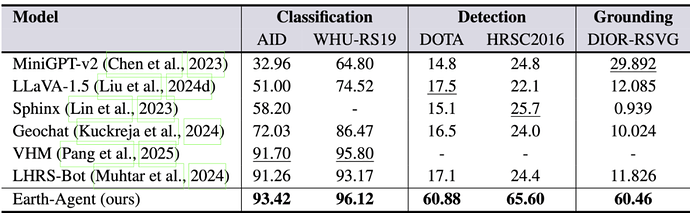

实验三:与 MLLM 方法的对比

研究者还将 Earth-Agent 和通用的 Agent 架构以及 MLLM 方法进行了横向对比,可以发现 Earth-Agent 在各个 Spectrum、Products、RGB 三个模态的效果领先于通用的 Agent 架构,并且在经典的遥感分类、检测、分割任务中相比于 MLLM 都取得了领先的性能,这验证了 Earth-Agent 在地球观测任务的巨大应用前景。

消融实验

为了验证 Earth-Agent 的能力提升来自于 LLM 对于工具的调用而非其他的因素,研究者对 Earth-Agent 进行了系统的消融实验,划分为 A 组:不使用工具;B 组:使用工具。结果表明,在 LLM 无法使用工具的情况下,不同的 LLM 准确率都在 37%(图中蓝色虚线)。

而允许 LLM 调用工具后,不同的 LLM 对于地球科学问题的回答准确性提升出现了明显的差异。GPT5 的回答准确率提升到了 65%;Gemini-2.5、DeepSeek-V3.1、Kimik2、Qwen3-max 的回答准确率提升到 50%,GPT-4o 的回答准确率仅提升到 45%。

地球科学智能体的未来路线

Earth-Agent 为地球观测数据分析提供了一个新的学习范式:不再像 MLLM 将全部能力编码到大模型预训练的参数中,而是将能力外化为一个结构化的、可随时调用的工具库,让大模型扮演一个了解 「何时调度和决策」 的大脑。这种范式更接近我们人类的学习和工作方式:我们并非把所有知识都记在脑子里,而是学会在需要时,精准地选择并使用合适的工具。Earth-Agent 未来还有广阔的发展前景:

-

从基石到生态:Earth-Agent 只纳入了 104 个专业的地球科学工具 / 专家模型,这仅仅是一个起点。Earth-Agent 采用了 MCP 框架,可以非常方便地加入新的工具。研究者相信在开放社区的共同努力下,Earth-Agent 将成长为一个不断进化、日益强大的地球科学智能体。

-

从评估到训练:本篇工作验证了智能体路线在地球科学分析任务中的巨大潜力,而没有对 LLM 进行专门的训练或微调。研究者在附录中对于现阶段的 LLM 进行了详细的错误分析,发现智能体在与真实操作系统交互时,表现出严重的 「工具幻觉」 和 「文件幻觉」,它们会调用不存在的工具或试图处理根本不存在的文件。这为将来的训练路线提供指导。

-

从语言到视觉:当前 LLM 对于工具的选择依赖于模型的上下文和工具的描述,它局限在文本语义的 prompt 提示工程,随着 MLLM 的成熟,研究者预见下一个突破点:让具备视觉能力的模型作为智能体的核心,建立在视觉语义的工具感知可能成为突破地球观测数据分析的关键。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com