谷歌开源Coral NPU,这是一个全栈AI平台,旨在将大语言模型等强大AI带到智能手表等低功耗边缘设备上全天候运行,同时强调硬件级隐私保护,并构建开放生态。 它是首个为将大语言模型(LLM)引入可穿戴设备而设计的开放、基于标准的低功耗NPU。

原文标题:谷歌开源全栈平台Coral NPU,能让大模型在手表上全天候运行

原文作者:机器之心

冷月清谈:

怜星夜思:

2、Coral NPU强调硬件强制的隐私保护,这在AI时代特别重要。但话说回来,硬件级的保护真的就万无一失了吗?会不会有新的安全风险,或者在实际应用中,用户还是会担心数据被滥用?大家怎么看这种平衡?

3、Google这次选择开源Coral NPU架构,还基于RISC-V指令集,这是一个很重要的决定。为什么Google会这么做?它对整个边缘AI硬件产业,特别是对开发者来说,意味着什么?跟那些封闭的、专有架构相比,RISC-V和开源模式有哪些独到的优势呢?

原文内容

编辑:Panda

今天,谷歌有点忙。

一方面,他们与耶鲁大学合作基于 Gemma 研发的 Cell2Sentence-Scale 27B (C2S-Scale) 首次预测了一种新的潜在癌症疗法,引发世界广泛关注。另一方面,他们又更新上线了 Veo 3.1,为用户带来了大幅提升的视频生成能力,参阅报道《》。

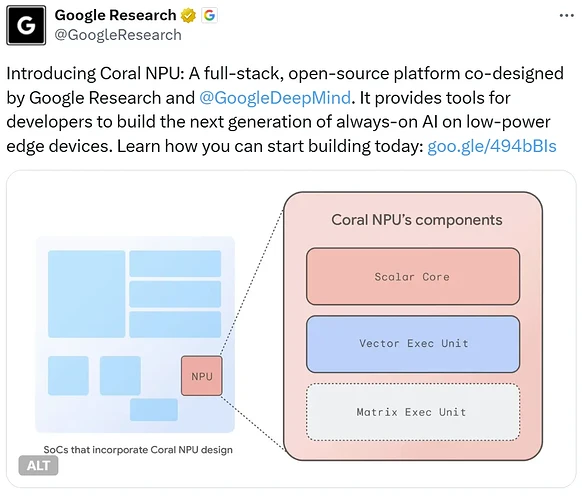

再一方面,他们又推出了 Coral NPU,可用于构建在低功率设备上持续运行的 AI。具体来说,其可在可穿戴设备上运行小型 Transformer 模型和 LLM,并可通过 IREE 和 TFLM 编译器支持 TensorFlow、JAX 和 PyTorch。

和前两个新闻一样,这也同样引起了开发者的广泛热议。

Coral NPU:一个为边缘设备打造的全栈开源 AI 平台

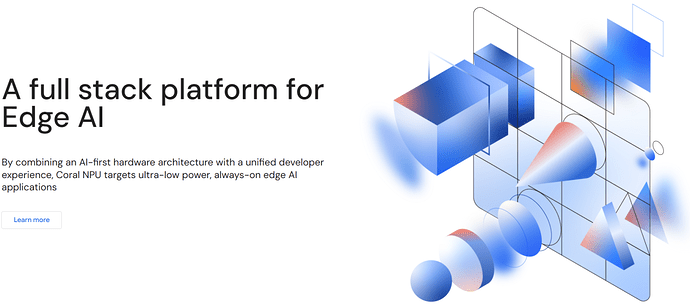

谷歌给 Coral NPU 的定位是「一个全栈、开源的平台,旨在解决性能、碎片化和隐私这三大核心挑战,而这些挑战限制了功能强大、始终在线的 AI 技术在低功耗边缘设备和可穿戴设备上的应用。」

也就是说,使用 Coral NPU,未来我们有望打造出能在智能手表等设备上本地持续运行的好用 AI,让智能直接嵌入到用户的个人环境中。

然而,要做到这一点却并非易事。谷歌总结了三大方面的挑战:

-

性能差距:复杂且先进的机器学习模型需要更多的计算资源,这远超边缘设备有限的功率、散热和内存预算。

-

碎片化成本:为多样化的专有处理器编译和优化机器学习模型既困难又昂贵,这阻碍了跨设备实现一致的性能。

-

用户信任缺失:要想真正发挥作用,个人 AI 必须优先保障个人数据和情境的隐私与安全。

而谷歌今天推出的 Coral NPU 基于其最初的 Coral 项目,「可为硬件设计者和机器学习开发者提供了构建下一代私密、高效边缘 AI 设备所需的工具。」

具体来说,Coral NPU 是与 Google Research 和 Google DeepMind 合作设计的成果,乃是一个 AI 优先的硬件架构,可用于支持下一代超低功耗、始终在线的边缘 AI。

它提供了统一的开发者体验,使部署环境感知等应用变得更加容易。它专为在可穿戴设备上实现全天候 AI 而设计,同时能最大限度地减少电池消耗,并且可通过适当配置来适应更高性能的应用场景。

谷歌已经发布了相关文档和工具,以便开发者和设计者可以立即开始构建。

-

项目主页:https://developers.google.com/coral

-

代码库:https://github.com/google-coral/coralnpu

技术细节

顾名思义,Coral NPU 采用了 NPU(神经处理单元 /neural processing unit)架构,其为下一代高能效、针对机器学习优化的片上系统 (SoC) 提供了构建模块。

该架构基于一套符合 RISC-V 指令集架构 (RISC-V ISA) 的 IP 模块,专为最低功耗而设计,使其成为始终在线的环境感知的理想选择。

其基础设计可在仅消耗几毫瓦功率的情况下,提供 512 GOPS (每秒十亿次操作) 级别的性能,从而可为边缘设备、耳戴式设备、AR 眼镜和智能手表带来强大的端侧 AI 能力。

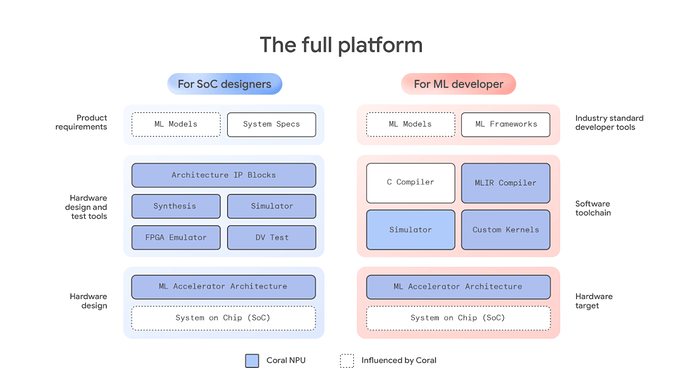

Coral NPU 生态系统统一视图,展示了为 SoC 设计者和机器学习开发者提供的端到端技术栈。

这种基于 RISC-V 的开放且可扩展的架构为 SoC 设计者提供了灵活性,让他们可以修改基础设计,或将其用作一个预配置的 NPU。

Coral NPU 架构包含以下组件:

-

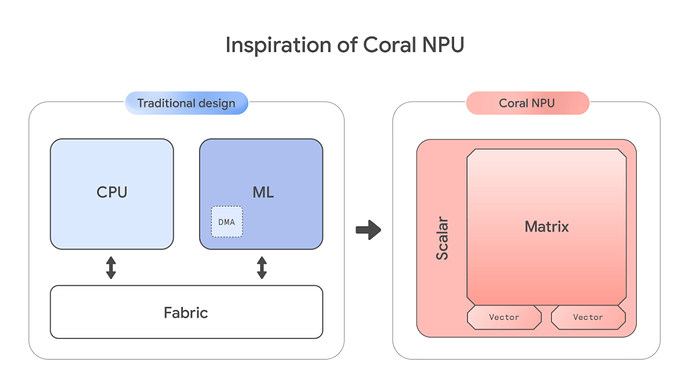

一个标量核心(scalar core): 一个轻量级、可用 C 语言编程的 RISC-V 前端,负责管理流向后端核心的数据流。它采用简单的「运行到完成」 (run-to-completion) 模型,以实现超低功耗和传统的 CPU 功能。

-

一个向量执行单元(vector execution unit): 一个强大的单指令多数据 (SIMD) 协处理器,符合 RISC-V 向量指令集 (RVV) v1.0 规范,能够对大型数据集进行同步操作。

-

一个矩阵执行单元(matrix execution unit): 一个高效的量化外积乘积累加 (MAC) 引擎,专为加速神经网络的基本运算而构建。请注意,该矩阵执行单元仍在开发中,将于今年晚些时候在 GitHub 上发布。

从传统设计到 Coral NPU 的架构转变示意图。

统一的开发者体验

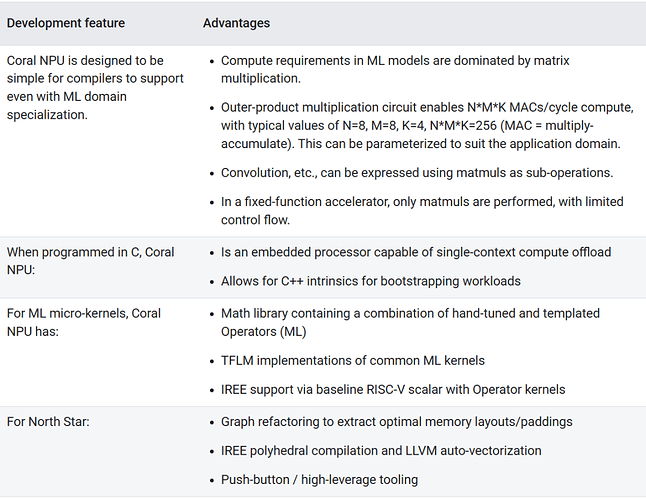

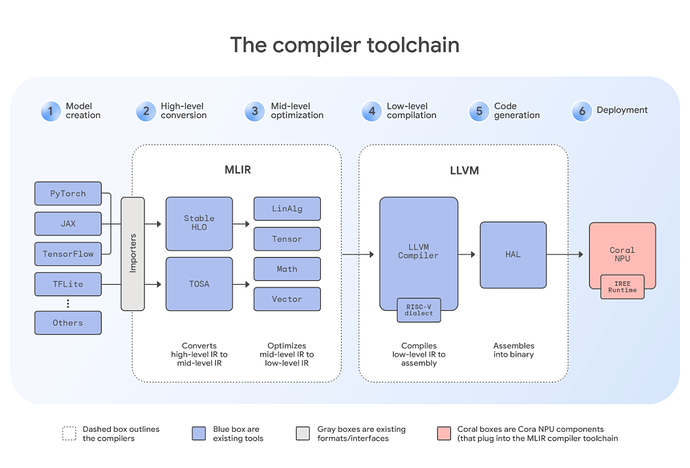

Coral NPU 架构是一个简单的、可用 C 语言编程的目标平台,可以与 IREE 和 TFLM 等现代编译器无缝集成。这使得它能够轻松支持 TensorFlow、JAX 和 PyTorch 等机器学习框架。

Coral NPU 包含一个全面的软件工具链,其中包括针对 TensorFlow 的 TFLM 编译器等专用解决方案,以及一个通用的 MLIR 编译器、C 编译器、自定义内核和一个模拟器。这可为开发者提供了灵活的路径。

例如,一个来自 JAX 等框架的模型首先会使用 StableHLO 方言 (dialect) 导入为 MLIR 格式。这个中间文件随后被送入 IREE 编译器,该编译器会应用一个硬件特定的插件来识别 Coral NPU 的架构。之后,编译器会执行渐进式降低 (progressive lowering)—— 这是一个关键的优化步骤,在此过程中代码会通过一系列方言被系统地翻译,逐步接近机器的本地语言。优化后,工具链会生成一个最终的、紧凑的二进制文件,以便在边缘设备上高效执行。

下表展示了 Coral NPU 的软件开发优势:

这套行业标准的开发者工具有助于简化机器学习模型的编程,并能在各种硬件目标上提供一致的体验。

Coral NPU 编译器工具链,展示了从机器学习模型创建、优化、编译到设备端部署的完整流程。

Coral NPU 的协同设计过程聚焦于两个关键领域。

-

首先,该架构能高效加速当今设备端视觉和音频应用中领先的、基于编码器的架构。

-

其次,谷歌正与 Gemma 团队紧密合作,针对小型 Transformer 模型优化 Coral NPU,以确保该加速器架构能够支持下一代边缘生成式 AI。

这种双重关注意味着 Coral NPU 有望成为首个开放、基于标准、专为将大语言模型 (LLM) 引入可穿戴设备而设计的低功耗 NPU。

对于开发者而言,这可提供一条单一且经过验证的路径,可以用最低的功耗和最高的性能来部署当前和未来的模型。

目标应用

Coral NPU 旨在支持超低功耗、始终在线的边缘 AI 应用,尤其侧重于环境感知系统。其主要目标是在可穿戴设备、手机和物联网 (IoT) 设备上实现全天候的 AI 体验,同时最大限度地减少电池消耗。

潜在用例包括:

-

情境感知:检测用户活动(如步行、跑步)、距离或环境(如室内 / 室外、移动中),以启用「免打扰」模式或其他情境感知功能。

-

音频处理:语音和声音检测、关键词识别、实时翻译、转录以及基于音频的无障碍功能。

-

图像处理:人物和物体检测、面部识别、手势识别以及低功耗视觉搜索。

-

用户交互: 通过手势、音频提示或其他传感器驱动的输入进行设备控制。

硬件强制的隐私保护

Coral NPU 的一个核心原则是通过硬件强制的安全性来建立用户信任。

谷歌表示:「我们的架构正在被设计用来支持 CHERI 等新兴技术,该技术提供细粒度的内存级安全和可扩展的软件分区。我们希望通过这种方法,将敏感的 AI 模型和个人数据隔离在硬件强制的沙箱中,以抵御基于内存的攻击。」

构建生态系统

开源硬件项目的成功依赖于强大的合作伙伴关系。

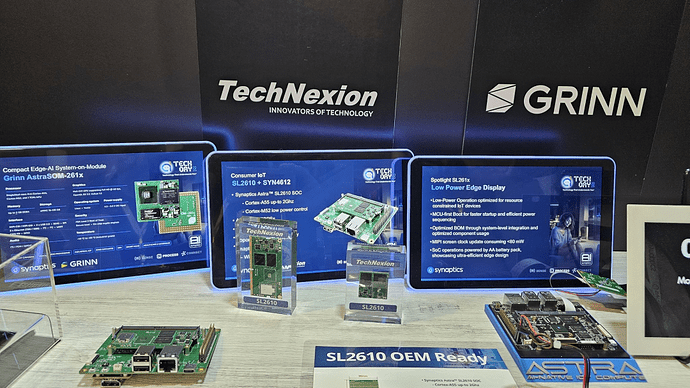

为此,谷歌宣布了与 Synaptics 的合作关系,这也是其「第一个战略芯片合作伙伴」,同时也是物联网领域嵌入式计算、无线连接和多模态传感的领导者。

今天,Synaptics 在其技术日活动上宣布了其新的 Astra SL2610 系列 AI 原生物联网处理器。该产品线采用了他们的 Torq NPU 子系统,这是业界首个 Coral NPU 架构的量产实现。该 NPU 的设计支持 Transformer 并支持动态算子,使开发者能够为消费和工业物联网构建面向未来的边缘 AI 系统。

Astra SL2610,来自 X 用户 @TekStrategist

结语

谷歌表示 Coral NPU 有望「解决边缘计算的核心危机」:「借助 Coral NPU,我们正在为个人 AI 的未来构建一个基础层。我们的目标是通过提供一个通用的、开源的、安全的平台供业界在此基础上发展,从而催生出一个充满活力的生态系统。」

对此,你怎么看?有兴趣尝试基于这个平台进行开发吗?

参考链接

https://x.com/GoogleResearch/status/1978449643437539378

https://research.google/blog/coral-npu-a-full-stack-platform-for-edge-ai

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com