RAPID Hand开源,高自由度灵巧手平台,集多模态感知与紧凑设计,突破通用机器人数据采集瓶颈,助力自主操作。

原文标题:NeurIPS 25 | 中大&UC Merced等开源RAPID Hand,重新定义多指灵巧手数据采集

原文作者:机器之心

冷月清谈:

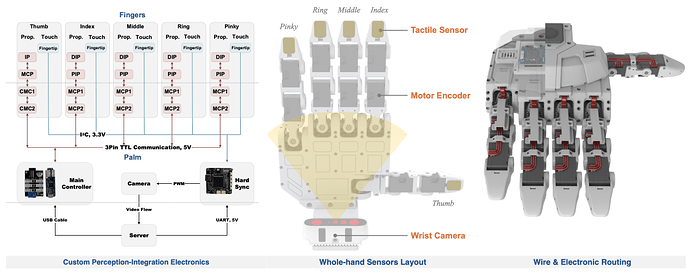

该平台在硬件层面采用了20自由度的类人结构,并优化了电机布局与多指节驱动方案,将手指厚度控制在20毫米内,实现了高效且独立的指节控制。此外,它还创新性地提出了硬件级的全手感知同步框架,能够稳定集成腕部视觉、指尖触觉和本体感觉等多种传感信息,实现了高精度的时序对齐和空间对齐。在软件方面,RAPID Hand开发了高自由度遥操作接口,以高效采集接触丰富的操作任务演示数据。

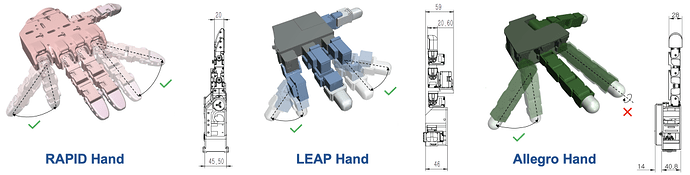

实验结果表明,在手内操作任务中,基于RAPID Hand训练的策略在表现和稳定性上均优于现有方法。这一平台不仅在手部结构设计和多模态感知集成方面优于LEAP、Allegro等现有灵巧手,更具备低成本和高可获得性的优势,为通用机器人灵巧操作的研究提供了坚实高效的支撑。

怜星夜思:

2、文章里把多模态感知(腕部视觉、指尖触觉、本体感觉)的同步和稳定性说得特别重要。除去技术实现难度,你觉得在机器人学习“手感”这事儿上,这些感知信息到底扮演了多重要的角色?有没有可能偷个懒,只用视觉或者用非接触式感知来代替大部分触觉?

3、RAPID Hand的设计是“类人结构”,这在机器人模仿人类操作方面是优势还是限制?人类的手掌有独特的灵活性和适应性,机器人灵巧手在模仿人类时,是应该完全复刻还是在特定任务上进行优化设计?

原文内容

在最近的一篇 NeurIPS 25 中稿论文中,来自中山大学、加州大学 Merced 分校、中科院自动化研究所、诚橙动力的研究者联合提出了一个全新开源的高自由度灵巧手平台 — RAPID Hand (Robust, Affordable, Perception-Integrated, Dexterous Hand)。

-

论文标题:RAPID Hand: A Robust, Affordable, Perception-Integrated, Dexterous Manipulation Platform for Generalist Robot Autonomy

-

论文地址:https://www.arxiv.org/abs/2506.07490

-

项目主页:https://rapid-hand.github.io/

-

Github 地址:https://github.com/SYSU-RoboticsLab/RAPID-Hand

研究背景

灵巧操作能力是通用机器人实现多任务泛化的核心能力之一。无论是日常的家庭整理、物品归置,还是辅助类服务任务,若缺乏灵巧的操作能力,机器人便难以真正完成复杂交互。

近年来,随着多模态大模型(VLMs)在机器人控制中的逐步应用,研究者们开始将高质量的操作演示与预训练模型结合,用于具身推理与通用操作策略学习,在模型架构和数据构造策略上取得了初步进展。

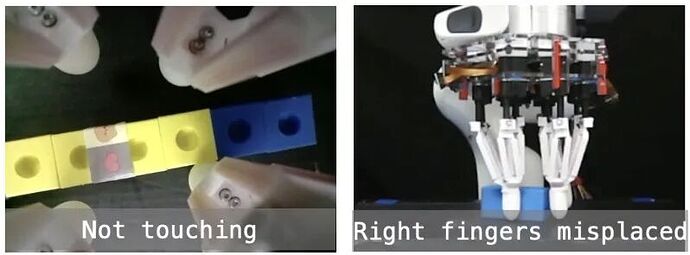

图 1 遥操作手内物体平动对比: Allegro(上) 容易掉落,LEAP(中) 几乎无明显运动,而 RAPID(下) 实现了更自然的指间横向移动。

然而,硬件瓶颈仍是机器人「动手」的关键障碍。首先,受限于末端执行器的可获得性,大多数平台仍依赖于双指夹爪,难以完成手内操作、工具使用等细粒度操作任务。其次,当前多指硬件平台在强调机械结构性能的同时,常常忽略感知系统的同步性与稳定性,导致数据丢帧、感知不同步等问题普遍存在。例如已有研究 [1] 显示,多模态传感器集成时常伴随 4.4% 的掉帧率与高达 15–100ms 的模态延迟。这些问题直接限制了操作技能的多样性,也阻碍了高质量、可复现的真实演示数据的采集。

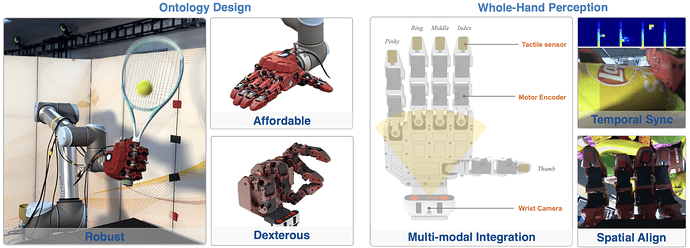

图 2 RAPID Hand 具有 20 自由度(DoF)的类人结构,集成了腕部视觉、指尖触觉和本体感觉等多模态感知能力,支持毫秒级的时空同步与精准的空间对齐,并提供高自由度的遥操作接口,旨在以低成本、高质量的数据,助力通用机器人灵巧操作的研究。

研究动机:多指操作能否稳定、高效采集?

高质量的真实机器人演示数据对于训练通用操作策略至关重要,但要实现稳定可靠的数据采集,仍缺乏一套紧凑、经济且具备高自由度的多指灵巧手系统。

挑战主要来自两个方面:一是驱动与传动结构的复杂性。电机布局不仅要兼顾低成本和高输出力,还需在指尖灵活性、结构紧凑性与类人关节运动学之间取得平衡,否则极易导致结构臃肿或不自然的关节运动;二是多模态感知在运动过程中容易出现断连与丢包,传感器间的延迟差异与不同步问题也会影响感知数据的一致性与完整性。

基于此,研究者们提出一个关键问题:能否构建一个软硬件高度集成、结构清晰的灵巧手操作平台,为稳定、高质量的数据采集提供可靠支撑?本研究正是围绕这一挑战展开,研究者们从硬件与软件两个层面协同设计,构建了 RAPID Hand 平台,力求在感知集成、结构设计与控制接口之间形成一致、稳定的闭环支持。

图 3 手指尺寸与运动学对比:对 RAPID、LEAP 和 Allegro 三种灵巧手的手指尺寸和运动学特性比较。

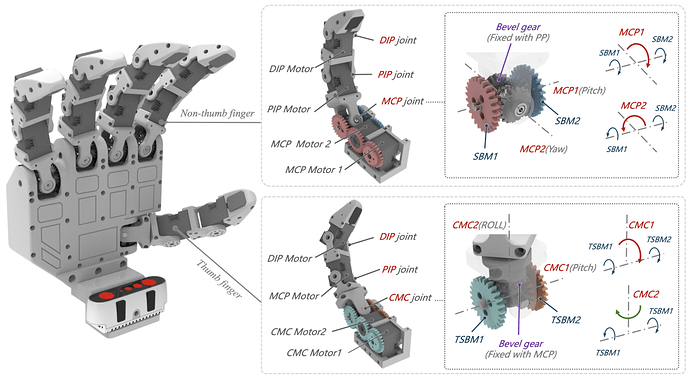

手部本体设计

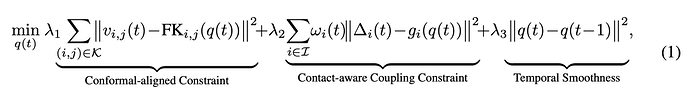

在硬件结构方面,RAPID Hand 采用紧凑的 20 自由度手部本体设计,并引入统一的多指节驱动与传动方案。通过对电机布局的系统优化(如图 4 所示),手指厚度被控制在 20 毫米,兼顾结构紧凑与驱动性能。具体而言,该方案在远端关节(DIP 与 PIP)采用直接驱动,近端关节(MCP)则引入并联机构,实现高效、独立的多指节控制。

图 4 RAPID Hand 所采用的统一多指节驱动方案。除拇指外,各手指的 DIP 和 PIP 关节,以及拇指的 DIP 和 MCP 关节,均由安装于指节的电机直接驱动;而除拇指外各手指的 MCP 关节与拇指的 CMC 关节则通过并联机构驱动,从而实现全手 20 自由度的独立控制。

此外,研究者们提出了一种硬件级的全手感知同步框架,可稳定集成腕部视觉、指尖触觉与本体感觉三类传感信息,实现高精度的时序对齐(如图 5 所示)。

图 5 硬件级全手感知集成框架示意图。展示了视觉、触觉和本体感觉传感器的布局,以及电子元件与走线排布。

学习灵巧操作技能

在软件系统方面,研究者们开发了一套高自由度的遥操作接口,可高效采集多样化的接触丰富的操作任务演示。最终,RAPID Hand 被构建为软硬协同优化的平台:紧凑的 20 自由度手部结构、稳定的全手感知集成框架与高自由度遥操作接口三者协同设计,实现了从数据采集到策略部署的闭环链条,确保硬件耐用、感知稳定,并支持灵巧操作任务中高效、高质量的演示数据采集。

基于该灵巧操作平台,研究者们在三个具有挑战性的手内操作任务上训练一个扩散模型,以验证 RAPID Hand 的性能。在实验中,基于 RAPID Hand 训练的策略在操作表现与稳定性方面均优于已有方法。据我们所知,RAPID Hand 在手部结构设计与多模态感知集成两方面均优于现有代表性灵巧手(LEAP、 Allegro),同时具备低成本、高可获得性的优势。

图 6 手内平动与滚动任务对比。上中两图展示了 RAPID Hand 在无需加速播放的情况下自主完成物体的手内滚动和平移操作;下图为先前方法 [2] 的效果。与其固定机械臂末端、依赖桌面支撑等简化设置不同,RAPID Hand 在放宽这些限制条件下,仍实现了稳定的自主操作。

图 7 多指翻找任务对比。上图展示了 RAPID Hand 在无需加速播放的情况下自主完成类似人类翻找抽屉的多指翻找任务。相比之下,RAPID 所训练的策略在操作表现上显著优于同期仅依赖单指扫动并使用 ArUco 标记进行感知的方法 [3]。

[1] RoboPanoptes: The All-seeing Robot with Whole-body Dexterity. CoRL 2025.

[2] Tilde: Teleoperation for Dexterous In-Hand Manipulation Learning with a DeltaHand. RSS 2024.

[3] Retrieval Dexterity: Efficient object retrieval in clutter with a dexterous hand. ArXiv 2025.

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com