深入探讨深度学习模型鲁棒性,涵盖视觉、领域泛化及大语言模型越狱的最新攻防进展。

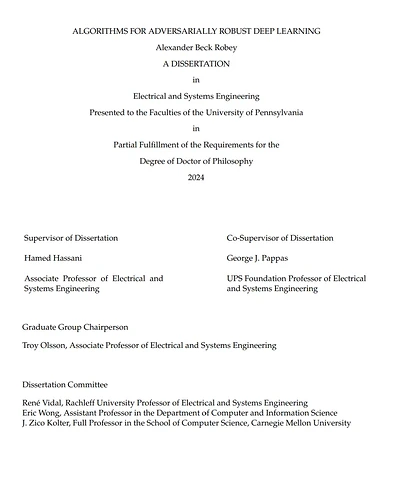

原文标题:对抗鲁棒性深度学习算法

原文作者:数据派THU

冷月清谈:

文章探讨了在安全关键型应用中确保深度学习模型决策对抗性利用时的鲁棒性。内容围绕设计具备理想鲁棒性算法的最新进展展开。首先,在计算机视觉领域,作者介绍了对抗样本问题的新技术、训练范式及认证算法。其次,针对领域泛化问题,文章指出提出的新算法在医学影像、分子识别和图像分类中实现了当前最先进的泛化性能,使神经网络能更好地泛化到未见过的测试分布。最后,对于大语言模型(LLMs)的越狱场景,文章提出了新的攻击与防御方法,这代表了在设计鲁棒的语言类智能体方面的前沿进展。

怜星夜思:

1、文章里提到了对抗样本问题,在现实生活中,我们可能接触到哪些潜在的、由对抗样本引发的安全风险呢?除了自动驾驶和人脸识别,还有没有更意想不到的例子?

2、大语言模型(LLMs)越狱听起来有点技术,但它对我们普通用户使用AI工具有什么实际的影响和风险呢?是不是意味着我们更容易被不当信息误导,或者AI会变得“不可控”?

3、文章说提升模型的鲁棒性很重要,但会不会在追求鲁棒性的同时,牺牲掉模型的其他性能或者让模型变得更复杂、更难训练呢?这两者之间有没有一个“最优解”?

2、大语言模型(LLMs)越狱听起来有点技术,但它对我们普通用户使用AI工具有什么实际的影响和风险呢?是不是意味着我们更容易被不当信息误导,或者AI会变得“不可控”?

3、文章说提升模型的鲁棒性很重要,但会不会在追求鲁棒性的同时,牺牲掉模型的其他性能或者让模型变得更复杂、更难训练呢?这两者之间有没有一个“最优解”?

原文内容

来源:专知本文约1000字,建议阅读5分钟本文将讨论在设计具备理想鲁棒性特性的算法方面的最新进展。

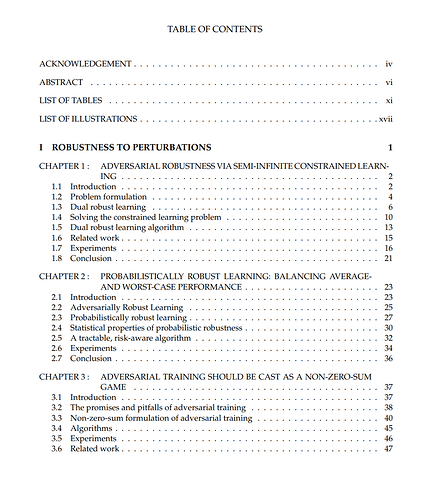

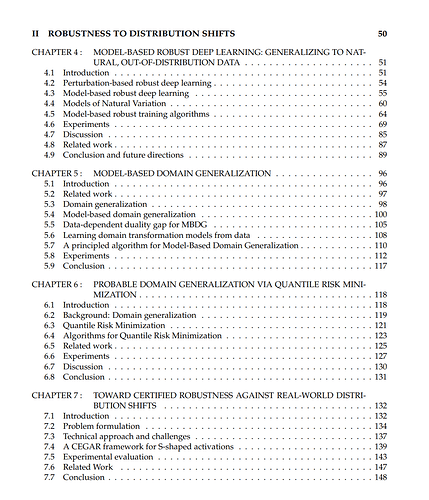

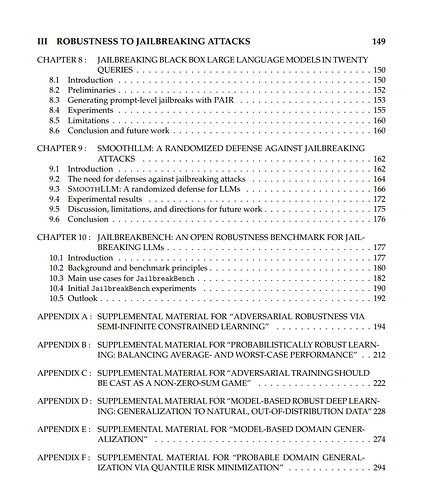

鉴于深度学习模型在安全关键型应用中的广泛使用,确保这些模型的决策在面对对抗性利用时依然具备鲁棒性具有根本性的重要意义。本文将讨论在设计具备理想鲁棒性特性的算法方面的最新进展。首先,我们探讨计算机视觉中的对抗样本问题,并提出新的技术成果、训练范式以及认证算法。接下来,我们考虑领域泛化问题,其任务是训练神经网络能够从一组训练分布泛化到未见过的测试分布。我们提出的新算法在医学影像、分子识别和图像分类中实现了当前最先进的泛化性能。最后,我们研究大语言模型(LLMs)越狱(jailbreaking)的场景,即对抗性用户试图设计提示词以引导模型生成不当内容。我们提出了新的攻击与防御方法,这些方法代表了在设计鲁棒的语言类智能体方面的前沿进展。