清华统一LLM训练SFT与RL,提出UPGE理论框架及HPT算法,实现动态自适应学习,显著提升模型性能与泛化力。

原文标题:打破SFT与RL的界限:清华提出统一LLM训练之道

原文作者:数据派THU

冷月清谈:

清华大学等团队的开创性论文《Towards a Unified View of Large Language Model Post-Training》首次从理论层面统一了SFT和RL的优化目标。他们提出了“统一策略梯度估计器”(UPGE),揭示了SFT、PPO、GRPO等多种训练方法本质上都是对同一目标函数在不同数据分布假设下的梯度估计。UPGE通过稳定性掩码、参考策略分母、优势估计和似然梯度这四大核心组件,实现了不同训练策略在梯度层面的统一,并阐明了它们在**偏差与方差权衡**上的固有差异。

基于UPGE的理论洞察,研究团队进一步设计了“混合后训练算法”(HPT)。HPT的核心创新在于其动态切换机制:它能根据模型对每个问题答案的正确率,自适应地选择使用SFT(当模型表现不佳时,侧重模仿学习)或RL(当模型表现良好时,侧重探索学习)。这种智能策略有效平衡了探索与利用,且无需人工设定复杂的混合比例。

实验结果令人鼓舞,HPT在多个数学推理基准测试中显著超越了现有最佳方法,尤其在分布外泛化能力上表现出明显优势,证明了其在提升LLM性能和适应性方面的强大潜力。这项研究为理解和优化LLM的后训练过程提供了**统一的理论框架和实用的算法**,预示着未来LLM的训练可能迈向更加智能化的自适应模式,从而培养出更“聪明”且更具泛化能力的模型。

怜星夜思:

2、论文里说SFT和RL在本质上是“同一枚硬币的两面”。你觉得在现实生活中,有没有什么事情或技能的学习过程,也很像SFT(模仿)和RL(试错)这样,最后却殊途同归的?能举个例子聊聊吗?

3、UPGE框架统一了SFT和各种RL方法的梯度形式。这意味着我们可以像搭积木一样选择组件。那么,如果给你一个全新的、还没被探索过的LLM任务(比如生成某种特定风格的艺术作品),你会怎么“组装”这些梯度组件来设计你的训练策略?为什么这么选?

原文内容

本文约3000字,建议阅读5分钟

SFT和RL并非彼此对立,而是同一枚硬币的两面。

SFT和RL并非彼此对立,而是同一枚硬币的两面。

在大语言模型(LLM)迅猛发展的今天,如何让模型变得更“聪明”——尤其是在数学推理、复杂问题解决等需要逻辑链条的任务上——已成为学界和工业界共同关注的焦点。目前,主流方法主要有两种:一是监督微调(SFT),即用人类写好的标准答案“手把手”教模型;二是强化学习(RL),让模型自己尝试解题,并根据结果的好坏自我调整。两者各有优劣:SFT学得稳但容易僵化;RL探索性强但初期容易“学歪”。

一个很自然的想法是:能不能把两者结合起来?近年来确实出现了不少混合使用SFT和RL的方法,但它们大多只是简单地将两个损失函数加权求和,缺乏深层的理论解释——为什么两者可以融合?它们本质上是冲突的还是互补的?这正是本论文所要回答的核心问题。

-

论文:Towards a Unified View of Large Language Model Post-Training

-

链接:https://arxiv.org/pdf/2509.04419

这篇由清华大学等单位合作完成的论文,首次从理论层面统一了SFT和RL的优化目标,提出了统一策略梯度估计器(Unified Policy Gradient Estimator, UPGE),并在此基础上设计了一种混合后训练算法(Hybrid Post-Training, HPT),能够根据模型的实际表现动态选择学习方式。实验表明,HPT在多个数学推理基准上显著超越了以往的最佳方法,且适用于不同规模的模型。

这不仅是一项技术突破,更是一次深刻的理论洞察:它告诉我们,SFT和RL并非彼此对立,而是同一枚硬币的两面。

背景与动机:SFT与RL的割裂与融合趋势监督微调(SFT)与强化学习(RL)的各自局限:

-

SFT 就像“模仿学习”:模型学习人类提供的示范数据,快速掌握解题模式。但缺点是容易过拟合——模型只擅长解见过的题,缺乏举一反三的能力。

-

RL 则更像“试错学习”:模型自己生成多种解法,根据正确与否(奖励信号)调整策略。它擅长探索新方法,但前提是模型本身要有一定基础,否则在初期可能完全得不到正向反馈,无法学习。

现有混合方法的不足与理论空白

以往混合方法(如LUFFY、SRFT)大多采用静态混合比例(如固定权重)或基于启发式规则(如根据熵动态调整)来结合SFT和RL。它们虽然有效,但缺乏一个统一的理论框架来解释:

-

为什么两种损失可以加在一起?

-

最优的混合比例应该如何确定?

-

是否存在一个共同的优化目标?

论文指出,唯有从梯度层面实现统一,才能从根本上理解这些方法的本质联系与差异。

核心理论:统一策略梯度估计器(UPGE)

UPGE的提出与通用形式

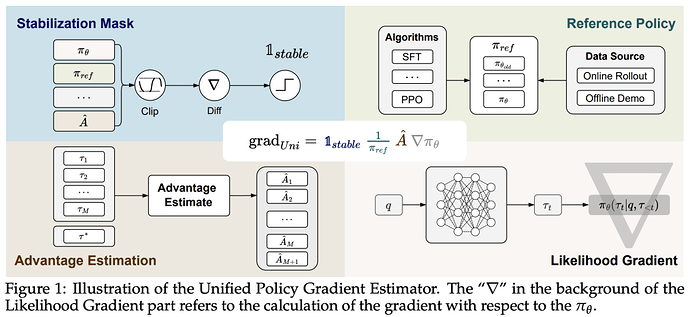

论文提出了一个简洁而强大的统一形式:

这个公式可以理解为:梯度 = 稳定性控制 × 重要性权重 × 优势信号 × 策略更新方向。

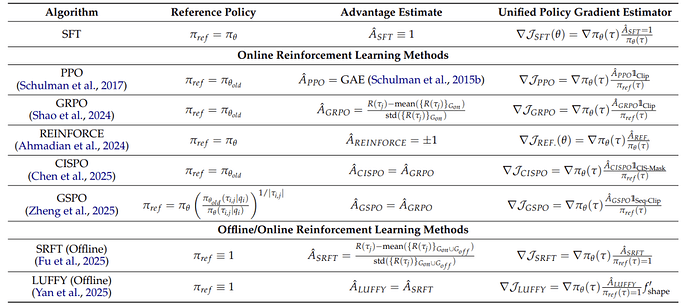

列出了SFT、PPO、GRPO、SRFT等方法的梯度形式,均可用上述统一形式表示。核心组件

-

稳定性掩码( )

防止梯度更新过大导致模型崩溃。例如PPO中的clip操作就是一个典型的掩码,当模型更新幅度超过阈值时,梯度会被截断。

就像学骑车时,父母会在后面扶着车把,防止你摔得太狠。 -

参考策略分母( )

调整不同token的重要性权重。SFT中使用当前策略 ,鼓励模型关注预测概率低的token;PPO中使用旧策略 ,控制更新幅度;离线RL中常设 ,简化计算但引入偏差。

老师批改作文时,对常见错误(高概率)略过,对罕见但精彩的表达(低概率)重点表扬。 -

优势估计( )

评价一个回答序列的好坏程度。SFT中所有样本默认为正样本( );RL中常用归一化后的奖励值(如GRPO中的组内归一化)。

考试后不仅看自己考了多少分,还要看自己在全班中的相对排名。 -

似然梯度( )

将前面的信号传递回模型参数,是实际执行参数更新的部分。所有方法共享这一项。

不管用什么教学方法,最终都要落实到学生大脑中的神经网络更新。

从共同目标推导UPGE

论文证明,SFT和RL实际上在优化同一个目标函数:

其中:

-

第一项是期望奖励最大化(RL的目标);

-

第二项是与示范策略 的KL散度最小化(SFT的目标)。

通过对该目标求导并引入重要性采样,即可推导出UPGE形式。这意味着SFT和RL本质上是同一目标在不同数据分布假设下的具体体现。

梯度分量分析:偏差-方差权衡

不同方法在四个组件上的选择,本质上是偏差-方差权衡的体现:

-

SFT方差小但偏差大(依赖示范数据);

-

RL偏差小但方差大(依赖模型自身探索);

-

离线RL设 降低了方差,但引入偏差;

-

PPO的clip降低方差,但可能过于保守。

UPGE的价值在于:我们可以像搭积木一样,根据不同任务和数据特性,组装出最合适的梯度估计器。

算法实现:混合后训练(HPT)

基于UPGE的理论洞察,论文提出了HPT算法,其核心思想是:让模型自己决定什么时候该模仿(SFT),什么时候该探索(RL)。

动态切换机制的设计原理

-

对每个问题 ,模型生成 个答案,计算正确率 。

-

根据 决定使用SFT还是RL:其中 是一个阈值(例如0或1)。

反馈函数与损失混合策略

-

当模型正确率低( ),说明它不会做,此时使用SFT学习示范答案。

-

当正确率高( ),说明它已掌握基础,切换至RL进行探索,寻找更多解法。

具体损失函数构成

-

:采用Dr. GRPO损失,含clip和优势归一化。

-

:标准交叉熵损失。

-

总损失:

实验设置:模型、基准与基线

-

模型:Qwen2.5-Math-1.5B/7B、LLaMA3.1-8B

-

基准:6个数学推理数据集(AIME、MATH等)+ 2个分布外测试集(ARC-c、GPQA)

-

基线:SFT、GRPO、LUFFY、SRFT、SFT→GRPO等

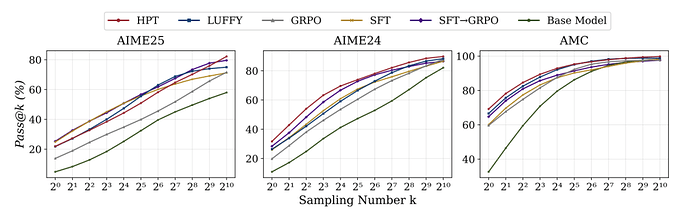

主实验结果:性能全面提升

HPT在几乎所有模型和基准上均取得最佳性能,尤其在分布外泛化上优势明显。例如在Qwen2.5-Math-7B上,HPT比最强基线高出7个百分点(AIME2024)。

训练动态分析:探索与利用的平衡

-

探索能力:HPT的Pass@1024显著高于纯RL方法,说明它既提升了性能上限,又保持了探索多样性。

-

利用能力:HPT解决了更多难题(见表4红色数字),且没有遗忘已学会的题目(绿色数字稳定)。

消融实验:离线RL作用与门限阈值选择

-

离线RL(如LUFFY)不如SFT有效,说明高质量的示范数据本身比复杂的离线RL算法更重要。

-

门限阈值 需谨慎选择: (仅在全错时用SFT)效果最好,说明过度依赖SFT反而会抑制探索。

统一视角的意义

UPGE首次将SFT、在线RL、离线RL等方法的梯度形式统一到一个框架下,揭示了它们本质上的共通性——都是对同一目标函数在不同数据分布下的梯度估计。

HPT的泛化性与适应性

HPT的成功得益于其简单而自适应的设计:

-

无需人工设定混合比例;

-

适用于不同规模模型;

-

在模型弱时侧重SFT,强时侧重RL,符合学习规律。

本论文通过理论统一和算法创新,解决了LLM后训练中SFT与RL融合的根本问题。UPGE框架为理解现有方法提供了共同基础,而HPT算法则展示了如何基于性能反馈实现动态平衡。未来工作可探索:

-

更精细的梯度组件组合策略;

-

扩展至多模态、跨任务场景;

-

理论分析更复杂的偏差-方差 trade-off。

编辑:黄继彦

点击下方链接下单你的DATA心愿!