DeepSeek开源685B实验模型V3.2-Exp,引入稀疏注意力机制DSA,成功在保持性能的同时提升长上下文处理效率,探索大模型新架构方向。

原文标题:刚刚,DeepSeek开源V3.2-Exp,公开新稀疏注意力机制DSA

原文作者:机器之心

冷月清谈:

怜星夜思:

2、文章里提到DSA能在不影响模型质量的情况下,显著提高长上下文训练和推理的效率。但现实中,这种稀疏注意力机制在实际应用,比如部署到特定硬件或者处理极其复杂的实时任务时,会不会遇到一些意想不到的挑战或者限制?大家有没有什么看法或者经验分享一下?

3、大模型厂商老喜欢在节假日、半夜搞事,DeepSeek这次在假期前一天发布,以及智谱GLM-4.6也即将推出,你们觉得这种“赶节奏”的发布策略背后,除了技术竞争,还有哪些方面的考量呢?对我们普通用户来说,是好事还是坏事?

原文内容

机器之心编辑部

还是熟悉的节奏!

在假期前一天,DeepSeek 果然搞事了。

刚刚,DeepSeek-V3.2-Exp 开源了!

该模型参数量为 685B,HuggingFace 链接:

https://huggingface.co/deepseek-ai/DeepSeek-V3.2-Exp

此外,此次发布竟然也同步公开了论文,公开了 DeepSeek 新的稀疏注意力机制,为我们提供了更多结束细节:

https://github.com/deepseek-ai/DeepSeek-V3.2-Exp/blob/main/DeepSeek_V3_2.pdf

DeepSeek Sparse Attention(DSA)稀疏注意力机制

在官方介绍中,DeepSeek 表示 DeepSeek-V3.2-Exp 是实验版本。作为迈向下一代架构的过渡,V3.2-Exp 在 V3.1-Terminus 的基础上引入了 DeepSeek 稀疏注意力机制(DeepSeek Sparse Attention,DSA)—— 一种旨在探索和验证在长上下文场景下训练和推理效率优化的稀疏注意力机制。

DSA 也是 3.2 版本的唯一架构改进。

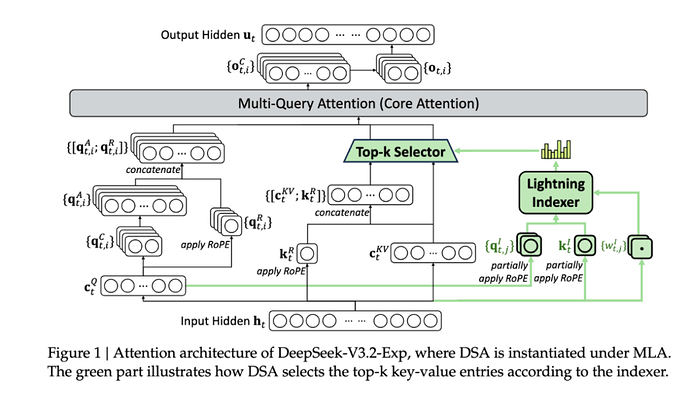

DeepSeek-V3.2-Exp 的架构,其中 DSA 在 MLA 下实例化。

重点要说的是,DeepSeek 称该实验版本代表了他们对更高效的 Transformer 架构的持续研究,特别注重提高处理扩展文本序列时的计算效率。

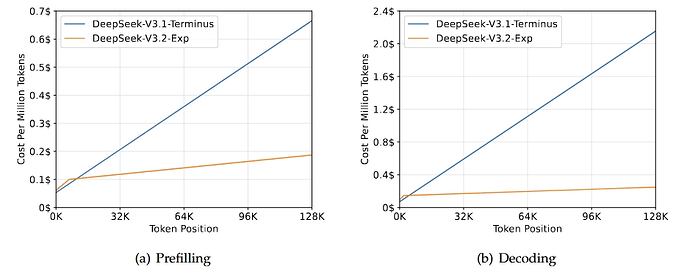

在 v3.2 版本中,DeepSeek 稀疏注意力 (DSA) 首次实现了细粒度稀疏注意力,在保持几乎相同的模型输出质量的同时,显著提高了长上下文训练和推理效率。

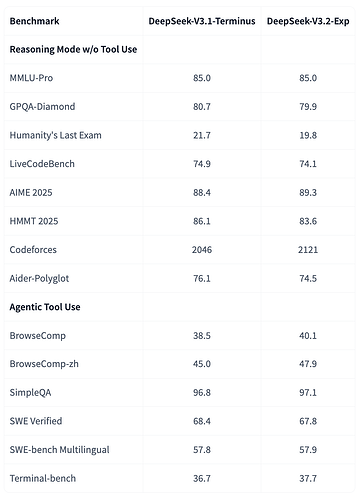

为了严格评估引入稀疏注意力机制的影响,DeepSeek 特意将 DeepSeek-V3.2-Exp 的训练配置与 9 月 22 日刚刚推出的 V3.1-Terminus 进行了对比。在各个领域的公开基准测试中,DeepSeek-V3.2-Exp 的表现与 V3.1-Terminus 相当。

更多信息,读者们可以查阅 DeepSeek-V3.2-Exp 的 huggingface 介绍。

值得一提的是,智谱的 GLM-4.6 也即将发布,在 Z.ai 官网可以看到,GLM-4.5 标识为上一代旗舰模型。

最后,有一波小节奏。在模型发布前,已经有网友在 Community 里发帖称:国庆是休息日,请给我们关注的同学一点休息时间。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com