字节跳动发布FutureX评测基准,挑战AI预测未来能力,考察远见而非记忆力。Grok-4目前领跑,但AI与人类仍有差距。

原文标题:AI智能体是否能预测未来?字节跳动seed发布FutureX动态评测基准

原文作者:机器之心

冷月清谈:

怜星夜思:

2、Grok-4现在在FutureX上表现最好,但跟人类专家比还有很大差距。你觉得AI要超越人类,最重要的是在哪方面取得突破?是推理能力,还是对“不确定性”的理解和处理?

3、文章里提到,AI预测未来需要“工具调用质量”、“搜索来源可靠性”和“推理规划全面性”。这三点里,你觉得哪一点是当前AI最薄弱的,或者说最难提升的?为什么?

原文内容

你有没有想过,AI 不仅能记住过去的一切,还能预见未知的未来?

想象一下,让 AI 预测下周的股价、下个月的票房冠军、甚至下届世界杯的赢家……这听起来像科幻片,但如今,它已经成为现实中一场「极限挑战」。

最近,一场专门考验 AI「预言」能力的考试——FutureX 动态评测基准正式发布。它由字节跳动 Seed 团队联合斯坦福大学 Jose Blanchet 教授团队、复旦大学邱锡鹏教授团队、普林斯顿大学王梦迪教授团队共同打造,让 Grok-4、GPT、Gemini 等模型齐聚预测未来的考场。

-

论文标题:FutureX: An Advanced Live Benchmark for LLM Agents in Future Prediction

-

项目主页:https://futurex-ai.github.io/

-

技术报告:https://huggingface.co/papers/2508.11987

-

数据: https://huggingface.co/datasets/futurex-ai/Futurex-Online

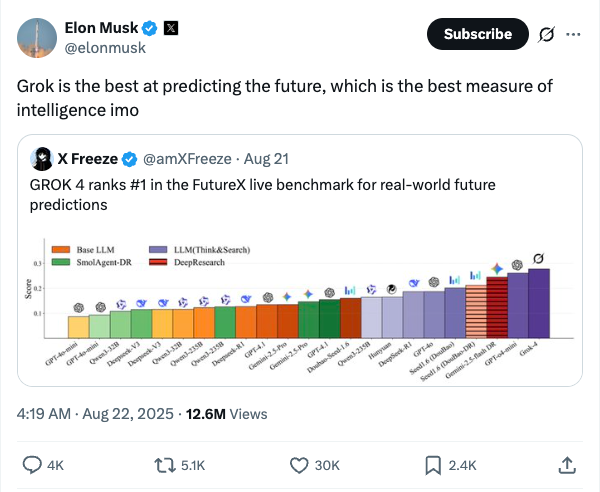

发布后 Elon Musk 转发,并评价该任务为「智能的真正度量」,推特浏览量过千万。

不考「记忆」考「远见」,FutureX 是什么?

过去的 AI 评测,总被诟病像「开卷默写」。题目是固定的,答案是已知的,提前「背好书」,就能轻松拿高分。这更像一场记忆力竞赛,而不是真正的智力考验。

FutureX 则改变了这一逻辑——它让 AI 预测的是尚未发生的未来,完全避免了数据污染/泄漏的可能,可以真实反映 AI 智能体的规划、搜索、复杂推理决策等能力。

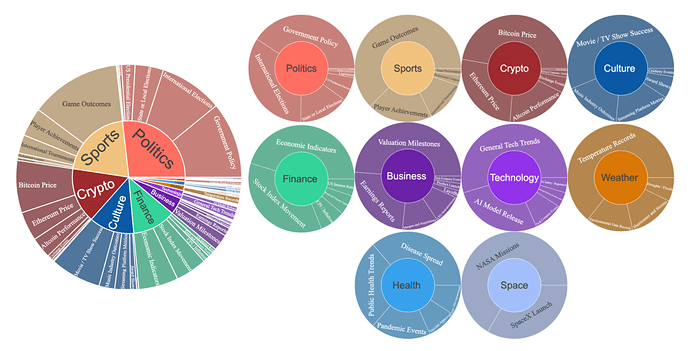

每周,系统会自动从全球 195 多个高质量信息源中,筛选出 500 个新的预测任务,涵盖经济、科技、体育等各个领域。从预测一部新电影的首周票房,到判断一场关键体育赛事的胜者,所有题目在 AI 作答时都没有「标准答案」。

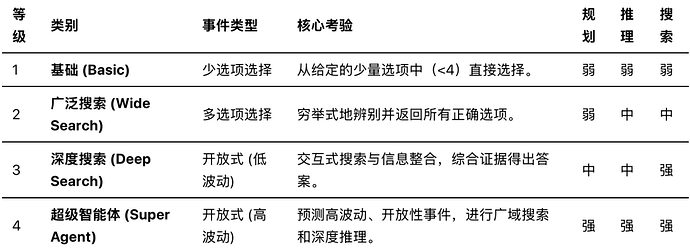

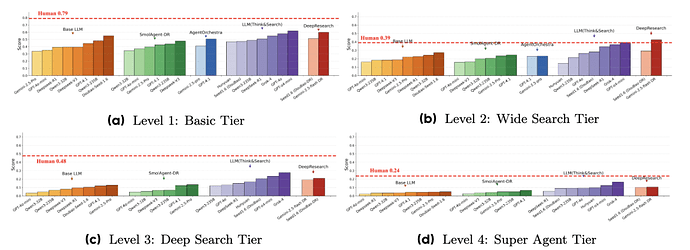

未来预测有多难?FutureX 的四层「进阶试炼」

预测未来从来不是简单的猜测,而是对信息搜集、趋势分析、风险判断等综合能力的终极考验。FutureX 将任务划分为四个难度层级,如同为 AI 智能体设置的「段位考核」:

这些任务并非凭空设计,而是基于 195 个精选自 2000 多个网站的高质量信息源,覆盖经济、科技、体育等多个领域,完全对接真实世界的复杂场景。

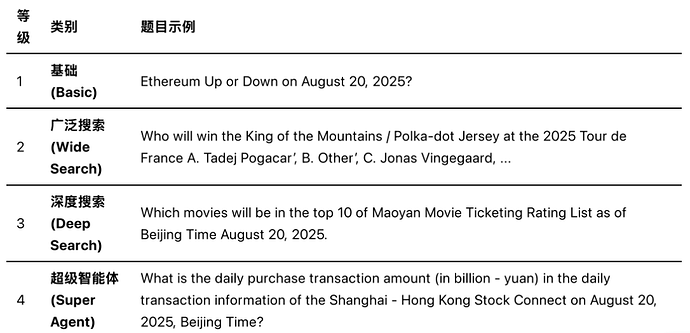

自动化评测体系,FutureX 是怎么构建的?

为了实现对未来事件的动态评估,FutureX 构建了一套完全闭环的自动化系统:

-

每天自动抓取值得预测的未来事件;

-

在事件发生之前调度 23 个主流 LLM/ 智能体进行预测;

-

在事件发生之后抓取事件结果进行评分。

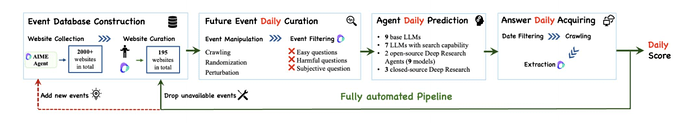

最新排行榜:谁在预测未来的赛道上领跑?

那么,在这场史无前例的「未来考试」中,谁拔得头筹?(数据统计自 7 月 20 日至 8 月 14 日)

核心发现:

-

Grok-4 暂时领跑,GPT 和 Gemini 紧随其后。 在所有模型中,Grok-4 的综合表现最为突出,拔得头筹。紧随其后的是 GPT-4o-mini 和 Gemini-2.5-flash Deep Research。字节跳动Seed系列模型也展现了不俗的实力。

-

AI 智能体距离人类专家仍有差距。 表现最好的 Grok-4 在 L4(高波动开放任务)上的准确率只有不到 20%,大部分 agents 的准确率只有不到 10%,仍明显落后于人类预测。

-

预测未来是推理和搜索的结合。 在简单选择题上,不依赖工具的基础 LLM 表现惊人,比如 DouBao-Seed1.6-Thinking 甚至超过部分带搜索功能的智能体;但到了复杂任务,能实时调用工具的智能体优势立刻显现,说明「联网搜索」是 AI 应对复杂预测的必备技能。

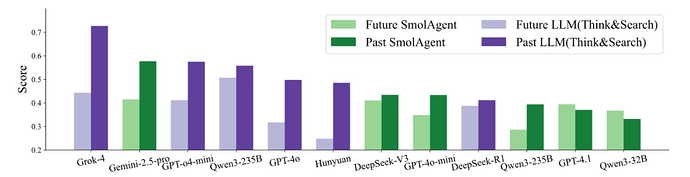

AI 的「神预言」vs「马后炮」:差距有多大?

为了搞清楚「预测」到底比「搜索」难多少,研究团队做了一个对比实验:

-

事前预测(神预言模式): 在事件发生前,预测结果。

-

事后搜索(马后炮模式): 在事件发生后,去网上查找并回答结果。

结果发现:Grok-4 在开启「马后炮模式」时,凭借强大的搜索能力,准确率可以轻松达到很高的水平。然而,一旦切换到「神预言模式」,准确率便断崖式下跌。

这个对比一针见血地指出:搜索信息只是 AI 的基本功,真正的难点在于如何在信息不完整、充满不确定性的情况下,进行高质量的推理和判断。这才是「预测」的精髓,也是 AI 最需要突破的瓶颈。

解密未来预测:AI 需要练好哪些「内功」?

为什么预测未来如此之难?研究发现,三大核心能力至关重要:

-

工具调用质量: 能否精准、高效地使用搜索等工具。

-

搜索来源可靠性: 能否从海量信息中辨别真伪,找到关键信源。

-

推理规划全面性: 能否像人类专家一样,构建全面、严谨的逻辑链条。

简单来说,强大的搜索力和思考力缺一不可。这正是 FutureX 希望推动 AI 发展的核心方向。

未来已来:推动 AI 从「已知」走向「未知」

FutureX 的探索仅仅是一个开始。我们的研究揭示了当前 AI 智能体在迈向真正实用的道路上,必须克服的核心挑战:如何在信息爆炸、充满不确定性的真实世界中,像人类专家一样进行思考、推理和决策。

我们坚信,FutureX 有潜力成为推动 LLM 智能体发展的关键引擎。通过提供一个公平、动态且极具挑战性的评估平台,我们希望能激励学术界和工业界的研究者们,共同开发出能够在高风险、高复杂度真实场景中,比肩甚至超越人类顶尖分析师的下一代 AI 智能体。

周赛开启:一起来可靠评测 Agent

每周题目发布于 https://huggingface.co/datasets/futurex-ai/Futurex-Online ,预测提交截止为每周三晚 23:59。欢迎阅读我们的技术报告,与我们一同探索 AI 的未来。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com