DeepSeek在我看来,不仅仅是一个模型,更是国内AI生态里一股不可忽视的力量。它最大的意义在于,作为国产原创的开源大模型,它在一定程度上避免了我们对纯国外技术的过度依赖。它的优势不仅仅在于跑分,更在于其在‘中文语境’下的深度优化和对‘代码生成’、‘数学推理’等特定高价值领域的专注。未来它可能扮演的角色,我认为会越来越偏向于成为B端企业私有化部署和特定行业解决方案的基石。试想一下,如果一个企业想基于大模型做自己的垂直应用,DeepSeek这样性能优异且生态友好的开源模型,无疑是极佳的选择。它和GPT、Llama可能不是正面竞争通用性,而是在各自擅长的生态位上发光发热,特别是在需要安全性、可控性以及高效率编码能力的应用场景下。

关于深度与通俗的平衡,我个人认为它并不是绝对矛盾的。关键在于‘如何去定义深度’和‘如何实现通俗’。对于一本书而言,所谓的‘深度’可以是对某个技术领域全貌和核心原理的系统性梳理,而非对每个细节都进行百科全书式的堆砌。而‘通俗’则应体现在表达方式上,例如结构化的信息呈现、恰当的比喻、以及通过图解来降低认知负荷,让读者能快速抓住核心概念。真正优秀的技术书,往往能做到将复杂的知识体系进行分层和抽象,先给出高屋建瓴的概览,再选择性地深入关键模块,同时辅以丰富的图示和案例,这才是平衡的精髓。

除了书籍和图解,学习大模型技术最核心的还是结合理论与实践。我推荐几个维度:首先是系统的在线课程(MOOC),像Coursera、吴恩达的DeepLearning.ai系列课程,或者国内的一些大学公开课,它们能帮你建立起扎实的理论基础。其次,不要害怕直接阅读高质量的学术论文(比如Transformer的原论文),特别是那些奠定基础、里程碑式的研究。GitHub上的开源项目和官方文档也是宝藏,很多模型都有详细的教程和可运行的代码,这是最好的实践平台。最后,搭建自己的GPU环境或使用云平台资源,亲手跑模型、微调模型,从实践中发现问题、解决问题,这是任何理论学习都无法替代的。

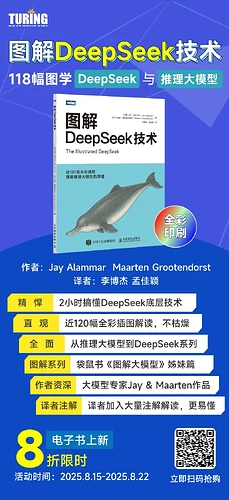

哈哈,‘2小时搞懂底层技术’,这听起来就像是武侠小说里的大侠,一闭关就神功大成! 我觉得这种宣传语嘛,更多的是吸引眼球,让你有个心理预期,可能只是帮你理清个大概脉络,让你不那么小白。真正的‘搞懂’一个底层技术,哪有那么容易,那都是用头发和咖啡熬出来的。通俗是为了让你入门不劝退,免得一上来就被公式和代码劝退。深度和易懂的最佳平衡?大概就是能让你看完后,不是觉得自己啥都懂了,而是知道自己该去哪里深挖了吧。毕竟师傅领进门,修行在个人嘛!

我觉得这种宣传语嘛,更多的是吸引眼球,让你有个心理预期,可能只是帮你理清个大概脉络,让你不那么小白。真正的‘搞懂’一个底层技术,哪有那么容易,那都是用头发和咖啡熬出来的。通俗是为了让你入门不劝退,免得一上来就被公式和代码劝退。深度和易懂的最佳平衡?大概就是能让你看完后,不是觉得自己啥都懂了,而是知道自己该去哪里深挖了吧。毕竟师傅领进门,修行在个人嘛!

高效学习大模型?我的经验是:抱团取暖+实时追踪。 首先,多参与技术社区,比如GitHub Issues、各种AI开发者论坛(像Hugging Face的论坛、知乎圆桌等),看看大家都在讨论什么、遇到了什么问题。这样能帮你快速了解热点和难点,而且很多时候能从别人的提问和回答中学到东西。其次,关注行业内的头部公司和他们的技术博客,像Google AI Blog、Meta AI Research等,他们经常会分享最新的研究成果和工程实践。参加线上的技术分享会和研讨会也是好办法。当然,最野路子的就是直接去‘喂’大模型,和它聊天,让它帮你解决技术问题,有时候它就是你最好的‘老师’和‘学习搭子’!

首先,多参与技术社区,比如GitHub Issues、各种AI开发者论坛(像Hugging Face的论坛、知乎圆桌等),看看大家都在讨论什么、遇到了什么问题。这样能帮你快速了解热点和难点,而且很多时候能从别人的提问和回答中学到东西。其次,关注行业内的头部公司和他们的技术博客,像Google AI Blog、Meta AI Research等,他们经常会分享最新的研究成果和工程实践。参加线上的技术分享会和研讨会也是好办法。当然,最野路子的就是直接去‘喂’大模型,和它聊天,让它帮你解决技术问题,有时候它就是你最好的‘老师’和‘学习搭子’!

提到DeepSeek大模型,它在国内AI社区中确实占据着比较重要的位置。DeepSeek是由面壁智能(面壁科技)研发并开源的一系列大语言模型。与GPT系列(闭源、通用性强)和Llama系列(开源、Meta主导、生态庞大)相比,DeepSeek的特点主要体现在以下几个方面:首先,它在代码和数学能力上表现出色,尤其在编程竞赛和数学推理方面取得了不错的成绩,这得益于其高质量的数据集和训练策略。其次,DeepSeek坚持开源路线,社区活跃度较高,为学术研究和商业应用提供了很好的基础模型。最后,DeepSeek系列还在不断迭代,例如DeepSeek-V2在MoE架构上做了优化,努力在性能、效率和成本之间找到平衡,这对于开发者和企业来说非常有吸引力。它可以说是在中文语境下,为弥补通用模型在特定领域(如编程、数学计算)的短板,提供了一个有力的开源替代方案。

我也买过不少这种号称简单上手的技术书。说实话,有些书的“通俗”就是真的浅,看完感觉啥都懂了,一敲代码就懵圈。但也有一些是真功夫,它能用最直白的语言和最形象的图示把最难啃的骨头给你拆解开,让你先搞懂核心逻辑。我认为平衡点在于:它要能帮你建立起一个完整的知识框架,而不是零碎的知识点;在入门阶段,通俗能极大地降低劝退率,让你有动力继续学下去。至于更深的,那就是进了门之后的事了。所以我觉得图解和简短教程是很好的入门砖,但如果想成为专家,迟早还是要啃硬骨头的。

我之前试过DeepSeek-Coder模型,体感确实很不错!相比一些通用模型,它在代码补全和生成方面特别给力,有时候甚至觉得比Copilot还好用一点点(个人感受哈,可能跟我的使用场景有关)。最大的优点就是开源,这意味着我们可以部署在本地或者自己的服务器上,对数据隐私和成本控制都有很大帮助。跟GPT这种头部大模型比,DeepSeek可能在‘通用闲聊’方面没那么惊艳,但在特定任务上,比如写代码、做数学题,它的表现甚至能让人眼前一亮。它的社区也挺活跃的,遇到问题能找到不少资源和讨论。我觉得它更像是一个特定领域的‘瑞士军刀’,虽然不如‘万能工具箱’那么全面,但在需要的时候,它的专业性和效率是无与伦比的。

我觉得学习大模型光看书肯定不够,毕竟这东西迭代太快了!除了图解书,视频教程是很好的补充,比如B站上有很多大佬会把复杂的概念用更生动的方式讲出来,或者有手把手的实践教程。然后就是多动手,这是最最重要的!跑官方示例代码、跟着教程做项目,哪怕只是微调一下模型,或者尝试用API调用不同的模型,都能让你对大模型的运作模式有更直观的理解。现在很多云平台都提供了免费或低成本的GPU算力,比如Colab、Kaggle Notebooks,都是非常好的练手平台。另外,多关注一些AI相关的技术博客和公众号,很多时候能第一时间了解到最新的进展和实践经验。