Qwen3团队提出GSPO算法,通过序列级重要性权重解决大型模型强化学习及MoE模型训练难题。

原文标题:DeepSeek-GRPO重要性权重设计错误?详解Qwen3新强化学习算法GSPO

原文作者:数据派THU

冷月清谈:

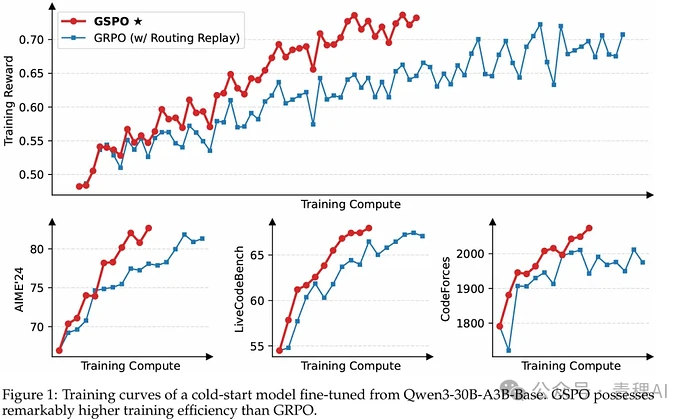

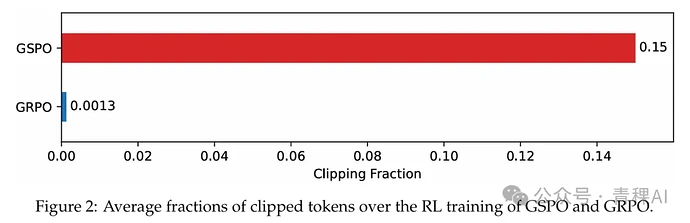

GSPO的核心改进在于,将重要性权重从token级别转换到序列(sequence)级别,并从序列维度计算梯度,使其与奖励函数的定义保持一致。这一改变不仅解决了RL训练中的稳定性难题,尤其是在MoE模型训练中表现卓著,避免了额外复杂的稳定策略,简化了RL架构。实验结果显示,相对于GRPO加路由重放策略,GSPO在Qwen3模型上展现出更高的训练效率。尽管GSPO可能裁减掉更多的序列,但它提供了更可靠且高效的学习信号,从而实现更快、更稳定的收敛。

文章还探讨了GSPO的变体GSPO-token,以便在特定场景下(如多轮RL)仍能实现token级别的优势细粒度调整。整体而言,GSPO为大型语言模型和MoE模型的强化学习训练带来了显著的进步,提高了训练的鲁棒性和效率。

怜星夜思:

2、文章提到“GSPO clip掉更多的tokens,但是却拥有更高的训练效率,这说明GSPO可能提供比GRPO更可靠且高效的学习信号。”这句怎么理解?是不是意味着有时候“宁可错杀一千,不可放过一个”反而比“谨慎行事”效率更高?在实际训练中,这种“大刀阔斧”的策略会带来什么意想不到的优势或潜在风险?

3、GSPO偏向于序列级别的优化,GRPO及其变体GSPO-token则在token级别上有细粒度调整的能力。在实际的大型语言模型应用中,比如客服对话、代码生成、创意写作等场景,大家觉得哪种粒度的优化会更吃香?为什么?

原文内容

来源:深度学习自然语言处理作者:绊缘

https://zhuanlan.zhihu.com/p/1932829167801574272

本文约1800字,建议阅读5分钟在本论文中,我们旨在通过关注多模态智能的三个关键维度来推动该领域的发展:多模态对齐性、鲁棒性和泛化性。

1. 引言

在更大的语言模型上使用 GRPO 时,会出现训练不稳定的情况[1][2]。在这篇论文,作者认为这种现象源于 GRPO 的重要性权重的设计错误,GRPO 对于 next-token 的重要性权重,容易引入高方差的噪声,在 response 的长度的增加和裁剪机制的作用下,最终导致训练崩溃。

为了解决这一问题,论文提出 GSPO (Group Sequence Policy Optimization),将针对 token 分布的权重改换为针对 sequence 的重要性权重,并且从 sequence 的维度来计算梯度,而不是 token 的维度,和 reward 本身的定义保持一致。

最终,GSPO 在 MoE 模型的 RL 训练上解决了稳定性问题,从而不必单独设计复杂的 trick 来维持稳定,简化了 RL 架构。

2. 动机

RL 阶段,我们首先会采样一个 large rollout batch,为了提高采样效率,通常我们会将其切分成几个 mini-batches 来进行梯度更新,这一过程无可避免地会导致 off-policy 场景的出现,同时这也一定程度上说明了 PPO 和 GRPO 的 clip 机制可以防止那些过度 off-policy 的样本参与梯度计算。

尽管类似 clip 的机制有助于缓解 off-policy 带来的问题,然而 GRPO 错误应用了重要性权重。

重要性采样. 借助对于从行为分布 采样的权重进行权重分配,从而用来估计函数 在目标分布 下的期望:

这需要从行为分布采样多个样本,而不是一个。

然而 GRPO 中重要性权重设计为 ,这一权重主要考虑 ,显然这个分布在当前的 setting 下只有一个采样样本,即 ,而这违背了采样性权重的期望形式的定义。

而如果重要性权重是应用在 上,即从 sequnece-level 上去考虑整个优化问题,在 GRPO 算法里至少我们拥有一组针对同一分布的重要性权重值,而且 sequnece-level 更能匹配奖励函数的设计 (奖励一般是针对整个 response 打分)。

3. 算法

当我们从 sequence-level 上考虑问题,按照重要性采样定义,RL 的目标为:

这很自然地和 sequence-level reward 定义一致,也让 clip 的机制意义更明确 (筛去过度 off-policy 的 sequence 的梯度)。

基于以上观察,论文提出 GSPO 算法,它使用以下目标:

奖励使用 group-based 来估计:

重要性权重使用平均后的序列似然来定义:

4. 分析

我们将 GSPO 和 GRPO 目标的梯度进行对比:

GRPO 的梯度为:

二者的区别主要在于,如何给 tokens 的似然的梯度赋予权重。可以看到 GRPO,针对每个 token 赋予分布 的重要性采样权重。然而,这样的 所修正的分布对于每个 token 来说是不一致的,将它们都用一个标准 来 clip 也显得不合适。相比之下,GSPO 为 tokens 赋予 sequence 级别重要性采样权重。

4.1 token level 上的变体

某些场景下 (multi-turnRL),我们可能还是想在 token 级别上针对优势进行细粒度调整,为此,论文提出了 GSPO 的变体 GSPO-token,它拥有和 GSPO 一致的梯度。

其中

这里 表示 stop gradient,作为常数参与梯度计算。当 时,GSPO-token 在优化目标、裁剪条件以及理论梯度方面在数值上与 GSPO 是一致的。

5. 实验

5.1 实验结果

使用基于 Qwen3-30B-A3B-Base 的 SFT 微调后的冷启动模型,采用 GSPO (不使用路由重放策略)和 GRPO + Routing Replay training strategy 两者设置。下图给出了训练时奖励的变化曲线以及在 AIME24、LiveCodeBench、CodeForces (Elo Rating)上的表现。

相比 GRPO,GSPO 训练效率在 Qwen3 上更高。

5.2 clip 比例上的观察

GSPO 会 clip 整个 response 的 tokens,而 GRPO 则 clip 一些 over off-policy 的 tokens。 统计训练中两种实验的 clip 比例,得到下图:

GSPO clip 掉更多的 tokens,但是却拥有更高的训练效率,这说明 GSPO 可能提供比 GRPO 更可靠且高效的学习信号。

5.3 MoE 训练中效果

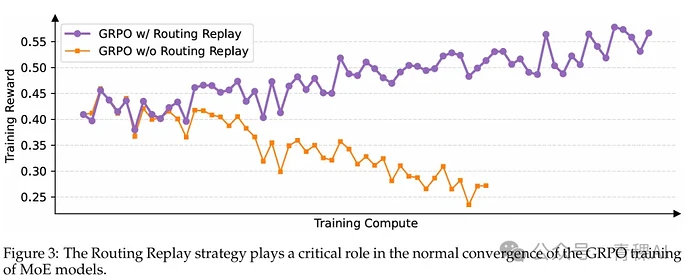

背景. MoE 模型的训练中,使用 GRPO 算法,专家激活的不稳定性可能会导致强化学习训练无法正常收敛,进行一次梯度更新后,即使对于相同的 response,所激活的专家也可能发生显著变化。这一不稳定要素,导致 token 级别的重要性权重波动更大,从而如之前讨论的,最后导致模型崩溃。

先前的方法. 使用 Routing Replay 策略,训练时,存储 被激活的专家有哪些,当计算重要性权重 时,在 重新 replay 之前存储的路由的策略。这种情况下,则能确保对于每个 ,重要性权重的分子分母使用同样的激活网络进行计算。下图展示这一策略带来的好处:

GSPO 的效果. 但是上述启发式策略,存在额外的内存和通信开销,也会限制 MoE 模型的实际知识容量。实验上,可以看到 GSPO 比 GRPO + routing replay 策略效率更高,且训练稳定;从理论上来说,MoE 模型仍然保留语言模型的能力,sequence 的似然比起单个 token 的似然在 MoE 模型的输出中更加稳定。

参考

[1]Team Qwen. Qwen3technical report. arXiv preprint arXiv:2505.09388, 2025a.

[2] MiniMax. Minimax-m1: Scaling test-time compute efficiently with lightning attention. arXiv pr

[2] MiniMax. Minimax-m1: Scaling test-time compute efficiently with lightning attention. arXiv pr

编辑:文婧