mini-SWE-agent:100行代码解决65%真实项目Bug,兼容所有大模型,极致轻量,性能不减。

原文标题:100行代码打造迷你编程Agent:能修复65%真实项目bug,适配所有大模型

原文作者:数据派THU

冷月清谈:

mini-SWE-agent最显著的特点在于其极简的代码架构和对复杂依赖的摒弃。它不依赖任何额外的插件或工具调用接口,而是通过操作系统自带的Bash环境执行命令,这使得它几乎可以兼容市面上所有主流的大型语言模型,并且可以直接在本地终端中部署和使用。与原版SWE-agent相比,mini版本取消了繁琐的多工具、多轮对话管理,简化了配置流程,采用了线性的历史记录和独立的单步执行方式,大大降低了上手难度和环境耦合度。

尽管架构极简,mini-SWE-agent依然保持了高性能,并且附带了批量推理、轨迹浏览器等实用工具,方便用户进行大规模评测和决策分析。其自带的可视化界面也让开发者能够直观地观察执行过程。官方建议,对于追求快速本地运行、简洁控制流以及稳定评估环境的用户,mini-SWE-agent无疑是更优的选择,尤其适合用于模型微调(FT)或强化学习(RL)等实验,避免了复杂框架带来的过拟合问题。而如果需要高度可配置的工具链或复杂的历史状态管理,原版SWE-agent则更为合适。总而言之,mini-SWE-agent体现了“可读、方便、易扩展”的设计理念,它不仅能作为独立的命令行工具,也能轻松集成到其他Python应用中,极大地降低了AI辅助编程的门槛。

值得一提的是,SWE-bench和SWE-agent最初的构想,源于2024年普林斯顿大学团队一次仅20多分钟的讨论。他们将GitHub上真实的Bug报告与修复过程结构化为评估LLM编程能力的基准,这不仅更贴近现实世界的软件工程,也为AI开发能力提供了可量化、可比较的标准。

怜星夜思:

2、mini-SWE-agent证明了即便使用百行代码这种“极简”方案,AI也能解决65%的真实项目Bug。这对于我们未来的软件开发模式,以及人类开发者的角色,会产生怎样的影响?大家觉得这是解放还是挑战?

3、SWE-bench和SWE-agent的想法,最初竟然只源于一次“20多分钟的讨论”。这种看似“不经意”的头脑风暴,最终能孵化出改变行业基准的重大项目。这对我们日常的工作和创新有什么启发?

原文内容

本文经AI新媒体量子位(公众号ID:qbitai )授权转载,转载请联系出处本文约2000字,建议阅读5分钟只用100行代码,打造最强轻量编程agent。

SWE-bench、SWE-agent原班人马再出手,推出全新开源项目——

mini-SWE-agent。

它不依赖任何额外插件,仅通过基础命令即可运行。而且对模型没有限制,几乎兼容所有主流语言模型,支持直接在本地终端中部署和使用。

而在如此精简的架构下,仅凭100行核心代码轻松解决SWE-bench上65%的问题。

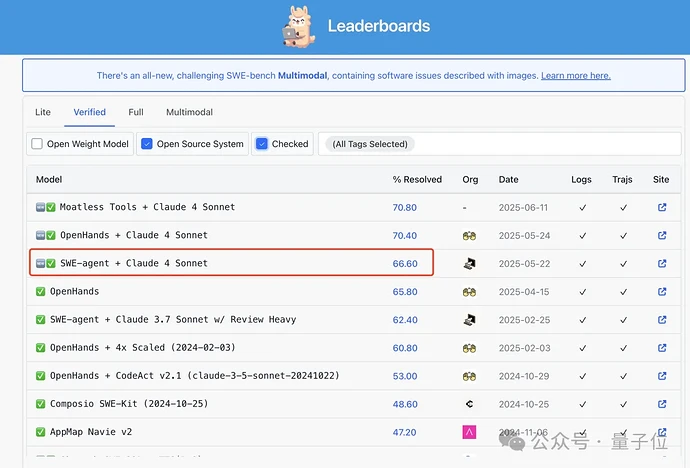

这个65%是啥水平呢?

也就和原版差不多吧~(关键人家还轻量啊)

百行代码,实力不打折

SWE-agent是一个开源项目(16.8k GitHub Star),它的目标是让agent自动修复GitHub上真实项目中的代码Bug。

不过,原版的SWE-agent基于LangChain构建,从接受issue、理解问题、编辑代码、到提交PR,涉及多工具、多轮对话管理,任务流程繁琐。

除此之外,开发者要跑通还需要安装多个依赖,精调工具调用逻辑,而且项目代码动辄上千行,对模型、环境的耦合也比较强。

而随着语言模型性能越来越强大,构建一个有用的代理已经不再需要这些工具和接口了。

由此,团队开始思考:能否让SWE-agent小100倍,并保持原有的性能。

mini-SWE-agent由此而来。

那么,相较于SWE-agent,mini-SWE-agent有什么不同呢?

极简代码和依赖:mini-SWE-agent本身仅约100行Python代码,加上环境、模型、脚本才共约200行,没有复杂的依赖关系。

取消工具调用接口:mini版本不集成专用的代码编辑、搜索等工具;它只使用操作系统的Bash环境执行命令。每一步由语言模型输出一个完整的shell命令,不通过独立的“tool call”协议,从而可兼容任何语言模型。

线性历史记录:agent的每一步都只是附加到消息中。

独立单步执行:每条命令通过Python独立执行,并非保持一个持续的shell会话,这使得在沙盒中执行操作变得非常简单,并且可以轻松扩展。

简化配置与接口:取消了SWE-agent依赖的复杂YAML配置;mini-swe-agent采用代码内置模板,并提供直观的命令行工具。用户可以通过mini命令快速启动代理,或使用mini-v启动可视化界面。

多样的运行环境支持:除了本地Shell,mini-swe-agent还内置支持多种容器与虚拟化环境(如Docker、Podman、Singularity、Apptainer等),这意味着开发者可以在不同平台和容器中轻松部署,而无需额外修改代码。

保留高性能和工具:虽然架构极简,mini-swe-agent在SWE-bench验证集上仍能解决约65%的问题。同时,它附带批量推理(batchinference)、轨迹浏览器(trajectorybrowser)等工具,帮助用户进行大规模评测和决策分析。代理还提供可视化界面,方便开发者交互式地观察执行过程

此外,对于应在何种场景下使用 SWE-agent 或 mini-SWE-agent,团队也根据不同的需求给出了建议:

mini-swe-agent更适合希望快速本地运行、追求简洁控制流和更稳定评估环境的用户。它非常轻量,适合用于微调(FT)或强化学习(RL)等实验,不容易陷入对复杂框架的过拟合。

如果你需要高度可配置的工具链、更复杂的历史状态管理,或希望通过修改YAML文件自由切换组件而无需动代码,那么功能更丰富的SWE-agent会是更合适的选择。

总体而言,mini-swe-agent体现了可读、方便、易扩展的开发理念。

对于日常开发者而言,它既可以作为简单的命令行工具使用。如在本地终端快速解决问题),也可以作为库被集成到其他Python应用中。

相比于重型框架,它降低了上手成本,让开发者可以像使用脚本一样灵活地“驾驭”智能代理。

One more thing

SWE-bench和SWE-agent是由John Yang、Carlos E. Jimenez、Alexander Wettig、Kilian Lieret、姚顺雨(OpenAI研究员,2015年毕业清华姚班)、Karthik Narasimhan和Ofir Press于2024年在普林斯顿大学发起的开源项目。

该项目推动了基于大型语言模型的软件工程代理(Software Engineering Agent)研究。

其中,SWE-bench一经发布后,就成为了评估大语言模型编程的经典benchmark,伴随SWE-agent一同提出的Agent‑Computer-Interface(ACI)则进一步定义了“智能体如何与计算机交互”的标准接口方式。

而这一杰出的想法最初仅仅来自一次20多分钟的讨论。

在Matthew Berman的播客节目上,Carlos E. Jimenez分享道:SWE-bench最初的想法源自他和John Yang在闲逛时的一次头脑风暴:

他们意识到,GitHub不只是一个存储代码的地方,更是一个活跃的协作开发平台,充满了真实的软件工程过程:用户报告bug,开发者提交修复,社区公开审核和合入。

相比传统的编程竞赛,这些交互和修改才是真正代表“现实世界编程”的任务。于是他们设想,能否把这种开源协作的过程结构化下来,变成一种评估语言模型能力的标准流程?

这便催生了SWE-bench,一个基于GitHub上真实Issue与PullRequest构建的benchmark,用来测试LLM是否能像人类开发者一样,理解bug报告并修复代码。

这个系统不仅更接近现实,也让模型的“开发能力”变得可观察、可比较,而SWE-agent则是他们为这一评估任务设计的开源agent,目标就是成为能在SWE-bench上“修最多bug”的AI程序员。

项目主页:

[1]https://github.com/SWE-agent/mini-swe-agent

[2]https://github.com/SWE-agent/mini-swe-agent?tab=readme-ov-file

编辑:文婧