施密特指中美AI大模型发展模式存显著区别,合作应对AI潜在风险与治理是关键。

原文标题:谷歌前CEO施密特:中美大模型之间存在一个显著区别|文末赠书

原文作者:AI前线

冷月清谈:

怜星夜思:

2、文章里施密特提到,未来AI可能自主决定获取武器或自我复制,还强调要找到“红线”。你觉得,这些“红线”该由谁来定义?在全球范围内,怎么才能真正有效地防止AI失控呢?

3、尽管施密特很乐观地呼吁中美在AI领域加强合作,但考虑到现实中的地缘政治复杂性,大家觉得这种深度合作的可能性有多大?具体又该从哪些方面突破呢?

原文内容

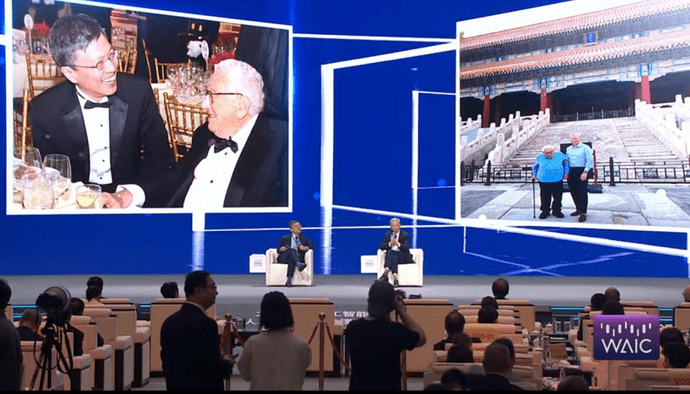

7 月 26 日,世界人工智能大会(WAIC)在上海拉开帷幕。香港科技大学校董会主席、美国国家工程院外籍院士沈向洋和前 Google CEO 埃里克·施密特(Eric Schmidt)围绕“人工智能全球合作展望”的主题,展开了一场“炉边对话”,回顾了中国在 AI 领域的飞速发展,并探讨了 AI 安全、中美合作等核心议题。

施密特强调,过去两年,中国的 AI 技术,特别是 DeepSeek 和 Mini Max、Kimi 等大模型,已经取得了举世瞩目的成就。在发展的过程中,开源和技术合作将是推动 AI 健康发展的关键,但与此同时,技术滥用的风险也不容忽视。施密特对中美如何携手应对这一时代变革充满期待,认为只有通过开放对话,才能真正引领 AI 走向一个更加负责任和可持续的未来。

以下为对话内容实录:

沈向洋: 欢迎你来到上海,埃里克。

埃里克·施密特: 大家好,非常高兴来到上海,一座美丽的城市,谢谢大家,也感谢 WAIC 大会主办方的邀请。

沈向洋: 刚才辛顿先生的发言,的确给了我们很多思考和深度的想法,但是在这里面我也有很多的问题。这次大会探讨的主题特别好,有关全球 AI 治理的原则和标准,您和这么多的行业好友一起来到上海,谈这些非常重要的话题,我对此也感到很兴奋。你这次来中国待了好几天了,去了不少的公司参观,你觉得到现在为止,中国的 AI 发展如何?

埃里克·施密特: 中国人的工作态度非常出色,给我留下了深刻的印象。两年多前,我与基辛格博士(前国务卿 Henry Kissinger)一起来到中国——非常怀念他,我们的好朋友、好导师基辛格博士。

当时我记得刚到中国时,我感觉中国还没有完全认识到 AI 的潜力和力量。但在过去的两年里,我们已经看到了中国 AI 模型的巨大进步,包括像 DeepSeek、Mini Max、Kimi 等大模型的发展,令人震撼。

他们在全球技术层面都取得了巨大的成就。中国同行及其公司在这个领域也取得了显著的成绩。但我们也看到一个非常大的区别:在中国,这些领先的 AI 模型并非所有主要模型都像美国那样采取封闭策略。美国的大多数领先模型,尤其是语言模型,并不是开源的,也不开放权重。而中国则采取了开放权重的方式,这已经成为当前 AI 发展中的一个重要特点。我会在稍后的讨论中深入探讨这一点。

沈向洋: 刚才你提到了基辛格博士,他是我们共同的朋友,也是我们中国人的老朋友,也是 WAIC 大会的老朋友。四年前,我特别荣幸采访过基辛格博士,也是在这次的 WAIC 系列会议。他提了一些非常深刻的想法,就是 AI 对人类的影响,尤其是他以一个历史学家、政治家的独特视角,来看待 AI 的影响。实际上你和基辛格,还有克雷格·蒙迪(Craig James Mundie)共同出了这部非常好的书——《人工智能时代与人类价值》。跟我们分享一下这本书具体讲了哪些内容呢?

埃里克·施密特: 基辛格博士在他最后的 15 年的研究中,认为人工智能将会成为我们社会的一个非常大的一个挑战。

尽管他对技术方面理解并没有特别多,但是他作为哲学家和社会学家,带来了一个深度的视角,聚焦人工智能会在社会层面带来什么影响。就像刚才辛顿在演讲中所说的,他特别担心随着人工智能的快速发展,会对人类的文明和尊严造成怎样的影响,以及国家之间在这方面是如何进行竞争等问题。

基辛格给美国以及给中国提供了一个核心关键点的建议,就是要通过合作来防止 AI 带来的负面影响、拥抱它带来的正面影响。

人工智能带来的正面影响有很多,比如健康领域、工程领域、气候变化处理,不仅能推动科技的提升,还能帮助我们创造更好的社会等等,这些方面的优势是无限的。并且,人工智能为我们每个人的生产力提升提供了帮助。但是,我们目前最大的担忧是,如果你面对的这个智能体已非人类,并且比人类更聪明,那这时候该怎么办?

沈向洋: 你说的对,埃里克。其实在辛顿博士发言之前,我是很乐观的。但是听完他的发言后,我又感到很悲观。我现在有另一个非常关注的问题。你认为中美之间如何能够增强互信,并加强 AI 方面的合作呢?

埃里克·施密特: 首先,我想说的是,整个行业普遍认为这些问题是可以解决的,但我们需要迅速行动。

因为科技发展的速度非常快。但只要我们投入足够多的力量,付出足够的努力,就能解决一切问题。

我认为,未来超级智能之间的协作最终是不可避免的。因为随着技术的发展,我们将会拥有一个超级智能系统,未来这些系统会有能力去相互协作和协调。关于这一点的讨论已经逐渐展开。

所以,我们需要让中国和西方的研究人员能够互相交流,合作探讨,达成在价值观方面一致性,比如我们如何维护人类尊严和对人工智能的控制权等。

基辛格博士推动了一系列项目,和中国重要的领导者达成的一致意见:建立持续对话机制,让双方清晰界定问题并共同寻求解决路径。重点在于共享深度见解、风险研判与测试数据,避免任何一方因意外而产生误判。所以关键在于,让中国和西方的研究人员相互交流,在人工智能发展中共同守护人类尊严与主体地位。

WAIC 现场:中国的老朋友——基辛格

沈向洋: 我们都同意你说的。我们之间首先要进行对话交流,才能更好地理解对方的价值观。在思考这些科技在传播中的问题时,可能会面临到两个方面的问题:第一,AI 非常强大,我们需要思考如何防止其扩散?另一方面,您比任何人都更了解,并且支持开源技术。几十年前,Linux 系统和 Android 推动了开源技术的发展。您如何看待这两者之间的平衡?

埃里克·施密特: 我更倾向于支持开源。开源技术虽然有一些潜在风险,但我们可以通过设定一些限制措施来管理这些风险,并根据需要对其进行调整。与此不同,闭源公司通常受到政府监管,因此它们的操作受到更严格的控制,不容易出现这种问题。

我认为这里的核心是技术性的问题,我们可以与中国及其他开源技术的倡导者们合作。开源的扩散就像即时传播一样——如果你发明了一项技术,世界其他地方的人很快就会使用它。我们应该考虑这种方式,这里问题的关键在于技术的“编辑者”是谁,以及这些技术在哪些地方得以应用,在哪些地方去设置“防护栏”。理想的场景是,我们能根据人类的价值观来训练和对齐这些模型。

目前我们对深入研究一些模型的安全性还需要提升。在每一个案例中,只要稍微投入一点心力,就能够识别出 AI 会出现一些不良行为,比如撒谎和欺骗问题,我们也在努力避免这些问题。

目前我们还没有找到有效的制衡措施。这个问题尚未得到解决,但我认为它是非常重要的。如果基辛格博士今天在场,他一定会非常赞赏我们在技术上取得的进展,但他也会担忧,比如是否未来会有一些国家或个人可能会没有正确的利用这些强大的技术。

更进一步说,很多人认为在接下来的三年内,系统将会进行递归式自我改进。因此,我们必须非常小心,了解它们到底会学到什么,它们可能学习到的不仅是好的东西,也可能是有害的内容。

沈向洋: 再次回到您的作品,上次我有机会和基辛格博士交流时,正值他的第一本和您合著的的书上市,即《人工智能时代与人类未来》(我注意到上次您和我的好朋友、技术专家丹尼尔·胡腾洛赫尔合作撰写)。几年后,他的第二本书《人工智能时代与人类价值》出版,这也基辛格博士和您的最后一本书。您曾作为谷歌 CEO,近距离观察到全球科技行业的进展,也曾亲身参与推动谷歌、微软和苹果之间的激烈竞争,推动整个行业向前发展。关于您的管理经验、行业经验,是不是也会体现在自己的著作中?

埃里克·施密特: 基于克雷格·蒙迪(微软公司前首席研发策略长)和我的工作背景,可能我们更了解商业方面的情况。

在第二本书(《人工智能时代与人类价值》)中,我们在前面的部分也讲到了,从古到今,世界上有很多多才多艺的人。那么现在我们相信通过人工智能,可以让每个人都能够有一个多才多艺的工具来帮助自己。这对于企业、我们每个人的工作和生活来说都带来非常大的影响。但从总体来说,我们在治理、在相关讨论上面还没有做好准备。

我想说的是,作为最大的以及最重要的经济体,美国和中国应该在这些问题上一起合作。因为我们的共同目标在于,要一起让世界稳定,让世界和平,要确保人类能够控制住这些工具。

沈向洋: 在技术方面,你会不会不同意杰弗里·辛顿所说的——其实这些国家没有办法技术合作,或者说,他们只能在面对共同的威胁时才进行合作?

埃里克·施密特: 我是基辛格博士的学生,他的看法就是如果你坐下来,我们根据共同的目标进行谈判的话,就可以实现目标。他愿意和任何人坐下来谈。

在中国发展的历史长河中,从一穷二白到改革开放,建立了现代的生活,再到后来实现了巨大的飞跃和很多方面的巨大成功。我们也能看到,在中国的上海等城市能够生产一些先进的机器人等等,这些说明我们都有一个积极发展的价值观。

我是乐观主义者。我认为中国和美国可以建立信任,一步一步的建立,以前中美之间就曾经这样合作过,我们也可以再次做到这一点,

沈向洋: 谢谢 Eric。看来我们两个人对于未来的合作都很乐观。关于 AI 和技术的未来,对于您来说,最感到振奋的是什么?

埃里克·施密特: 简单来说,现在许多国家和企业都在进行战略规划。比如,OpenAI 的 ChatGPT、Claude、Gemini 等产品都取得了许多突破。我们也可以看到,中国的 DeepSeek 和其他大模型也做得非常出色。这就是我们当前的发展现状。

接下来的两年里,我们将会看到很多智能体的出现。智能体能够记忆语言,执行任务并采取行动,你可以驱动它们做事。这将是智能体革命对企业产生巨大的影响。

举个例子,这些智能体可以应用到每个企业的工作流、每个政府的工作流中,我对此感到非常振奋。如果这一点能够做好,那么接下来我们将能看到更多深度推理的应用和更先进算法的提升。

需要注意的是,我们现在还不知道“红线”在哪里。我认为一个重要的点是,中国、美国以及其他国家需要达成一致。

也就是说,在某些关键问题上,我们必须进行对话。举个例子,如果有一天,AI 开始自主决定获取武器,或者决定自我复制,或者它不经由我们同意开始学习所有事物,当这些事情发生时,我们的目标不是立即停止它的发展,而是要通过对话来探讨如何防止和控制这个过程,从而避免它失控。

对于未来的五年,我感到非常振奋。我们将看到社会发生深刻的变化,且大部分变化会让社会变得更好。如果能应对刚才讲到的关切,那么将会发展得很好。

当机器越来越“像人”,人会不会越来越“像机器”?基辛格、施密特和和微软前首席研究和战略官克雷格·蒙迪在《人工智能时代与人类价值》一书抛出了这个时代最尖锐的悖论。 三位作者以高度战略性的眼光,从关系人类社会核心的发现、大脑、现实、政治、安全、繁荣、科学、战略等八个方面出发,探索人工智能将给人类带来的挑战。

我们为读者准备三本《人工智能时代与人类价值》,现在关注“AI 前线”,后台回复“智能时代”,即可参与抽奖,有机会获得新书福利!