Qwen新模型3B激活媲美GPT-4o,消费级GPU也能跑!通用、长文本能力大增,已开源。

原文标题:凌晨,Qwen又更新了,3090就能跑,3B激活媲美GPT-4o

原文作者:机器之心

冷月清谈:

具体而言,Qwen3-30B-A3B-Instruct-2507在通用能力、多语言长尾知识覆盖、用户偏好对齐以及长文本理解(提升至256K)方面均实现了大幅提升。这款模型已在魔搭社区和HuggingFace等平台开源,用户也可在QwenChat上直接体验。值得关注的是,该模型能在搭载RTX 3090等消费级GPU的设备上运行,显著降低了运行高性能AI模型的硬件门槛,很快也得到社区量化版本支持,彰显了开源力量。

然而,文章也特别指出这是一个“非推理”模型。著名开发者Simon Willison对比后认为,对于生成复杂代码等特定任务而言,模型是否具备“推理”能力可能是一个关键因素。尽管各家团队在深夜“内卷”,但每天看到AI能力不断突破,也令人兴奋不已。

怜星夜思:

2、仅仅激活30亿参数就能与顶尖模型媲美,且能在RTX 3090这样的消费级GPU上流畅运行,这对于AI大模型的普及和个人用户参与AI创新意味着什么?未来AI模型是否会越来越“轻量化”?

3、Qwen作为国产开源模型,其性能能媲美GPT-4o等闭源模型。这会给当前的大模型市场格局带来怎样的影响?开源模型未来将如何与商业闭源模型进行竞争和协作?

原文内容

编辑:张倩

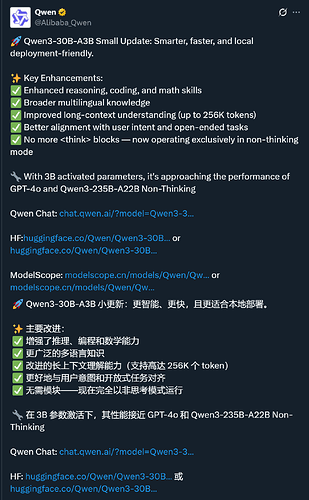

继前段时间密集发布了三款 AI 大模型后,Qwen 凌晨又更新了 —— 原本的 Qwen3-30B-A3B 有了一个新版本:Qwen3-30B-A3B-Instruct-2507。

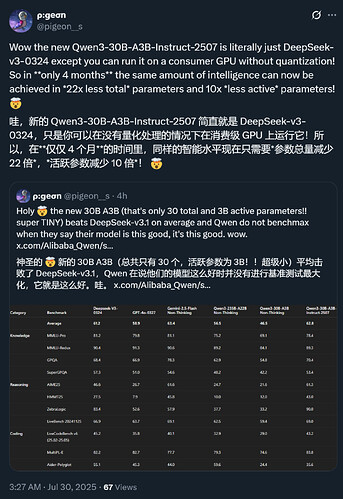

这个新版本是一个非思考模式(non-thinking mode)的新模型。它的亮点在于,仅激活 30 亿(3B)参数,就能展现出与业界顶尖闭源模型,如谷歌的 Gemini 2.5-Flash(非思考模式)和 OpenAI 的 GPT-4o 相媲美的超强实力,这标志着在模型效率和性能优化上的一次重大突破。

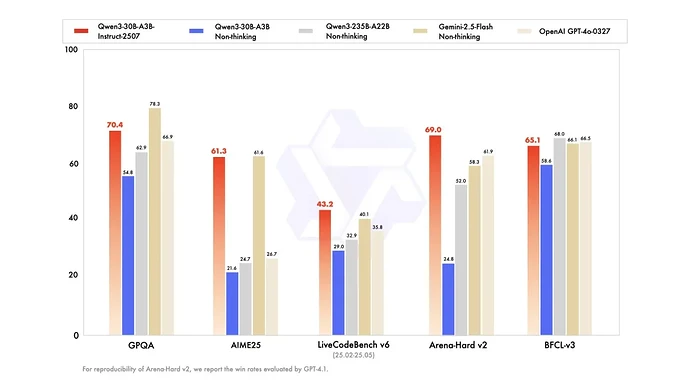

下图展示了该模型的性能数据,可以看出,与更新前的版本相比,新版本在多项测试中都实现了跨越式提升,比如 AIME25 从之前的 21.6 提升到了 61.3,Arena-Hard v2 成绩从 24.8 提升到了 69.0。

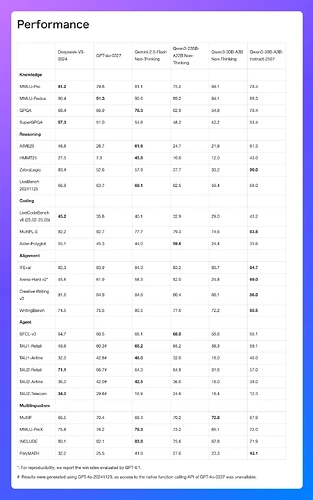

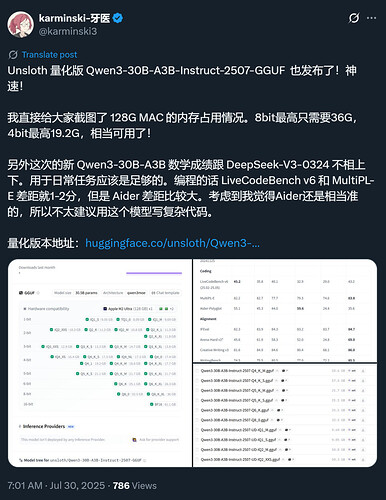

下图展示了新版本和 DeepSeek-V3-0324 等模型的性能对比结果,可以看到,在很多基准测试中,新版本模型可以基本追平甚至超过 DeepSeek-V3-0324。

这让人感叹模型计算效率的提升速度。

具体来说,Qwen3-30B-A3B-Instruct-2507 在诸多方面实现了关键提升:

-

通用能力大幅提升,包括指令遵循、逻辑推理、文本理解、数学、科学、编程及工具使用等多方面;

-

在多语言的长尾知识覆盖方面,模型进步显著;

-

在主观和开放任务中,新模型与进一步紧密对齐了用户偏好,可以生成更高质量的文本,为用户提供更有帮助的回答;

-

长文本理解能力提升至 256K。

现在模型已经在魔搭社区和 HuggingFace 等平台开源。QwenChat 上也可以直接体验。

体验链接:http://chat.qwen.ai/

该模型发布后也很快得到了社区的支持,有了更多的使用渠道,甚至还有了量化版本。这就是开源的力量。

它的出现,让大家在消费级 GPU 上运行 AI 模型有了新的选择。

有人晒出了这个新版本在自己的 Mac 电脑、搭载 RTX 3090 的 PC 等设备上的运行体验。

如果你也想运行这个模型,可以参考这个配置要求:

值得注意的是,这次的新版本模型是一个非推理模型。著名开发者 Simon Willison 将该模型与他之前测试过的「推理」 模型(如 GLM-4.5 Air)进行了对比。他得出的核心结论是:对于生成「开箱即用」的复杂代码这类任务,模型是否具备「推理」能力可能是一个至关重要的因素。

Qwen 团队的这次更新依然在深夜进行,这让其他同行再次感觉被卷到了。不过,每天醒来都能看到 AI 的能力又上了一个新台阶,这本身就是一件激动人心的事。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:liyazhou@jiqizhixin.com